Clear Sky Science · de

SynthEHR-eviction: Verbesserung der Erkennung von Zwangsräumungs‑SDoH mithilfe von LLM-unterstützten synthetischen EHR-Daten

Warum Wohnungsprobleme in medizinische Unterlagen gehören

Der Verlust der eigenen Wohnung kann die Gesundheit schwer schädigen, doch die meisten Gesundheitssysteme bemerken kaum, wenn es passiert. Dieser Artikel beschreibt eine neue Methode, künstliche Intelligenz so zu trainieren, dass sie Hinweise auf Zwangsräumung und verwandte soziale Belastungen in den Notizen von Ärztinnen und Ärzten erkennt. Indem sich ein geringer Einsatz von Expertenarbeit in einen großen, realistisch wirkenden Trainingssatz verwandelt, könnte der Ansatz Gesundheitseinrichtungen dabei helfen, gefährdete Personen früher zu identifizieren und mit Wohnungs‑ und Sozialhilfen zu verknüpfen.

Wenn der Verlust des Zuhauses die Gesundheit schädigt

Eine Zwangsräumung ändert mehr als nur die Adresse. Sie steht in Verbindung mit Obdachlosigkeit, Arbeitslosigkeit, Depressionen und sogar erhöhten Sterberaten, mit besonders starken Auswirkungen auf marginalisierte Gruppen und in Krisenzeiten wie der COVID‑19‑Pandemie. In den heutigen elektronischen Gesundheitsakten erscheinen Informationen über Wohnungsverlust oder Androhungen einer Zwangsräumung jedoch meist nur in freien Textfeldern, nicht in standardisierten Checkboxen oder Codes. Das erschwert es Krankenhäusern, Forschenden und Entscheidungsträgern zu erkennen, wo Zwangsräumungen stattfinden, wer am stärksten betroffen ist und wann interveniert werden sollte.

Aufbau realistischer „synthetischer“ Patientengeschichten

Da echte medizinische Notizen, die Zwangsräumungen klar erwähnen, selten und sensibel sind, entwickelten die Autorinnen und Autoren eine Pipeline namens SynthEHR‑Eviction, um realistisch wirkende, aber vollständig synthetische Beispiele zu erzeugen. Sie begannen mit Sozialanamnese‑Abschnitten realer Krankenhausentlassungsberichte und ließen große Sprachmodelle — KI‑Systeme, die auf umfangreichen Textsammlungen trainiert sind — diese umschreiben, sodass jede Notiz eine spezifische Wohn‑ oder Sozialsituation widerspiegelte. Expertinnen und Experten definierten sorgfältig 14 Kategorien, darunter detaillierte Zwangsräumungsstadien wie „anhängig“, „einvernehmliche Beendigung des Mietvertrags“ und „vergangene vs. aktuelle Zwangsräumung“, ebenso wie verwandte Probleme wie Obdachlosigkeit, Lebensmittelunsicherheit und Zahlungsprobleme. Durch einen iterativen Human‑in‑the‑loop‑Prozess überprüften Klinikerinnen und Kliniker Stichproben, markierten Fehler und gaben strukturiertes Feedback in den Prompt‑Prozess zurück, bis jeder KI‑„Augmenter“ hochpräzise Notizen mit minimaler Zweideutigkeit erzeugte. Das Ergebnis war ein großer öffentlicher Datensatz mit 8.000 synthetischen Trainingsnotizen sowie über 600 sorgfältig gelabelten Testnotizen, die synthetische Fälle mit de‑identifizierten Realbeispielen aus bedeutenden Forschungsdatenbanken mischen.

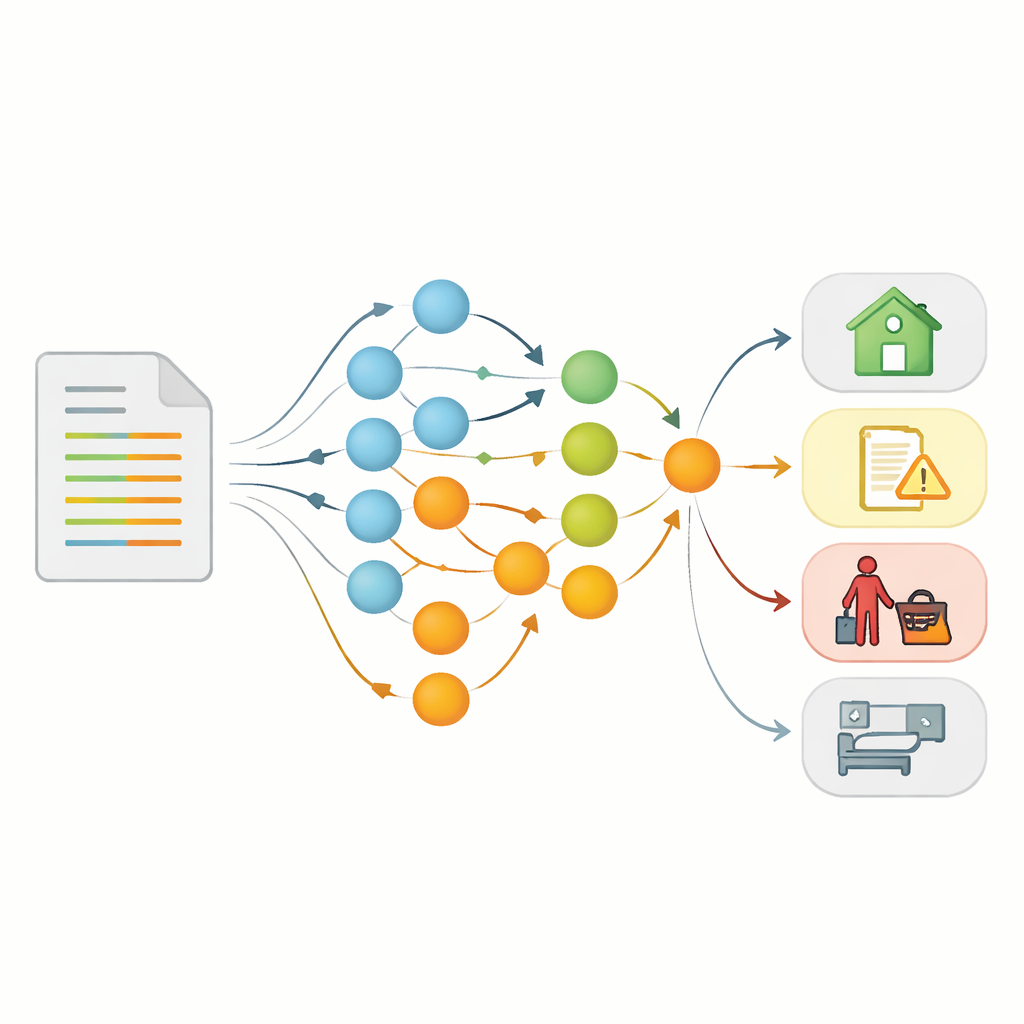

Computern beibringen, zwischen den Zeilen zu lesen

Auf Basis dieser synthetischen Geschichten entwickelte das Team ein automatisiertes Annotationssystem, das nicht nur eine Kategorie zuweist, sondern auch eine schrittweise Erklärung seiner Schlussfolgerung liefert. Mithilfe eines Frameworks namens DSPy optimierten sie Prompts, sodass die KI zunächst entscheidet, ob eine Notiz überhaupt Zwangsräumung thematisiert, und sie dann entweder an einen detaillierten Zwangsräumungs‑Klassifizierer oder an einen Klassifizierer für andere soziale Risiken wie Mobilitäts‑ oder Lebensmittelunsicherheit weiterleitet. Dieses Design spiegelt wider, wie ein menschlicher Leser zunächst fragen würde „Wird Zwangsräumung erwähnt?“ und erst danach in spezifischere Kategorien sortiert. Um manuelle Arbeit zu reduzieren, verglichen die Forschenden das vollständige menschliche Umschreiben und Labeln von 8.000 Notizen — über 260 Stunden Arbeit — mit ihrem KI‑unterstützten Workflow, der eine vergleichbare Datenqualität mit unter sechs Stunden Expertenzeit erreichte, eine Reduktion um 80 Prozent.

Wie gut die Modelle abschneiden

Mit SynthEHR‑Eviction feinabgestimmt, testeten die Autorinnen und Autoren eine Reihe Open‑Source‑Sprachmodelle und verglichen diese mit kommerziellen Systemen und älteren biomedizinischen Modellen. Für die einfache Aufgabe, zu entscheiden, ob überhaupt eine Zwangsräumung erwähnt wurde, erreichten viele Modelle gute Ergebnisse, am besten schnitten jedoch feinabgestimmte große Sprachmodelle und eine getunte GPT‑4‑Variante ab. Die anspruchsvollere Prüfung bestand darin, zwischen sieben nuancierten Zwangsräumungsstatus und einer separaten Gruppe von Nicht‑Zwangsräumungs‑sozialrisiken über drei Datensätze zu unterscheiden: synthetische Notizen, reale Krankenhausnotizen und ausführliche akademische Fallberichte. Hier erreichten feinabgestimmte Open‑Modelle wie Qwen2.5 und LLaMA‑3 Leistungen, die mit der optimierten GPT‑4 vergleichbar oder leicht besser waren, und erzielten Macro‑F1‑Werte — ein Maß, das Präzision und Vollständigkeit ausbalanciert — von etwa 0,89 für Zwangsräumung und über 0,90 für andere soziale Risiken. Kleinere Modelle mit nur drei Milliarden Parametern performten nach Feinabstimmung ebenfalls stark, was darauf hindeutet, dass leistungsfähige, gleichzeitig kostengünstigere Systeme in Umgebungen mit begrenzter Rechenkapazität einsetzbar sind.

Warum Begründungsspuren und reale Daten weiterhin wichtig sind

Die Studie zeigt, dass Erklärungen einigen Modellen mehr helfen als anderen. Wenn die Trainingsdaten kurze, explizite Begründungen dafür enthielten, warum eine Notiz einen bestimmten Zwangsräumungsstatus signalisierte, verbesserten sich kleinere Modelle deutlich, während die größten Modelle sich kaum veränderten — ein Hinweis darauf, dass diese bereits viel von dieser Logik kodiert hatten. Diese Begründungsspuren erleichtern auch Expertinnen und Experten die Überprüfung von Modellentscheidungen, wobei die Autorinnen und Autoren jedoch davor warnen, dass Erklärungen nicht immer vollkommen treu die tatsächliche Entscheidungslogik des Modells widerspiegeln. Ein weiterer zentraler Befund ist, dass ausschließlich auf synthetischen Notizen trainierte Modelle bei unordentlicher realer Schreibweise Probleme bekommen. Das einfache Beimischen eines moderaten Anteils realer Krankenhaus‑ oder Fallberichtnotizen verbesserte die Leistung in diesen Domänen deutlich — ein Hinweis darauf, dass synthetische Daten mächtig, aber allein nicht ausreichend sind.

Vom verborgenen Risiko zur sichtbaren Hilfe

Insgesamt zeigt der Artikel, dass sorgfältig gestaltete synthetische Daten in Kombination mit gezielter Expertenaufsicht verstreute Erwähnungen von Zwangsräumung und anderen Härten in strukturierte Signale verwandeln können, die Computer großflächig erkennen. Einfach gesagt lernt das System, zwischen den Zeilen von Ärztenotizen zu lesen und zu markieren, wenn ein Patient mit Wohnungsverlust oder verwandten sozialen Belastungen konfrontiert ist oder war. Integriert in elektronische Gesundheitsakten könnten solche Werkzeuge helfen, dass Klinikerinnen und Kliniker sowie Sozialarbeiterinnen und Sozialarbeiter gefährdete Personen früher erkennen und mit Wohnungsunterstützung, finanzieller Beratung oder Mobilitätshilfen verknüpfen. Indem die unsichtbare soziale Seite von Krankheit sichtbarer gemacht wird, bietet SynthEHR‑Eviction einen Weg hin zu einer Gesundheitsversorgung, die die gesamten Lebensumstände der Patientinnen und Patienten sieht und darauf reagiert.

Zitation: Yao, Z., Zhao, Y., Mitra, A. et al. SynthEHR-eviction: enhancing eviction SDoH detection with LLM-augmented synthetic EHR data. npj Digit. Med. 9, 292 (2026). https://doi.org/10.1038/s41746-026-02473-0

Schlüsselwörter: Zwangsräumung, soziale Determinanten der Gesundheit, elektronische Gesundheitsakten, synthetische Daten, klinische natürliche Sprachverarbeitung