Clear Sky Science · fr

SynthEHR-eviction : améliorer la détection des déterminants sociaux du logement liés à l’expulsion grâce à des DSE synthétiques augmentés par des LLM

Pourquoi les problèmes de logement ont leur place dans les dossiers médicaux

Être chassé de son logement peut dévaster la santé, pourtant la plupart des systèmes médicaux ne remarquent guère lorsque cela arrive. Cet article décrit une nouvelle méthode pour apprendre à l’intelligence artificielle à repérer les signes d’expulsion et les difficultés sociales associées dans les notes des médecins. En transformant un petit travail d’experts en un large jeu d’entraînement réaliste, l’approche pourrait aider les systèmes de santé à identifier plus tôt les personnes à risque et à les mettre en relation avec des aides au logement et des services sociaux.

Quand la perte d’un logement nuit à la santé

L’expulsion ne se limite pas à un simple changement d’adresse. Elle est liée à la précarité, au sans‑abrisme, au chômage, à la dépression et même à un surcroît de mortalité, avec des impacts particulièrement lourds sur les populations marginalisées et en période de crise comme la pandémie de COVID‑19. Pourtant, dans les dossiers médicaux électroniques actuels, les informations sur la perte de logement ou les menaces d’expulsion apparaissent généralement seulement dans des notes en texte libre, et non sous forme de cases à cocher ou de codes standardisés. Cela rend difficile pour les hôpitaux, les chercheurs et les décideurs de savoir où l’expulsion se produit, qui est le plus touché et quand intervenir.

Construire des récits patients « synthétiques » réalistes

Parce que les notes médicales réelles mentionnant clairement une expulsion sont rares et sensibles, les auteurs ont créé une chaîne de traitement appelée SynthEHR‑Eviction pour générer des exemples réalistes mais entièrement synthétiques. Ils sont partis des sections d’antécédents sociaux de vrais comptes rendus de sortie d’hôpital et ont utilisé des grands modèles de langage — des systèmes d’IA entraînés sur d’immenses corpus textuels — pour les réécrire afin que chaque note reflète une situation de logement ou sociale précise. Des experts ont soigneusement défini 14 catégories, incluant des stades détaillés d’expulsion comme « en attente », « accord mutuel de résiliation de bail », et « expulsion passée vs actuelle », ainsi que des problématiques connexes telles que le sans‑abrisme, l’insécurité alimentaire et les difficultés à payer les factures. Via un processus itératif incluant l’humain, des cliniciens ont passé en revue des échantillons de sorties, signalé les erreurs et réinjecté des retours structurés dans le processus de prompt jusqu’à ce que chaque « augmentateur » IA produise des notes très précises et peu ambiguës. Le résultat est un large jeu de données public contenant 8 000 notes d’entraînement synthétiques ainsi que plus de 600 notes de test soigneusement étiquetées, mélangeant cas synthétiques et exemples réels dé‑identifiés extraits de grandes bases de recherche.

Apprendre aux ordinateurs à lire entre les lignes

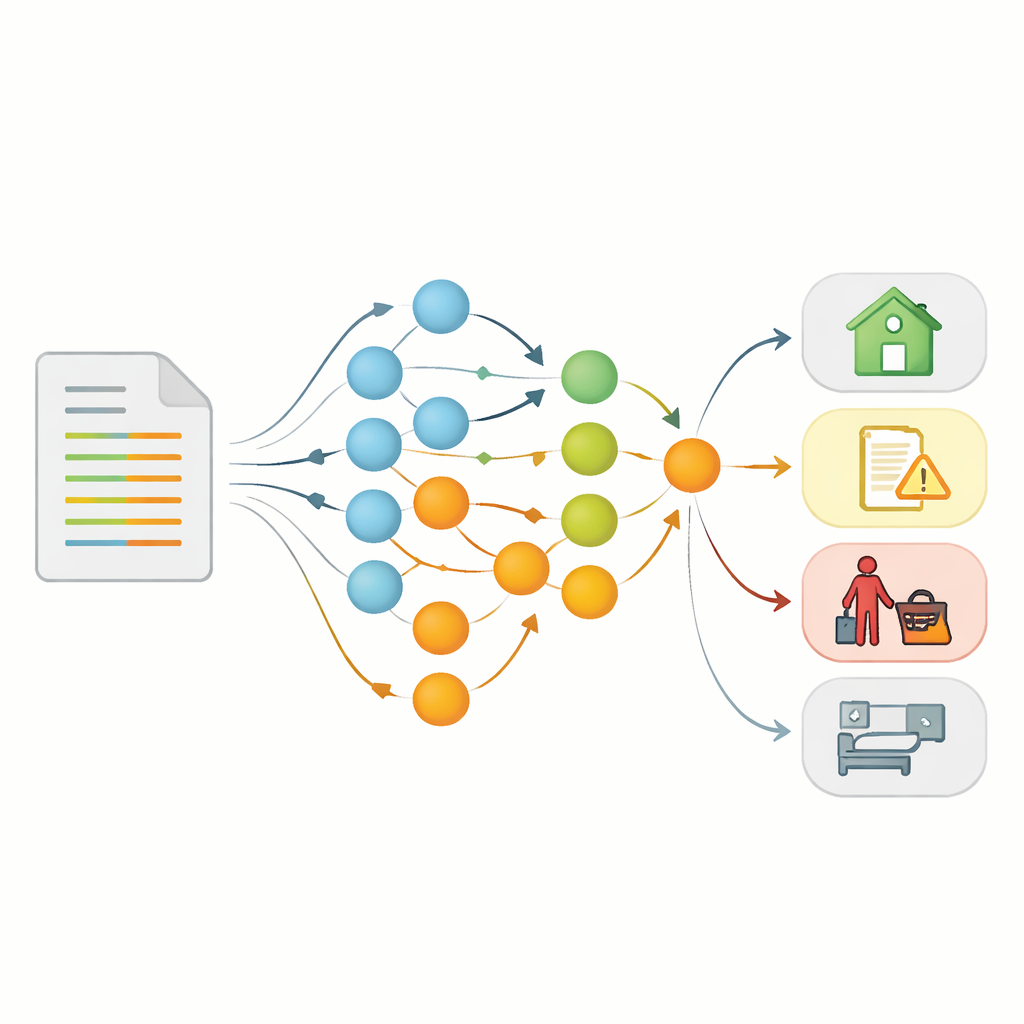

Sur la base de ces récits synthétiques, l’équipe a construit un système d’annotation automatisé qui non seulement assigne une catégorie, mais produit aussi une explication pas à pas de son raisonnement. En utilisant un cadre appelé DSPy, ils ont optimisé les prompts pour que l’IA décide d’abord si une note concerne ou non une expulsion, puis l’oriente soit vers un classifieur détaillé d’expulsion, soit vers un classifieur pour d’autres risques sociaux comme les difficultés de transport ou l’insécurité alimentaire. Cette conception reflète la façon dont un lecteur humain pourrait d’abord se demander « L’expulsion est‑elle mentionnée ? » avant de classer le cas dans des rubriques plus spécifiques. Pour réduire le travail manuel, les chercheurs ont comparé la réécriture et l’étiquetage humains complets de 8 000 notes — plus de 260 heures de travail — avec leur flux de travail assisté par IA, qui a atteint une qualité de données comparable en moins de six heures de temps d’expert, soit une réduction de 80 %.

Performance des modèles

Armés de SynthEHR‑Eviction, les auteurs ont ensuite affiné une gamme de modèles de langage open source et les ont comparés à des systèmes commerciaux et à des modèles biomédicaux plus anciens. Pour la tâche simple consistant à déterminer si l’expulsion était mentionnée ou non, de nombreux modèles ont bien performé, mais les grands modèles de langage affinés et une variante GPT‑4 ajustée ont obtenu les meilleurs scores. Le test plus difficile consistait à distinguer sept statuts nuancés d’expulsion et un ensemble séparé de risques sociaux non liés à l’expulsion sur trois jeux de données : notes synthétiques, notes d’hôpital réelles et longs rapports de cas académiques. Ici, des modèles open‑source affinés tels que Qwen2.5 et LLaMA‑3 ont égalé ou légèrement surpassé la performance d’un GPT‑4 optimisé, atteignant des scores macro‑F1 — une mesure globale équilibrant précision et rappel — autour de 0,89 pour l’expulsion et supérieurs à 0,90 pour les autres risques sociaux. Des modèles plus petits, d’environ trois milliards de paramètres, ont aussi montré de bonnes performances une fois affinés, ce qui suggère que des systèmes capables et économiques peuvent être déployés dans des environnements à ressources informatiques limitées.

Pourquoi les traces de raisonnement et les données réelles restent importantes

L’étude montre que les explications aident certains modèles plus que d’autres. Quand les données d’entraînement comprenaient de courts raisonnements explicites expliquant pourquoi une note signalait un certain statut d’expulsion, les modèles plus petits se sont améliorés sensiblement, tandis que les plus grands ont peu changé, laissant penser qu’ils avaient déjà encodé une grande partie de cette logique. Ces traces de raisonnement facilitent aussi la révision des décisions par des experts, bien que les auteurs préviennent que les explications ne reflètent pas toujours fidèlement la façon exacte dont le modèle prend ses décisions. Une autre conclusion clé est que les modèles entraînés uniquement sur des notes synthétiques peinent face à l’écriture désordonnée du monde réel. Le simple fait d’ajouter une part modeste de notes d’hôpital réelles ou de rapports de cas augmente fortement les performances sur ces domaines, soulignant que les données synthétiques sont puissantes mais pas suffisantes à elles seules.

De la vulnérabilité cachée à l’aide visible

Globalement, l’article montre que des données synthétiques soigneusement conçues, combinées à une supervision experte ciblée, peuvent transformer des mentions éparses d’expulsion et d’autres difficultés en signaux structurés que les ordinateurs peuvent détecter à grande échelle. En termes simples, le système apprend à lire entre les lignes des notes des médecins et à signaler quand un patient fait face ou a fait face à une perte de logement ou à des tensions sociales associées. Intégrés aux dossiers médicaux électroniques, de tels outils pourraient aider cliniciens et travailleurs sociaux à repérer plus tôt les personnes à risque et à les orienter vers une aide au logement, un accompagnement financier ou un soutien en matière de transport. En rendant plus visible la dimension sociale souvent cachée de la maladie, SynthEHR‑Eviction ouvre une voie vers des soins qui voient et prennent en compte l’ensemble des circonstances de la vie des patients.

Citation: Yao, Z., Zhao, Y., Mitra, A. et al. SynthEHR-eviction: enhancing eviction SDoH detection with LLM-augmented synthetic EHR data. npj Digit. Med. 9, 292 (2026). https://doi.org/10.1038/s41746-026-02473-0

Mots-clés: expulsion, déterminants sociaux de la santé, dossiers médicaux électroniques, données synthétiques, traitement automatique du langage clinique