Clear Sky Science · fr

Estimation de l'affaissement induit par la liquéfaction des fondations superficielles par apprentissage automatique avec des données déséquilibrées

Pourquoi le sol qui tremble compte pour les bâtiments quotidiens

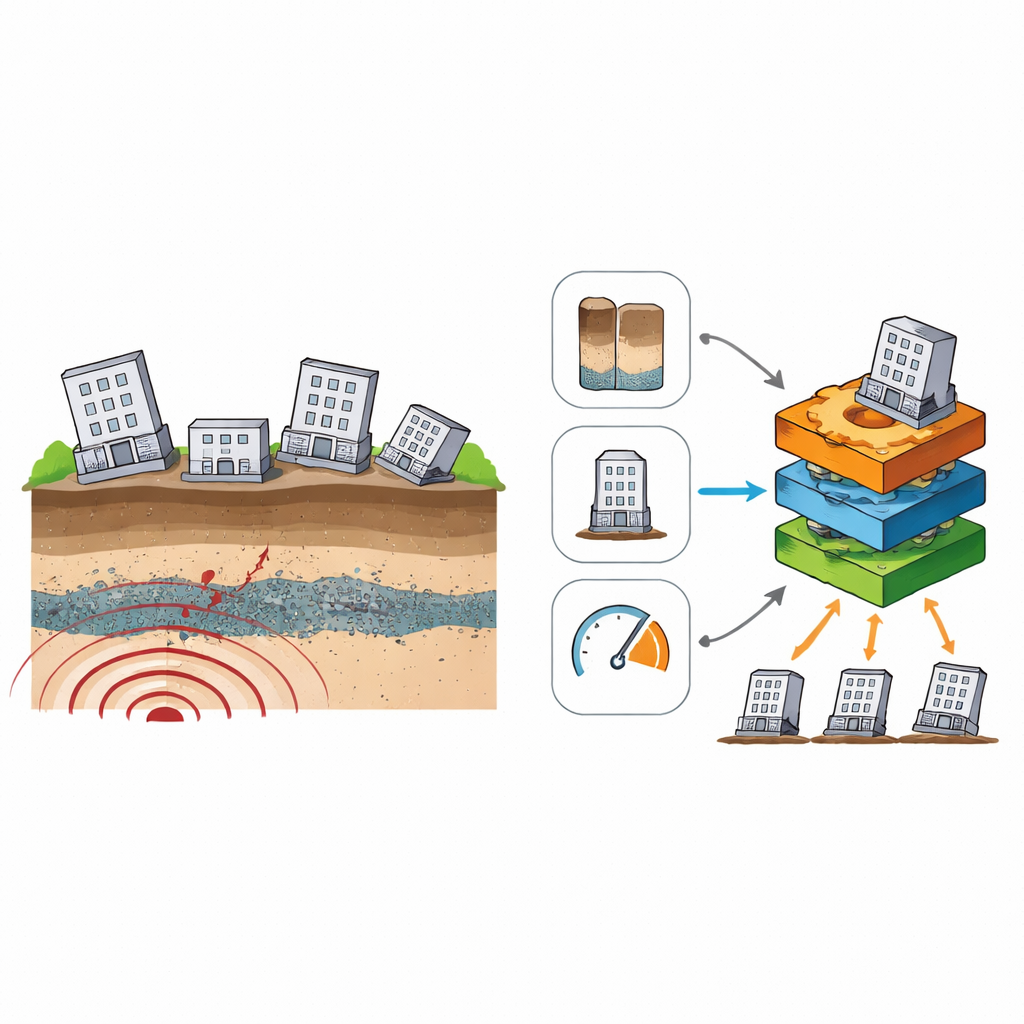

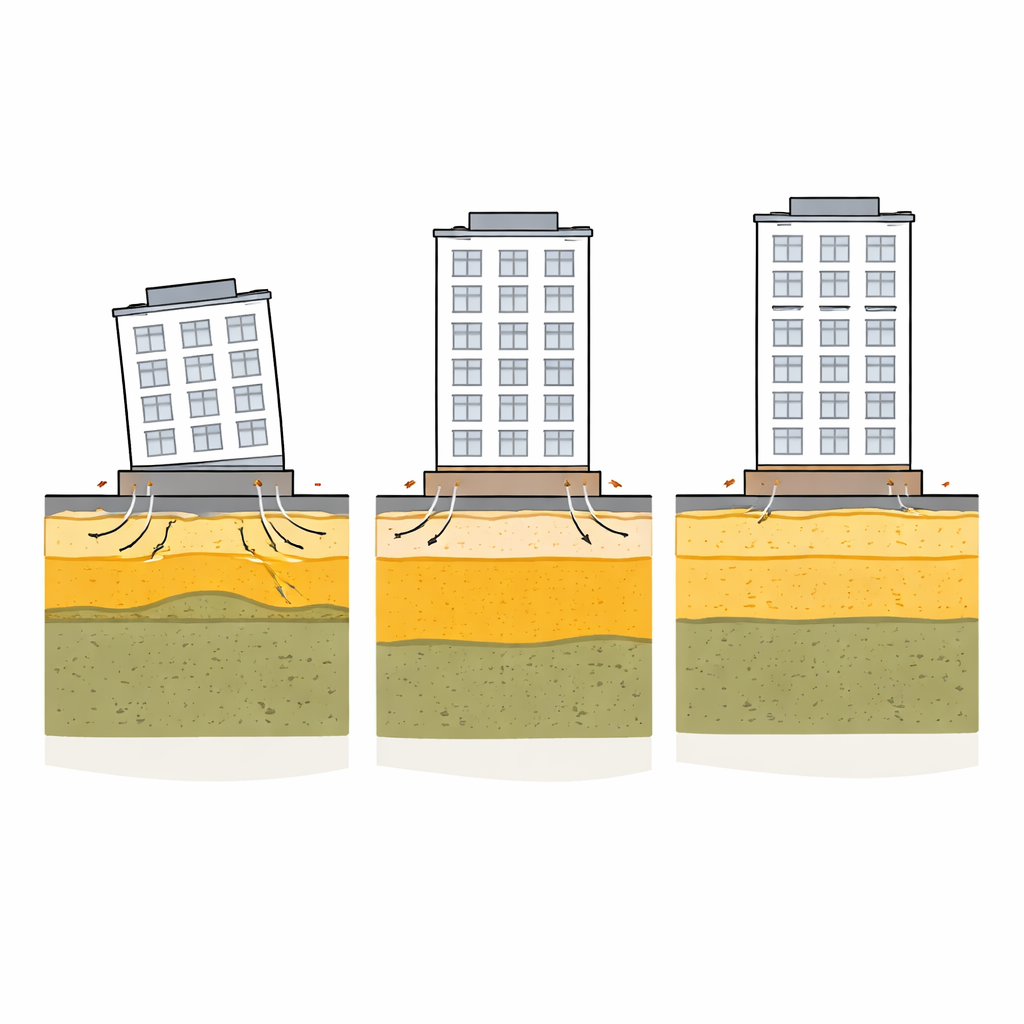

Lorsqu'un fort séisme survient, un sol qui paraît solide peut momentanément se comporter comme un liquide, entraînant l'enfoncement, l'inclinaison ou la fissuration des bâtiments. Ce phénomène, appelé liquéfaction, a endommagé des habitations et des infrastructures lors de nombreux séismes récents, de la Turquie au Japon. Les ingénieurs savent que quelques dizaines de centimètres d'affaissement inégal suffisent à rendre un bâtiment dangereux ou inutilisable. Pourtant, prédire combien un bâtiment donné va s'enfoncer, à partir de données de site limitées, reste difficile. Cette étude examine comment les outils modernes d'apprentissage automatique peuvent transformer des historiques d'événements dispersés issus de séismes réels en une méthode pratique pour anticiper les dégâts liés à la liquéfaction et orienter des conceptions plus sûres, des décisions d'assurance et des inspections post-catastrophe.

Des rapports de cas dispersés à une base de données sismiques mondiale

Les chercheurs ont commencé par constituer une base de données mondiale de 206 bâtiments ayant subi des ruptures de terrain liées à la liquéfaction lors de séismes passés. Pour chaque cas, ils ont rassemblé des informations simples souvent disponibles en pratique : l'intensité des secousses au site, la hauteur et la largeur totales du bâtiment, la pression exercée par le bâtiment sur sa fondation, et des propriétés clés des couches de sol sous-jacentes — en particulier la profondeur de la première couche susceptible de liquéfier et son épaisseur. Plutôt que de chercher à calculer un affaissement exact en centimètres, ils ont regroupé les issues en quatre niveaux de dommage, allant d'aucun affaissement visible à un affaissement et une inclinaison étendus. Cet « indice de rupture de terrain » transforme des mesures réelles imprécises en catégories claires utilisables pour entraîner et tester des modèles d'apprentissage automatique.

Apprendre aux ordinateurs à repérer des motifs dangereux dans des données inégales

Les enregistrements sismiques réels sont loin d'être ordonnés : certains types de dommages sont fréquents tandis que d'autres sont rares, et les variables d'entrée peuvent contenir des valeurs aberrantes et du bruit. Dans ce jeu de données, les cas de dommages sévères étaient beaucoup plus fréquents que les cas modérés, créant un fort déséquilibre susceptible d'induire en erreur de nombreux algorithmes qui négligent la classe la plus rare. Pour y faire face, les auteurs ont combiné plusieurs stratégies de manière systématique. Ils ont nettoyé les données avec des méthodes de filtrage des valeurs aberrantes, puis exploré deux approches complémentaires pour gérer le déséquilibre : la copie artificielle des cas minoritaires (suréchantillonnage aléatoire) et l'incitation des algorithmes à considérer les erreurs sur les classes rares comme plus coûteuses (apprentissage à coût sensible). Pour éviter des résultats excessivement optimistes, toutes ces étapes ont été réalisées dans un flux de travail strict « sans fuite », dans lequel les données de test restaient complètement inconnues pendant l'entraînement, l'ajustement et le rééchantillonnage des modèles.

Quels facteurs et modèles capturent le mieux le risque d'affaissement ?

Plusieurs modèles largement utilisés ont été mis à l'épreuve, notamment les forêts aléatoires, les méthodes de gradient boosting, un réseau de neurones artificiel et un ensemble qui moyenne les prédictions de plusieurs modèles. Parce que la précision globale peut masquer une mauvaise performance sur des niveaux de dommages rares mais importants, l'équipe a mis l'accent sur le rappel — c'est-à-dire la proportion de cas réellement sévères correctement détectés par le modèle — comme métrique clé. Le Gradient Boosting et un ensemble de modèles basés sur des arbres se sont révélés les options les plus fiables, en particulier lorsqu'ils étaient combinés au suréchantillonnage aléatoire, à un traitement minutieux des valeurs aberrantes et à des seuils de décision finement ajustés. Pour comprendre ce que les modèles « regardaient », les auteurs ont utilisé SHAP, un outil qui décompose chaque prédiction en contributions des caractéristiques individuelles. Cette analyse a montré que la profondeur de la première couche susceptible de liquéfier était le facteur le plus influent, suivi de l'intensité des secousses et de la géométrie de base de la fondation, comme la largeur du bâtiment. En termes simples, des couches superficielles facilement liquéfiables situées sous des fondations étroites étaient systématiquement associées aux dommages les plus graves.

Tester l'approche sur des études de cas sismiques réelles

Pour vérifier si leurs méthodes fonctionnaient en dehors de l'échantillon d'entraînement, les chercheurs ont appliqué les modèles finaux à quatre études de cas détaillées issues de séismes bien connus, notamment l'événement de Loma Prieta de 1989 en Californie, le séisme de Kocaeli en 1999 en Turquie, la séquence de Kumamoto de 2016 au Japon et le séisme de Kahramanmaraş de 2023 en Turquie. Dans ces exemples, les seules entrées étaient des estimations simples de l'intensité des secousses, des dimensions et des charges du bâtiment, et de la profondeur et de l'épaisseur des couches susceptibles de liquéfier issues d'essais de terrain. Les modèles ont généralement correspondu à la gravité observée des affaissements, identifiant correctement à la fois les niveaux de dommages mineurs et étendus. Dans un cas, le modèle a volontairement fait une erreur par excès de prudence en prédisant une classe de dommage supérieure à celle rapportée. Les auteurs soutiennent que, dans des contextes à enjeux élevés comme la résilience sismique, de telles prévisions conservatrices sont préférables à l'omission de bâtiments gravement endommagés.

Un outil fondé sur les données pour des villes plus sûres sur sols mous

Ce travail ne remplace pas les formules traditionnelles basées sur la physique pour estimer l'affaissement, qui restent essentielles lorsque des résultats détaillés d'essais de sol sont disponibles. Il offre plutôt un outil complémentaire : une manière transparente et fondée sur les données de classer les bâtiments en grandes catégories de risque en utilisant un petit ensemble de paramètres régulièrement collectés. En traitant soigneusement les données déséquilibrées, en évitant les biais cachés dans l'évaluation et en révélant quelles caractéristiques du sol et du bâtiment importent le plus, le cadre d'apprentissage automatique proposé fournit aux ingénieurs, planificateurs et assureurs une aide pratique d'alerte précoce. Dans les régions bâties sur des sols mous saturés d'eau, il peut aider à prioriser les bâtiments les plus susceptibles de subir des affaissements et des inclinaisons dangereuses lors du prochain séisme majeur.

Citation: Sargin, S., Korkmaz, G., Yildirim, A.K. et al. Estimation of liquefaction-induced settlement of shallow foundation by machine learning with imbalanced data. Sci Rep 16, 11198 (2026). https://doi.org/10.1038/s41598-026-41969-3

Mots-clés: liquéfaction des sols, génie parasismique, apprentissage automatique, affaissement des bâtiments, risque sismique