Clear Sky Science · de

Objektverfolgungsalgorithmus basierend auf einem deformierbaren Aufmerksamkeitsmechanismus

Die Spur halten in einer vollen, chaotischen Welt

Moderne Kameras überwachen belebte Straßen, Einkaufszentren und Fabrikhallen, doch Computern beizubringen, vielen sich bewegenden Menschen und Objekten in diesen Szenen zu folgen, ist überraschend schwierig. Wenn jemand hinter einer Säule verschwindet, Scheinwerfer blenden oder eine Menschenmenge durch eine Tür drängt, können selbst fortgeschrittene Tracking‑Programme die Spur verlieren, Identitäten verwechseln oder zu viel Rechenleistung verbrauchen. Dieses Paper stellt einen neuen Tracking‑Ansatz vor, der in solchen realen, chaotischen Situationen zuverlässiger an Zielen festhält und gleichzeitig effizient genug für den praktischen Einsatz bleibt.

Warum herkömmliches Tracking an seine Grenzen stößt

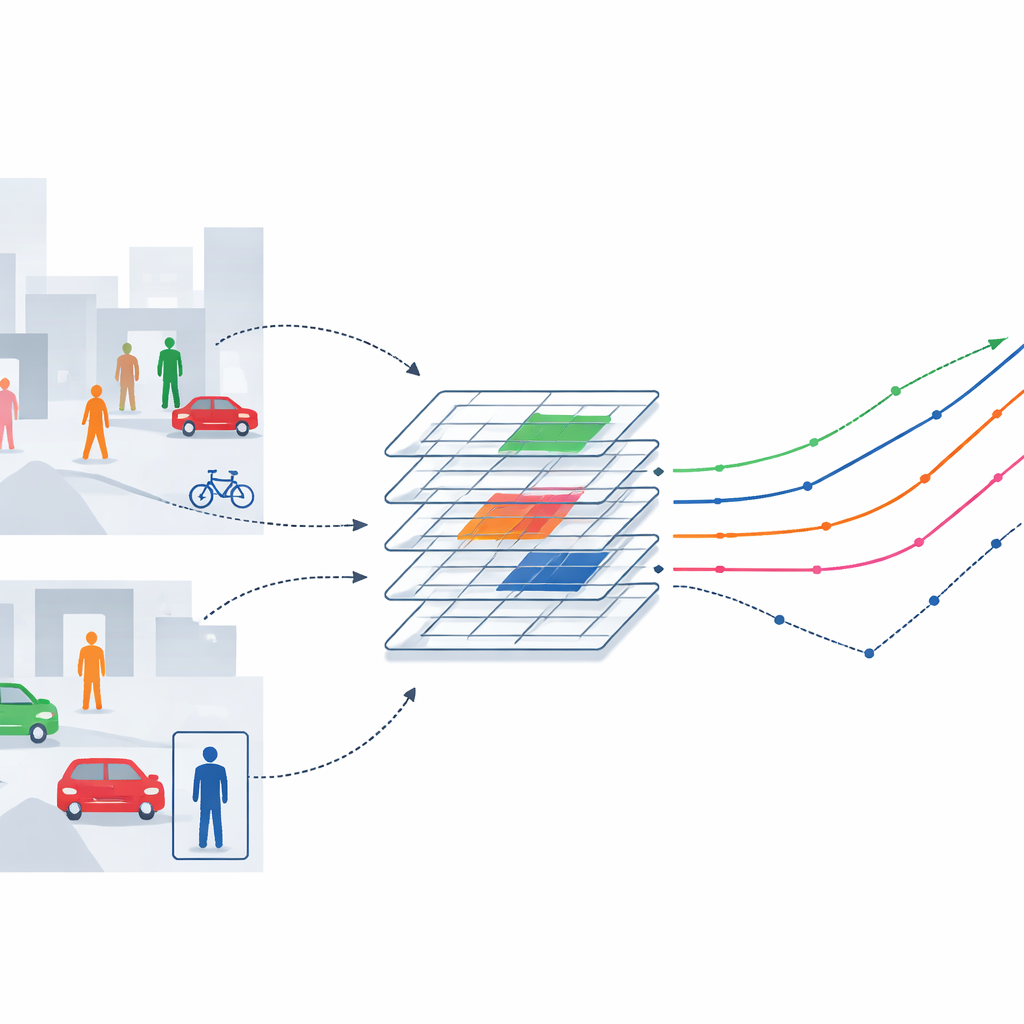

Objekt‑Tracking‑Systeme arbeiten meist in drei Schritten: Zunächst analysieren sie jedes Videobild, um visuelle Merkmale zu extrahieren, dann kombinieren sie Informationen aus unterschiedlichen Skalen und Bereichen, und schließlich sagen sie vorher, wie sich jedes Ziel über die Zeit bewegt. Viele aktuelle Methoden verbessern jeweils nur einen dieser Schritte — etwa indem der Detektor besser gemacht, Berechnungen beschleunigt oder Bewegungsmodelle intelligenter gestaltet werden. In dichten, schnell wechselnden Szenen treten jedoch Schwachstellen in den Schnittstellen dieser Teile zutage. Feste „Sichtfelder“ in Standardnetzwerken können sich nicht um gebogene Körper oder veränderte Posen legen, und Bewegungsprognosen, die von glatten, einfachen Bewegungen ausgehen, können stark abdriften, wenn Personen stehen bleiben, abdrehen oder kurz hinter Hindernissen verschwinden.

Ein flexibles Auge für bewegte Ziele

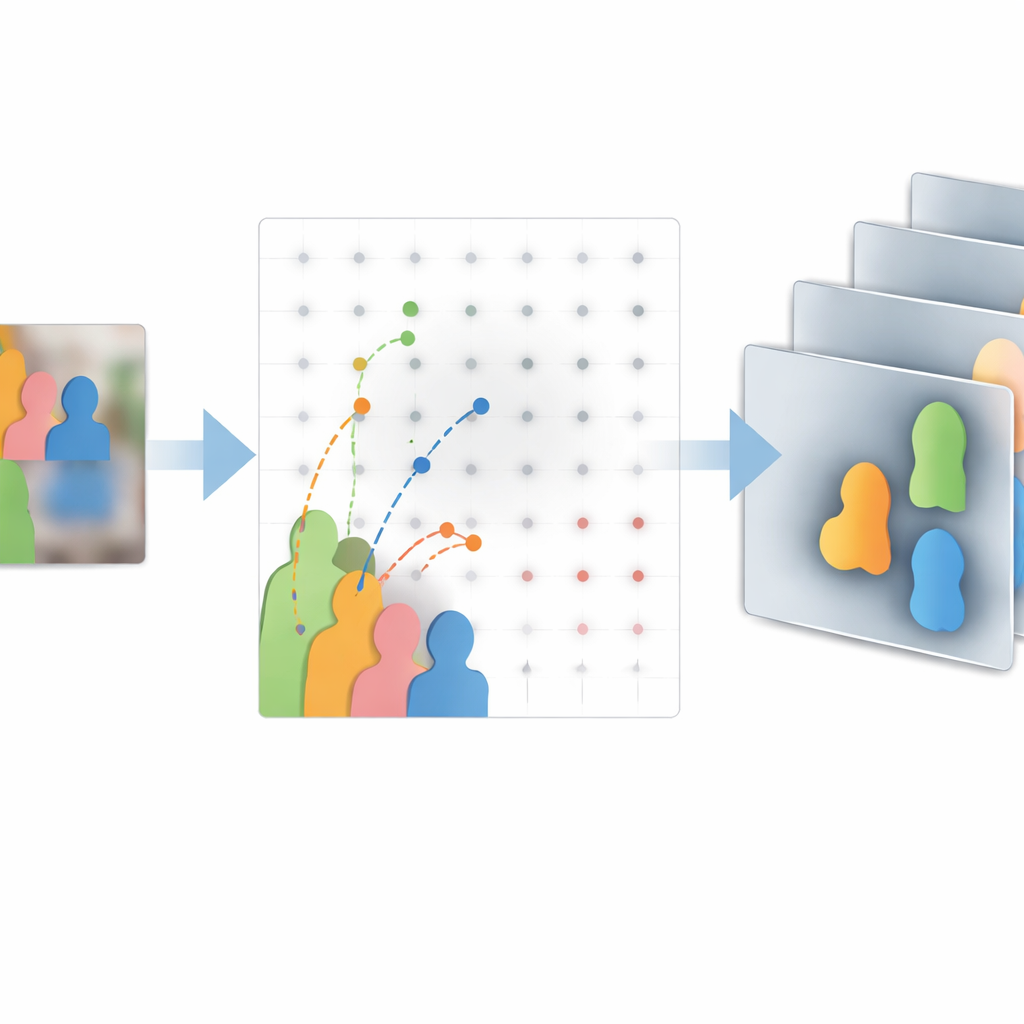

Die Autoren begegnen diesen Einschränkungen, indem sie dem Tracking‑System eine flexiblere Art des „Hinsehens“ geben. Sie bauen auf einem verbreiteten Bild‑Backbone namens ResNet‑18 auf und integrieren einen deformierbaren Aufmerksamkeitsmechanismus. Statt visuellen Input stets an starren, gleichmäßig verteilten Punkten abzutasten, lernt dieser Mechanismus, seine Abtastpositionen zu den informationsreichsten Stellen einer Person oder eines Objekts zu verschieben — etwa entlang der Kontur von Rumpf oder Kopf — und gleichzeitig störenden Hintergrund auszublenden. Indem diese flexible Aufmerksamkeit in tiefere Schichten des Netzwerks eingefügt wird, kann das System seinen Fokus anpassen, wenn sich Pose oder Größe ändern oder Teile verdeckt sind, ohne die Rechenlast stark zu erhöhen. Tests auf großen Benchmarks zeigen, dass dieses flexible Auge die Tracking‑Genauigkeit verbessert und dabei die Rechenkosten um weniger als 8 % und die Parameterzahl nur geringfügig erhöht.

Details über Skalen und Zeit hinweg verbinden

Die gleichzeitige Verfolgung vieler Objekte erfordert außerdem, dass das System sowohl feine Details als auch das große Bild versteht. Dazu nutzt die Methode ein spezielles Feature‑Fusionsmodul, eine bidirektionale Feature‑Pyramide, die Informationen aus groben, hochstufigen und feinen, niedrigstufigen Ansichten mischt. Die Autoren ergänzen dieses Modul mit derselben deformierbaren Aufmerksamkeit, wodurch es besser gelingt, Merkmale auszurichten, die sonst bei Überlappungen oder schnellen Bewegungen schlecht zusammenpassen würden. Das hilft, einzelne Personen in dichten Menschenmengen zu trennen und Identitätsverwechslungen zu reduzieren. Auf der zeitlichen Ebene setzt der Algorithmus auf ein klassisches Werkzeug der Regelungstheorie, den Kalman‑Filter, jedoch in intelligenterer Form. Anstatt die Modellvorhersage als ausschlaggebende Wahrheit und den Detektor als kleine Korrektur zu behandeln, wird das Verhalten des Filters von der Vertrauenswürdigkeit des Detektors in jedem Frame gesteuert. Ist der Detektor sicher, vertraut das System ihm direkt und verhindert so Fehlerakkumulation; ist er unsicher, stützt sich der Filter stärker auf vergangene Bewegungen und mischt beide Quellen glatt miteinander.

Wie gut funktioniert das in der Praxis?

Das Team bewertet seinen Ansatz — DAM‑Track genannt — auf herausfordernden öffentlichen Datensätzen, die Tracking‑Algorithmen auf die Probe stellen. Bei Single‑Object‑Tests, die lange Sequenzen und schwierige Situationen wie starke Deformationen und vollständige Okklusion betonen, verbessert das deformierbare Attention‑Backbone Überlappungs‑ und Erfolgsraten gegenüber dem Standard‑ResNet‑18, ohne hohe Zusatzkosten. Auf einem bekannten Multi‑Object‑Benchmark mit extrem dichten Fußgängermengen erreicht DAM‑Track höhere Gesamtgenauigkeit, schärfere Lokalisierung und bessere Identitätskonsistenz als weit verbreitete Methoden wie ByteTrack und DeepSORT. Es hält mehr Trajektorien länger aufrecht, verliert weniger Ziele und vermeidet besonders häufig Identitätswechsel — ein kritischer Punkt für Anwendungen wie Sicherheitsüberwachung und Verkehrsanalysen.

Was das für alltägliche Anwendungen bedeutet

Für Nicht‑Spezialisten ist die Schlussfolgerung, dass diese Arbeit Tracker in der Computer Vision widerstandsfähiger gegenüber den chaotischen, unvorhersehbaren Szenen macht, die im praktischen Einsatz am wichtigsten sind — von Bahnhöfen und Straßen bis zu intelligenten Geschäften und autonomen Fahrzeugen. Indem das Systemgaze zu wichtigen Regionen hin verschiebbar wird und die Merkmalsextraktion, Multiskalenfusion und Bewegungsprognose über ein gemeinsames Vertrauenskonzept koordiniert werden, bauen die Autoren einen geschlossen arbeitenden Tracker, der besser nachverfolgt, wer sich wo befindet. Weitergehende Tests bei Nacht, aus der Luft und in Multi‑Kamera‑Szenarien sind noch nötig; doch dieses flexible, vertrauensbewusste Design weist auf eine neue Generation von Tracking‑Systemen hin, die komplexe Umgebungen zuverlässiger überwachen können, ohne unpraktisch hohe Rechenressourcen zu verlangen.

Zitation: Liu, Q., Yu, N. & Cheng, J. Object tracking algorithm based on deformable attention mechanism. Sci Rep 16, 12454 (2026). https://doi.org/10.1038/s41598-026-43147-x

Schlüsselwörter: Mehrfach-Objekt-Verfolgung, Computer Vision, Aufmerksamkeitsmechanismen, Überwachung in Menschenmengen, Autonomes Fahren