Clear Sky Science · de

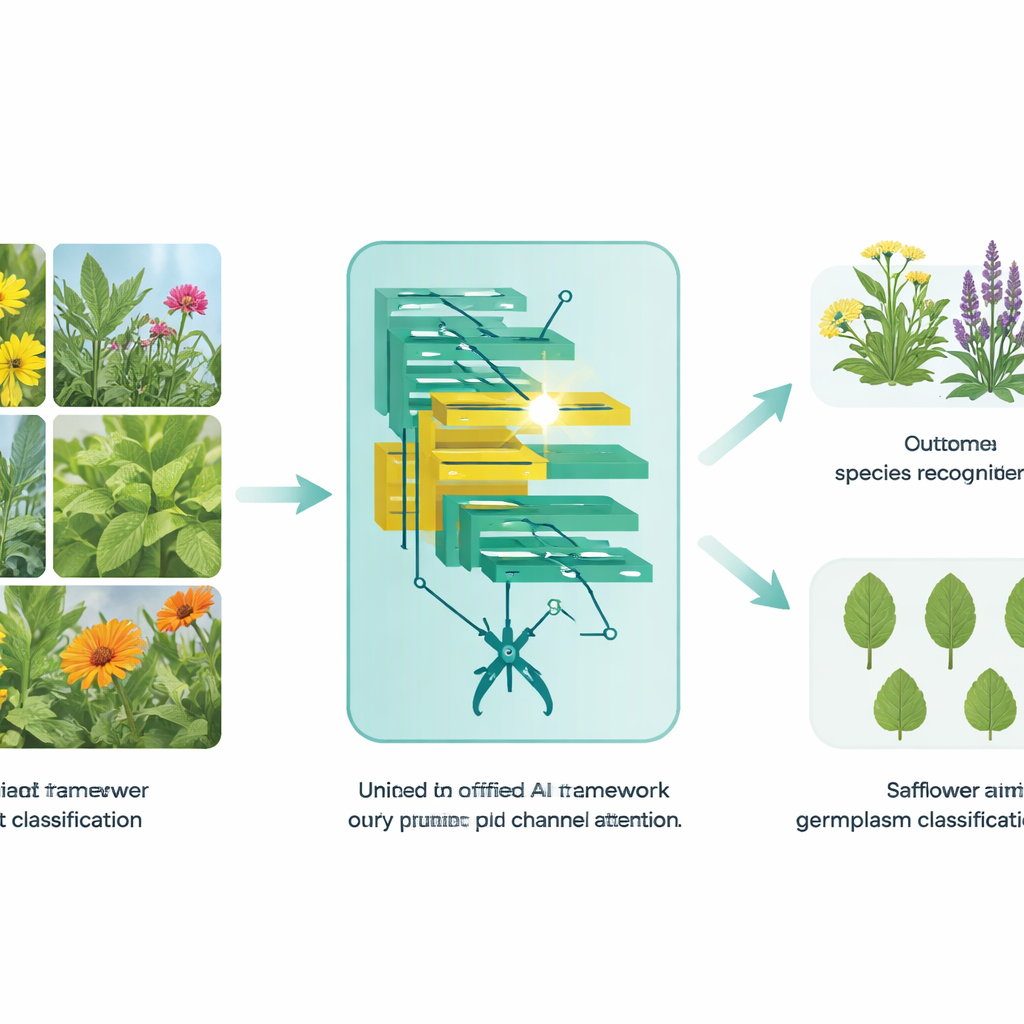

Ein einheitliches, auf EfficientSwinB basierendes Framework zur Erkennung von Heilpflanzen und Klassifikation von Färberdistel-Genmaterial

Warum intelligentere Pflanzenidentifikation wichtig ist

Von Küchenkräutern bis zu traditionellen Heilmitteln: Viele gesundheitsfördernde Pflanzen sehen einander überraschend ähnlich. Sie mit bloßem Auge zu unterscheiden erfordert jahrelange Ausbildung; Fehler können die Medikamentenqualität, landwirtschaftliche Entscheidungen und den Naturschutz beeinträchtigen. Diese Studie stellt ein neues Framework der künstlichen Intelligenz (KI) vor, das Heilpflanzen aus Alltagsfotos erkennen und sogar sehr eng verwandte Färberdistel-Sorten an ihren Blättern unterscheiden kann. Indem die Pflanzenidentifikation schneller und verlässlicher wird, öffnet die Arbeit den Weg für praktische Werkzeuge für Apotheker, Landwirtinnen und Naturschützer.

Von Blatt-Schnappschüssen zu vertrauenswürdigen Antworten

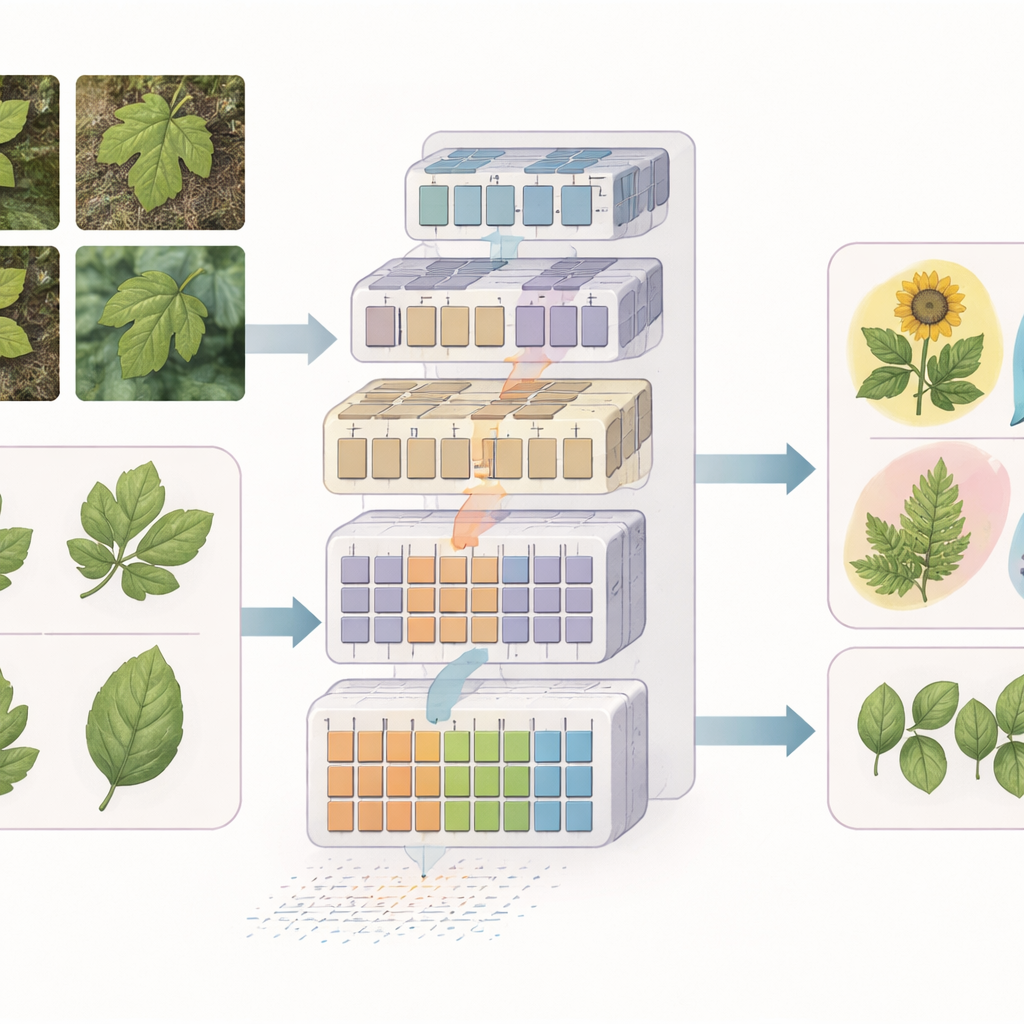

Die Autoren konzentrieren sich auf eine der schwierigsten Varianten der Pflanzenbestimmung: die Arbeit direkt mit Blattbildern. Außenaufnahmen von Heilpflanzen sind oft mit Erde, Schatten und anderen Pflanzen überlagert, und viele Arten teilen nahezu identische Formen und Adermuster. Traditionelle Verfahren der Computer-Vision benötigten große, sorgsam kuratierte Datensätze und hatten trotzdem Probleme mit solcher Variabilität. Die Forschenden bauen hier auf einer modernen Familie von KI-Modellen auf, den Vision Transformern, die ein Bild als Sammlung kleiner Patches behandeln und lernen, wie diese Teile zueinander in Beziehung stehen. Ihr Ziel ist es, ein einziges Framework zu entwerfen, das sowohl breite Artenerkennung im Freiland als auch feine Unterscheidungen zwischen Kulturvarietäten im Labor bewältigt.

Ein schlankeres, schärferes Auge für Heilpflanzen

Für die allgemeine Erkennung von Heilpflanzen schlagen die Autorinnen und Autoren ein Modell vor, das sie EfficientSwinB-SE nennen. Es baut auf dem Swin Transformer auf, einem weithin genutzten Vision Transformer, der überlappende Fenster eines Bildes betrachtet, um sowohl lokale Details als auch die größere Szene zu erfassen. Die erste Verbesserung ist ein Pruning-Schritt: Das Modell entfernt automatisch die am wenigsten nützlichen Verbindungen in seiner frühen Bildverarbeitungsstufe und reduziert so interne Berechnungen, ohne die Gesamtstruktur zu verändern. Die zweite Verbesserung ist ein Squeeze-and-Excitation-Block, der das Modell lehrt, einige visuelle Kanäle stärker zu gewichten als andere – ähnlich wie eine Botanikerin, die Aderstrukturen oder Kantentexturen besonders beachtet und ablenkende Hintergrundpixel vernachlässigt.

Hineinzoomen auf Unterschiede innerhalb der Färberdistel-Familie

Die Erkennung von Varietäten innerhalb einer einzigen Kultur ist noch schwieriger als die Unterscheidung verschiedener Arten, weil die visuellen Unterschiede extrem subtil sein können. Um dem zu begegnen, erweitern die Autorinnen und Autoren ihr Framework zu einem zweiten Modell namens OLSF-EfficientSwinB-SE, das auf Färberdistel-Genmaterial – die in der Züchtung verwendeten genetischen Linien – zugeschnitten ist. Im Labor verbessern sie zunächst Blattbilder mit einem „Optimal Leaf Structure Feature“-Verfahren, das Aderrichtungen und feine Texturen hervorhebt. Diese verbesserten Bilder werden dann in denselben geprunten und aufmerksamen Transformer-Backbone eingespeist. Diese Kombination hilft der KI, sich auf winzige, aber biologisch bedeutsame Strukturhinweise zu konzentrieren, die eine Färberdistellinie von einer anderen unterscheiden, und unterstützt so präzisere Züchtung und Management genetischer Ressourcen.

Erprobung des neuen Frameworks

Die Forschenden bewerten ihre Modelle an drei öffentlichen Datensätzen: Indische Heilpflanzen, die in Gärten fotografiert wurden, indonesische Heilpflanzen aus unterschiedlichen Online-Quellen und ein Färberdistel-Datensatz mit Dutzenden von Varietäten, die unter kontrollierten Laborbedingungen abgebildet wurden. In allen Fällen übertrifft EfficientSwinB-SE bekannte Deep-Learning-Modelle, darunter klassische konvolutionale Netze und andere Transformer. Es erreicht etwa 99,75 % Genauigkeit im indischen Datensatz und 97,70 % im indonesischen Datensatz, selbst bei wechselnden Lichtverhältnissen und unruhigen Hintergründen. Für die feinkörnige Färberdistel-Aufgabe erzielt die OLSF-EfficientSwinB-SE-Variante rund 91,63 % Genauigkeit und übertrifft damit einen vorherigen transformerbasierten Ansatz, der speziell für diese Kultur entwickelt wurde.

Was das für die Praxis von Pflanzen bedeutet

Praktisch betrachtet zeigt die Studie, dass sich ein einziges, effizientes KI‑„Auge“ bauen lässt, das sowohl eine große Bandbreite an Heilpflanzen im Feld erkennen als auch nahezu identische Blätter im Labor zuverlässig sortieren kann. Durch das Wegtrimmen unnötiger Berechnungen und das Lehren des Modells, die informativsten visuellen Hinweise zu betonen, schaffen die Autorinnen und Autoren Werkzeuge, die genau, robust und praktisch genug für den nahezu Echtzeit‑Einsatz sind. Solche Systeme könnten Smartphone‑Apps zur Kräuterbestimmung, automatisierte Katalogisierung genetischer Ressourcen und intelligente Plattformen für die Pflanzenwirtschaft unterstützen, die Kulturen anhand ihrer Blätter verfolgen. Wenn dieselben Ideen auf mehr Arten und Umgebungen ausgeweitet werden, können sie helfen, traditionelles Pflanzenwissen und moderne datengetriebene Landwirtschaft zu verbinden.

Zitation: Khuat, P.T., Thien Van, H. A unified EfficientSwinB-based framework for medicinal plant recognition and safflower germplasm classification. Sci Rep 16, 11791 (2026). https://doi.org/10.1038/s41598-026-42449-4

Schlüsselwörter: Erkennung von Heilpflanzen, Deep Learning, Vision Transformer, Färberdistel-Genmaterial, Pflanzenidentifikation