Clear Sky Science · de

Integration von Mehrskalen‑Faltung und Aufmerksamkeitsmechanismen in HybridHAR für leistungsstarke Erkennung menschlicher Aktivitäten

Warum es wichtig ist, dass Computer Alltagsbewegungen verstehen

Jeden Tag zeichnen unsere Telefone, Uhren und andere Geräte unauffällig auf, wie wir uns bewegen – ob wir gehen, Treppen steigen oder auf der Couch ruhen. Diese Rohbewegungssignale zuverlässig in ein Verständnis menschlicher Aktivitäten zu übersetzen, könnte die Gesundheitsüberwachung, Altenpflege, Rehabilitation und intelligente Häuser verändern. Dieses Papier stellt HybridHAR vor, ein neues Modell, das diese Signale genauer und effizienter auswertet und uns näher an tragbare Geräte bringt, die in Echtzeit wirklich verstehen, was wir tun.

Aktivitäten aus Bewegungssensoren verstehen

Die Erkennung menschlicher Aktivitäten besteht darin, anhand von Sensoren wie Beschleunigungsmessern und Gyroskopen in Smartphones und Wearables zu bestimmen, was eine Person tut. Frühere Systeme setzten darauf, dass Experten Merkmale aus diesen Signalen von Hand entwickelten und sie dann klassischen Machine‑Learning‑Algorithmen zuführten. Dieser Ansatz funktionierte in kontrollierten Laborumgebungen, brach aber in der unordentlicheren realen Welt oft zusammen, wo Bewegungen variabler und verrauschter sind. Deep Learning hat Verbesserungen gebracht, indem es Muster in den Daten automatisch entdeckt; dennoch übersehen gängige Architekturen wichtige Details, die auf unterschiedlichen Zeitskalen auftreten, und verlieren beim Tieferwerden der Netze Informationen.

Warum bestehende Deep‑Modelle noch Probleme haben

Menschliche Bewegungen erfolgen gleichzeitig auf vielen Zeitskalen: ein schneller Schritt, ein kurzer Weg quer durch einen Raum oder eine längere Sitzphase. Viele Deep‑Learning‑Modelle konzentrieren sich entweder auf kurze Ausschnitte oder auf längere Bereiche, aber nicht beides gleichermaßen gut. Wenn Netze mehr Schichten hinzufügen, um komplexe Muster zu erfassen, können Lernsignale verblassen, sodass frühe Schichten nicht mehr verbessert werden. Einige Modelle fehlen zudem Leitmechanismen für interne Schichten, sodass sie keine nützlichen mittleren Bausteine lernen, die nötig sind, um Aktivitäten zu unterscheiden, die in den Rohsignalen ähnlich aussehen, etwa Sitzen versus Stehen.

Ein Hybrid‑Design, das Bewegung auf mehreren Ebenen betrachtet

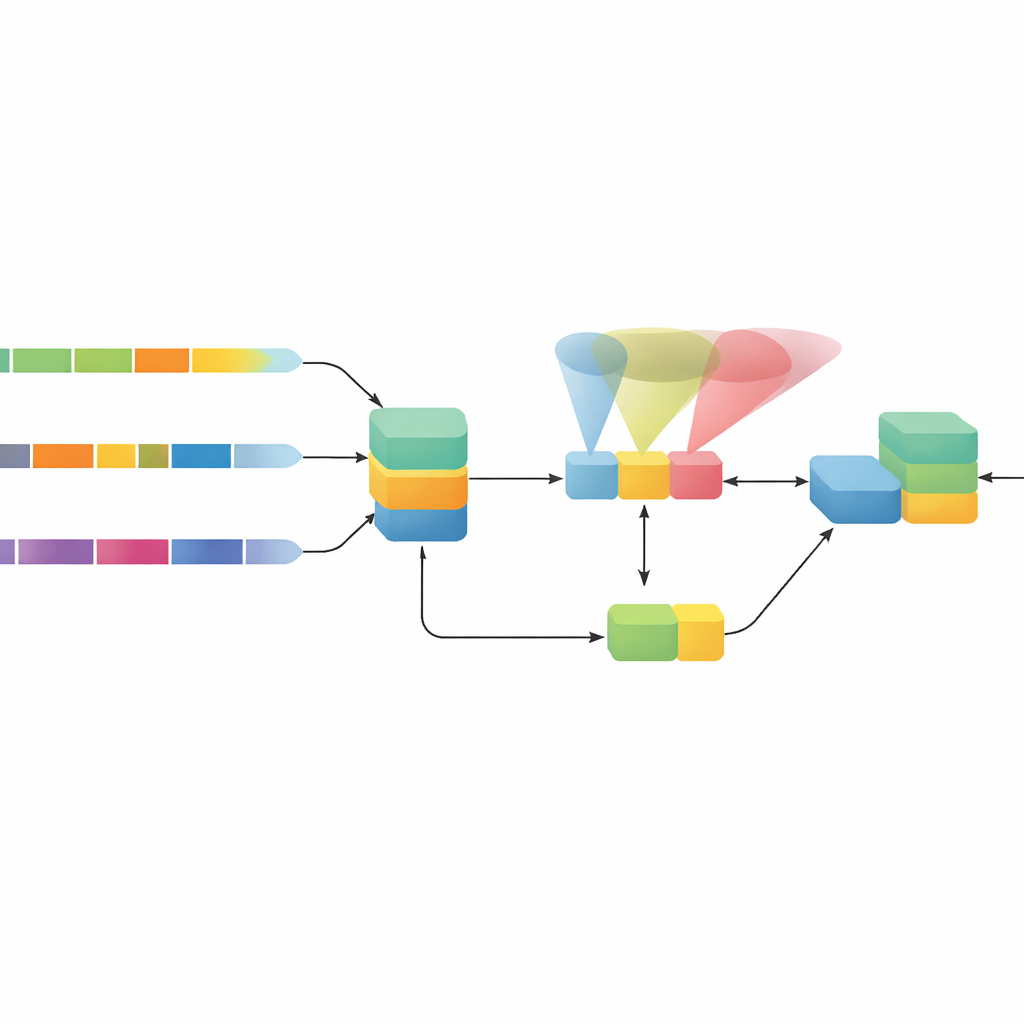

Die Autorinnen und Autoren schlagen HybridHAR vor, ein sorgfältig entworfendes Modell, das diese Schwächen mit drei zusammenwirkenden Ideen angeht. Erstens wird das gleiche Sensorsignal nicht in einer einzigen Sicht auf die Zeit verarbeitet, sondern parallel durch drei Pfade geführt, die jeweils unterschiedliche Zeitskalen betrachten – von sehr kurzen bis zu etwas längeren Segmenten. Diese Pfade wirken wie drei Linsensets, die feine Details schneller Gesten sowie langsamere Trends in Haltung und Bewegung erfassen. Ihre Ausgaben werden dann zu einer reichhaltigen, kombinierten Darstellung verschmolzen, die Informationen aus allen Skalen bewahrt.

Aufmerksamkeit und Lernsteuerung tief im Modell

Zweitens ergänzt HybridHAR diese kombinierte Darstellung um ein spezielles Aufmerksamkeitsmodul. Dieser Mechanismus lernt, die aussagekräftigsten Teile des Signals hervorzuheben – zum Beispiel die feinen Bewegungsunterschiede, die Treppensteigen von Treppenabwärtsgehen trennen – und behält gleichzeitig einen Shortcut bei, der die ursprüngliche Information bewahrt. Dieser „residuale“ Shortcut hilft, Lernsignale gleichmäßig durch das Netzwerk fließen zu lassen und verhindert, dass Informationen in tieferen Schichten verloren gehen. Drittens erhält das Modell einen zusätzlichen Hilfsklassifikator, der auf Zwischenrepräsentationen vor Anwendung der Aufmerksamkeit zugreift. Während des Trainings wird auch dieser Hilfsausgang bewertet und zwingt frühe Schichten behutsam dazu, bereits brauchbare Merkmale zu lernen, was das Training stabilisiert und beschleunigt.

Wie gut der neue Ansatz abschneidet

Zur Evaluation nutzten die Forschenden ein weit verbreitetes öffentliches Datenset, in dem Freiwillige ein Smartphone trugen und sechs Grundaktivitäten ausführten: drei Gehvarianten sowie Sitzen, Stehen und Liegen. Auf diesem Benchmark erreichte HybridHAR etwa 99 % Genauigkeit auf zurückbehaltener Validierungsdaten und 96 % auf einem unbekannten Testset und übertraf damit mehrere starke Alternativen, darunter klassische Faltungsnetze, rekurrente Netze, Hybridmodelle und Ansätze auf Basis von Reinforcement Learning. Besonders stark war es darin, ähnliche Gehaktivitäten auseinanderzuhalten und Fehler zwischen verwirrenden Paaren wie Treppenauf‑ und Treppenabgehen zu reduzieren. Das Team zeigte außerdem, dass jede der drei Komponenten – Mehrskalenpfade, Aufmerksamkeit und tiefe Supervision – die Ergebnisse messbar verbesserte und dass das vollständige Modell bessere Leistung erzielte als jede Variante, der eine Komponente fehlte.

Warum das für reale Geräte wichtig ist

Trotz hoher Genauigkeit bleibt HybridHAR kompakt und schnell, mit deutlich weniger einstellbaren Parametern als viele konkurrierende Modelle und der Fähigkeit, Hunderte von Aktivitätsfenstern pro Sekunde zu verarbeiten, während es etwa ein Megabyte Speicher benötigt. Es generalisierte zudem gut auf ein zweites, komplexeres Datenset mit mehr Aktivitäten und reichhaltigeren Sensorsetzungen, wo es noch besser abschnitt. Für Nicht‑Expertinnen und Nicht‑Experten ist die wichtigste Erkenntnis, dass dieses Design einen praktischen Bauplan bietet, um verrauschte Wearable‑Signale in vertrauenswürdige, feinkörnige Beschreibungen dessen zu verwandeln, was Menschen tun. Solche Modelle könnten künftige Gesundheitsmonitore, Smart‑Homes und Sicherheitssysteme zuverlässiger machen und einfacher auf Alltagsgeräten betreiben lassen.

Zitation: Huo, Y., Wei, C., Xu, Z. et al. Integrating multi-scale convolution and attention mechanisms in HybridHAR for high-performance human activity recognition. Sci Rep 16, 10143 (2026). https://doi.org/10.1038/s41598-026-40904-w

Schlüsselwörter: Erkennung menschlicher Aktivitäten, tragbare Sensoren, Deep Learning, Aufmerksamkeitsmechanismen, Gesundheitsüberwachung