Clear Sky Science · de

Ein Crystal-Graph-to-Vector-Ansatz zur Vorhersage magnetischer Eigenschaften

Warum klügere Magnete wichtig sind

Magneten stehen im Zentrum von Festplatten, Elektromotoren, medizinischen Scannern und aufkommenden Quanten‑Geräten. Die Entwicklung neuer magnetischer Materialien ist jedoch langsam und kostspielig, weil jeder Kandidat in der Regel detailliert simuliert oder im Labor hergestellt und getestet werden muss. Diese Arbeit stellt eine neue Abkürzung vor: eine kompakte Darstellung von Kristallen, sodass Standard‑Methoden des maschinellen Lernens schnell und zuverlässig vorhersagen können, wie magnetisch ein Material ist und wie stabil diese Magnetisierung ist. Der Ansatz verspricht, die Suche nach besseren Magneten zu beschleunigen und dabei deutlich weniger Daten und Rechenleistung zu benötigen als heutige Deep‑Learning‑Modelle.

Von komplexen Kristallen zu einfachen Zahlen

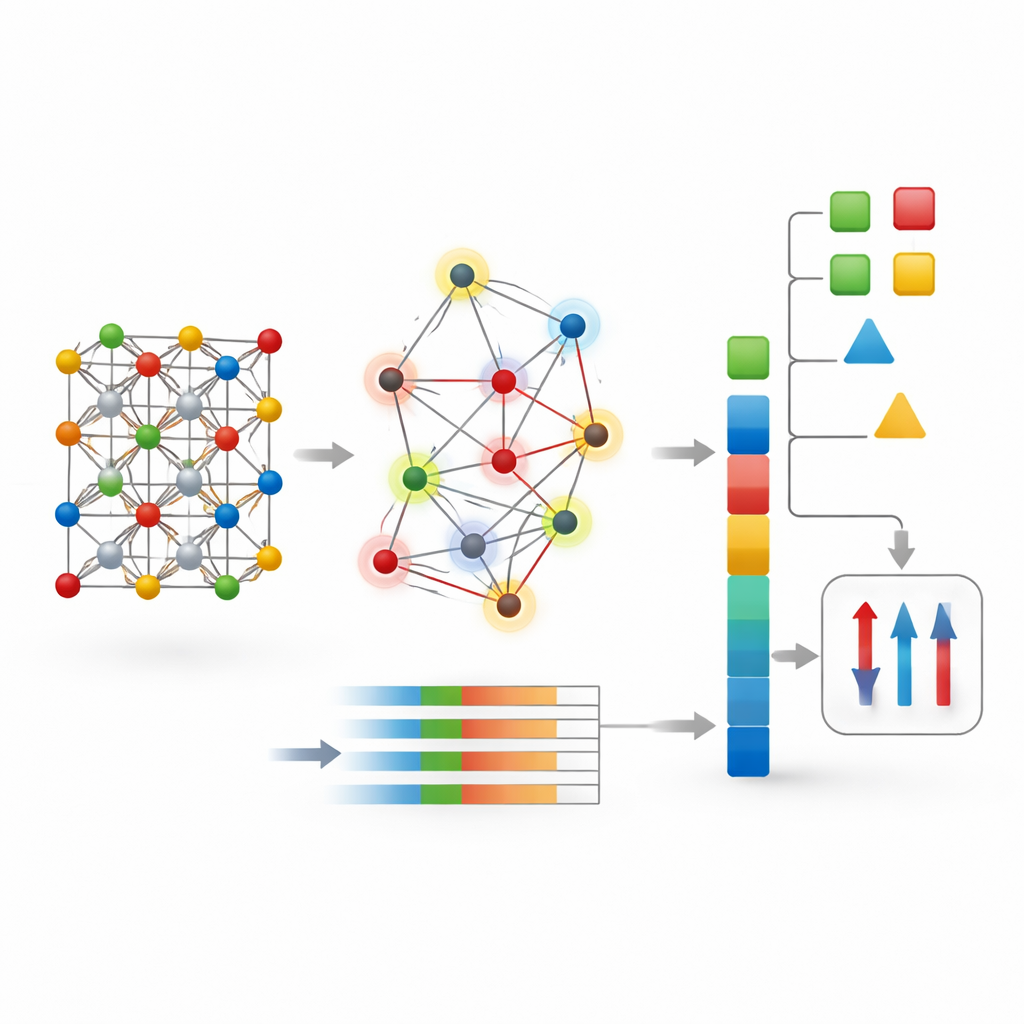

Auf atomarer Ebene entsteht Magnetismus durch ungepaarte Elektronen und die Ausrichtung ihrer winzigen Spins im Material. Konventionelle Computerverfahren, wie die Dichtefunktionaltheorie, verfolgen diese Elektronen direkt. Sie sind genau, aber teuer, insbesondere für große oder komplexe Kristalle. Neuerdings haben sich graphneuronale Netze etabliert: Sie behandeln einen Kristall als Netzwerk von Atomen, die über Bindungen verbunden sind, und lernen Muster durch wiederholten Nachrichtenaustausch entlang dieser Verbindungen. Obwohl leistungsfähig, benötigen diese tiefen Modelle typischerweise große, saubere Datensätze und erhebliche Rechenzeit und tun sich manchmal schwer, langreichweitige magnetische Effekte zu erfassen.

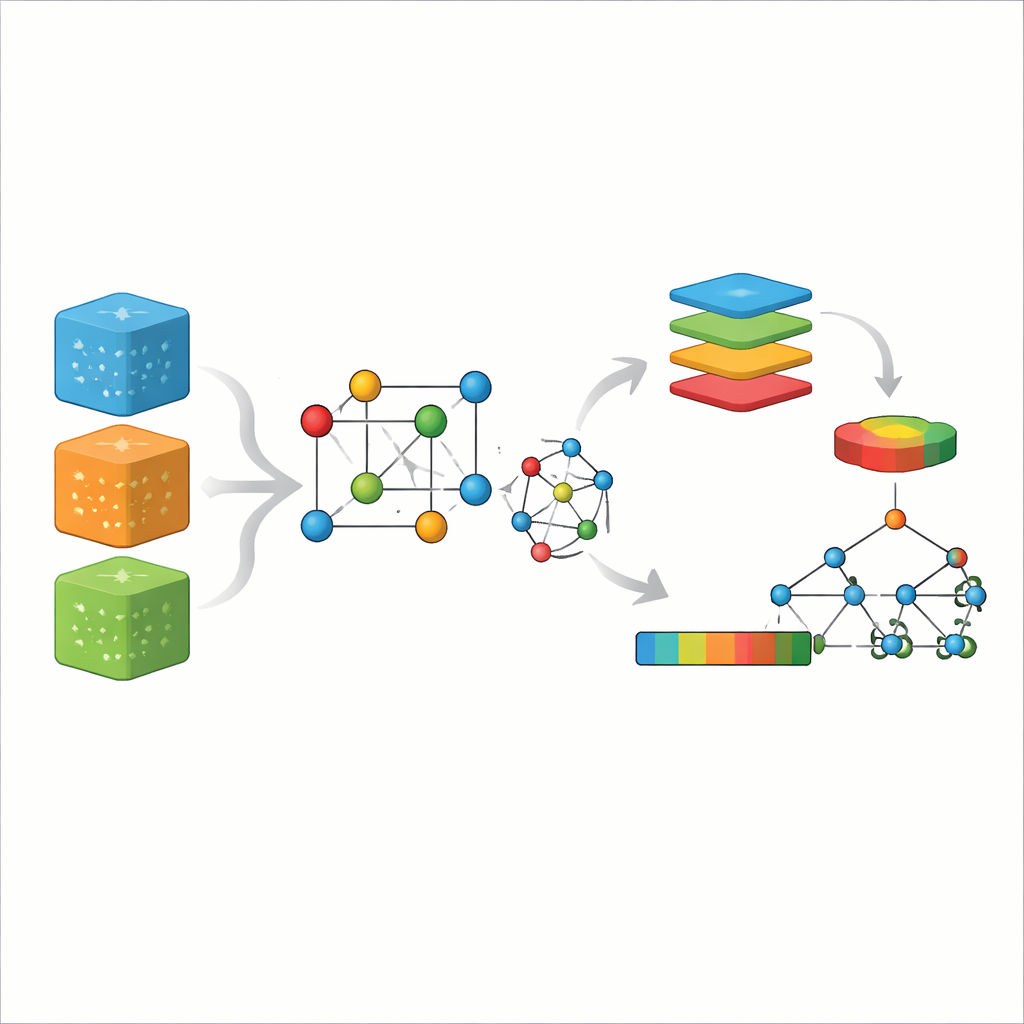

Eine neue Art, einen Kristall zu kodieren

Die Autorinnen und Autoren schlagen eine andere Strategie namens CG‑Vec (crystal graph to vector) vor. Anstatt alles von Grund auf zu lernen, integrieren sie physikalisches Wissen von Beginn an. Jedem Atom im Kristallgraphen werden grundlegende Eigenschaften wie Ordnungszahl, Masse und Elektronenaffinität zugewiesen, zusammen mit zwei magnetischen Indikatoren: der Anzahl ungepaarter Elektronen in der Außenschale und dem spin‑only magnetischen Moment, das diese Elektronen erzeugen sollten. Bindungen zwischen Atomen werden durch glatte Funktionen des Abstandes beschrieben. Für jeden Kristall fasst die Methode dann alle atomaren und Bindungsinformationen in einem Vektor fester Länge zusammen, indem einfache Statistiken berechnet werden – vor allem Mittelwert und Streuung jeder Eigenschaft über die Struktur.

Alteingesessene Maschinenlernverfahren übernehmen die Arbeit

Sobald ein Kristall in diesen Vektor umgewandelt ist, kann er an etablierte Algorithmen wie Random Forests oder Gradient Boosting Machines übergeben werden. Diese Methoden sind schnell, robust bei kleinen Datensätzen und erlauben Einblicke, welche Eingangsmerkmale am wichtigsten sind. Die Autorinnen und Autoren testeten CG‑Vec an mehreren Materialkollektionen aus großen Online‑Datenbanken. Diese Datensätze enthielten Tausende dreidimensionaler und zweidimensionaler Verbindungen mit bekannten Bildungsenergien, elektronischen Bandlücken, Magnetisierungswerten und Curie‑Temperaturen – der Temperatur, bei der ein Magnet seine langreichweitige Ordnung verliert. Alle Daten wurden sorgfältig bereinigt, damit die Modelle von konsistenten, verlässlichen Beispielen lernen.

Deep Networks schlagen, wenn Daten knapp sind

Das Team verglich drei Ansätze: ein standardmäßiges Crystal‑Graph‑Neural‑Network, eine spin‑bewusste Version dieses Netzwerks, der zusätzliche magnetische Merkmale gegeben wurden, und die neue CG‑Vec‑Darstellung kombiniert mit einem Random‑Forest‑Modell. Für Eigenschaften, die überwiegend durch kurzreichweitige Bindungen bestimmt werden, wie Bildungsenergie und Bandlücke, schnitt das tiefe Netzwerk sehr gut ab und lag bei den größten Datensätzen oft leicht vor CG‑Vec. Wenn der Fokus jedoch auf magnetischen Eigenschaften lag – insbesondere der Magnetisierung in ferrimagnetischen Verbindungen und der Curie‑Temperatur – verschob sich das Bild. In diesen Fällen erreichte CG‑Vec die Leistung der Graph‑Netze oder übertraf sie, besonders wenn nur einige Hundert bis einige Tausend Trainingsbeispiele zur Verfügung standen. Der Vektoransatz benötigte außerdem deutlich weniger Speicher und war eine Größenordnung schneller beim Training und bei Vorhersagen.

Einblick, was Magnetismus antreibt

Weil CG‑Vec explizite, physikalisch sinnvolle Merkmale verwendet, konnten die Autorinnen und Autoren mit Interpretierbarkeitswerkzeugen untersuchen, welche Merkmale am wichtigsten sind. Sie fanden heraus, dass Mittelwert und Verteilung der atomaren magnetischen Momente, Details zur Besetzung der Valenzelektronen und bestimmte Bereiche der Zwischenatomabstände die stärksten Treiber für die Magnetisierungsvorhersagen des Modells waren. Dieses Bild stützt die Idee, dass viele magnetische Verhaltensweisen stärker von der allgemeinen elektronischen Zusammensetzung eines Materials und der Verteilung der Spins auf verschiedene Atomsitze abhängen als von feinen strukturellen Besonderheiten. Es erklärt auch, warum eine kompakte, globale Beschreibung gut generalisieren kann, ohne die Tiefe und Komplexität moderner Graph‑Netze zu benötigen.

Ein praktischer Weg zu schnellerer Materialentdeckung

Einfach gesagt zeigt die Studie, dass sorgfältig entworfene Zusammenfassungen eines Kristalls – verwurzelt in grundlegender Chemie und Magnetismus – mit schweren Deep‑Learning‑Modellen bei der Vorhersage zentraler magnetischer Eigenschaften konkurrieren oder sie übertreffen können, insbesondere wenn Daten begrenzt sind. CG‑Vec bietet ein schlankes, interpretierbares Werkzeug, das detaillierte Kristallstrukturen in handhabbare Zahlenmengen verwandelt, die Standard‑Maschinenlernverfahren leicht verarbeiten können. Durch die Verringerung sowohl des Daten‑ als auch des Rechenbedarfs könnte dieser Ansatz virtuelle Screenings für die nächste Generation magnetischer Materialien für Forschungsteams und Industrien zugänglicher machen und vielversprechende Kandidaten schneller vom Rechner ins Labor bringen.

Zitation: Singh, S., Sharma, A. & Kashyap, A. A crystal graph to vector approach for predicting magnetic properties. Sci Rep 16, 13160 (2026). https://doi.org/10.1038/s41598-026-40902-y

Schlüsselwörter: magnetische Materialien, maschinelles Lernen, graphneuronale Netze, Materialinformatik, Curie-Temperatur