Clear Sky Science · zh

用于梨果叶多病害严重度检测的优化轻量级U-Net与YOLACT框架

为何更智能的叶片检测重要

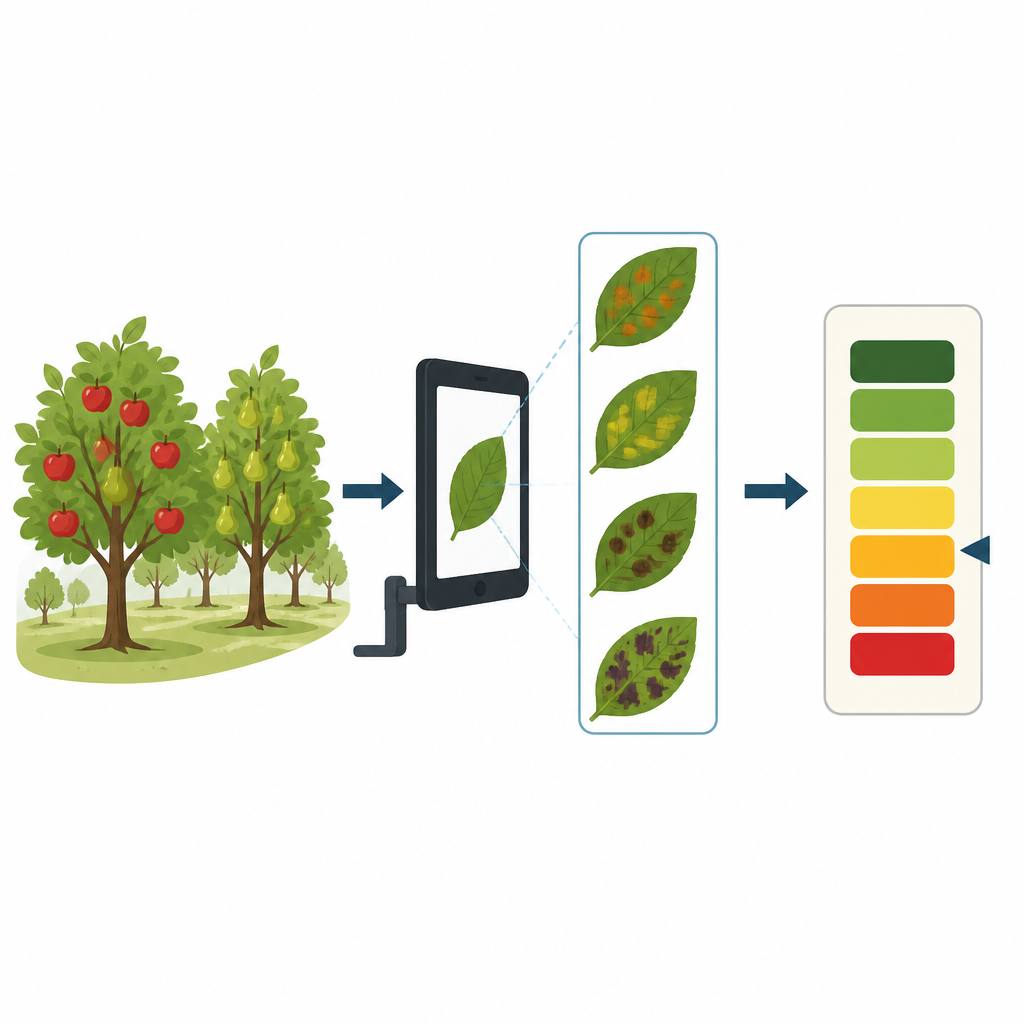

种植苹果和梨的农户都知道,叶片斑点和瑕疵传播迅速,会悄然削弱产量。徒步巡园并凭肉眼判断病情既耗时又常常不确定,尤其当同一叶片同时遭受多种感染时更是如此。本研究提出了一种基于相机的自动化方法,能在单片梨果叶上识别多种病害并估计每种感染的严重程度,为更快、更可靠的作物健康检查提供了可行路径。

看得比肉眼更多

研究者聚焦于苹果和梨等梨果类,这类果树容易遭受会影响果实品质并降低产量的叶部病害。传统检测依赖专家目测判断症状的大小和颜色,这一过程既耗时又因人而异。实际果园还存在杂乱背景、变化光照以及叶片重叠或卷曲的情况。团队旨在构建一种能应对这些视觉噪声、仅用普通彩色照片即可工作,并且能够在单叶上区分多种重叠感染同时评估每种病情进展的工具。

对病叶的两步观察

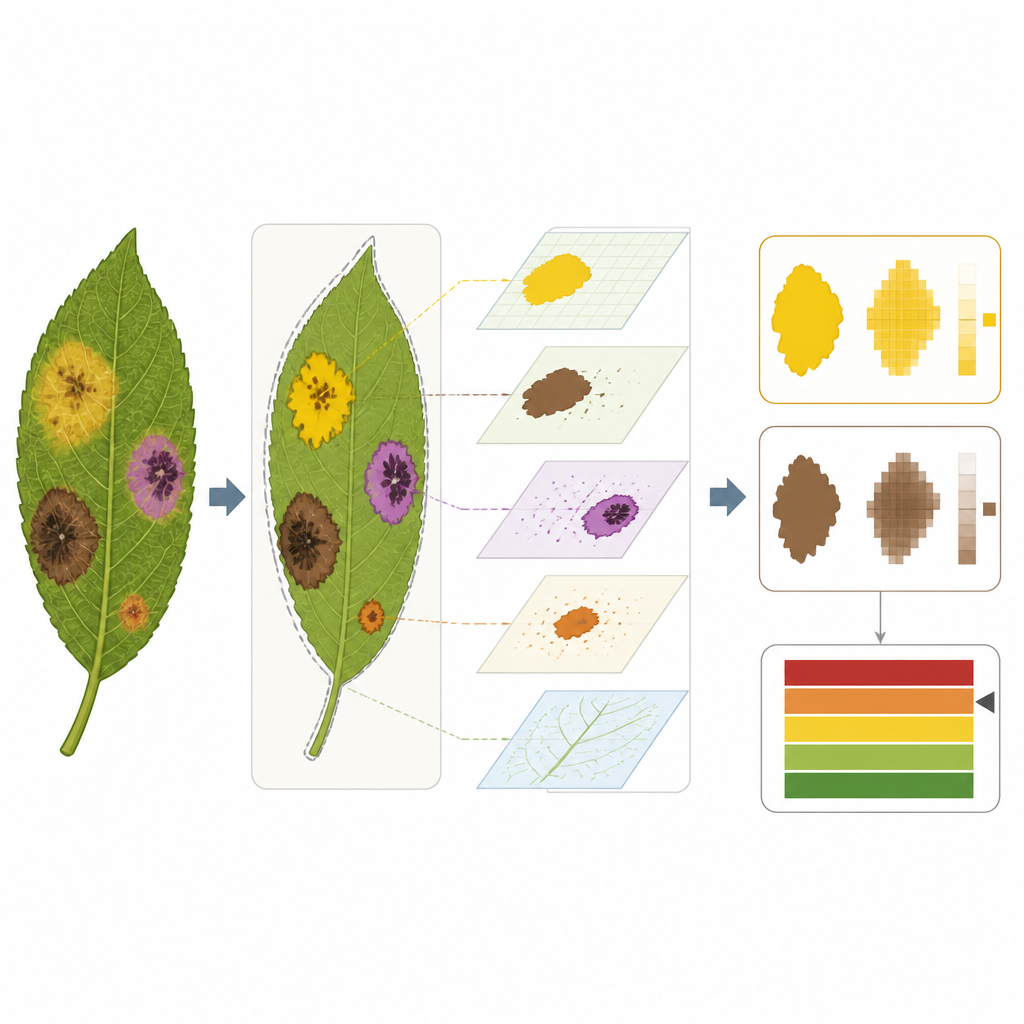

为了解决这一问题,研究采用了双重视觉处理流程。首先,使用一种简化的流行医学成像网络,称为Lite U Net,对叶片与背景进行分割并标出总体病变区域。这一步去除枝叶、天空和土壤等干扰,确保后续分析只集中在植物组织上。接着,轻量化的另一个网络Lite YOLACT进一步放大,识别每个独立的病灶斑块作为单独的对象。两步结合使系统能够识别出单片叶子可能同时带有疮痂和锈病等不同病害,每种病害具有各自的大小与扩展情况。

把斑点转成易懂的分数

在描出每个病变区域后,该方法测量每种感染覆盖叶面面积的比例。作者设计了一个新的九级严重度量表,将这些百分比转换为易于理解的阶段,从早期的细小斑点到接近全面损害。该量表可处理两种病害并存的情况,描述两者是否都轻微、都严重或一方明显占优。为增强用户对系统的信任,研究者加入了名为Grad CAM的可视化技术,生成热图以显示模型在判断病情严重度时依赖的叶片区域。

在果园与数字实验中的测试

团队在两个大型公开的苹果和梨叶图像集上训练并测试了他们的方法。这些数据集包含若干常见病害,均在真实田间条件下拍摄并由植物健康专家标注。经过细致的预处理、数据平衡以及在现代图形硬件上的训练,组合系统在多病害严重度分级任务上达到约95%的准确率。它也运行高效:通过使用紧凑的网络设计和巧妙的计算共享方式,模型所需的计算量和内存低于许多标准深度学习系统,使其适合运行在手机或现场使用的边缘设备上。

对种植者的意义

通俗地说,这项工作表明一台廉价相机加上瘦身的人工智能模型,能够可靠地在苹果和梨叶片上同时识别并分级多种病害。种植者不再依赖粗略的目测估计,而是可以获得一致的数值化结果,显示每种病害感染的叶面积及其进展程度。尽管该方法仍需在更多作物和更多条件下进行更广泛的测试,但它指向了切实可行的数字侦察工具,帮助农户更早采取行动、更精准地针对性处理,从而减少浪费和农药使用。

引用: Qasim, M., Adnan, S.M. & Safi, Q.G.K. Optimized Lightweight U-Net and YOLACT framework for multi-disease severity detection in pome fruit leaves. Sci Rep 16, 15132 (2026). https://doi.org/10.1038/s41598-026-45947-7

关键词: 植物病害检测, 苹果叶病, 梨叶病, 深度学习农业, 病害严重度分级