Clear Sky Science · de

Optimiertes leichtgewichtiges U-Net- und YOLACT-Framework zur Erkennung von Mehrfachkrankheits‑Schweregraden in Kernobstblättern

Warum intelligentere Blattkontrollen wichtig sind

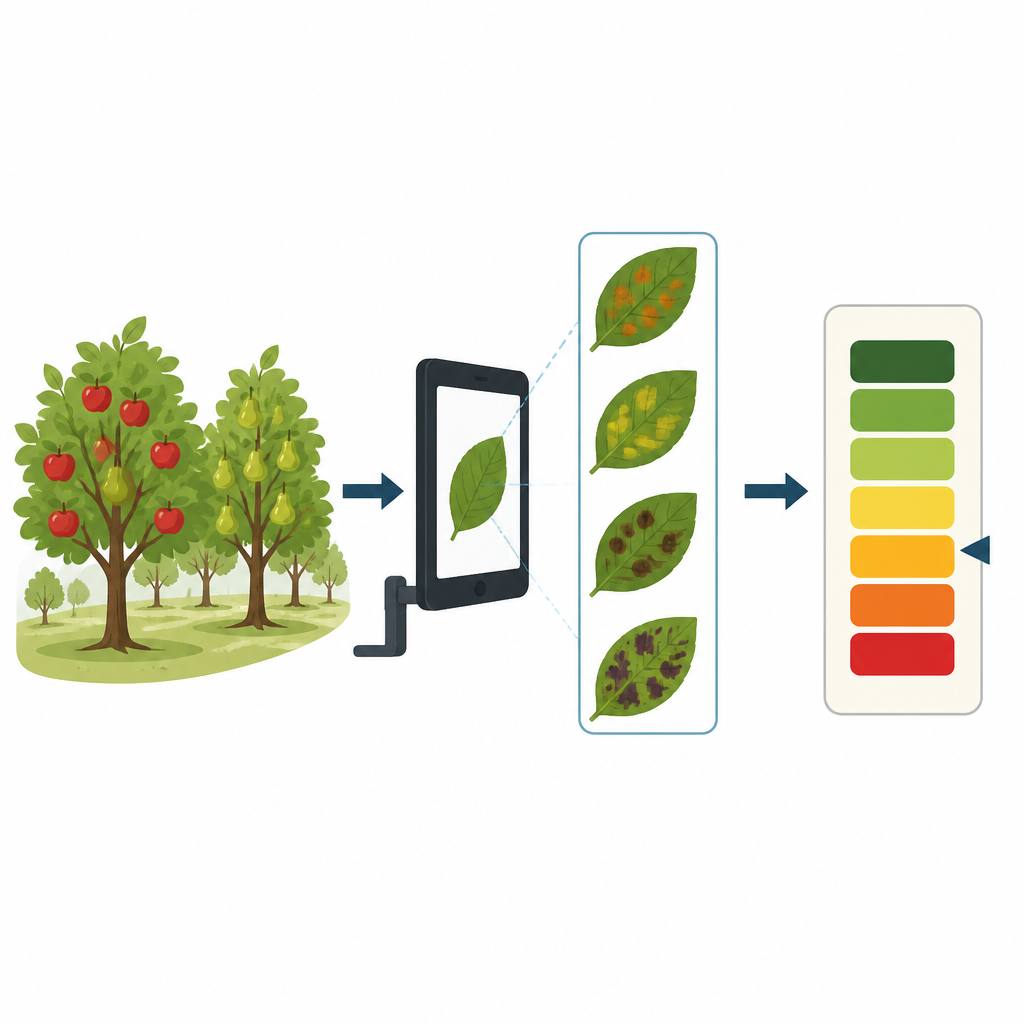

Obstbauer, die Äpfel und Birnen anbauen, wissen, dass Blattflecken und Verfärbungen sich schnell ausbreiten und Erträge schleichend reduzieren können. Das Durchgehen der Obstgärten und die visuelle Einschätzung von Krankheiten ist zeitaufwändig und oft unsicher, besonders wenn mehr als ein Erreger dasselbe Blatt befällt. Diese Studie stellt einen automatisierten, kamerabasierten Ansatz vor, der mehrere Krankheiten auf einem einzigen Kernobstblatt erkennen und den Schweregrad jeder Infektion abschätzen kann — ein praktischer Weg zu schnelleren und verlässlicheren Gesundheitschecks.

Mehr sehen als das menschliche Auge

Die Forschenden konzentrieren sich auf Kernobst wie Äpfel und Birnen, die stark anfällig für Blattkrankheiten sind, die die Fruchtqualität beeinträchtigen und den Ertrag senken. Traditionelle Inspektionen beruhen auf Experten, die Größe und Farbe von Symptomen visuell bewerten — ein zeitintensiver Prozess mit hohen Schwankungen zwischen Beobachtern. Im Feld kommen zusätzlich unruhige Hintergründe, wechselnde Lichtverhältnisse und überlappende oder eingerollte Blätter hinzu. Das Team wollte ein Werkzeug entwickeln, das mit diesem visuellen Rauschen umgehen kann, mit gewöhnlichen Farbfotos arbeitet und trotzdem mehrere sich überlappende Infektionen auf einem Blatt unterscheiden sowie deren Fortschritt beurteilen kann.

Eine zweistufige Sicht auf kranke Blätter

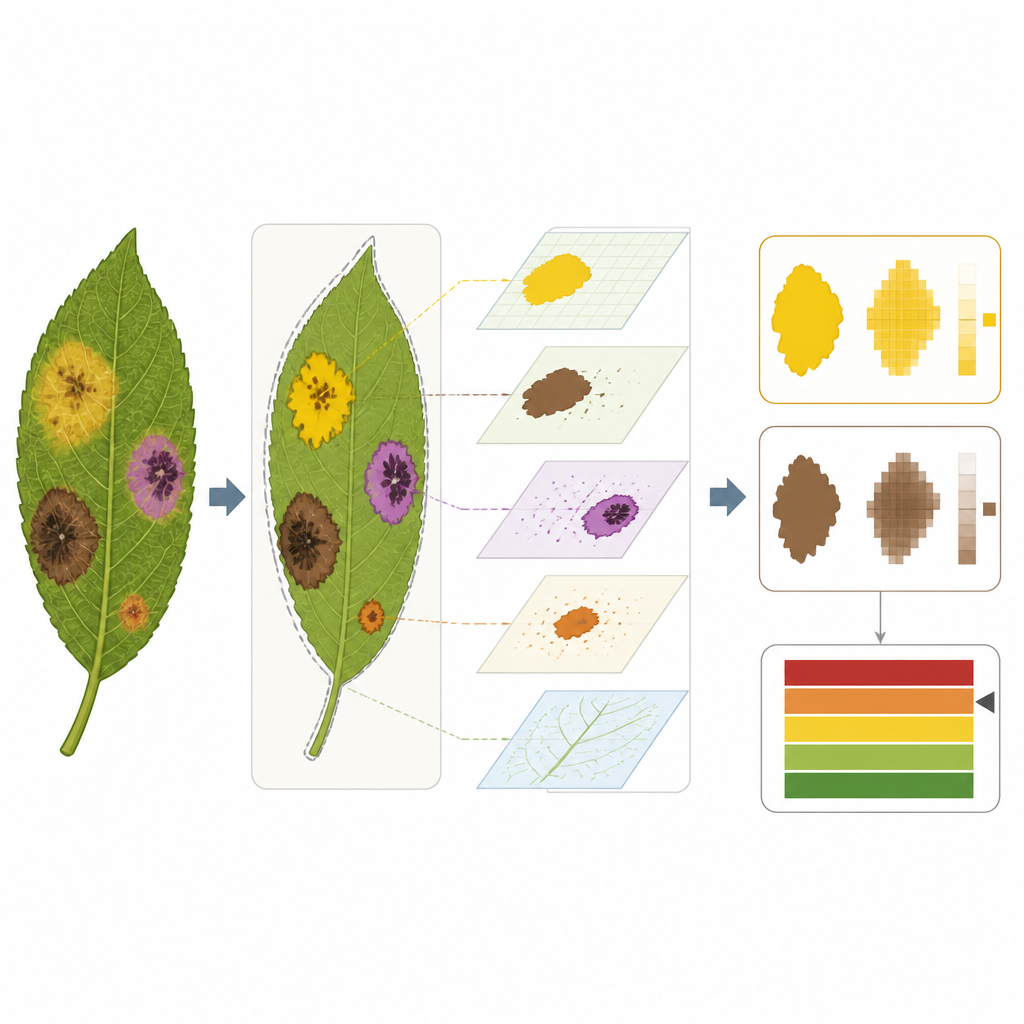

Zur Lösung setzt die Studie eine doppelte Bildverarbeitungs‑Pipeline ein. Zuerst wird eine gestraffte Version eines verbreiteten medizinischen Bildnetzes, genannt Lite U Net, trainiert, um das Blatt vom Hintergrund zu trennen und allgemeine Krankheitsbereiche zu markieren. Dieser Schritt entfernt Zweige, Himmel und Erde, sodass die nachfolgende Analyse sich auf das Pflanzengewebe konzentriert. Anschließend zoomt eine abgespeckte Version eines anderen Netzes, Lite YOLACT, weiter hinein, um jede einzelne erkrankte Stelle als eigenes Objekt zu erkennen. Zusammen erlauben diese beiden Schritte, dass das System etwa erkennt, wenn ein Blatt gleichzeitig Schorf und Rost trägt, jeweils mit eigenen Größen und Ausbreitungen.

Flecken in einfache Werte übersetzen

Sobald jeder kranke Bereich umrissen ist, misst die Methode, wie viel der Blattoberfläche von jeder Infektion bedeckt ist. Die Autorinnen und Autoren entwerfen eine neue neunstufige Schweregradskala, die diese Prozentsätze in leicht verständliche Stufen übersetzt — von winzigen Frühpunkten bis hin zu nahezu vollständiger Schädigung. Die Skala ist so konzipiert, dass sie zwei Krankheiten gleichzeitig abbilden kann und beschreibt, ob beide mild, beide weit fortgeschritten oder eine deutlich dominanter ist. Um Vertrauen in das System zu stärken, fügen die Forschenden eine Visualisierungstechnik namens Grad CAM hinzu, die Heatmaps erzeugt und zeigt, welche Blattbereiche das Modell bei der Schweregradeinschätzung stärker berücksichtigt hat.

Prüfung im Obstgarten und im digitalen Labor

Das Team trainiert und testet seinen Ansatz an zwei großen öffentlichen Bildsammlungen von Apfel‑ und Birnenblättern. Diese Datensätze enthalten mehrere verbreitete Krankheiten, aufgenommen unter realen Feldbedingungen und von Pflanzenschutzexpertinnen und -experten beschriftet. Nach sorgfältiger Vorverarbeitung, Ausbalancierung der Daten und Training auf moderner Grafikhardware erreicht das kombinierte System bei der Bewertung von Mehrfachkrankheits‑Schweregraden etwa 95 Prozent Genauigkeit. Es arbeitet zudem effizient: Durch kompakte Netzwerkarchitekturen und intelligente Nutzung gemeinsamer Berechnungen benötigt das Modell weniger Rechenoperationen und Speicher als viele Standard‑Deep‑Learning‑Systeme, wodurch es sich für Smartphones oder Edge‑Geräte eignet, die direkt im Feld eingesetzt werden können.

Was das für Landwirtinnen und Landwirte bedeutet

Alltäglich ausgedrückt zeigt diese Arbeit, dass eine preiswerte Kamera plus ein schlankes KI‑Modell zuverlässig mehrere Blattkrankheiten gleichzeitig an Äpfeln und Birnen erkennen und einstufen kann. Statt grober visueller Schätzungen könnten Erzeuger konsistente numerische Angaben erhalten, wie viel jedes Blatt von welcher Krankheit befallen ist und wie weit jede Erkrankung fortgeschritten ist. Obwohl die Methode noch breiter an weiteren Kulturen und Bedingungen getestet werden muss, weist sie in Richtung praktischer digitaler Kundschafter, die Landwirten helfen, früher zu handeln, Behandlungen gezielter einzusetzen und sowohl Abfall als auch Chemikalieneinsatz in Obstplantagen zu reduzieren.

Zitation: Qasim, M., Adnan, S.M. & Safi, Q.G.K. Optimized Lightweight U-Net and YOLACT framework for multi-disease severity detection in pome fruit leaves. Sci Rep 16, 15132 (2026). https://doi.org/10.1038/s41598-026-45947-7

Schlüsselwörter: Pflanzenkrankheitserkennung, Apfelblattkrankheit, Birnenblattkrankheit, Deep‑Learning Landwirtschaft, Schweregradbewertung von Krankheiten