Clear Sky Science · zh

用于增强对抗样本可迁移性的注意力语义攻击

为什么欺骗智能机器很重要

由深度神经网络驱动的现代人工智能系统如今被用于检测自动驾驶汽车的行人、识别照片中的人脸,并协助医生阅读医学影像。然而,这些系统存在一个令人惊讶的薄弱点:对图像做出微小且精心设计的改动——人眼难以察觉——就可能导致系统做出严重错误的预测。本文的研究正是针对这种脆弱性,提出了一种能够同时欺骗多种不同模型的新方法,既对人工智能安全提出了更明确的警示,也为评估未来系统的鲁棒性提供了有力工具。

攻击者目前如何欺骗神经网络

大多数现有的攻击方法通过将每个像素沿着能够最大增加模型训练损失的方向轻微移动来工作。当攻击者对模型的结构和参数一清二楚时,这种“白箱”策略非常有效。但在现实中,我们通常面对的是公司或医院部署的“黑箱”模型,其内部细节被隐藏。要攻击这样的模型,必须在替代模型上构造对抗图像,并希望这些图像也能欺骗隐藏系统——这种性质称为可迁移性。基于梯度的标准技巧常常对替代模型过拟合:它们利用了该模型判决边界的特定怪癖,因此当相同图像被发送到不同架构或经过对抗训练强化的模型时,成功率会急剧下降。

观察模型关注的对象

作者从一个简单但有力的观察出发:在相同数据集上训练的不同神经网络在做出相同预测时往往“注视”图像中的相似区域。这种内部关注可以通过热图可视化,显示哪些像素对决策贡献最大——一种机器注意力图。即便架构不同,对于相同输入和标签,这些注意力模式也显著相似。论文将这种共享模式形式化为注意力语义属性(Attentional Semantic Property,ASP),它定量描述每个像素对某一类别的支持程度。作者没有把注意力图仅仅当作可视化工具,而是将ASP本身转变为可以直接优化的对象。

摧毁共享语义而非追逐标签

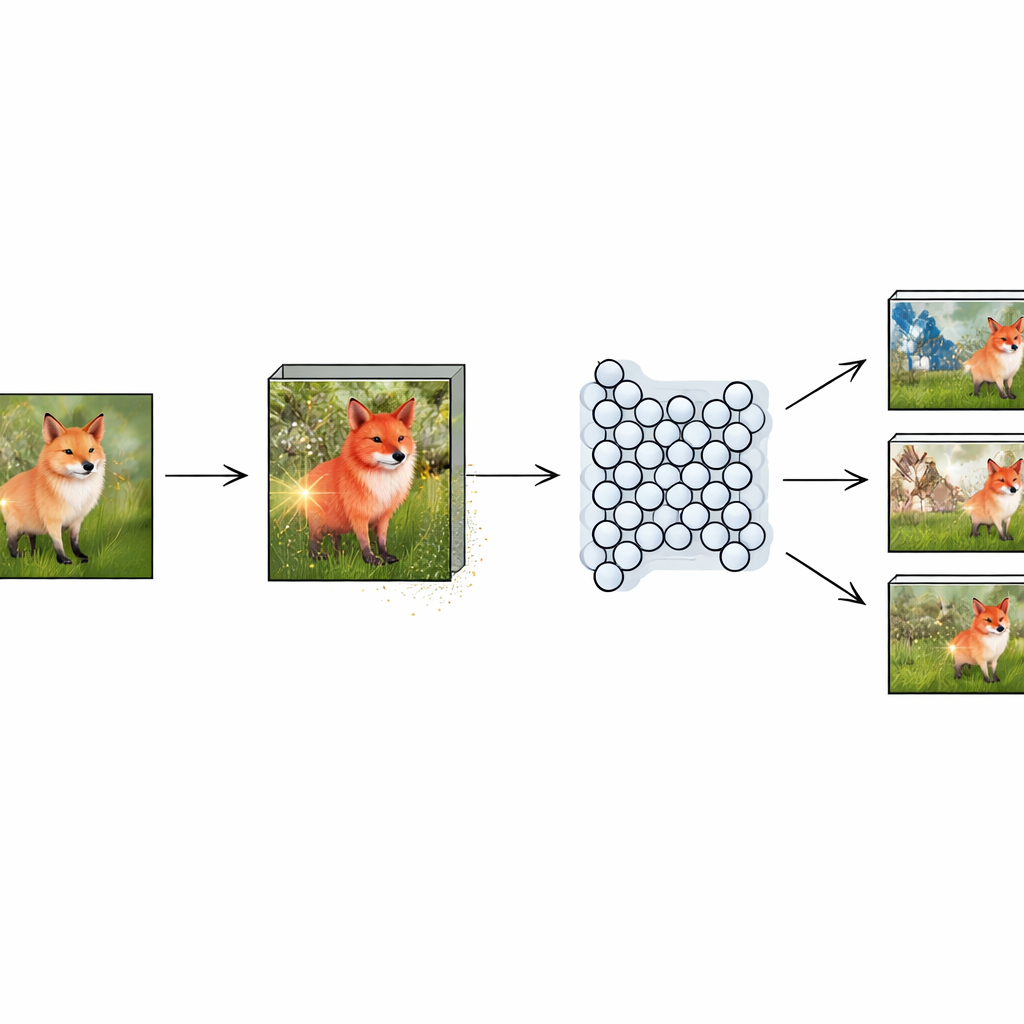

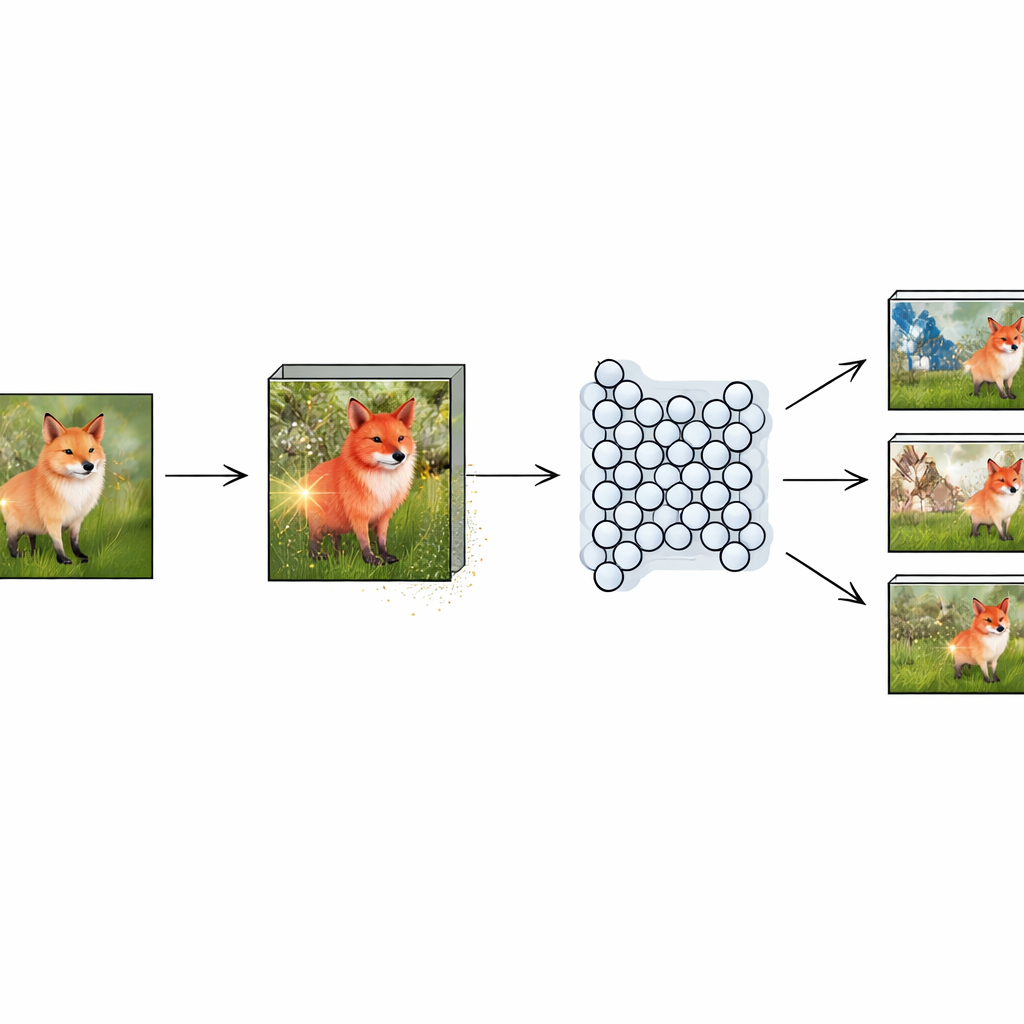

Figure 1.

基于这一思想,论文提出了注意力语义攻击(Attentional Semantic Attack,ASA)。ASA并非推动图像以增加常规分类损失,而是寻找能专门扭曲ASP的微小像素改动。该攻击旨在减少对真实类别的注意力,同时增加对某个错误类别的注意力。为了避免对单一替代标签过拟合,ASA常在每次优化步骤中随机选择该错误类别,迫使扰动破坏更普遍的证据模式,而不仅仅是交换前两名预测。从技术上讲,ASA使用一种称为层次相关传播(Layer-wise Relevance Propagation)的方法计算像素级相关性图,然后定义测量这些图在扰动前后相似性或差异性的损失函数。迭代沿着这种基于注意力的损失的梯度更新,会产生“注意力扰动”,重塑多个模型在图像中认为重要的区域。

衡量并比较破坏程度

为了测试他们的方法,作者在一个知名模型上生成对抗图像,并在十几种其他模型上评估,包括标准卷积网络、经对抗训练强化的模型以及现代视觉Transformer。在基于ImageNet的广泛实验中,ASA始终比依赖各种巧妙梯度调整、输入变换或中间特征操纵的众多竞争方法取得更高的攻击成功率。论文还提出了一种量化攻击“强度”的新方法,称为标签置信度变化(Label Confidence Change,LCC)。LCC并不只关心预测标签是否翻转,而是衡量模型对原正确类别的置信度下降了多少。高LCC表明图像被深入破坏,更可能迁移到未见模型,ASA生成的样本在LCC上显著高于竞争方法。

深入攻击机制内部

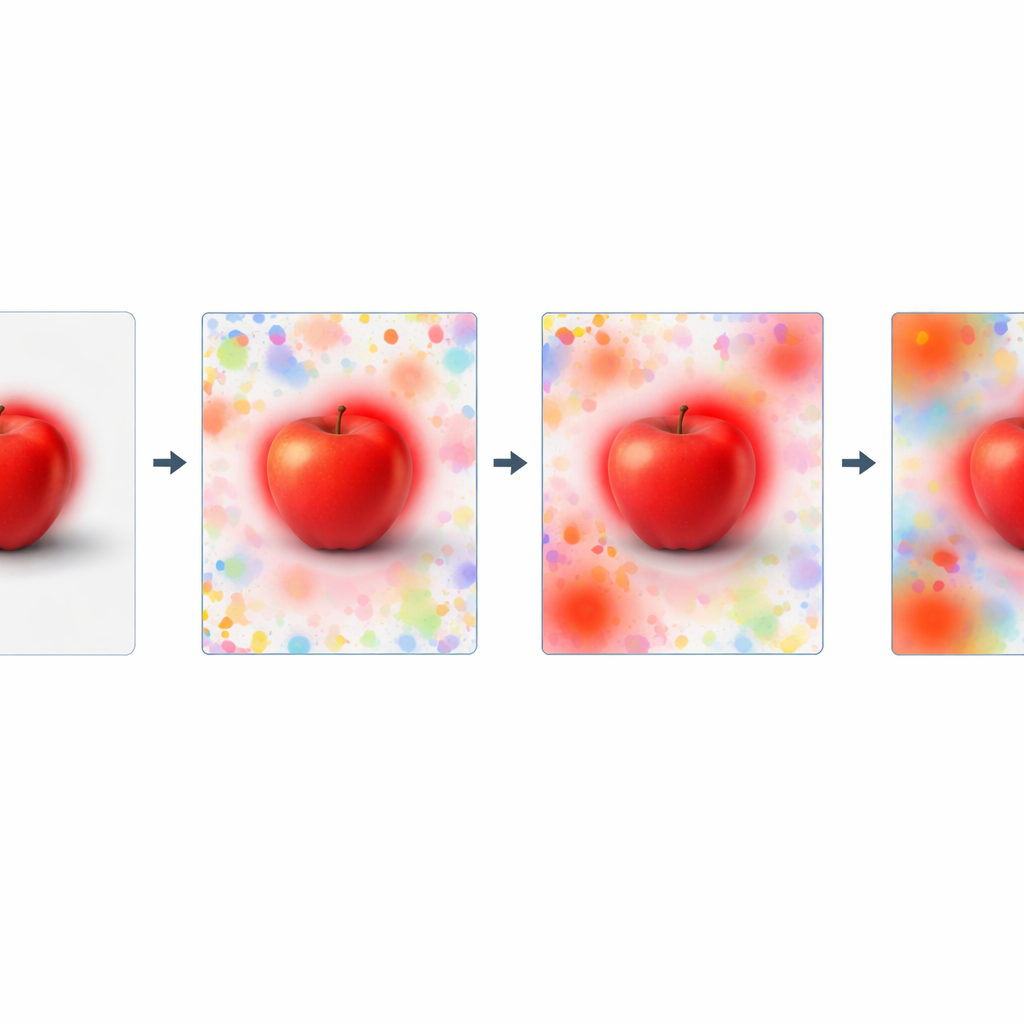

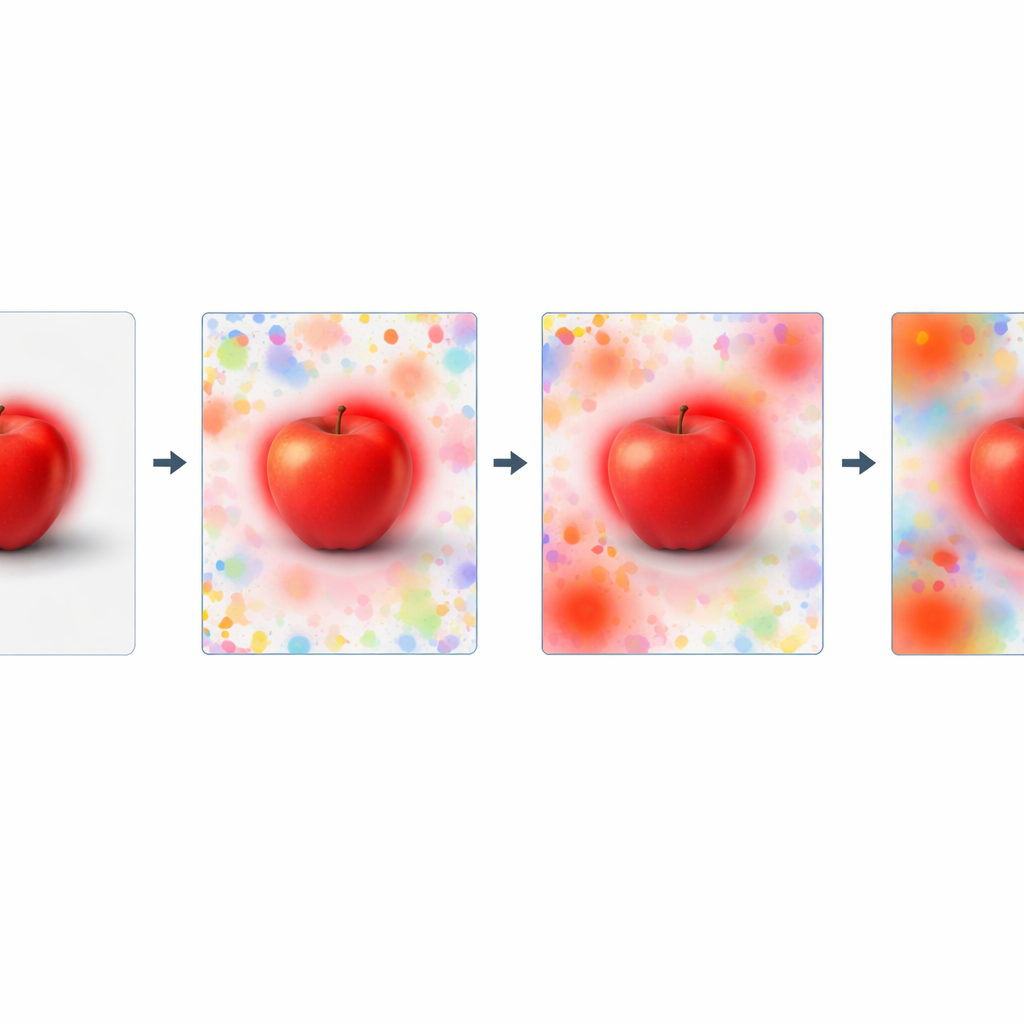

Figure 2.

注意力热图的可视化比较有助于解释为什么ASA具有较好的可迁移性。在传统攻击下,网络内部的高亮关注区域在迭代过程中只发生轻微移动,即使最终预测错误;模型对物体位置的基本认知仍然保持,这限制了扰动的广泛泛化。在ASA下,重复施加注意力扰动会彻底重构这些图:注意力从真实物体处流失,迁移到背景区域或无关结构上。这种内部关注的整体重排在普通模型和鲁棒模型中都能观察到,并且可以通过将ASA与现有的增强技巧(例如随机输入尺寸调整或源模型集成)结合来进一步加强。

对更安全AI的启示

简单来说,论文表明当今的视觉系统在判断图像中重要内容方面共享一种共同的“意义感”——而有针对性的噪声可以同时扰乱许多不同模型的这种共享意义。通过直接攻击注意力而不仅仅是最终标签分数,ASA产生的对抗图像更难被当前的防御方法忽视,也更适合用来对现实系统进行压力测试。对防御者而言,这强调了保护人工智能不仅要防护输出,还需要守护支撑模型对世界理解的内部注意力路径。

引用: Wang, P., Liu, J. Attentional semantic attack for enhancing adversarial samples transferability. Sci Rep 16, 10957 (2026). https://doi.org/10.1038/s41598-026-45207-8

关键词: 对抗示例, 神经网络安全, 注意力图, 黑箱攻击, 图像分类