Clear Sky Science · ja

敵対的サンプルの転移性を高めるための注意意味的攻撃

なぜ賢い機械を騙すことが重要か

深層ニューラルネットワークで動く現代の人工知能システムは、自動運転車の歩行者検出、写真の顔認識、医療画像の診断支援などに広く信頼されるようになっています。にもかかわらず、こうしたシステムには意外な弱点があります。人間にはほとんど知覚できない程度の微小で精巧に設計された画像の変更が、システムに極端に誤った予測をさせることがあるのです。本論文はその脆弱性に取り組み、複数のモデルを同時に騙せる新しい「敵対的」画像生成法を示します。これはAIの安全性に対するより強い警告であると同時に、将来のシステムを強度試験するための強力な手段でもあります。

攻撃者はいまどうやってニューラルネットを騙すか

既存の多くの攻撃手法は、各ピクセルをモデルの訓練損失を最も増大させる方向へ微小に動かすことで機能します。モデルの構造やパラメータがすべてわかっている場合──いわゆるホワイトボックス状況──この手法は非常に有効です。しかし現実には、企業や病院が配置した内部が秘匿された「ブラックボックス」モデルに直面することが多く、その場合は代理モデル上で敵対的画像を作り、それが隠れたモデルにも通用すること(転移性)に期待する必要があります。標準的な勾配ベースの手法はしばしば代理モデルに過剰適合しがちで、一つのモデルの決定境界の特異性を突くため、別のアーキテクチャや防御訓練で堅牢化されたモデルに対して成功率が急落します。

モデルが何に注意を払っているかを見る

著者らはまず単純だが強力な観察から出発します。同じデータセットで訓練された異なるニューラルネットワークは、同じ予測をする際に画像の似た部分に「注目」する傾向がある、というものです。この内部の焦点は、ある決定に最も寄与するピクセルを示すヒートマップとして可視化できます──一種の機械の注意マップです。アーキテクチャが異なっていても、同じ入力とラベルに対する注意パターンは驚くほど似ています。本論文はこの共有されるパターンを「注意意味的性質(Attentional Semantic Property, ASP)」として定式化し、各ピクセルが特定のカテゴリをどの程度支持しているかを定量的に記述します。著者らは注意マップを単なる可視化ツールとして扱うのではなく、ASP自体を直接最適化可能な対象へと転換します。

ラベルを追いかけるのではなく共有された意味を破壊する

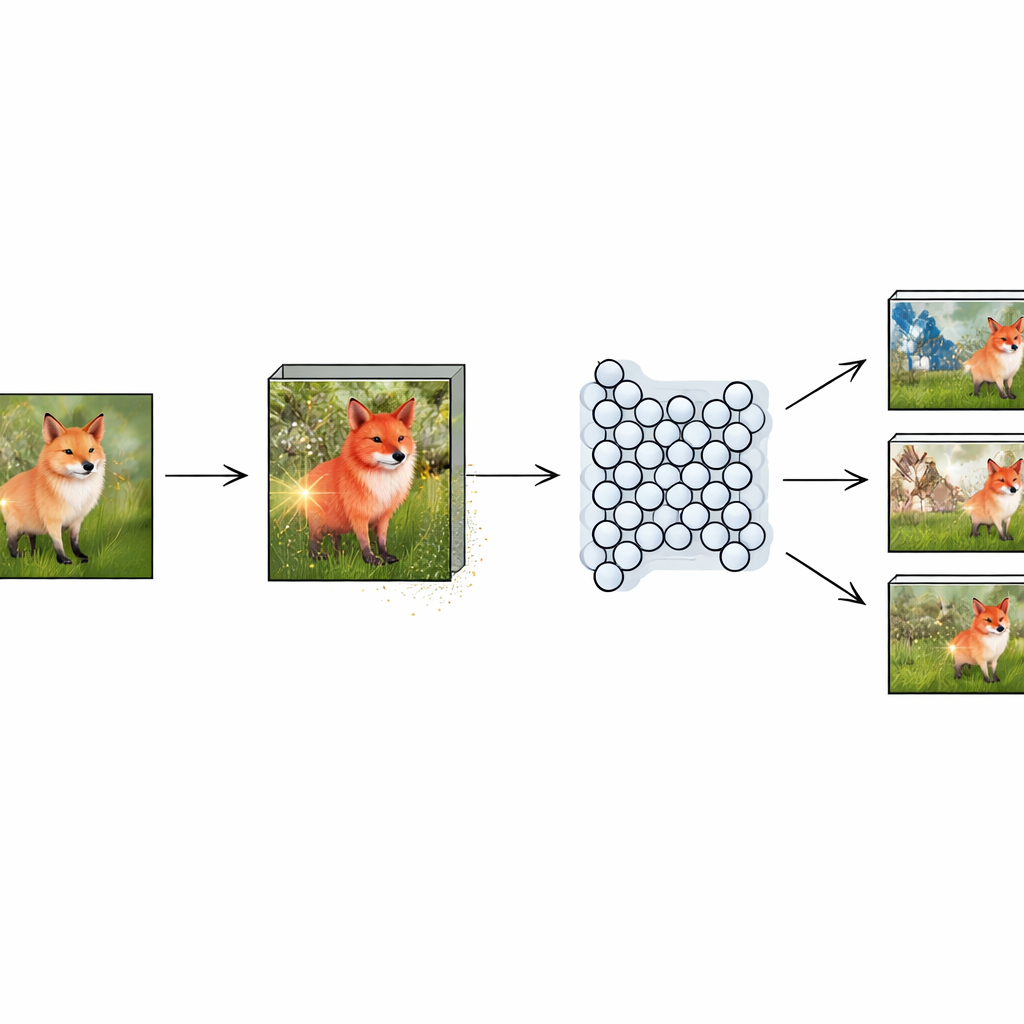

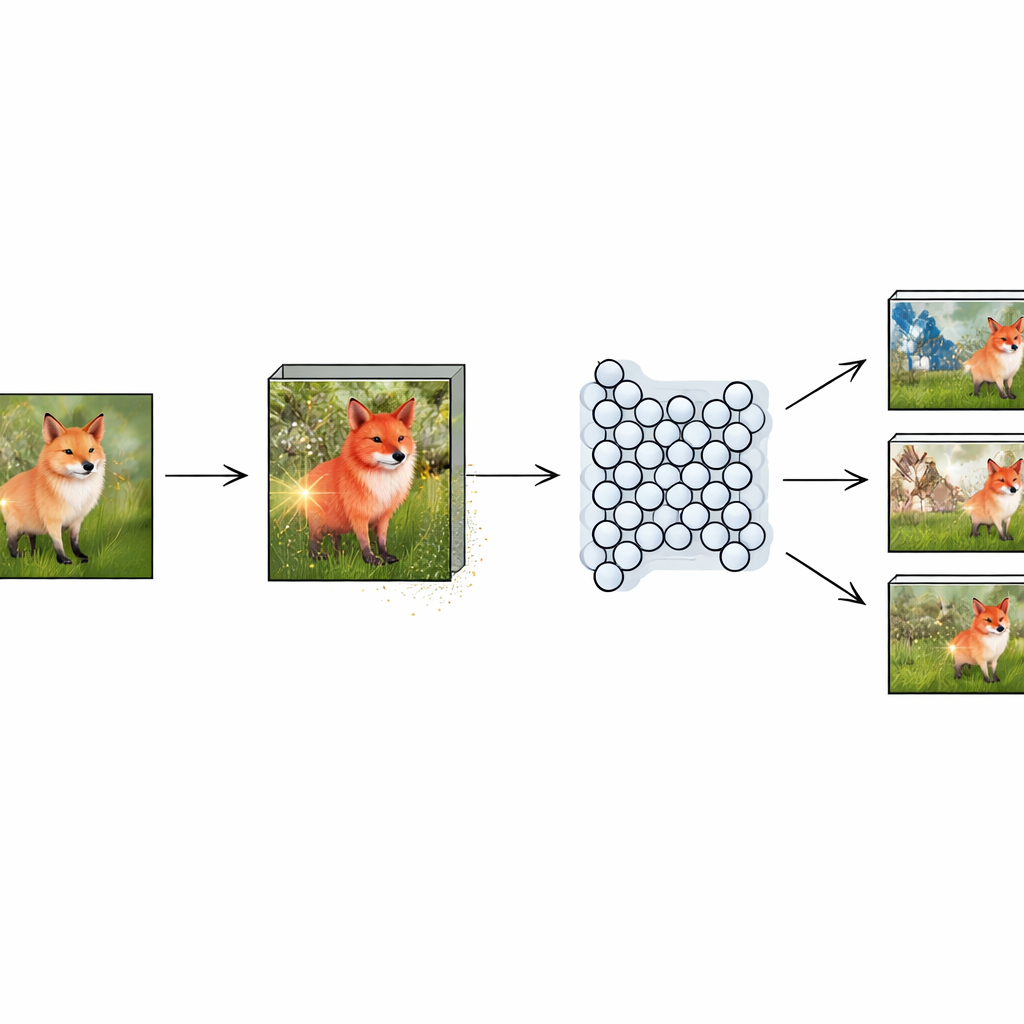

Figure 1.

この発想を踏まえて、本論文は注意意味攻撃(Attentional Semantic Attack, ASA)を導入します。通常の分類損失を増加させる方向に画像を押すのではなく、ASAはASPを具体的に歪めるような微小なピクセル変更を探索します。攻撃は真のクラスに向けられた注意を減らし、別の誤ったクラスへの注意を増やすことを目的とします。単一の代替ラベルに過剰適合するのを避けるため、ASAはしばしば最適化の各ステップでその別クラスをランダムに選び、摂動が単に上位2つの予測を入れ替えるのではなく、より一般的な証拠パターンを破壊するように強制します。技術的には、ASAはLayer-wise Relevance Propagationという手法を用いてピクセルごとの関連度マップを算出し、摂動前後でこれらのマップがどれだけ類似または異なるかを測る損失関数を定義します。この注意に基づく損失の勾配に従って反復的に更新することで、複数モデルが画像内で重要とみなす部分を再形成する「注意的摂動」が得られます。

ダメージを測り比較する

手法を検証するために、著者らはよく知られた一つのモデル上で敵対的画像を生成し、それを標準的な畳み込みネットワーク、敵対的訓練で堅牢化されたモデル、最新のビジョントランスフォーマーなど12の別モデルで評価しました。ImageNetに基づく広範な実験を通じて、ASAは巧妙な勾配調整、入力変換、中間特徴操作に頼る幅広い競合手法より一貫して高い攻撃成功率を達成します。さらに、本論文は攻撃の“強さ”を定量化する新しい指標、Label Confidence Change(LCC)を提案します。単に予測ラベルが反転したかを問う代わりに、LCCは元の正しいクラスに対するモデルの信頼度がどれだけ低下したかを測ります。LCCが高いということは、画像が深く破壊されており、未知のモデルにも転移しやすいことを示しますが、ASAのサンプルは競合手法より顕著に大きなLCCを示しました。

攻撃メカニズムの内部を覗く

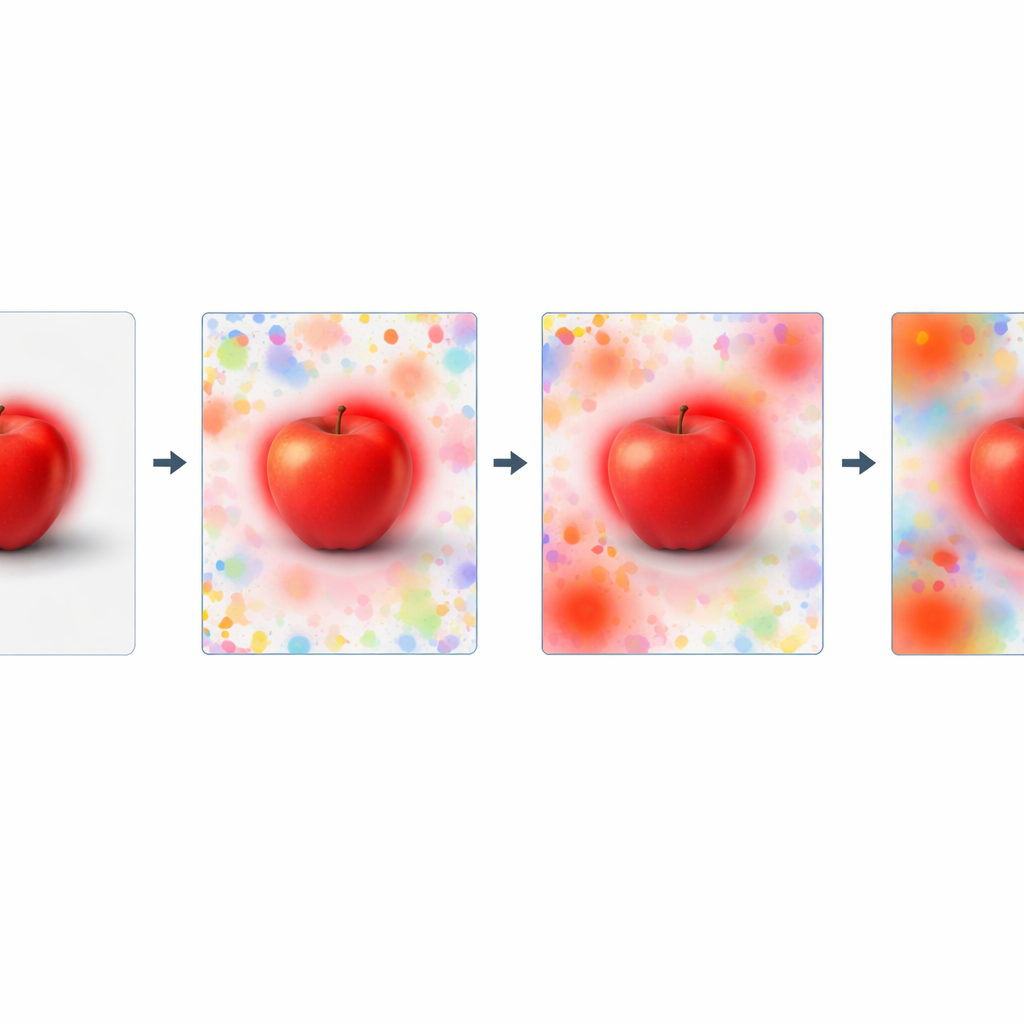

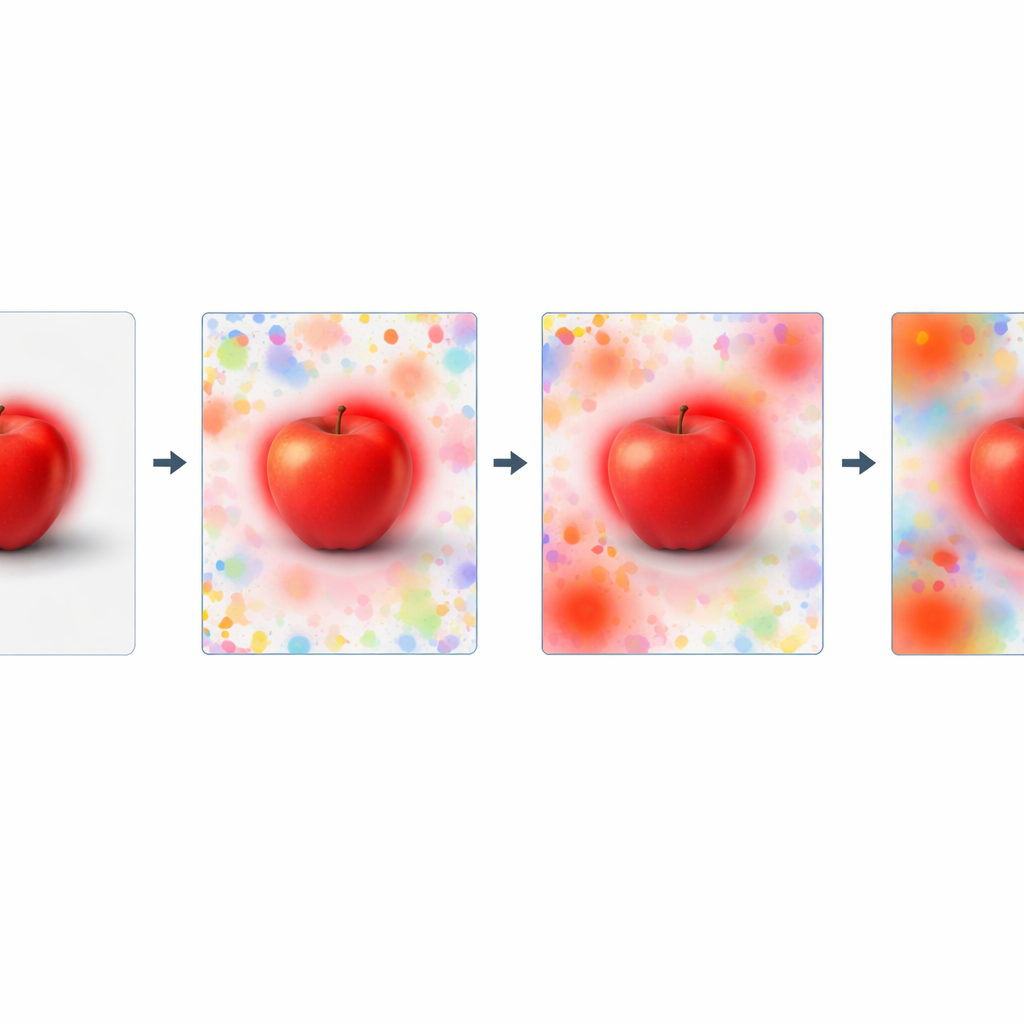

Figure 2.

注意ヒートマップの視覚的比較は、なぜASAがよく転移するのかを説明する助けになります。従来型の攻撃では、最終的な予測が誤ってもネットワーク内部の明るい注目領域は反復の間でわずかにしか移動しません。モデルが物体の所在に関する基本的な概念を保持しているため、摂動の一般化範囲が制限されるのです。ASAの下では、注意的摂動を繰り返し適用することでこれらのマップが劇的に書き換えられます。真の対象から注意が失われ、背景領域や無関係な構造に注意が移るのです。この内部焦点の全面的な再編は通常モデルでも堅牢化モデルでも観察され、ASAはランダムな入力リサイズやソースモデルのアンサンブルといった既存の強化手法と組み合わせることでさらに強化できます。

より安全なAIにとっての意味

平たく言えば、本論文は現代の視覚システムが画像で重要なものについて共通の「意味感覚」を共有しており、標的を絞ったノイズがその共有された意味を多くの異なるモデルにわたってかき乱しうることを示しています。最終的なラベルスコアだけでなく注意の内部経路自体を直接攻撃することで、ASAは現在の防御が容易に無視できない敵対的画像を生成し、実世界のシステムを強度試験する際により信頼できる手段を提供します。防御側にとっては、AIを守るには出力だけでなくモデルの理解を支える内部の注意経路も保護する必要があることが改めて示されています。

引用: Wang, P., Liu, J. Attentional semantic attack for enhancing adversarial samples transferability. Sci Rep 16, 10957 (2026). https://doi.org/10.1038/s41598-026-45207-8

キーワード: 敵対的事例, ニューラルネットワークのセキュリティ, 注意マップ, ブラックボックス攻撃, 画像分類