Clear Sky Science · ru

Многостратегийная структура для улучшения алгоритма Harris hawks для задач глобальной оптимизации

Умнейшая охота благодаря данным

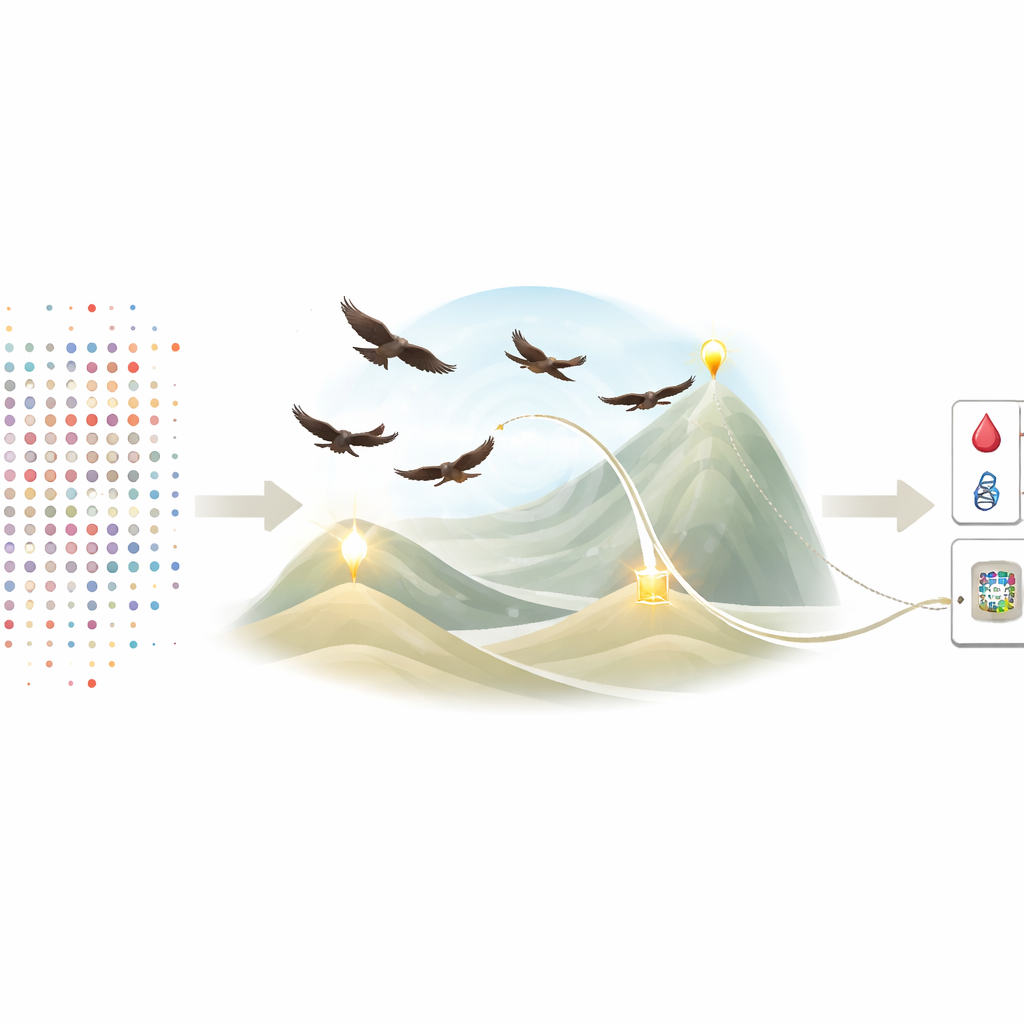

Современные больницы собирают огромное количество информации о каждом пациенте — от анализов крови и снимков до показаний датчиков и опросников. В этих измерениях скрыты шаблоны, которые помогают врачам раньше выявлять болезни и выбирать более эффективные лечения. Но когда измерений значительно больше, чем пациентов, традиционные модели могут запутаться и «подхватить» шум вместо истинных сигналов. В этой статье представлен новый подход, помогающий алгоритмам просеивать большие медицинские наборы данных, чтобы найти небольшое, надежное множество признаков, которое по‑прежнему точно предсказывает заболевание.

Почему избыток информации вреден

Медицинские наборы данных сегодня могут включать десятки и даже тысячи измерений на одного человека, тогда как число пациентов остается относительно небольшим. Этот дисбаланс делает модели склонными к «переобучению», когда они кажутся превосходными на прошедших данных, но не работают на новых пациентах. Одно из мощных решений — выбор признаков: вместо того чтобы подбрасывать в модель каждую лабораторную величину и измерение со сканера, алгоритм сначала ищет компактный набор самых информативных признаков. Диагностический инструмент, опирающийся на несколько ключевых биомаркеров, не только легче обучать и быстрее использовать, но и понятнее врачам, которым важно понимать, почему было принято то или иное решение.

Вдохновлено охотой ястребов

Чтобы выбрать такой идеальный поднабор признаков, авторы опираются на технику, вдохновлённую природой, — алгоритм Harris Hawks Optimization. В этой метафоре каждый возможный поднабор признаков — это «насест» для ястреба, а поиск лучшего набора имитирует скоординированную охоту на добычу по ландшафту вариантов. Стандартный Harris Hawks Optimization хорош в широком исследовании пространства и последующем сближении с перспективными областями, но он всё ещё может застрять, кружась вокруг вводного холма — решения, которое выглядит хорошим локально, но не является лучшим глобально. Такие замины особенно дорого обходятся в медицине, где каждое пробное решение оценивается обучением и тестированием классификатора — трудоёмкой процедурой.

Три новых приёма для стаи

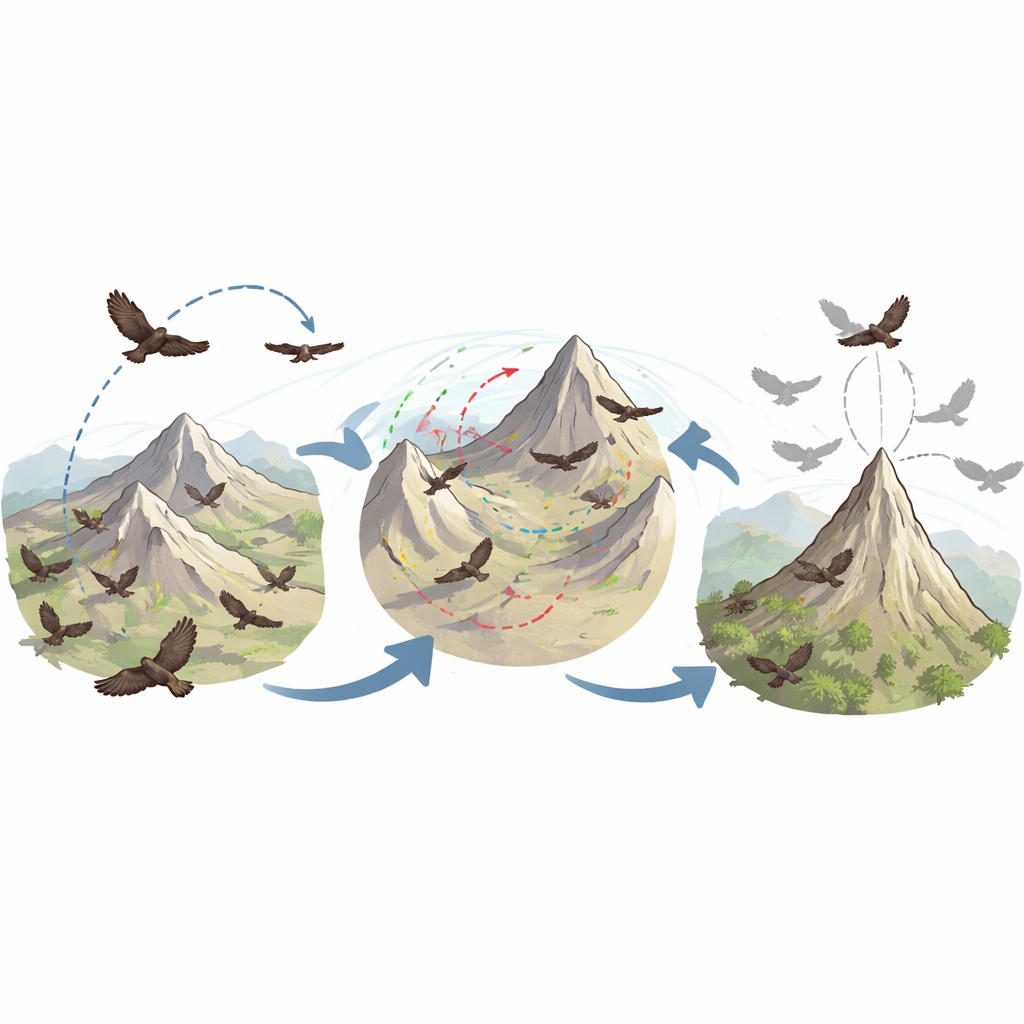

В работе предложена модифицированная структура, называемая MHHO, которая снабжает виртуальных ястребов тремя новыми стратегиями. Во‑первых, шаг «пересаадки» под руководством лидера подталкивает исследующих ястребов больше ориентироваться на текущее лучшее решение вместо того, чтобы слепо следовать случайным сородичам, что помогает быстрее достигать перспективных областей. Во‑вторых, адаптивный фактор обмана следит за признаками застоя; при их появлении он временно увеличивает амплитуду случайных скачков ястребов, чтобы они могли выпрыгнуть из локальных ловушек, а затем смягчает эти скачки, когда улучшение возобновляется, для точной доработки. В‑третьих, иерархическая стратегия атаки меняет финальный бросок: вместо того чтобы все ястребы ныряли в одну точку, каждый получает руководство от немного более успешного «наставника», подходя к цели под разными углами и препятствуя преждевременному слипанию всей стаи в одном месте.

Тестирование на математических задачах и реальных пациентах

Чтобы проверить, помогают ли эти новые поведения на практике, авторы провели два крупных кампейна тестов. В первом MHHO и исходный метод решали 23 стандартных математических эталонных задачи, широко используемых для испытания оптимизационных алгоритмов. MHHO показал лучшие результаты в подавляющем большинстве случаев, сходясь быстрее и точнее к истинному оптимуму, хотя и с некоторым увеличением времени вычислений. Во втором кампейне команда использовала MHHO в качестве селектора признаков на 15 общедоступных медицинских наборах данных, включая рак молочной железы, сердечные заболевания, расстройства щитовидной железы, болезнь Паркинсона и диабетическую ретинопатию. В каждом испытании классификатор опорных векторов оценивал, насколько выбранный поднабор признаков способен различать здоровых и больных (или между несколькими категориями диагнозов).

Меньше тестов — яснее ответы

В этих медицинских примерах MHHO обычно находил очень небольшие наборы признаков — часто всего один или два измерения — которые давали равную или более высокую точность классификации по сравнению с исходным подходом. Он также производил более стабильные решения: повторные прогоны склонны были выбирать похожие поднаборы и достигать схожей точности, что важно, когда врачи и регуляторы требуют воспроизводимости. Статистические тесты подтвердили, что каждая из трёх добавленных стратегий вносит значимый вклад, и что вместе они дают благоприятный баланс между точностью и разреженностью. На практике это означает, что будущие диагностические инструменты могут опираться на компактную панель высокоинформативных тестов, снижая стоимость и сложность при сохранении доверия к результатам.

Что это значит для пациентов и практиков

Для неспециалистов главная идея такова: улучшенные «стратегии поиска» внутри систем машинного обучения могут сделать медицинский ИИ одновременно умнее и проще. Координируя виртуальных ястребов, которые исследуют пространство, выходят из ловушек и интеллектуально уточняют прицел, предложенная структура помогает компьютерам сосредоточиться на нескольких наиболее важных измерениях. Хотя метод требует дальнейшей валидации за пределами медицины и добавляет некоторую вычислительную нагрузку, он демонстрирует, как продуманная оптимизация может приблизить нас к диагностическим моделям, которые точны, стабильны и понятны клиницистам, что облегчает их внедрение.

Цитирование: Al-Adwan, S., Abdullah, S., Alweshah, M. et al. A multi-strategy framework for enhancing Harris hawks optimization for global optimization problems. Sci Rep 16, 10614 (2026). https://doi.org/10.1038/s41598-026-45741-5

Ключевые слова: выбор признаков, медицинская диагностика, метаэвристическая оптимизация, алгоритм Harris hawks, высокомерные данные