Clear Sky Science · es

Un marco multi‑estrategia para mejorar la optimización Harris hawks en problemas de optimización global

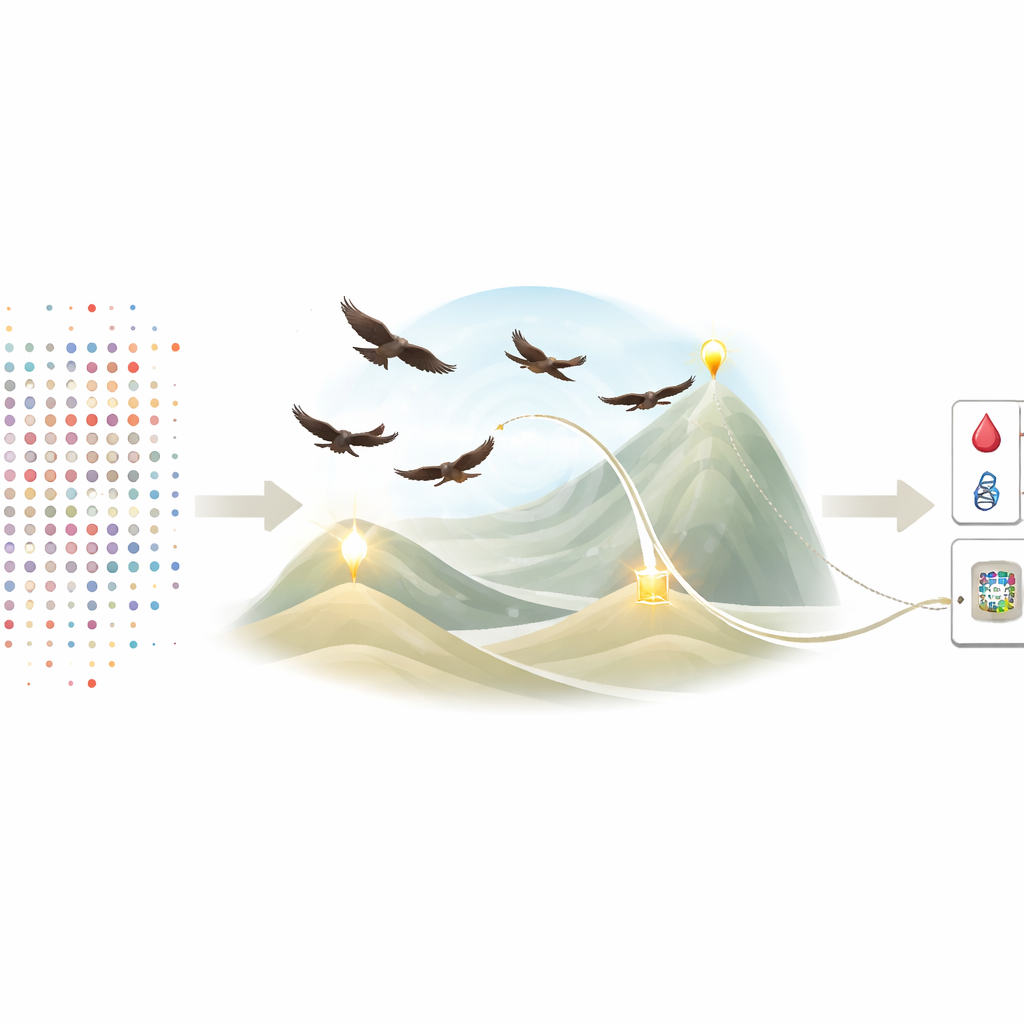

Cacerías más inteligentes mediante los datos

Los hospitales modernos recopilan una enorme cantidad de información sobre cada paciente —desde análisis de sangre y exploraciones hasta lecturas de sensores y cuestionarios—. Ocultos entre todas esas mediciones hay patrones que pueden ayudar a los médicos a detectar enfermedades antes y a escoger tratamientos mejores. Pero cuando hay muchas más mediciones que pacientes, los modelos informáticos tradicionales pueden confundirse y aferrarse al ruido en lugar de a las señales reales. Este artículo presenta una nueva forma de ayudar a los algoritmos a tamizar grandes conjuntos de datos médicos para encontrar un conjunto pequeño y fiable de pistas que siga prediciendo la enfermedad con precisión.

Por qué demasiada información puede perjudicar

Los conjuntos de datos médicos actuales pueden incluir docenas o incluso miles de mediciones por persona, mientras que el número de pacientes sigue siendo relativamente pequeño. Ese desequilibrio hace que los modelos informáticos sean propensos al “sobreajuste”, donde parecen brillantes con datos pasados pero fallan con pacientes nuevos. Un remedio eficaz es la selección de características: en vez de alimentar al modelo con cada valor de laboratorio y medición de una exploración, un algoritmo busca primero un conjunto compacto de las características más informativas. Una herramienta de diagnóstico que se base en un puñado de biomarcadores clave no solo es más fácil de entrenar y más rápida de ejecutar, sino que además resulta más transparente para los clínicos, que pueden razonar sobre por qué se tomó una decisión.

Inspirado en halcones en la caza

Para elegir ese subconjunto ideal de características, los autores se apoyan en una técnica inspirada en la naturaleza llamada Optimización Harris Hawks. En esta metáfora, cada posible subconjunto de características es una “percha” para un halcón, y la búsqueda del mejor subconjunto imita una caza coordinada de la presa a través de un paisaje de posibilidades. La Optimización Harris Hawks estándar es buena para desplazarse ampliamente y luego concentrarse en regiones prometedoras, pero aún puede quedar atrapada dando vueltas alrededor de una cumbre engañosa —una solución que parece buena localmente pero no es la mejor realmente. Estas paradas son especialmente costosas en medicina, donde cada solución de prueba debe evaluarse entrenando y probando un clasificador, un paso que consume tiempo.

Tres trucos nuevos para la bandada

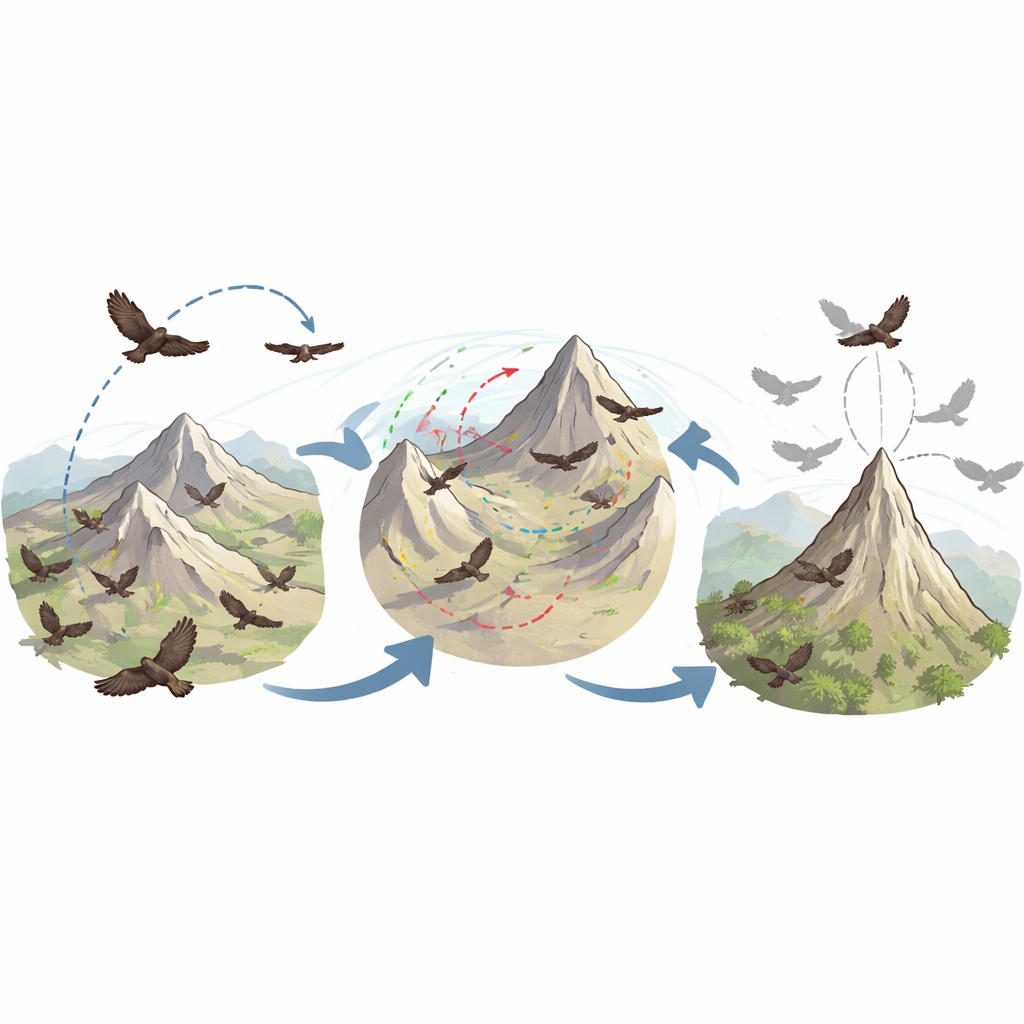

El artículo propone un marco modificado, denominado MHHO, que dota a los halcones virtuales de tres estrategias nuevas. Primero, un paso de percha guiado por el líder empuja a los halcones exploradores a prestar más atención a la solución actualmente mejor en lugar de deambular a ciegas tras pares aleatorios, ayudando a que la búsqueda alcance regiones prometedoras más pronto. Segundo, un factor de engaño adaptativo vigila señales de estancamiento; cuando eso ocurre, aumenta temporalmente la magnitud de los saltos aleatorios de los halcones para que puedan salir de trampas locales, y luego reduce esos saltos una vez que se reanuda la mejora para afinar los resultados. Tercero, una estrategia de ataque jerárquica cambia cómo funciona el golpe final: en lugar de que todos los halcones se lancen directamente al mismo punto, cada uno toma orientación de un halcón “mentor” ligeramente mejor, acercándose al objetivo desde múltiples ángulos y evitando que toda la bandada se agrupe demasiado pronto.

Pruebas en rompecabezas matemáticos y pacientes reales

Para comprobar si estos nuevos comportamientos realmente ayudan, los autores llevaron a cabo dos campañas de prueba principales. En la primera, MHHO y el método original abordaron 23 problemas de referencia matemáticos estándar que se usan ampliamente para desafiar a los algoritmos de optimización. MHHO obtuvo mejores resultados en la mayoría de ellos, convergiendo más rápido y con mayor precisión hacia el verdadero valor óptimo, aunque con un tiempo de cómputo algo mayor. En la segunda campaña, el equipo usó MHHO como selector de características en 15 conjuntos de datos médicos de acceso público, incluidos cáncer de mama, enfermedad cardíaca, trastornos tiroideos, enfermedad de Parkinson y retinopatía diabética. Para cada ensayo, un clasificador de máquinas de vectores de soporte evaluó qué tan bien un subconjunto de características dado podía distinguir entre sano y enfermo (o entre múltiples categorías de diagnóstico).

Menos pruebas, respuestas más claras

En estos estudios de caso médicos, MHHO normalmente encontró conjuntos muy pequeños de características —a menudo solo una o dos mediciones— que ofrecieron una precisión de clasificación igual o superior en comparación con el enfoque original. También produjo soluciones más estables: ejecuciones repetidas tendían a escoger subconjuntos similares y a alcanzar precisiones parecidas, una propiedad importante cuando médicos y reguladores exigen reproducibilidad. Las pruebas estadísticas confirmaron que cada una de las tres estrategias añadidas aportó mejoras significativas, y que en conjunto ofrecían un equilibrio favorable entre precisión y escasez de características. En términos prácticos, esto significa que futuras herramientas de diagnóstico podrían construirse sobre un panel reducido de pruebas altamente informativas, reduciendo coste y complejidad sin sacrificar la fiabilidad.

Qué significa esto para pacientes y profesionales

Para los no especialistas, el mensaje principal es que mejores “estrategias de búsqueda” dentro de los sistemas de aprendizaje automático pueden hacer que la IA médica sea a la vez más inteligente y más sencilla. Al coordinar halcones virtuales que exploran, escapan de trampas y refinan su objetivo con inteligencia, el marco propuesto ayuda a los ordenadores a centrarse en las pocas mediciones que más importan. Aunque el método aún requiere más validación más allá de la medicina y añade cierto coste computacional, demuestra cómo una optimización cuidadosamente diseñada puede acercarnos a modelos de diagnóstico que sean precisos, estables y más fáciles de entender y adoptar por los clínicos.

Cita: Al-Adwan, S., Abdullah, S., Alweshah, M. et al. A multi-strategy framework for enhancing Harris hawks optimization for global optimization problems. Sci Rep 16, 10614 (2026). https://doi.org/10.1038/s41598-026-45741-5

Palabras clave: selección de características, diagnóstico médico, optimización metaheurística, algoritmo Harris hawks, datos de alta dimensión