Clear Sky Science · pt

Duração entre recompensas controla a taxa de aprendizado comportamental e dopaminérgico

Por que o ritmo das recompensas importa

Professores avisam contra estudar em cima da hora, e adestradores espaçam os petiscos — mas por que fazer pausas ajuda a aprender? Este estudo faz uma pergunta surpreendentemente simples com grandes implicações: quando você tenta aprender que um sinal prevê uma recompensa, é melhor receber muitas recompensas rápidas ou menos recompensas espaçadas por mais tempo? Ao cronometrar cuidadosamente gotas de água adoçada para camundongos e medir tanto o comportamento quanto a química cerebral, os pesquisadores descobrem uma regra matemática que mostra que o tempo entre recompensas, e não o número bruto de tentativas, controla a velocidade do aprendizado.

Aprender com menos, mas melhor espaçados, petiscos

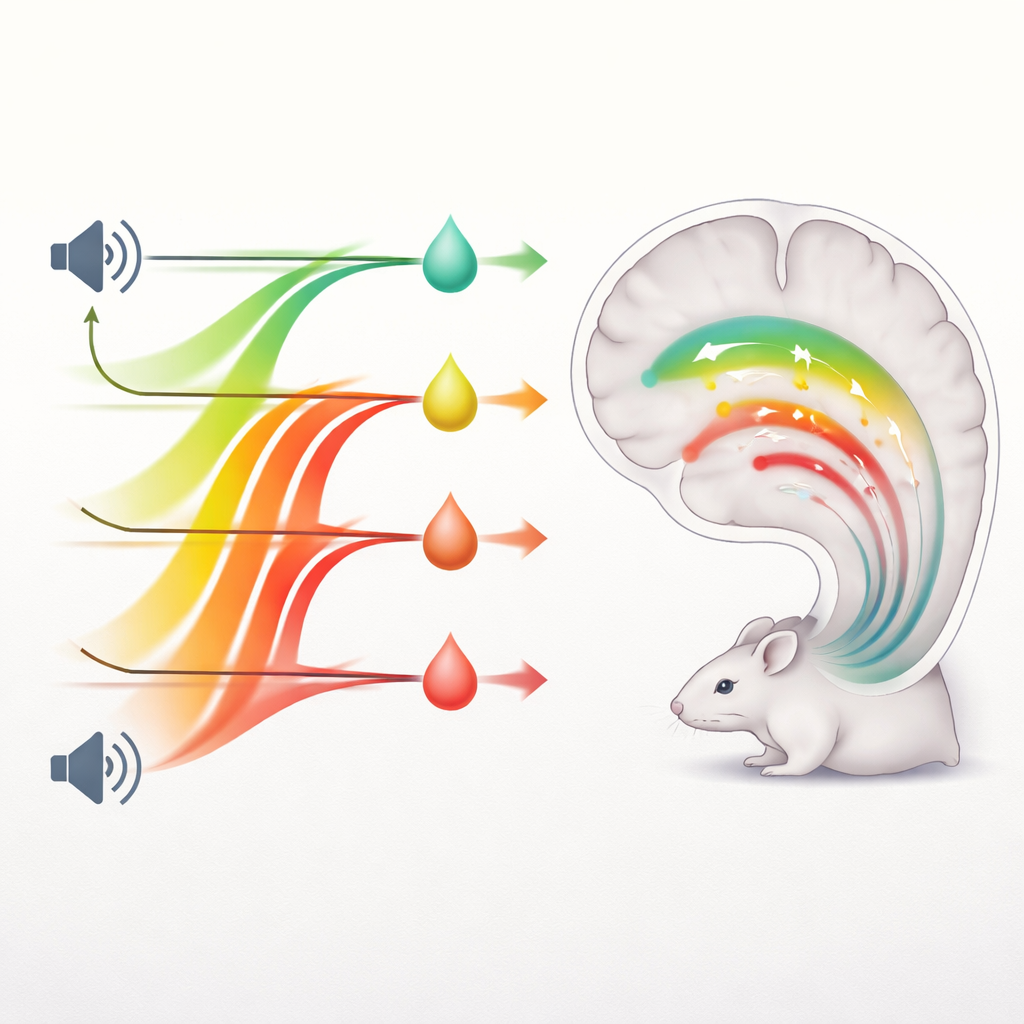

A equipe treinou camundongos sedentos, com a cabeça imobilizada, para associar um breve tom a um pequeno gole de líquido doce. Todos os camundongos ouviram o mesmo som e receberam a mesma recompensa logo em seguida, mas o tempo até o próximo ciclo tom‑recompensa variou dramaticamente — de meio minuto até dez minutos, e em um grupo até uma hora. Camundongos com pausas curtas tiveram muitas associações por dia, enquanto os de pausas longas tiveram apenas algumas. Intuitivamente, poderia-se esperar que o cronograma “corrido” produzisse aprendizado mais rápido. Em vez disso, ocorreu o oposto: quando as pausas foram dez vezes mais longas, os camundongos precisaram de cerca de dez vezes menos experiências tom‑recompensa para descobrir a associação.

Mesmo aprendizado no mesmo tempo, não importa quantas tentativas

Embora os camundongos espaçados precisassem de muito menos experiências, eles não aprenderam literalmente mais rápido em tempo real. Quando os pesquisadores calcularam quantos minutos de condicionamento haviam se passado antes de cada camundongo começar a lamber de forma consistente em antecipação à recompensa, o tempo total para aprender foi praticamente idêntico entre os grupos cujas pausas variaram por um fator de 20. Em outras palavras, alongar o intervalo entre recompensas tornou cada experiência individual mais potente para o aprendizado, em proporção direta ao tempo de espera. Remover nove em cada dez tentativas de um cronograma denso teve essencialmente nenhum efeito sobre quanto tempo levou para a associação se formar, desde que o tempo total decorrido no contexto de treino permanecesse o mesmo.

Sinais de dopamina seguem a mesma regra

Para ver o que acontecia dentro do cérebro, os cientistas usaram um sensor fluorescente para rastrear a dopamina, um mensageiro químico há muito pensado como sinalizador de erro de previsão de recompensa — isto é, a diferença entre a recompensa esperada e a real. À medida que o treino progrediu, breves picos de dopamina deslocaram‑se gradualmente da própria recompensa para o tom preditivo. Crucialmente, essas respostas de dopamina exibiram a mesma regra temporal que o comportamento: quando as recompensas foram espaçadas dez vezes mais, o pico de dopamina ao sinal apareceu após cerca de uma décima parte das experiências tom‑recompensa, porém após aproximadamente a mesma quantidade de tempo de relógio. O padrão valeu não só para recompensas agradáveis, mas também quando o tom previa um choque leve, sugerindo que tanto o aprendizado positivo quanto o negativo compartilham a mesma regra baseada no tempo.

Uma nova forma de o cérebro computar causa e efeito

Teorias clássicas retratam o aprendizado como um processo tentativa a tentativa em que cada experiência puxa um valor interno para cima ou para baixo por uma fração fixa. Nesses modelos “baseados em tentativas”, ver mais pareamentos de sinal e resultado em um dado período deveria sempre acelerar o aprendizado. Os novos resultados contradizem essa ideia e, em vez disso, dão suporte a um quadro diferente, chamado ANCCR, no qual o cérebro atualiza suas crenças apenas quando um resultado realmente ocorre e então trabalha para trás no tempo para creditar sinais anteriores. Como essas atualizações são desencadeadas a cada recompensa, o modelo prevê que a mudança por recompensa deve crescer em proporção direta ao tempo decorrido desde a recompensa anterior. Isso explica matematicamente por que lacunas mais longas entre recompensas fazem cada experiência valer mais, enquanto deixam o aprendizado total após uma duração fixa inalterado.

Repensando “a prática leva à perfeição”

Ao mostrar que a duração entre recompensas — e não o mero número de tentativas — governa tanto as taxas de aprendizado comportamental quanto as dopaminérgicas, este trabalho desafia a suposição comum de que mais repetições automaticamente significam aprendizado mais rápido. Para associações simples entre sinais e resultados, acumular tentativas extras pode oferecer pouco benefício se as recompensas vierem muito próximas umas das outras. Em vez disso, um espaçamento bem cronometrado pode permitir que o sistema de dopamina do cérebro faça atualizações maiores e mais informativas a partir de cada resultado. As descobertas pedem uma reavaliação de como modelamos o aprendizado no cérebro e sugerem que, em muitas situações, espaçar as experiências de forma mais inteligente pode ser tão importante quanto, ou mais importante do que, praticar com mais frequência.

Citação: Burke, D.A., Taylor, A., Jeong, H. et al. Duration between rewards controls the rate of behavioral and dopaminergic learning. Nat Neurosci 29, 825–839 (2026). https://doi.org/10.1038/s41593-026-02206-2

Palavras-chave: dopamina, aprendizado por recompensa, efeito do espaçamento, condicionamento associativo, aprendizado por reforço