Clear Sky Science · pl

Czas między nagrodami kontroluje tempo uczenia się zachowania i aktywności dopaminergicznej

Dlaczego tempo nagród ma znaczenie

Nauczyciele przestrzegają przed przygotowywaniem się na ostatnią chwilę, a treserzy zwierząt rozkładają smakołyki w czasie — ale dlaczego przerwy pomagają nam się uczyć? To badanie stawia zaskakująco proste pytanie o dalekosiężnych implikacjach: gdy próbujesz nauczyć się, że sygnał zapowiada nagrodę, czy lepiej dostawać wiele szybkich nagród, czy mniej nagród rozłożonych w czasie? Poprzez precyzyjne dawkowanie kropli słodkiej wody myszom i równoczesne mierzenie ich zachowania oraz chemii mózgu, naukowcy odkryli matematyczną zasadę pokazującą, że to czas między nagrodami, a nie sama liczba prób, kontroluje szybkość uczenia się.

Uczenie się przy mniejszej liczbie, ale lepiej rozłożonych smakołyków

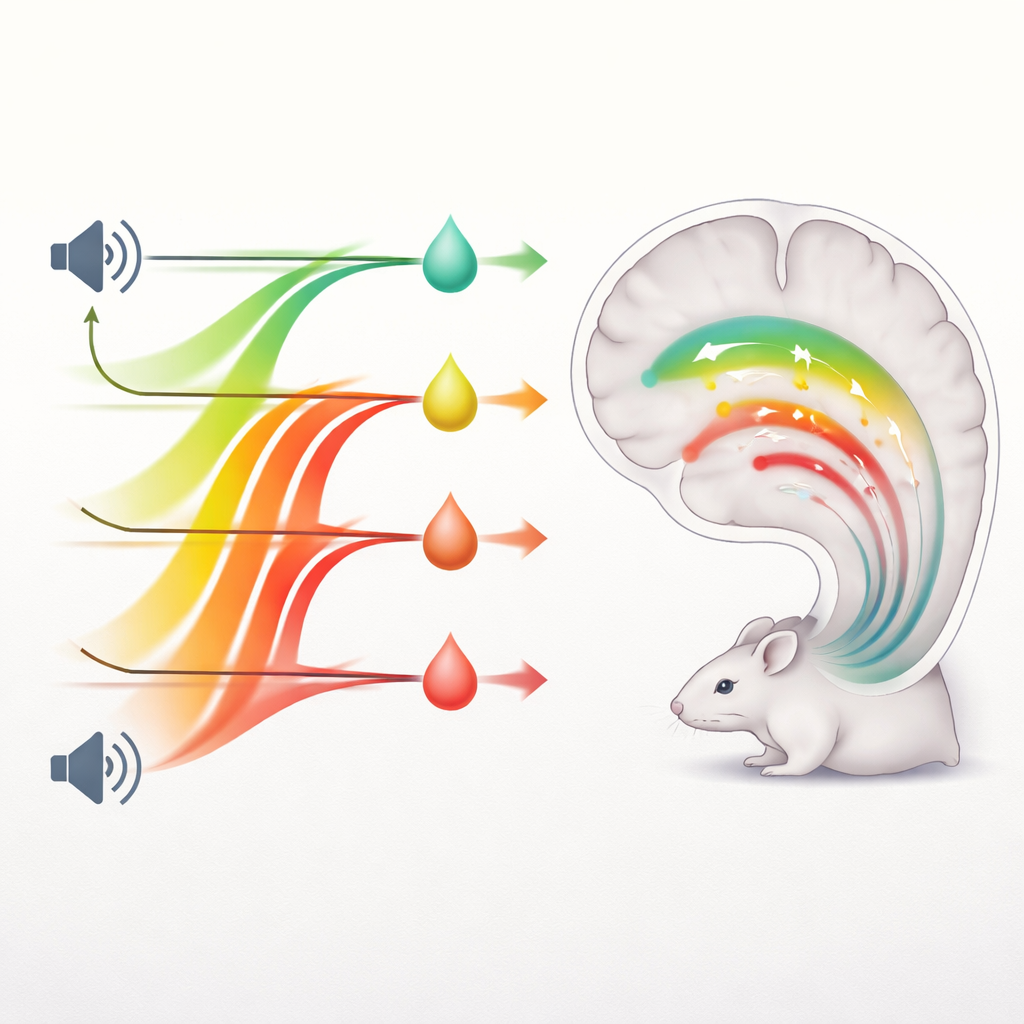

Zespół szkolił spragnione, unieruchomione głowowo myszy, by kojarzyły krótki ton z maleńkim łykiem słodkiego płynu. Wszystkie myszy słyszały ten sam dźwięk i otrzymywały tę samą nagrodę wkrótce potem, ale czas do następnego cyklu ton–nagroda różnił się dramatycznie — od pół minuty do dziesięciu minut, a w jednej grupie do godziny. Myszy z krótkimi przerwami doświadczały wiele połączeń sygnału i nagrody dziennie, podczas gdy te z długimi przerwami przechodziły ich tylko kilka. Intuicyjnie można by oczekiwać, że „zajęty” harmonogram przyspieszy naukę. Zamiast tego wydarzyło się odwrotnie: gdy odstępy były dziesięć razy dłuższe, myszy potrzebowały około dziesięć razy mniej doświadczeń sygnału i nagrody, żeby wywnioskować skojarzenie.

To samo nauczenie się w tym samym czasie, niezależnie od liczby prób

Chociaż myszy z rozłożonymi w czasie sesjami potrzebowały znacznie mniej doświadczeń, w rzeczywistym czasie nie uczyły się szybciej. Gdy badacze policzyli, ile minut kondycjonowania upłynęło, zanim każda mysz zaczęła konsekwentnie lizać w oczekiwaniu na nagrodę, całkowity czas potrzebny na naukę był niemal identyczny w grupach, których przerwy różniły się dwudziestokrotnie. Innymi słowy, wydłużenie odstępu między nagrodami sprawiało, że każde pojedyncze doświadczenie było bardziej skuteczne dla uczenia się, wprost proporcjonalnie do czasu oczekiwania. Usunięcie dziewięciu na dziesięć prób z gęstego harmonogramu treningu praktycznie nie wpływało na to, jak długo zajęło wykształcenie skojarzenia, o ile całkowity upływ czasu w warunkach treningowych pozostał taki sam.

Sygnały dopaminowe podążają tą samą regułą

Aby zobaczyć, co działo się w mózgu, naukowcy użyli fluorescencyjnego sensora do śledzenia dopaminy — przenosiciela chemicznego od dawna uważanego za sygnalizującego błąd predykcji nagrody, czyli różnicę między oczekiwaną a rzeczywistą nagrodą. W miarę postępów treningu krótkie skoki dopaminy stopniowo przemieszczały się z samej nagrody na dźwięk zapowiadający. Co kluczowe, te odpowiedzi dopaminowe wykazywały tę samą regułę czasową co zachowanie: gdy nagrody były rozłożone dziesięć razy rzadziej, skok dopaminy na skutek sygnału pojawiał się po około jednej dziesiątej liczby par sygnał–nagroda, lecz po mniej więcej tym samym upływie czasu zegarowego. Wzorzec ten utrzymywał się nie tylko dla przyjemnych nagród, lecz także gdy ton przewidywał łagodne wstrząsy, co sugeruje, że zarówno pozytywne, jak i negatywne uczenie podlegają tej samej regule opartej na czasie.

Nowy sposób, w jaki mózg oblicza przyczynowość

Klasyczne teorie przedstawiają uczenie się jako proces próbny-po-próbie, w którym każde doświadczenie przesuwa wewnętrzną wartość w górę lub w dół o pewien stały ułamek. W tych „modelach opartych na próbach” widok większej liczby par sygnału i wyniku w danym okresie powinien zawsze przyspieszać naukę. Nowe wyniki podważają tę ideę i zamiast tego wspierają inną ramę teoretyczną, nazwaną ANCCR, w której mózg aktualizuje swoje przekonania tylko wtedy, gdy faktycznie wystąpi wynik, a następnie działa wstecz w czasie, by przypisać zasługę wcześniejszym sygnałom. Ponieważ te aktualizacje są wyzwalane przy każdej nagrodzie, model przewiduje, że zmiana przypadająca na jedną nagrodę powinna rosnąć wprost proporcjonalnie do czasu, jaki upłynął od poprzedniej nagrody. To matematycznie wyjaśnia, dlaczego dłuższe przerwy między nagrodami sprawiają, że każde doświadczenie ma większe znaczenie, przy jednoczesnym pozostawieniu całkowitego uczenia się po ustalonym czasie bez zmian.

Ponowne przemyślenie „ćwiczenie czyni mistrza”

Pokazując, że to czas między nagrodami — a nie sama liczba prób — rządzi tempem zarówno behawioralnego, jak i dopaminergicznego uczenia się, praca ta podważa powszechne założenie, że więcej powtórzeń automatycznie oznacza szybsze uczenie się. Dla prostych skojarzeń między sygnałami a wynikami dodawanie kolejnych prób może przynosić niewielkie korzyści, jeśli nagrody następują zbyt blisko siebie. Zamiast tego dobrze dobrane odstępy pozwalają układowi dopaminowemu mózgu dokonywać większych, bardziej informacyjnych aktualizacji po każdym wyniku. Odkrycia te wskazują na potrzebę przewartościowania sposobu modelowania uczenia się w mózgu i sugerują, że w wielu sytuacjach mądrzejsze rozłożenie doświadczeń może być równie ważne, a czasem ważniejsze, niż częstsze ćwiczenie.

Cytowanie: Burke, D.A., Taylor, A., Jeong, H. et al. Duration between rewards controls the rate of behavioral and dopaminergic learning. Nat Neurosci 29, 825–839 (2026). https://doi.org/10.1038/s41593-026-02206-2

Słowa kluczowe: dopamina, uczenie się przez nagrody, efekt odstępów, warunkowanie asocjacyjne, uczenie się przez wzmocnienie