Clear Sky Science · pl

Badanie wydajności i kluczowych czynników wdrożeń w świecie rzeczywistym klasyfikacji obrazów ziaren przy użyciu splotowych sieci neuronowych

Dlaczego inteligentniejsze kontrole ziaren mają znaczenie

Każdy bochenek chleba zaczyna się od maleńkiego ziarna pszenicy. Zapewnienie, że te ziarna są zdrowe i wolne od ukrytych uszkodzeń, ma kluczowe znaczenie dla jakości żywności, uczciwości wycen i ograniczania strat w całym łańcuchu dostaw ziaren. Obecnie wiele takich kontroli wciąż wykonuje się wzrokowo, co jest powolne, męczące i może różnić się w zależności od inspektora. W tym badaniu analizujemy, jak nowoczesna, oparta na obrazach sztuczna inteligencja może wiarygodnie odróżniać zdrowe od uszkodzonych ziaren pszenicy w warunkach rzeczywistych oraz co jest potrzebne, by zaufać takim systemom poza laboratorium.

Od ręcznej inspekcji do maszynowego spojrzenia

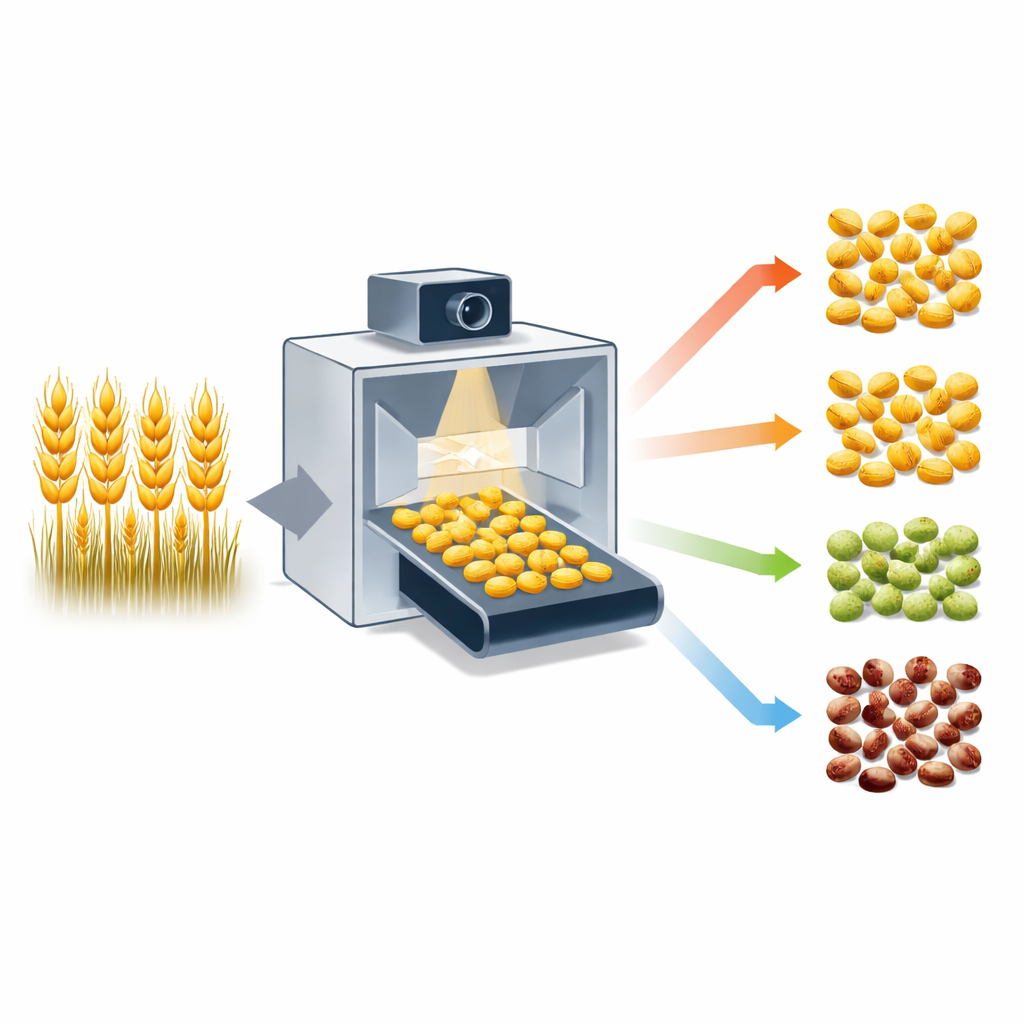

Tradycyjnie eksperci oceniają pszenicę, wizualnie badając próbki masowe i wyszukując defektów, takich jak pleśń, uszkodzenia przez owady czy połamane ziarna. Artykuł koncentruje się na zautomatyzowanym systemie obrazowania, który fotografuje pojedyncze ziarna przy użyciu luster i wysokorozdzielczych kamer, rejestrując ponad 90% powierzchni każdego ziarna. Obrazy te trafiają następnie do modeli uczenia głębokiego zwanych splotowymi sieciami neuronowymi (CNN), które potrafią nauczyć się rozpoznawać wzorce związane z problemami jakościowymi bez ręcznie konstruowanych reguł. Autorzy pytają nie tylko, czy CNN potrafią klasyfikować ziarna, ale jak niezawodnie działają w obliczu złożonych, rzeczywistych danych.

Test trzech zaawansowanych modeli

Naukowcy zgromadzili ponad 200 000 oznakowanych obrazów pojedynczych ziaren pszenicy, podzielonych na osiem kategorii, takich jak zdrowe, spleśniałe, wykiełkowane czy uszkodzone przez owady. Porównali trzy popularne architektury CNN — MobileNetV2, EfficientNetV2B0 i ResNet50V2 — trenując je na większości obrazów i wykorzystując oddzielne zbiory zdjęć wykonanych w innych terminach jako dane testowe. W sumie dwa większe modele, ResNet50V2 i EfficientNetV2B0, osiągnęły ponad 96% dokładności, podczas gdy lżejszy MobileNetV2 wypadł nieco gorzej i był mniej stabilny między uruchomieniami. Jednak analizując każdą klasę osobno, badacze stwierdzili, że rzadkie typy defektów, jak niektóre infekcje grzybicze, były znacznie trudniejsze do prawidłowej klasyfikacji niż liczne zdrowe ziarna.

Dlaczego równowaga danych i oczyszczanie obrazów mają znaczenie

Aby sprawdzić odporność systemu, autorzy modyfikowali sposób podziału danych na zbiory treningowe i testowe oraz powtarzali treningi z różnymi losowymi ziarniami (seedami). Wyniki pogarszały się, gdy zbiór testowy pochodził z punktu czasowego, który wyglądał nieco inaczej niż dane treningowe, szczególnie w przypadku rzadkich lub wizualnie niejednoznacznych defektów. Analizując błędnie sklasyfikowane ziarna za pomocą interaktywnych map wizualnych, odkryli, że część pomyłek wynikała z niepewnych etykiet ludzkich oraz z ziaren, które realistycznie należały do więcej niż jednej kategorii. Testowali też, czy wbudowane przetwarzanie obrazu — segmentacja ziaren od tła, korekcja kolorów i zmniejszanie rozdzielczości — rzeczywiście pomaga. Ku zaskoczeniu, obrazy wstępnie przetworzone i skalowane (256×256 pikseli) wypadały ogólnie tak samo dobrze jak surowe obrazy w wysokiej rozdzielczości, a w przypadku kilku typów defektów nawet lepiej, choć niektóre rzadkie klasy wciąż korzystały z większej ilości szczegółów.

Projektowanie systemów do zastosowań w świecie rzeczywistym

Wyniki wskazują na kilka kluczowych składników godnej zaufania inspekcji ziaren przez AI. Po pierwsze, istotne jest posiadanie wystarczającej liczby reprezentatywnych przykładów każdego typu defektu; gdy niektóre defekty są rzadkie lub etykietowane niekonsekwentnie, nawet potężne modele mają trudności. Po drugie, przetwarzanie wstępne, które standaryzuje oświetlenie i izoluje ziarna, zwykle zwiększa wydajność i stabilność, ale wiąże się z kompromisem: pewne subtelne defekty wymagają dodatkowych szczegółów zachowanych w obrazach o wyższej rozdzielczości. Autorzy sugerują, że łączenie informacji z obrazów wstępnie przetworzonych i pełnej rozdzielczości, albo fuzja wielu modeli, może dodatkowo poprawić niezawodność, zwłaszcza w trudnych przypadkach, gdy uszkodzenia nachodzą na siebie między kategoriami.

Co to oznacza dla przyszłego sortowania ziaren

Mówiąc prościej, badanie pokazuje, że AI może już dorównać lub przewyższyć ludzką inspekcję ziaren pszenicy, pod warunkiem że jest trenowana na odpowiednich danych i starannie oceniana. Najlepiej działające modele były dokładne i spójne ogólnie, ale ujawniły słabe punkty tam, gdzie rzadkie lub mylące defekty oraz niedoskonałe etykiety ograniczają niezawodność. Poprzez podkreślenie roli równowagi danych, inteligentnego oczyszczania obrazów i testowania uwzględniającego klasy, praca wytycza plan działania, jak przekształcić uczenie głębokie z obiecującego narzędzia laboratoryjnego w niezawodnego partnera na podłodze silosu zbożowego, pomagając rolnikom, młynom i producentom żywności podejmować szybsze, bardziej obiektywne decyzje dotyczące jakości.

Cytowanie: Kumari, R., Persson, J., Eklöf, V.E. et al. Investigating performance and key factors for real-world deployment of grain image classification using convolutional neural networks. Sci Rep 16, 12357 (2026). https://doi.org/10.1038/s41598-026-45314-6

Słowa kluczowe: jakość ziaren pszenicy, inspekcja oparta na obrazach, uczenie głębokie, splotowe sieci neuronowe, automatyczne sortowanie ziaren