Clear Sky Science · pl

Niskokosztowe, tolerancyjne na błędy obliczenia kwantowe poprzez uogólnianie operatorów logicznych

Utrzymywanie uczciwości komputerów kwantowych

Przyszłe komputery kwantowe obiecują rozwiązywać problemy, które dziś stawiają w zakłopotanie superkomputery, jednak są również wyjątkowo kruchymi urządzeniami: drobne zakłócenia mogą zniszczyć ich obliczenia. Artykuł ten przedstawia nowy sposób utrzymywania wielkich obliczeń kwantowych na właściwym torze, używając znacznie mniejszej liczby dodatkowych kubitów niż dotychczas uważano za konieczne, przybliżając tym samym praktyczne, odporne na błędy maszyny kwantowe do realności.

Dlaczego kubity potrzebują ochrony

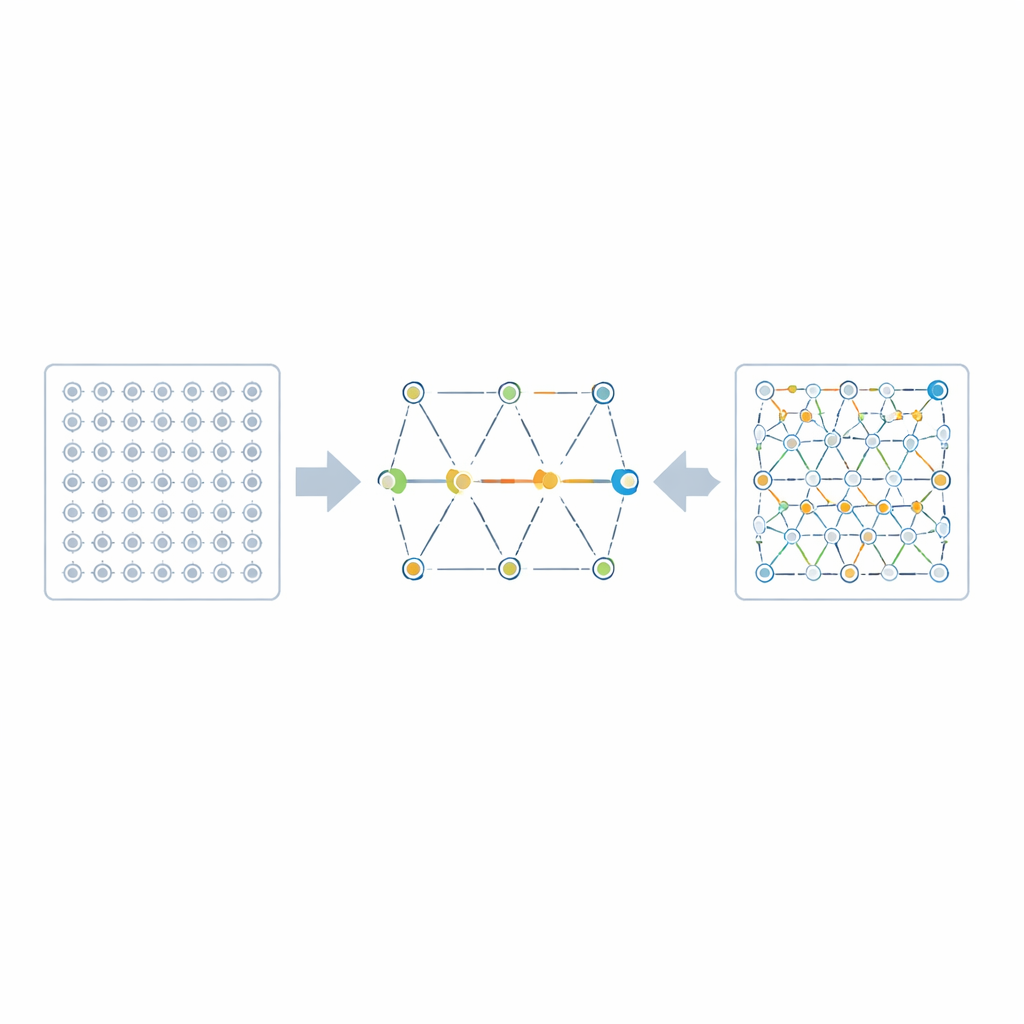

Kubity (qubity) mogą przechowywać informacje w delikatnych superpozycjach, które łatwo zaburzyć przez otoczenie. Aby je chronić, badacze grupują wiele fizycznych kubitów w pojedynczy kubit logiczny przy użyciu kwantowych kodów korekcyjnych. Potężną klasą takich kodów są kwantowe kody niskiej gęstości parzystości (qLDPC), które potrafią chronić wiele kubitów logicznych, używając relatywnie niewielu kubitów fizycznych i tylko rzadkich połączeń między nimi. Jednak chociaż kody te świetnie nadają się do przechowywania informacji kwantowej, wykonywanie operacji logicznych potrzebnych do pełnoprawnych obliczeń często wymagało dużych dodatkowych „pomocniczych” systemów, co erodowało ich przewagę wydajnościową.

Pomiary bez łamania kodu

Wiele algorytmów kwantowych można zrealizować, jeśli potrafimy wiarygodnie mierzyć pewne zbiorcze właściwości — operatory logiczne — zakodowanych kubitów. Robienie tego niedbale może uszkodzić ochronny kod lub wymagać ogromnej liczby dodatkowych kubitów. Autorzy rozwiązują to wyzwanie, reinterpretując operator logiczny jako pewien rodzaj symetrii systemu, koncept zapożyczony z fizyki. Zamiast mierzyć globalną wielkość bezpośrednio, wprowadzają sieć prostych, lokalnych pomiarów, których skumulowane wyniki ujawniają tę samą informację. Pomysł ten, znany jako „ugauging” (gauging symetrii), ma długą historię w teoriach materii i oddziaływań, lecz tutaj zostaje przekształcony w praktyczne narzędzie dla obliczeń kwantowych.

Przekształcanie globalnego pytania w lokalne kontrole

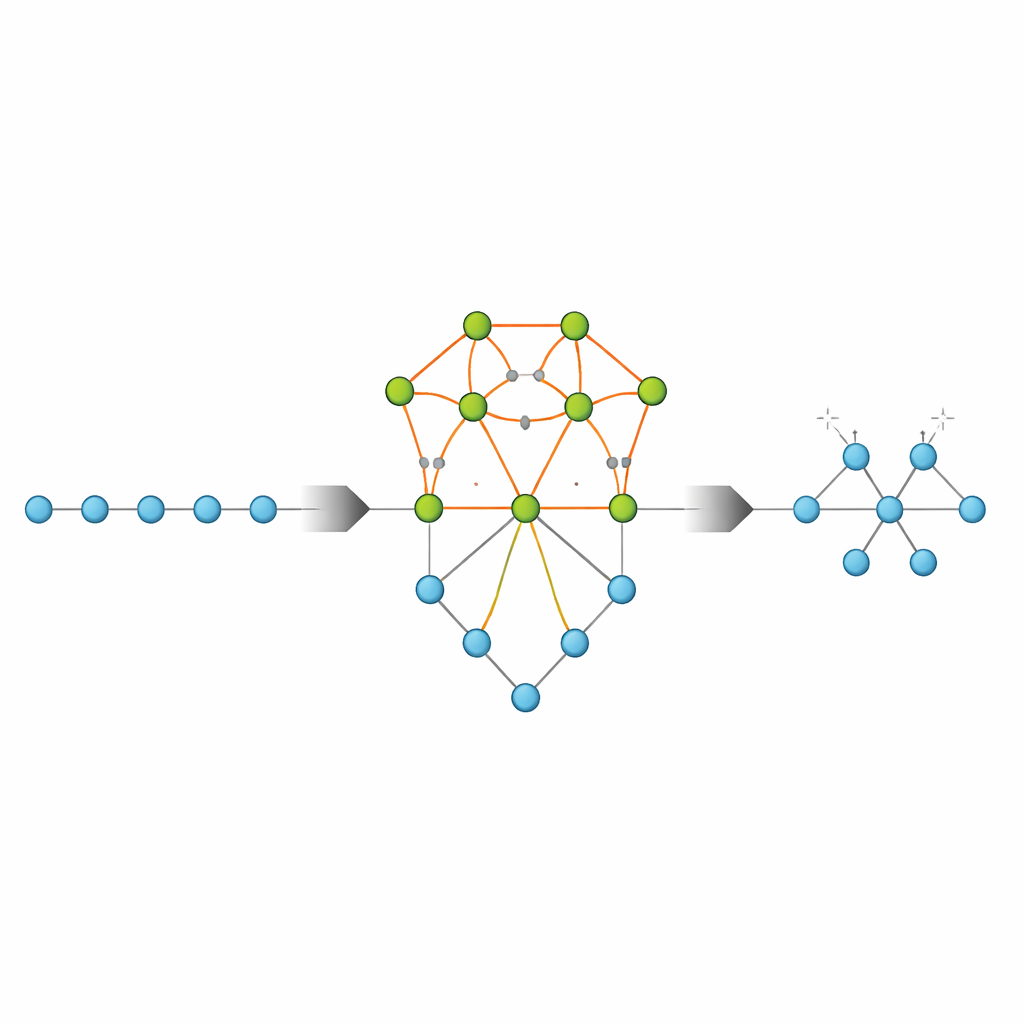

Trzon metody polega na dołączeniu pomocniczego grafu — sieci dodatkowych kubitów — do grupy kubitów zaangażowanych w operator logiczny. Każde krawędź tego grafu mieści nowy kubit, a przeprowadza się proste, lokalne testy obejmujące jeden kubit danych i sąsiednie kubity krawędziowe. Testy te egzekwują reguły przypominające prawo Gaussa w elektromagnetyzmie, wiążąc zachowanie kubitów wokół każdego wierzchołka. Choć każdy pojedynczy wynik może wyglądać losowo, ich iloczyn koduje wartość pierwotnego operatora logicznego. Po tym „zgaugowaniu” pomocnicze kubity są delikatnie usuwane przez kolejne pomiary — proces zwany „odgauge’owaniem” (ungauging) — co przywraca system do postaci równoważnej oryginalnemu kodowi.

Projektowanie efektywnych sieci pomocniczych

Nie każdy pomocniczy graf działa równie dobrze. Aby utrzymać niskie współczynniki błędów i umiarkowane narzuty, sieć musi pozostać rzadka, zachować dobrą odległość ochronną i unikać tworzenia zbyt złożonych pętli. Autorzy identyfikują jasne zasady projektowe gwarantujące te właściwości i pokazują, jak systematycznie konstruować odpowiednie grafy dla dowolnego operatora logicznego. Korzystając z narzędzi współczesnej teorii grafów i topologii, w tym tzw. grafów ekspanderowych oraz procesu zwanego decongestion, dowodzą, że liczba dodatkowych kubitów potrzebnych do pomiaru skaluje się zasadniczo liniowo z liczbą kubitów objętych operatorem logicznym, z umiarkowanymi czynnikami polilogarytmicznymi. To dramatyczna poprawa w porównaniu z wcześniejszymi podejściami, gdzie narzut mógł rosnąć szybciej niż rozmiar samego kodowanego układu.

Tolerancja błędów w przestrzeni i czasie

Rzeczywiste urządzenia cierpią nie tylko z powodu błędów kubitów, lecz także wadliwych pomiarów. Autorzy analizują, jak ich procedura gaugingu zachowuje się przy takich niedoskonałościach, traktując całą sekwencję lokalnych operacji w przestrzeni i czasie jako większy „kod przestrzenno‑czasowy”. Pokazują, że pod warunkiem wyboru pomocniczego grafu zgodnie z ich regułami i wystarczającej liczby powtórzeń odpowiednich sprawdzeń, ogólny schemat zachowuje ten sam poziom ochrony co oryginalny kod qLDPC. Innymi słowy, sam pomiar logiczny staje się tolerancyjny na błędy, odporny zarówno na fizyczne uszkodzenia kubitów, jak i na błędnie zgłoszone wyniki, bez dramatycznego zwiększania liczby kubitów ani czasu trwania protokołu.

Co to znaczy dla przyszłych maszyn kwantowych

Dla czytelnika nietechnicznego kluczowe przesłanie jest takie, że autorzy znaleźli sposób, by zadawać globalne pytanie dotyczące wielu kubitów — niezbędne do uruchamiania algorytmów kwantowych — poprzez sprytne ułożenie serii lokalnych, łatwych do wdrożenia kontroli, które nie przeciążają sprzętu. Ich ramy integrują i uogólniają kilka wcześniejszych technik „code surgery” oraz oferują jasny przepis na rozszerzenie ich na nowe rodziny kodów kwantowych. Jeśli zostaną dopracowane i zintegrowane z praktycznymi dekoderami, podejście oparte na gaugingu może stać się standardowym elementem budowy dużych, odpornych na błędy procesorów kwantowych, pozwalając na wykonywanie potężnych obliczeń przy zasobach sprzętowych realistycznie dostępnych.

Cytowanie: Williamson, D.J., Yoder, T.J. Low-overhead fault-tolerant quantum computation by gauging logical operators. Nat. Phys. 22, 598–603 (2026). https://doi.org/10.1038/s41567-026-03220-8

Słowa kluczowe: tolerancyjne na błędy obliczenia kwantowe, korekcja błędów kwantowych, kwantowe kody LDPC, pomiary logiczne, operacje na kodach (code surgery)