Clear Sky Science · de

Fehlertolerante Quantenberechnung mit geringem Overhead durch Verschaltung logischer Operatoren

Quantencomputer ehrlich halten

Zukünftige Quantencomputer versprechen, Probleme zu lösen, an denen heutige Supercomputer scheitern, sind aber zugleich extrem empfindlich: kleinste Störungen können ihre Berechnungen durcheinanderbringen. Dieses Papier stellt eine neue Methode vor, um große Quantenberechnungen mit weniger zusätzlichen Qubits als bisher für nötig gehalten zu stabilisieren, und rückt praktisch nutzbare, fehlertolerante Quantenmaschinen näher an die Realität.

Warum Qubits Schutz brauchen

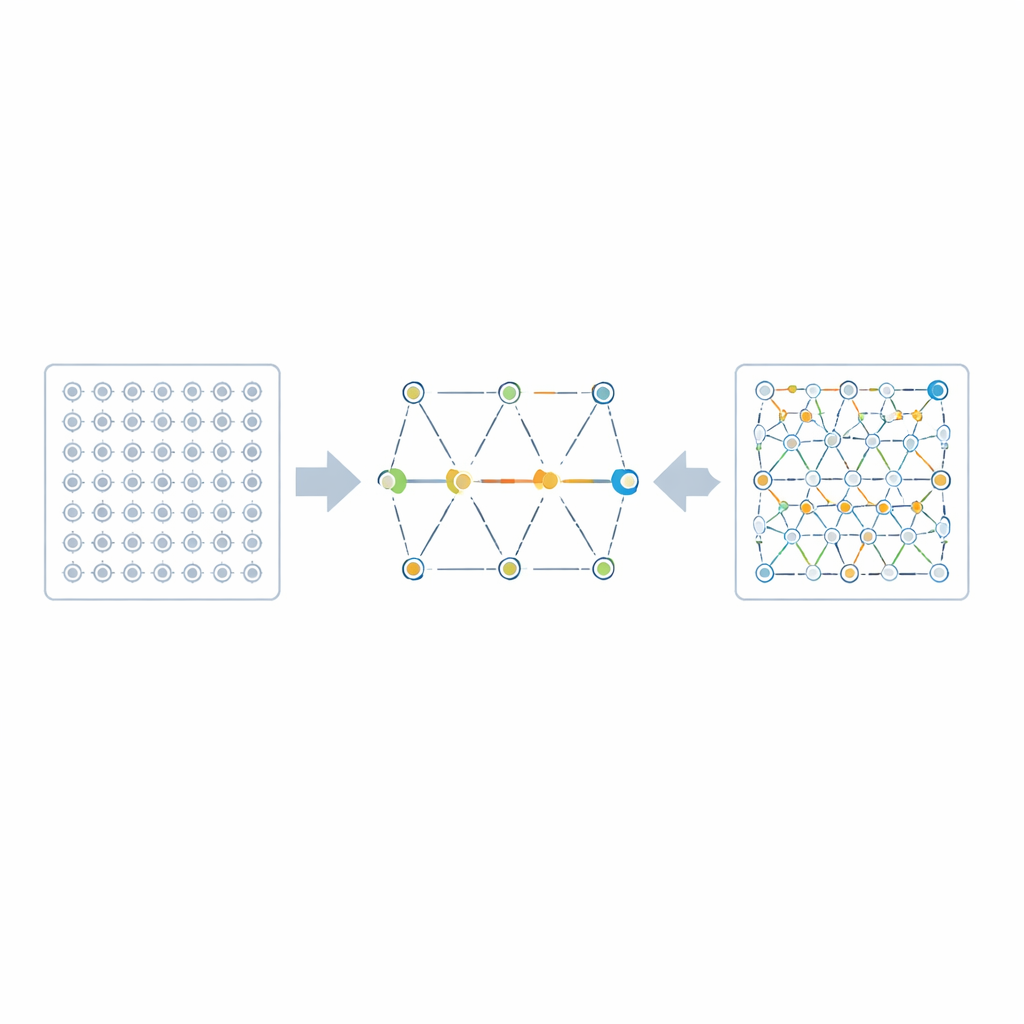

Quantenbits, oder Qubits, speichern Information in empfindlichen Superpositionen, die leicht durch die Umgebung gestört werden. Um sie zu schützen, fassen Forschende viele physische Qubits zu einem logischen Qubit zusammen, indem sie Quantenfehlerkorrekturcodes verwenden. Eine leistungsfähige Klasse solcher Codes, sogenannte quantitative Low‑Density‑Parity‑Check‑(qLDPC‑)Codes, kann viele logische Qubits mit vergleichsweise wenigen physischen Qubits und nur spärlichen Verbindungen schützen. Zwar eignen sich diese Codes hervorragend zur Speicherung quanteninformation, doch das Ausführen der logischen Operationen für groß angelegte Berechnungen erforderte bislang oft große zusätzliche „Hilfs“-Systeme, die ihren Effizienzvorteil wieder schmälern.

Messen, ohne den Code zu zerstören

Eine globale Frage in lokale Prüfungen verwandeln

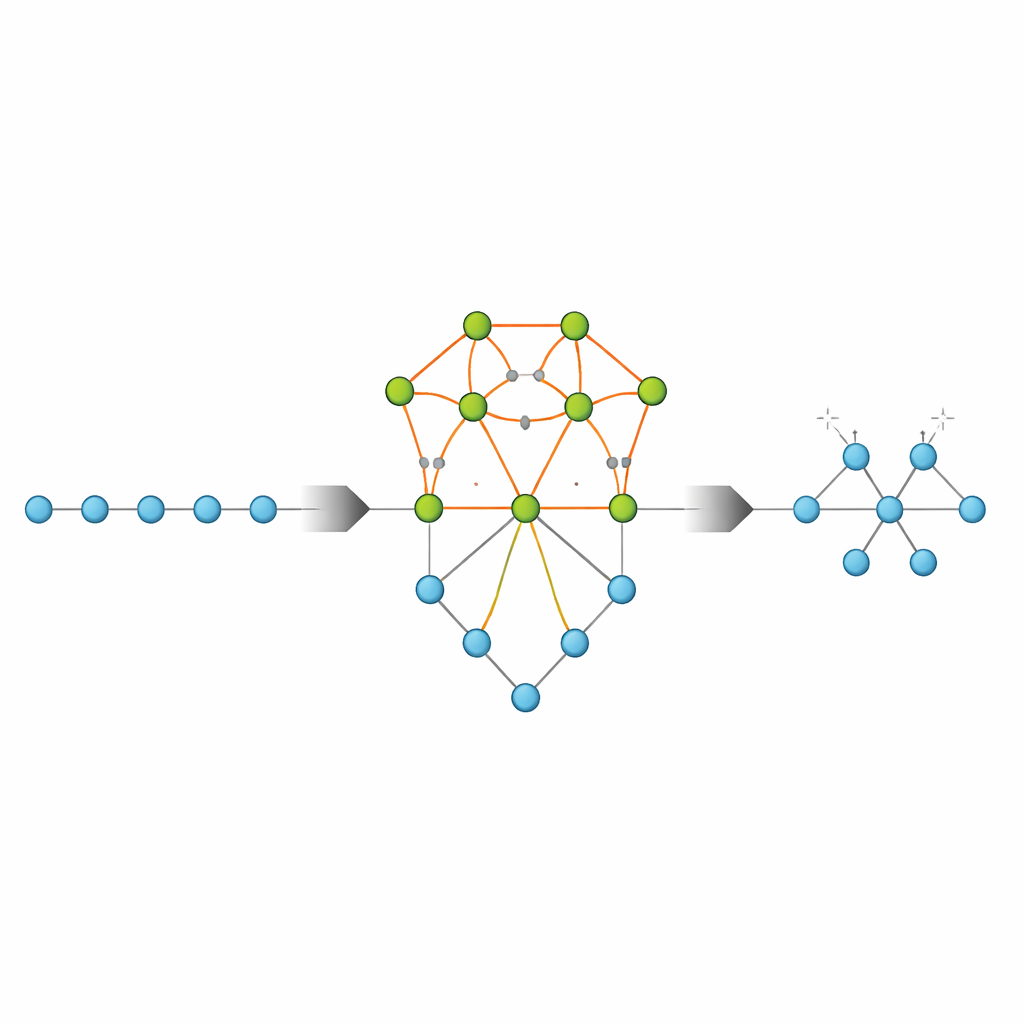

Der Kern der Methode besteht darin, dem QuBit‑Verbund, der vom logischen Operator betroffen ist, ein Hilfsgraph — ein Netzwerk zusätzlicher Qubits — anzuhängen. Jede Kante dieses Graphen trägt ein neues Qubit, und es werden einfache lokale Prüfungen durchgeführt, die ein Daten‑Qubit und benachbarte Kantenqubits einbeziehen. Diese Prüfungen erzwingen Regeln, die an die Gauss’sche Gesetzmäßigkeit der Elektromagnetismus‑Formulierungen erinnern und das Verhalten der Qubits um jeden Knoten herum verbinden. Obwohl jedes einzelne Messergebnis zufällig erscheint, codiert ihr Produkt den Wert des ursprünglichen logischen Operators. Nach dieser „gauged Messung“ werden die Hilfsqubits selbst durch weitere Messungen schonend entfernt — ein Prozess, der als „ungauging“ bezeichnet wird und das System in eine dem ursprünglichen Code äquivalente Form zurückführt.

Effiziente Hilfsnetzwerke entwerfen

Nicht jeder Hilfsgraph funktioniert gleich gut. Um die Fehlerraten niedrig und den Overhead moderat zu halten, muss das Netzwerk sparsam bleiben, eine gute Schutzdistanz erhalten und das Entstehen zu komplizierter Schleifen vermeiden. Die Autor*innen identifizieren klare Gestaltungsregeln, die diese Eigenschaften garantieren, und zeigen, wie sich geeignete Graphen systematisch für jeden logischen Operator konstruieren lassen. Mit Werkzeugen aus der modernen Graphentheorie und Topologie, einschließlich so genannter Expander‑Graphen und eines Verfahrens namens Decongestion, beweisen sie, dass die Anzahl zusätzlicher Qubits im Wesentlichen linear mit der Anzahl der vom logischen Operator berührten Qubits skaliert — zuzüglich bescheidener polylogarithmischer Faktoren. Das ist eine dramatische Verbesserung gegenüber früheren Ansätzen, bei denen der Overhead schneller wachsen konnte als die Größe des kodierten Systems selbst.

Fehlertoleranz in Raum und Zeit

Reale Geräte leiden nicht nur unter Qubit‑Fehlern, sondern auch unter fehlerhaften Messungen. Die Autor*innen analysieren, wie ihr Gauging‑Verfahren unter solchen Unvollkommenheiten arbeitet, indem sie die gesamte Abfolge von raum‑ und zeitlokalen Operationen als einen größeren „Raumzeit‑Code“ betrachten. Sie zeigen, dass, sofern der Hilfsgraph nach ihren Regeln gewählt wird und die relevanten Prüfungen ausreichend oft wiederholt werden, das Gesamtschema denselben Schutzgrad wie der ursprüngliche qLDPC‑Code beibehält. Mit anderen Worten: Die logische Messung selbst wird fehlertolerant und widersteht sowohl physischen Fehlern an Qubits als auch falsch gemeldeten Ergebnissen, ohne die Zahl der Qubits oder die Dauer des Protokolls dramatisch zu erhöhen.

Was das für künftige Quantenmaschinen bedeutet

Für Nicht‑Spezialist*innen lautet die Kernbotschaft, dass die Autor*innen einen Weg gefunden haben, eine globale Frage über viele Qubits — entscheidend für die Ausführung von Quantenalgorithmen — zu stellen, indem sie geschickt eine Reihe lokaler, leicht implementierbarer Prüfungen anordnen, die die Hardware nicht überlasten. Ihr Rahmenwerk vereinheitlicht und verallgemeinert mehrere frühere „Code‑Chirurgie“-Techniken und bietet ein klares Rezept, um diese auf neue Familien von Quantencodes auszuweiten. Wenn diese Methode weiter verfeinert und mit praktischen Decodern integriert wird, könnte der gauging‑basierte Ansatz zum Standardbaustein großer, fehlertoleranter Quantenprozessoren werden und leistungsfähige Berechnungen mit realistisch verfügbaren Hardware‑Ressourcen ermöglichen.

Zitation: Williamson, D.J., Yoder, T.J. Low-overhead fault-tolerant quantum computation by gauging logical operators. Nat. Phys. 22, 598–603 (2026). https://doi.org/10.1038/s41567-026-03220-8

Schlüsselwörter: fehlertolerante Quantenberechnung, Quantenfehlerkorrektur, quantum LDPC Codes, logische Messungen, Code‑Chirurgie