Clear Sky Science · nl

Multimodale benadering op basis van graph attention-netwerken voor de classificatie van longaandoeningen

Waarom slimmer longonderzoek ertoe doet

Longziekten behoren wereldwijd tot de belangrijkste doodsoorzaken, maar veel daarvan zijn behandelbaar als ze vroeg worden ontdekt. Artsen baseren zich doorgaans op thoraxfoto’s en geschreven aantekeningen over de symptomen van een patiënt om vast te stellen wat er aan de hand is. Het handmatig lezen van al deze informatie is traag en foutgevoelig, vooral wanneer verschillende ziekten op de scan vergelijkbaar lijken of dezelfde hoest en koorts veroorzaken. Deze studie introduceert een kunstmatig-intelligent systeem dat ontworpen is om röntgenfoto’s en klinische tekst samen te lezen, en zo hulpverleners te helpen verschillende soorten longaandoeningen nauwkeuriger en consistenter te herkennen.

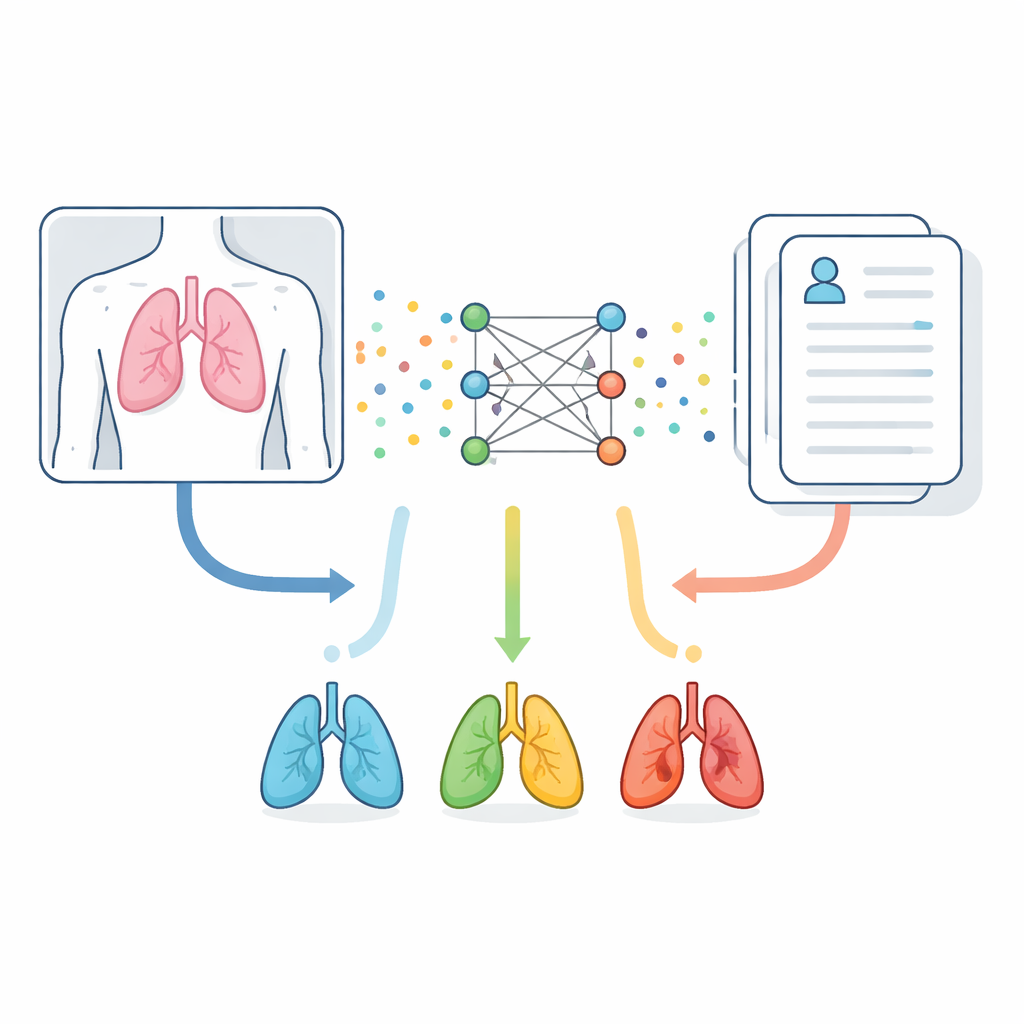

Gelijktijdig zien en lezen

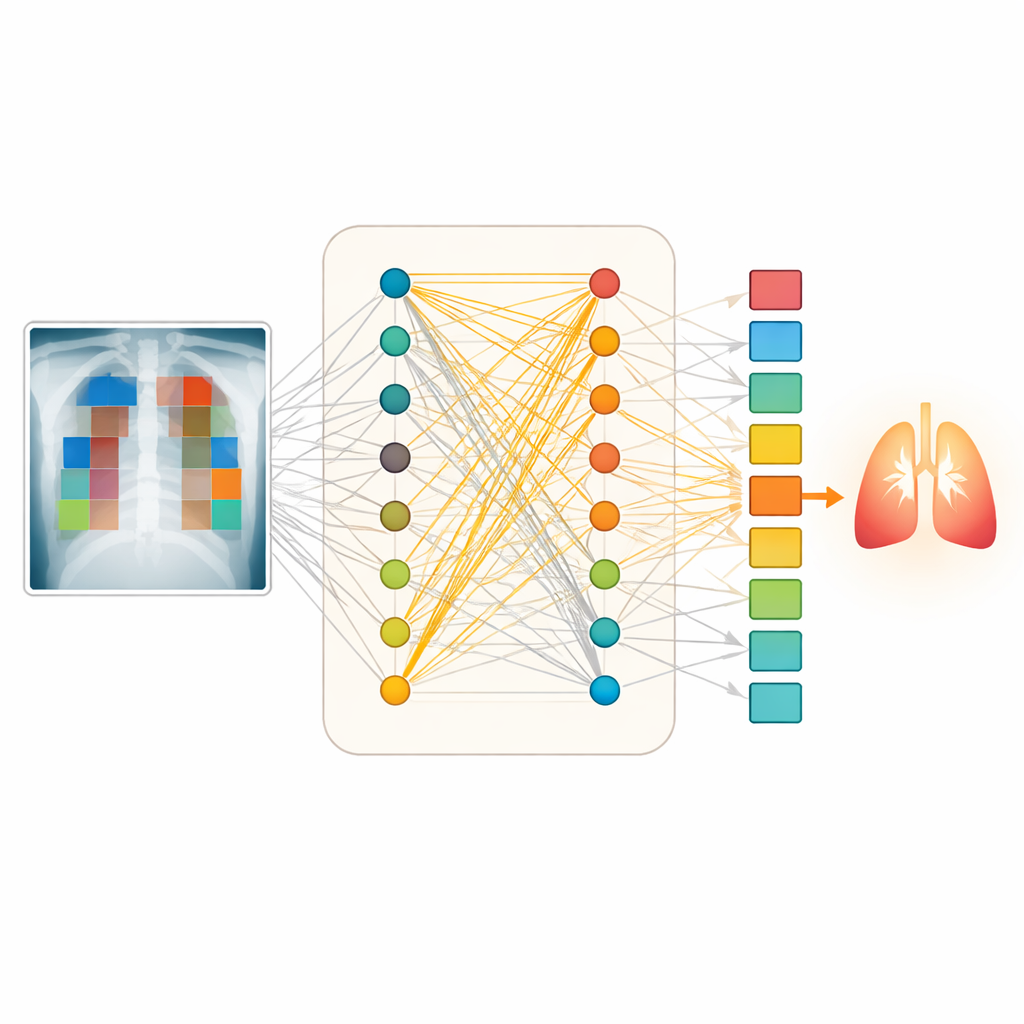

De onderzoekers vertrekken van een eenvoudig idee: het verhaal van het lichaam wordt zowel in beelden als in woorden verteld. Thoraxfoto’s tonen vormen, schaduwen en dichtheden in de borstkas, terwijl klinische aantekeningen klachten vermelden zoals kortademigheid of pijn op de borst. In plaats van deze als afzonderlijke aanwijzingen te behandelen, verweeft het nieuwe systeem ze. Het gebruikt een visiemodel dat specifiek op medische beelden is getraind om elke röntgenfoto om te zetten in veel kleine numerieke onderdelen die visuele patronen vastleggen. Parallel daaraan zet een taalmodel, afgestemd op medische teksten, elk woord in de klinische beschrijving om in een eigen numerieke representatie. Samen vormen deze twee stromen van getallen een gedeeld beeld van wat er in de longen van een patiënt gebeurt.

Het bouwen van een netwerk van verbindingen

Het simpel stapelen van beeld- en tekstinformatie mist vaak subtiele verbanden, zoals een kleine bewolkte regio op een röntgenfoto die alleen relevant is wanneer in de aantekening een recente infectie wordt genoemd. Om dit aan te pakken, representeren de auteurs de gecombineerde data als een grafiek — een netwerk van punten en verbindingen. Elk punt correspondeert met een specifiek gebied op de röntgenfoto of met een specifiek woord in de klinische tekst. Het systeem meet vervolgens hoe sterk elk beeldgebied relatie heeft met elk woord en houdt alleen de sterkste relaties over. Dat levert een sparse maar betekenisvol netwerk op dat bijvoorbeeld een heldere vlek nabij de longrand koppelt aan een vermelding van pijn op de borst of vocht.

Aandacht als leidraad voor de diagnose

Wanneer dit netwerk eenmaal is opgebouwd, wordt het verwerkt door een graph attention-model. In deze opzet ‘‘kijkt’’ elk punt in de grafiek naar zijn buren en bepaalt het hoeveel gewicht het aan hen geeft, vergelijkbaar met een arts die zich richt op de meest relevante combinatie van scankenmerken en symptomen. Meerdere attention-‘heads’ onderzoeken parallel verschillende patronen, waardoor uiteenlopende manieren waarop tekst en beeld elkaar kunnen ondersteunen worden vastgelegd. Het model verzamelt vervolgens de meest informatieve signalen uit de hele grafiek en voert die samen naar een laatste beslissingslaag die voorspelt welke van de acht longaandoeningen — of een normaal beeld — het meest waarschijnlijk is voor die casus.

Het systeem op de proef stellen

Het team trainde en evalueerde hun methode op een grote openbare dataset met ongeveer 80.000 thoraxfoto’s gekoppeld aan korte klinische beschrijvingen, ingedeeld in acht categorieën van longziekten plus normale longen. Ze splitsten en schoonden de data zorgvuldig om te voorkomen dat bijna-identieke gevallen tussen training en testen zouden lekken. Op niet eerder geziene testbeelden en -teksten classificeerde hun aanpak de longaandoeningen in ongeveer 96 van de 100 gevallen correct, waarmee ze meerdere sterke concurrenten overtroffen die data grover samenvoegden of eenvoudiger graph-methoden gebruikten. Het systeem leverde ook zeer betrouwbare kansscores, wat betekent dat het vertrouwen goed overeenkwam met hoe vaak het gelijk had. Toen het getest werd op een dataset van een ander ziekenhuis met andere ziektefrequenties, daalde de prestatie — zoals verwacht — maar het systeem onderscheidde nog steeds aandoeningen goed, wat wijst op nuttige robuustheid in de echte wereld.

Wat dit betekent voor patiënten en artsen

In praktische termen toont dit werk dat een AI-systeem kan leren zowel het beeld als het verslag samen te ‘‘lezen’’, vergelijkbaar met een ervaren radioloog die de scan in het licht van het verhaal van de patiënt bekijkt. Door zich te richten op de meest betekenisvolle koppelingen tussen beeldgebieden en specifieke symptomen kan het model gemiste of onjuiste diagnoses verminderen en onzekere gevallen markeren voor nader onderzoek. Hoewel verdere tests in echte klinieken nodig zijn, vooral met rijkere en meer gevarieerde rapporten, wijst de studie op ondersteunende beslissingshulpmiddelen die de diagnose van longziekten in ziekenhuizen zonder expertradiologen sneller, consistenter en toegankelijker zouden kunnen maken.

Bronvermelding: Rahman, M., YongZhong, C. & Bin, L. Graph attention network-based multimodal approach for lung diseases classification. Sci Rep 16, 10914 (2026). https://doi.org/10.1038/s41598-026-44282-1

Trefwoorden: diagnose van longziekten, thoraxfoto, medische AI, multimodaal leren, graph neural networks