Clear Sky Science · nl

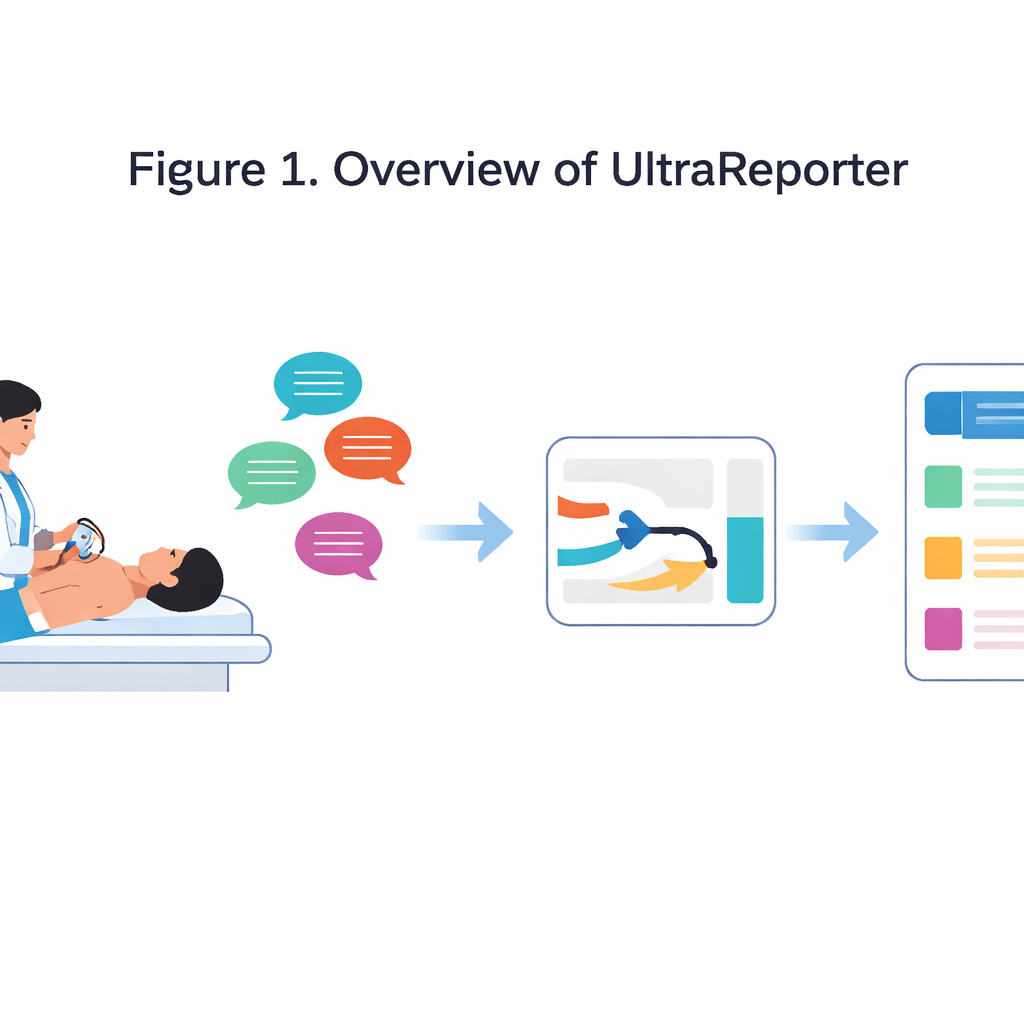

UltraReporter voor het omzetten van gesproken diagnostische aanwijzingen naar gestructureerde echografieverslagen met grote taalmodellen

Van praten naar tijdsbesparing

Wanneer artsen een echografie uitvoeren, moeten ze twee veeleisende taken combineren: zorgvuldig de patiënt scannen en tegelijkertijd haastig typen of klikken om een gedetailleerd verslag op te stellen. Dit papierwerk kan langer duren dan de scan zelf en is gevoelig voor vermoeidheid en kleine maar belangrijke fouten. De studie introduceert UltraReporter, een kunstmatig-intelligentiesysteem dat luistert naar de korte zinnen die artsen al tijdens het onderzoek uitspreken en deze automatisch in ongeveer één seconde omzet in een verzorgd, gestructureerd verslag. Voor patiënten betekent dit snellere consulten en consistentere documentatie; voor zorgverleners biedt het een manier om tijd terug te winnen en burn-out te verminderen.

Een nieuwe hulp in de echokamer

In veel ziekenhuizen is echografie het werkpaard onder de beeldvormingsmiddelen, gebruikt voor de lever, galblaas, nieren, schildklier en andere organen. De snelheid en veiligheid hebben ervoor gezorgd dat het aantal onderzoeken zo hoog is geworden dat sonografen en radiologen onder grote rapportagedruk staan. Traditioneel hebben pogingen om rapportage te automatiseren ofwel lange gedicteerde alinea’s getranscribeerd of geprobeerd beelden direct te interpreteren. Beide benaderingen hebben moeite in echte klinische omgevingen: volledige dictaten kosten nog steeds minuten en moeten worden bewerkt, terwijl systemen die alleen op beelden werken vaak rumoerige echobeelden verkeerd lezen. UltraReporter past zich daarentegen aan bij wat artsen al doen. Terwijl zij scannen, roepen ze van nature korte aanwijzingen zoals “levercyste, één komma twee bij één komma één.” UltraReporter luistert, zet die gesproken aanwijzingen om naar tekst en breidt ze vervolgens uit tot een volledig verslag in sjabloonstijl dat kan worden gecontroleerd en ondertekend.

Gegevens creëren uit dunne lucht

Het ontwerpen van zo’n systeem stuit op een belangrijk probleem: er bestaan vrijwel geen koppels van echte gesproken aanwijzingen gekoppeld aan eindige echorapporten. De onderzoekers losten dit op met een multi-agent AI-pijplijn die effectief realistische trainingsdata vervaardigt uit bestaande tekstverslagen. Een AI-“cue-simulator” leert volledige verslagen terug te brengen tot korte, artsachtige bullet-achtige zinnen. Een tweede AI-“report-generator” leert zulke aanwijzingen weer uit te breiden tot goed gestructureerde narratieven. Een derde “kwaliteitevaluator” beoordeelt elk synthetisch paar op nauwkeurigheid, volledigheid, duidelijkheid en andere factoren, en verwijdert alles dat niet voldoet. Dit proces leverde meer dan 21.000 hoogwaardige cue–verslag-paren op die honderden lichaamslocaties en duizenden aandoeningen omvatten, en gaf het systeem een rijke basis zonder extra handmatige annotatie te vereisen.

Het systeem in ziekenhuisgewoonten leren

Naast algemene medische kennis moeten realistische rapporten lokale gewoonten volgen: vertrouwde kopjes, favoriete uitdrukkingen en specifieke manieren om veelvoorkomende bevindingen te beschrijven. Om dit vast te leggen voegde het team een tweede trainingsfase toe, template-augmented fine-tuning genoemd. Hier leert UltraReporter niet alleen van aanwijzingen en verslagen, maar ook van een bibliotheek van bijna 200 echte institutionele sjablonen gekoppeld aan het betreffende orgaan en de aandoening. Dit stuurt het model richting standaardformuleringen en lay-out, wat de consistentie tussen patiënten en zorgverleners verbetert. Een laatste trainingsstap, defect-oriented preference optimization, leert het systeem zijn eigen subtiele fouten te herkennen en te corrigeren. Wanneer het model een meting verwart of een belangrijk detail weglaat, signaleert een andere AI het defect en creëert trainingsvoorbeelden die expliciet de gecorrigeerde versie prefereren, waardoor het klinische redeneren van het model wordt aangescherpt.

Van spraak naar verslag in één seconde

Om in een drukke onderzoekskamer te werken, moet het systeem rommelige, echte spraak aankunnen. De auteurs combineren een ruisbestendige spraakherkenner met een taalmodel dat is afgestemd op medische terminologie zodat uitdrukkingen als “poortader” niet als alledaagse woorden worden gehoord. De herkende aanwijzing wordt vervolgens doorgegeven aan het getrainde UltraReporter-model, dat vrijwel onmiddellijk een gestructureerd verslag genereert met bevindingen en indrukken. Veiligheid is ingebouwd: het systeem berekent hoe zeker het is over elk tekstgedeelte, vooral cijfers en diagnoses. Elk segment met lage zekerheid wordt in de interface van de arts gemarkeerd, zodat aandacht wordt gevestigd op onderdelen die een tweede blik verdienen. In lezerstudies beoordeelden onafhankelijke specialisten UltraReporter-verslagen vaak als gelijkwaardig aan of beter dan die door artsen geschreven, en in routinematig gebruik werden de meeste gegenereerde verslagen als gelijkwaardig beoordeeld aan de originelen.

Wat dit betekent voor patiënten en zorgverleners

UltraReporter toont aan dat een relatief compact taalmodel—veel kleiner dan veel koppenmakende systemen—expertprestatie kan evenaren of zelfs overtreffen voor een gericht, praktisch taakgebied wanneer het wordt gevoed met de juiste data en zorgvuldig wordt getraind. Door de korte zinnen die artsen al uitspreken om te zetten in complete, gestandaardiseerde rapporten, heeft het de potentie om documentatietijd tot seconden te reduceren zonder de controle aan zorgverleners te ontnemen. Voor patiënten kan dit meer face-to-face tijd en minder administratieve vertraging betekenen. Voor zorgsystemen biedt het een blauwdruk: gebruik multi-stap AI-kaders, geworteld in lokale sjablonen en menselijke supervisie, om alledaagse klinische routines op een veilige en schaalbare manier te transformeren.

Bronvermelding: Hao, P., Zhang, J., Zhang, S. et al. UltraReporter for transforming spoken diagnostic cues into structured ultrasound reports with large language models. Sci Rep 16, 13662 (2026). https://doi.org/10.1038/s41598-026-41439-w

Trefwoorden: echografieverslaggeving, medische AI, spraak-naar-verslag, klinische documentatie, grote taalmodellen