Clear Sky Science · es

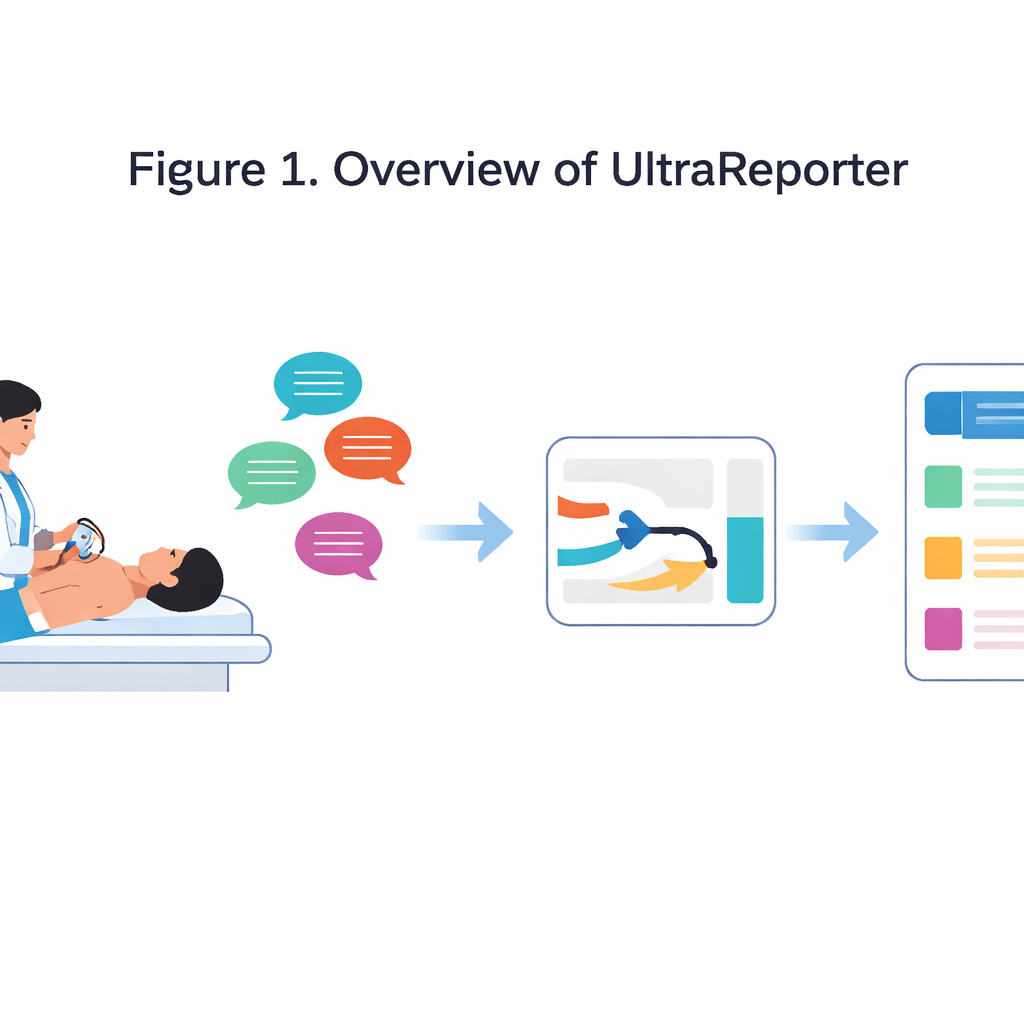

UltraReporter para transformar indicios diagnósticos hablados en informes ecográficos estructurados con modelos de lenguaje grande

Convertir la charla en tiempo ahorrado

Cuando los médicos realizan una ecografía, deben atender dos tareas exigentes a la vez: escanear al paciente con cuidado y, al mismo tiempo, teclear o hacer clic apresuradamente para completar un informe detallado. Esta labor administrativa puede llevar más tiempo que la propia exploración y es vulnerable al cansancio y a errores pequeños pero importantes. El estudio presenta UltraReporter, un sistema de inteligencia artificial que escucha las frases cortas que los médicos ya pronuncian durante el examen y las transforma automáticamente en un informe pulido y estructurado en aproximadamente un segundo. Para los pacientes, esto promete visitas más rápidas y documentación más consistente; para los clínicos, ofrece una forma de recuperar tiempo y reducir el agotamiento.

Un nuevo asistente en la sala de ecografía

En muchos hospitales, la ecografía es la herramienta de imagen más utilizada, aplicada en hígado, vesícula biliar, riñones, tiroides y otros órganos. Su rapidez y seguridad han incrementado tanto el volumen de exploraciones que los ecografistas y radiólogos sufren una fuerte presión de informes. Tradicionalmente, los intentos de automatizar los informes han transcrito largos dictados o han intentado interpretar directamente las imágenes. Ambos enfoques tienen dificultades en clínicas reales: el dictado completo sigue tomando minutos y requiere edición, mientras que los sistemas basados solo en imágenes a menudo interpretan mal ecoscopias ruidosas. UltraReporter, en cambio, se adapta a lo que los médicos ya hacen. Mientras escanean, suelen decir en voz alta indicios breves como “quiste hepático, uno punto dos por uno punto uno”. UltraReporter escucha, convierte esos indicios hablados en texto y luego los amplía hasta un informe completo, con formato de plantilla, que puede verificarse y firmarse.

Construir datos de la nada

Diseñar un sistema así enfrenta un problema clave: casi no existen pares reales de indicios hablados emparejados con informes ecográficos finales. Los investigadores resolvieron esto con una canalización de inteligencia artificial multiagente que, en la práctica, fabrica datos de entrenamiento realistas a partir de informes textuales existentes. Una IA “simuladora de indicios” aprende a reducir informes completos a frases breves tipo viñeta, propias de un médico. Una segunda IA “generadora de informes” aprende a expandir esos indicios de nuevo en narrativas bien estructuradas. Un tercer agente, el “evaluador de calidad”, puntúa cada par sintético en precisión, completitud, claridad y otros factores, descartando los que no alcanzan el umbral. Este proceso produjo más de 21.000 pares indicio–informe de alta calidad que abarcan cientos de sitios corporales y miles de enfermedades, proporcionando al sistema una base rica sin requerir anotación manual adicional.

Enseñar los hábitos del hospital al sistema

Más allá del conocimiento médico general, los informes del mundo real deben seguir hábitos locales: encabezados familiares, frases preferidas y formas específicas de describir hallazgos comunes. Para capturar esto, el equipo añadió una segunda etapa de entrenamiento llamada ajuste fino aumentado con plantillas. Aquí, UltraReporter aprende no solo de indicios e informes, sino también de una biblioteca de casi 200 plantillas institucionales reales emparejadas con el órgano y la enfermedad correspondientes. Esto orienta al modelo a usar un lenguaje y un diseño estándar, mejorando la consistencia entre pacientes y profesionales. Un paso final de entrenamiento, llamado optimización de preferencias orientada a defectos, enseña al sistema a detectar y corregir sus propios errores sutiles. Cuando el modelo confunde una medida u omite un detalle clave, otra IA señala el defecto y crea ejemplos de entrenamiento que prefieren explícitamente la versión corregida, afinando el razonamiento clínico del modelo.

De la voz al informe en un segundo

Para funcionar en una sala de exploración concurrida, el sistema debe manejar el habla real y desordenada. Los autores combinan un reconocedor de voz tolerante al ruido con un modelo de lenguaje afinado en chino médico para que frases como “vena porta” no se oigan como palabras cotidianas. El indicio reconocido se pasa luego al modelo UltraReporter entrenado, que genera un informe estructurado que cubre hallazgos e impresiones casi al instante. La seguridad está incorporada: el sistema calcula cuánta confianza tiene en cada fragmento de texto, especialmente números y diagnósticos. Cualquier segmento de baja confianza se resalta en la interfaz del médico, atrayendo la atención hacia puntos que merecen una segunda mirada. En estudios de lectura, especialistas independientes a menudo juzgaron los informes de UltraReporter como equivalentes o mejores que los redactados por médicos, y en uso rutinario la mayoría de los informes generados fueron valorados a la par con los originales.

Qué significa esto para pacientes y clínicos

UltraReporter demuestra que un modelo de lenguaje relativamente compacto—mucho más pequeño que muchos sistemas mediáticos—puede igualar o incluso superar el rendimiento de expertos en una tarea práctica y concreta cuando se le alimenta con los datos adecuados y se entrena con cuidado. Al convertir las frases breves que los médicos ya pronuncian en informes completos y estandarizados, tiene el potencial de reducir el tiempo de documentación a segundos sin quitar el control a los clínicos. Para los pacientes, esto podría traducirse en más tiempo presencial con el profesional y menos retrasos administrativos. Para los sistemas de salud, ofrece una hoja de ruta: usar marcos de IA en varios pasos, basados en plantillas locales y supervisión humana, para transformar las rutinas clínicas diarias de forma segura y escalable.

Cita: Hao, P., Zhang, J., Zhang, S. et al. UltraReporter for transforming spoken diagnostic cues into structured ultrasound reports with large language models. Sci Rep 16, 13662 (2026). https://doi.org/10.1038/s41598-026-41439-w

Palabras clave: informe ecográfico, IA médica, voz a informe, documentación clínica, modelos de lenguaje grande