Clear Sky Science · it

Confronto tra intelligenza artificiale e professionisti sanitari nell'analisi video chirurgica e interventistica: una revisione sistematica e meta-analisi

Occhi più intelligenti nella sala operatoria

Ogni anno, centinaia di milioni di persone vengono sottoposte a interventi e procedure minimamente invasive guidate da video—pensate a colonscopie, chirurgia a “porta” o piccole videocamere introdotte nei vasi sanguigni. In questi momenti, la capacità del medico di individuare segnali sottili sullo schermo può fare la differenza tra cogliere precocemente un cancro o non notarlo. Questo studio pone una domanda rilevante per qualsiasi paziente futuro: quando i video chirurgici e interventistici vengono analizzati, come si comportano i sistemi di intelligenza artificiale rispetto ai clinici umani e cosa succede quando i due lavorano insieme?

Portare ordine a un flusso di video chirurgici

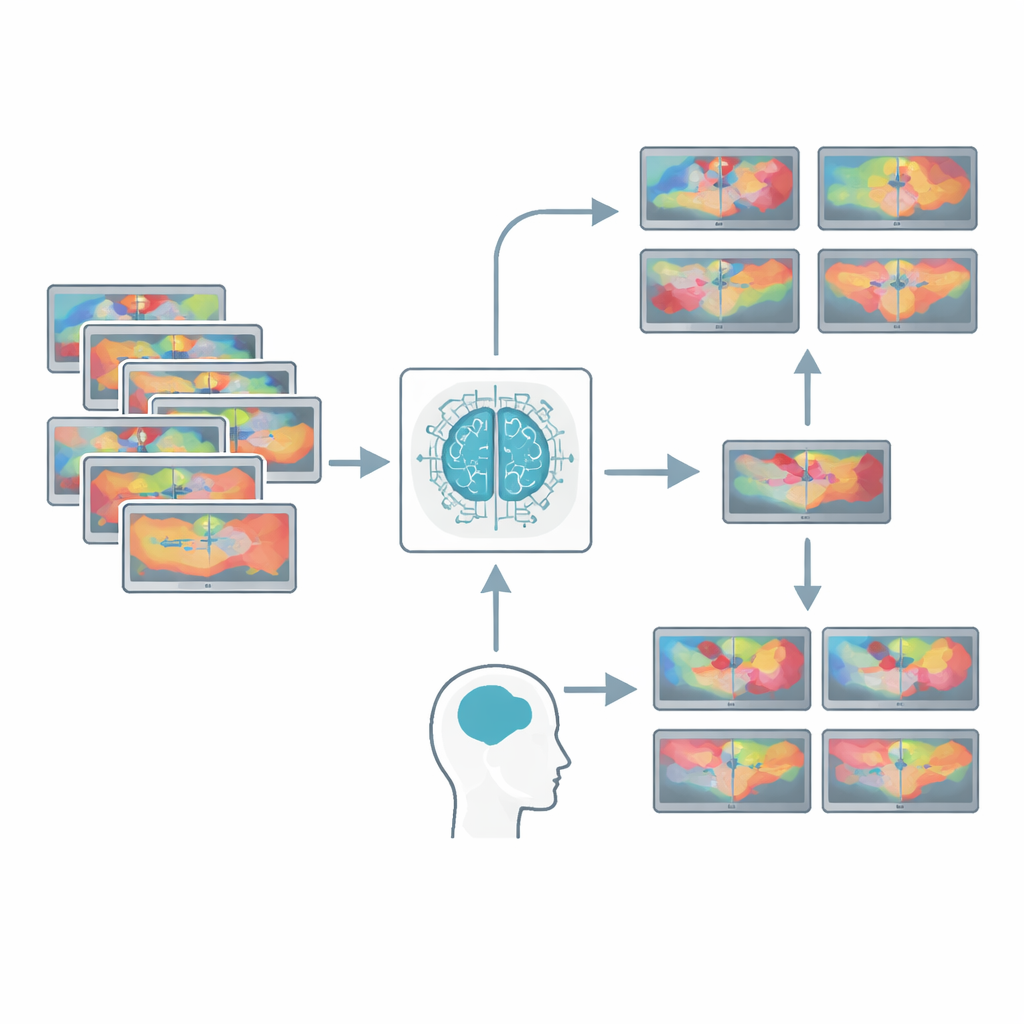

La medicina moderna registra ora un numero enorme di video procedurali, dalle endoscopie digestive agli interventi assistiti da robot. Queste registrazioni sono ricche di informazioni: piccoli polipi nel colon, tumori precoci nello stomaco o nell’esofago, nervi delicati da evitare o fasi di un’operazione complessa. I ricercatori hanno addestrato sistemi di AI per scandagliare queste immagini, segnalare aree sospette e persino riconoscere a che punto è il chirurgo in una procedura. Tuttavia, fino ad oggi, la maggior parte degli studi ha messo a confronto l’AI con i medici in gare testa a testa artificiali, invece di chiedere come la tecnologia potrebbe essere usata realisticamente—come assistente al fianco del clinico. Questa revisione si è proposta di raccogliere e analizzare in modo sistematico le evidenze sparse attraverso molte specialità.

Cosa hanno esaminato i ricercatori

Il gruppo ha cercato nei principali database medici e ingegneristici e ha iniziato con quasi 38.000 articoli. Dopo aver applicato criteri rigorosi—solo studi primari che utilizzavano AI su video chirurgici o interventistici reali e che confrontavano direttamente le prestazioni con quelle dei professionisti sanitari—sono rimasti soltanto 146 studi. Questi coprivano un ampio ventaglio di procedure, in particolare l’endoscopia gastrointestinale, ma anche interventi su polmoni, tiroide, cervello, cuore e apparato urinario. La maggior parte utilizzava metodi moderni di deep learning, come le reti neurali convoluzionali, addestrate a rilevare malattie, riconoscere l’anatomia, valutare la pulizia intestinale o identificare le fasi di un’operazione. Settantasei di questi studi riportavano dettagli sufficienti per permettere agli autori di aggregare i risultati e calcolare con quale frequenza AI e umani fossero corretti o sbagliassero.

AI da sola contro i medici, e l’AI come compagna di squadra

Quando i ricercatori hanno confrontato l’AI con clinici non assistiti che guardavano gli stessi video, i sistemi di AI in genere individuavano più problemi reali (maggiore sensibilità) senza causare più falsi allarmi (specificità simile). Questo andamento si è mantenuto sia quando i modelli sono stati testati su dati familiari sia quando hanno affrontato nuovi set di dati esterni. Tuttavia, la scoperta più rilevante dal punto di vista clinico è emersa quando l’AI è stata utilizzata come assistente. In una vasta gamma di compiti, i clinici che potevano vedere i suggerimenti dell’AI erano migliori nel trovare la malattia e meno propensi a classificare erroneamente tessuto normale rispetto a chi lavorava da solo. Questo miglioramento è stato particolarmente marcato per i non esperti, come i tirocinanti, che hanno beneficiato maggiormente della guida dell’AI. Per gli specialisti navigati, l’assistenza dell’AI e l’AI da sola hanno mostrato livelli di prestazione approssimativamente simili, suggerendo che in mani esperte la combinazione uomo–macchina può eguagliare i migliori algoritmi autonomi.

Fessure tra condizioni di laboratorio e vita reale

Nonostante questi numeri promettenti, la revisione mette in luce un divario tra come l’AI viene attualmente testata e come deve funzionare negli ambienti clinici reali. Molti studi hanno ripulito i dati rimuovendo fotogrammi sfocati o di bassa qualità, anche se le sale operatorie e le unità di endoscopia affrontano spesso proprio queste imperfezioni. Altri hanno analizzato istantanee isolate invece di video continui, evitando la sfida di seguire il movimento e la temporizzazione. Pochi studi hanno valutato l’AI in tempo reale al letto del paziente e la maggior parte si è basata su apparecchiature di fascia alta che potrebbero non essere disponibili negli ospedali con risorse limitate. Anche le pratiche di reporting sono risultate incoerenti: dettagli chiave su come i modelli sono stati sintonizzati e validati mancavano spesso, rendendo difficile per altri riprodurre o valutare equamente i risultati.

Costruire partnership uomo–AI affidabili

Gli autori sostengono che l’AI in chirurgia e medicina interventistica dovrebbe essere sviluppata e testata fin dall’inizio come partner per i clinici, non come sostituto. Ciò significa progettare studi che rispecchino le condizioni del mondo reale, condividere set di video diversi tra centri e adottare standard di rendicontazione chiari in modo che altri team possano verificare e migliorare il lavoro pubblicato. Significa anche formare i clinici a comprendere punti di forza e bias dell’AI, piuttosto che affidarsi ciecamente o respingere i suoi suggerimenti. Sebbene la meta-analisi mostri che l’AI può già eguagliare o superare le prestazioni umane non assistite in molte attività basate su video, il beneficio più significativo risiede nel modo in cui può affinare il giudizio umano. Per i pazienti, la conclusione non è che le macchine prenderanno il controllo della sala operatoria, ma che team uomo–AI progettati con cura potrebbero rendere le procedure più sicure, le diagnosi più precoci e gli esiti migliori.

Citazione: Rafati Fard, A., Williams, S.C., Smith, K.J. et al. Comparing artificial intelligence and healthcare professional performance in surgical and interventional video analysis: a systematic review and meta-analysis. npj Digit. Med. 9, 323 (2026). https://doi.org/10.1038/s41746-026-02401-2

Parole chiave: AI per video chirurgici, endoscopia assistita da computer, collaborazione uomo–AI, analisi di immagini mediche, supporto alle decisioni cliniche