Clear Sky Science · es

Comparación entre la inteligencia artificial y el desempeño de profesionales sanitarios en el análisis de vídeo quirúrgico e intervencionista: una revisión sistemática y metaanálisis

Ojos más inteligentes en el quirófano

Cada año, cientos de millones de personas se someten a operaciones y procedimientos mínimamente invasivos guiados por vídeo: piense en colonoscopias, cirugía por orificios o pequeñas cámaras introducidas en vasos sanguíneos. En esos momentos, la capacidad del médico para detectar señales sutiles en la pantalla puede marcar la diferencia entre detectar un cáncer a tiempo o pasarlo por alto. Este estudio plantea una pregunta que importa a cualquier paciente futuro: cuando se analizan vídeos quirúrgicos e intervencionistas, ¿qué tan bien rinden los sistemas de inteligencia artificial en comparación con los clínicos humanos, y qué ocurre cuando ambos trabajan juntos?

Poniendo orden en una avalancha de vídeo quirúrgico

La medicina moderna ahora registra un gran número de vídeos de procedimientos, desde endoscopias digestivas hasta operaciones asistidas por robot. Estas grabaciones están llenas de información: diminutos pólipos en el colon, tumores tempranos en estómago o esófago, nervios delicados que deben evitarse o pasos de una operación compleja. Los investigadores han entrenado sistemas de IA para escanear estas imágenes, señalar áreas sospechosas e incluso reconocer en qué punto del procedimiento se encuentra el cirujano. Sin embargo, hasta ahora la mayoría de los estudios enfrentaban a la IA contra médicos en comparaciones artificiales uno a uno, en lugar de preguntar cómo podría usarse la tecnología de forma realista—como un ayudante al lado del clínico. Esta revisión se propuso recopilar y analizar sistemáticamente esa evidencia dispersa en muchas especialidades.

Qué examinaron los investigadores

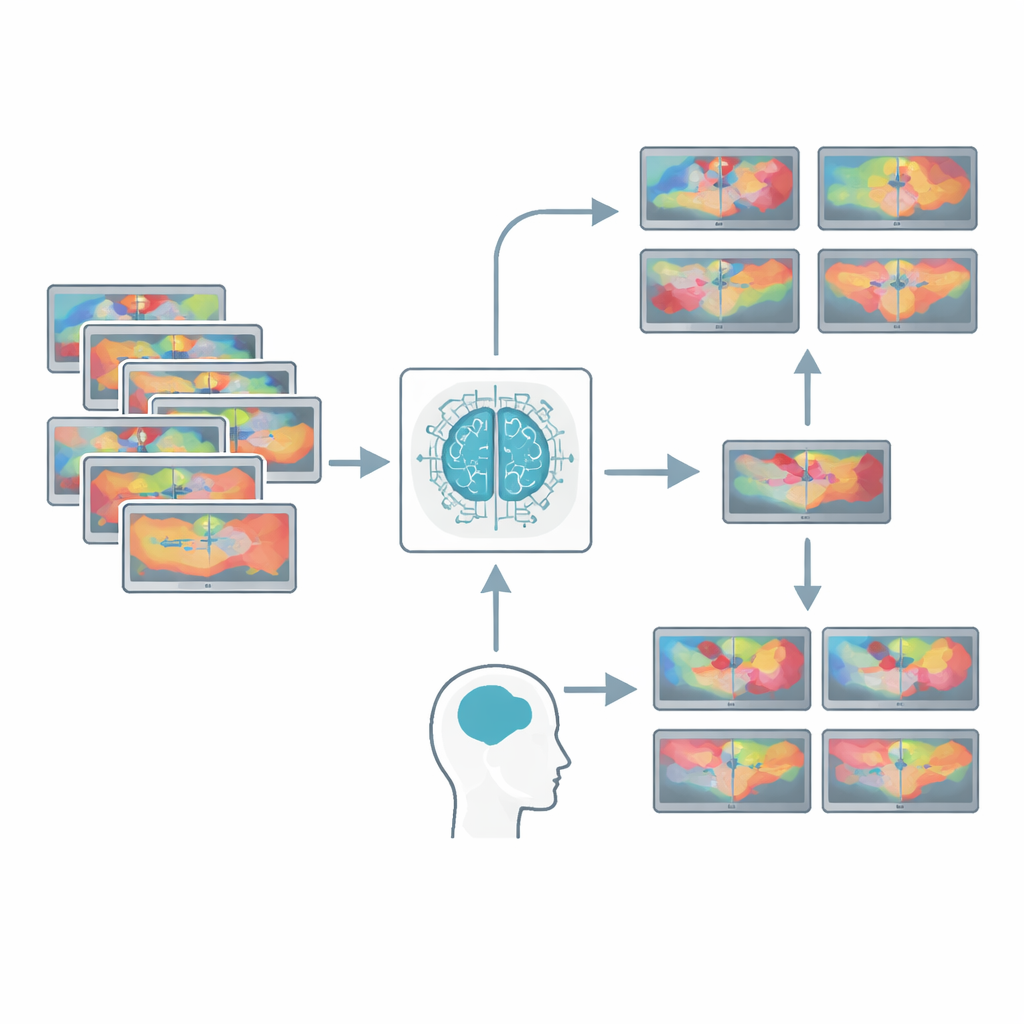

El equipo buscó en las principales bases de datos médicas y de ingeniería y partió de casi 38 000 artículos. Tras aplicar criterios estrictos—solo estudios primarios que usaran IA sobre vídeos quirúrgicos o intervencionistas reales y que compararan directamente su desempeño con el de profesionales sanitarios—solo quedaron 146 estudios. Estos abarcaron una amplia gama de procedimientos, especialmente endoscopia gastrointestinal, pero también intervenciones en pulmón, tiroides, cerebro, corazón y urología. La mayoría empleó métodos modernos de aprendizaje profundo, como redes neuronales convolucionales, entrenadas para detectar enfermedades, reconocer anatomía, valorar la limpieza intestinal o identificar pasos en una operación. Setenta y seis de estos estudios aportaron suficiente detalle para que los autores pudieran agrupar resultados y calcular con qué frecuencia la IA y los humanos acertaban o se equivocaban.

IA sola frente a médicos, y la IA como compañera

Cuando los investigadores compararon la IA con clínicos sin ayuda que miraban los mismos vídeos, los sistemas de IA en general detectaron más problemas reales (mayor sensibilidad) sin provocar más falsas alarmas (especificidad similar). Este patrón se mantuvo tanto cuando los modelos se evaluaron con datos conocidos como cuando se enfrentaron a conjuntos externos nuevos. Sin embargo, el hallazgo con mayor relevancia clínica surgió cuando la IA se usó como asistente. En una amplia variedad de tareas, los clínicos que podían ver las sugerencias de la IA mejoraron en la detección de enfermedades y tendieron menos a etiquetar erróneamente tejido normal en comparación con los que trabajaban solos. Este impulso fue especialmente notable entre los no expertos, como los residentes, que fueron los que más se beneficiaron de la guía de la IA. Para especialistas experimentados, la asistencia de la IA y la IA en solitario rindieron a niveles aproximadamente similares, lo que sugiere que en manos expertas la combinación humano–máquina puede igualar a los mejores algoritmos independientes.

Brechas entre condiciones de laboratorio y la vida real

A pesar de estos números prometedores, la revisión pone en evidencia una brecha entre cómo se prueba la IA actualmente y cómo debe funcionar en entornos clínicos reales. Muchos estudios limpiaron sus datos eliminando fotogramas borrosos o de baja calidad, aunque los quirófanos y las salas de endoscopia reales suelen lidiar exactamente con esas imperfecciones. Otros analizaron instantáneas aisladas en lugar de vídeo continuo, eludiendo el reto de seguir el movimiento y el tiempo. Pocos evaluaron la IA en tiempo real al lado de la cama, y la mayoría dependió de equipos de alta gama que pueden no estar disponibles en hospitales con recursos limitados. Las prácticas de reporte también fueron inconsistentes: con frecuencia faltaban detalles clave sobre cómo se ajustaron y validaron los modelos, lo que dificulta que otros reproduzcan o valoren de forma justa los resultados.

Construir asociaciones humano–IA de confianza

Los autores sostienen que la IA en cirugía y medicina intervencionista debería desarrollarse y probarse desde el principio como una socia de los clínicos, no como su reemplazo. Eso implica diseñar estudios que reflejen las condiciones del mundo real, compartir conjuntos de vídeo diversos entre centros y adoptar estándares claros de reporte para que otros equipos puedan verificar y mejorar el trabajo publicado. También supone formar a los clínicos para que comprendan las fortalezas y sesgos de la IA, en lugar de confiar ciegamente o descartar sus sugerencias. Aunque el metaanálisis muestra que la IA ya puede igualar o superar el rendimiento humano sin ayuda en muchas tareas basadas en vídeo, el beneficio más significativo radica en cómo puede agudizar el juicio humano. Para los pacientes, la conclusión no es que las máquinas ocuparán el quirófano, sino que equipos humano–IA diseñados con cuidado podrían hacer los procedimientos más seguros, las diagnósticos más tempranos y los resultados mejores.

Cita: Rafati Fard, A., Williams, S.C., Smith, K.J. et al. Comparing artificial intelligence and healthcare professional performance in surgical and interventional video analysis: a systematic review and meta-analysis. npj Digit. Med. 9, 323 (2026). https://doi.org/10.1038/s41746-026-02401-2

Palabras clave: IA en vídeo quirúrgico, endoscopia asistida por ordenador, colaboración humano–IA, análisis de imágenes médicas, soporte a la decisión clínica