Clear Sky Science · it

Inferenza mediante approssimazione saddlepoint per test basati sui ranghi in prove di sopravvivenza a k bracci con cluster

Perché questo conta per le prove nel mondo reale

Molti studi clinici moderni non si limitano più a registrare un singolo outcome semplice, come la pressione arteriosa in una visita. Segtono invece i pazienti nel tempo, combinano più misurazioni e spesso confrontano più trattamenti contemporaneamente. Quando i pazienti sono trattati in gruppi, come ospedali o cliniche, e gli esiti sono rapporti complessi o prodotti osservati nel tempo, gli strumenti statistici standard possono fornire risultati troppo fiduciosi e talvolta semplicemente errati. Questo articolo introduce un modo più accurato per analizzare tali studi, in modo che le affermazioni sui benefici o sui danni di un trattamento siano meno soggette a fuorviamento.

Studi condotti da gruppi, non da individui

In sanità pubblica e medicina, i ricercatori spesso randomizzano i trattamenti per cluster: intere cliniche, scuole o comunità vengono assegnate a diversi bracci dello studio e tutti gli individui all’interno del cluster ricevono lo stesso regime. Questo disegno è logisticamente vantaggioso e aiuta a prevenire la “contaminazione” tra trattamenti, ma crea una forte somiglianza familiare tra le persone nello stesso cluster—i loro esiti tendono a muoversi insieme. Allo stesso tempo, gli studi riassumono sempre più i cambiamenti di salute usando misure derivate, come il rapporto tra due valori di laboratorio o il prodotto cumulativo di misurazioni ripetute nel tempo. Quando i ricercatori confrontano più gruppi di trattamento usando questi esiti complessi e basati su gruppi, i soliti test basati sui ranghi che funzionano bene per campioni grandi e indipendenti possono fallire. In studi a cluster di piccole o medie dimensioni, l’abbreviazione comune che approssima la statistica di test con una curva chi-quadrato spesso aumenta i falsi positivi e produce intervalli di confidenza troppo stretti.

Trasformare misure complesse in “tempi” confrontabili

Il primo passo dell’autore è riesprimere gli esiti complicati in un linguaggio comune: dati tempo-all’evento. I rapporti, come un marcatore ematico diviso per un altro, sono trattati come il “tempo” necessario per raggiungere un rapporto critico; i prodotti di più misurazioni vengono ridotti a un unico valore combinato, spesso dopo una trasformazione logaritmica per stabilizzare la variabilità. Ciascun paziente è quindi riassunto dal momento in cui il valore derivato supera una soglia o da quanto a lungo è seguito senza che ciò avvenga, imitando l’analisi di sopravvivenza ordinaria. Poiché i pazienti risiedono all’interno di cluster, il metodo assegna a ciascun individuo un punteggio basato sui ranghi e pesato che tiene conto del censimento—quando il follow-up termina prima che l’evento si verifichi—e poi somma questi punteggi all’interno di ogni cluster. Il risultato è un numero di sintesi per cluster che cattura sia la tempistica degli eventi sia la correlazione tra le persone dello stesso gruppo. Da questi punteggi di cluster si costruisce quindi una statistica quadratica globale per confrontare tutti i bracci di trattamento insieme.

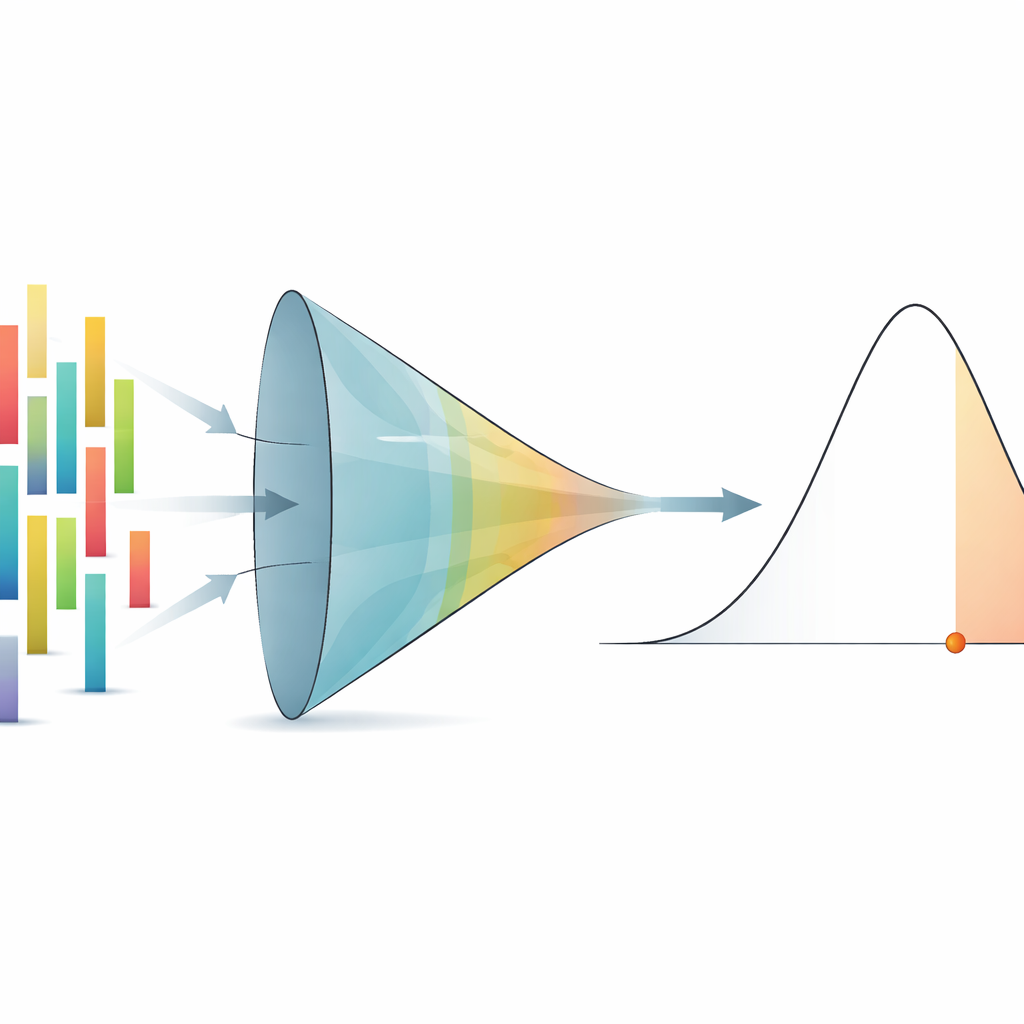

Una lente più nitida sulla variazione casuale

In linea di principio, il modo più corretto per valutare se una differenza osservata tra gruppi di trattamento sia sorprendente è considerare tutte le possibili assegnazioni dei cluster ai trattamenti secondo lo schema di randomizzazione effettivo e verificare quanto estrema risulterebbe la statistica di test su quell’insieme. Per studi a cluster che usano un’allocazione tipo urna—estrarre etichette di trattamento da un contenitore concettuale senza reinserimento—ciò significa esplorare un numero enorme di permutazioni. Elencarle esaustivamente è impossibile per studi realistici e simularle al computer migliaia di volte è costoso se ripetuto per molti test o per costruire intervalli di confidenza. L’articolo introduce un’approssimazione saddlepoint multivariata, una scorciatoia matematica che utilizza il comportamento completo della funzione generatrice della statistica di test, anziché solo la sua media e varianza, per imitare con grande accuratezza questa distribuzione di permutazione, anche nelle code estreme dove risiedono i p-value.

Mettere il metodo alla prova

Il nuovo quadro è sottoposto a severi test tramite ampie simulazioni che riproducono studi a cluster multi-braccio del mondo reale con numeri variabili di gruppi di trattamento, differenti dimensioni di cluster, diversi livelli di correlazione intra-cluster e sia censimento moderato che intenso. In 20 scenari impegnativi e su due famiglie di endpoint derivati—rapporti e prodotti—i p-value basati su saddlepoint corrispondono strettamente ai valori “quasi esatti” di riferimento ottenuti da un gran numero di permutazioni casuali. Al contrario, la familiare approssimazione chi-quadrato tende a rifiutare l’ipotesi nulla troppo spesso in contesti piccoli o altamente correlati, specialmente quando si confrontano molti gruppi di trattamento. Lo stesso schema emerge per gli intervalli di confidenza: quando costruiti invertendo il test saddlepoint, gli intervalli per gli effetti del trattamento coprono il valore vero al tasso dichiarato del 95%, mentre gli intervalli basati su chi-quadrato possono mancarlo troppo frequentemente, in particolare in disegni al limite dove le decisioni sono più sensibili.

Lezioni da studi clinici reali

Per mostrare cosa è in gioco nella pratica, l’autore applica il metodo a tre trial clinici multicentrici: uno studio sulla leucemia che misura la rapidità del recupero dei conteggi ematici, uno studio sulla malattia oculare legata all’età che monitora la perdita combinata della vista in entrambi gli occhi e un trial sulla parodontite che valuta la progressione della malattia gengivale all’interno della bocca. In due di questi casi, l’analisi standard che usa approssimazioni chi-quadrato dichiara un effetto di trattamento “statisticamente significativo” al livello convenzionale del 5%, potenzialmente inducendo conclusioni cliniche forti. Il metodo saddlepoint, insieme ai benchmark di permutazione quasi esatti, invece produce p-value leggermente più grandi e intervalli più ampi che includono il “nessun effetto”, indicando che le evidenze sono suggestive ma non decisive. In un grande studio oftalmologico ad alta potenza, tutti i metodi concordano che il trattamento è benefico, ma gli intervalli saddlepoint di nuovo evitano di sovrastimare la precisione, offrendo un quadro più onesto dell’incertezza.

Risposte più chiare dai dati complessi

Per i lettori non specialisti, il messaggio chiave è che non tutti gli strumenti statistici sono ugualmente affidabili quando gli studi diventano complessi e le dimensioni del campione sono limitate. Questo lavoro fornisce un modo coerente ed efficiente dal punto di vista computazionale per rispettare lo schema di randomizzazione reale degli studi a cluster e le complessità degli endpoint moderni senza ricorrere a forti simulazioni o a fragili scorciatoie asintotiche. Controllando in modo affidabile i falsi positivi e generando intervalli di confidenza che mantengono le loro promesse, il quadro saddlepoint aiuta a garantire che le conclusioni sulle nuove terapie—soprattutto in studi multicentrici più piccoli o finemente bilanciati—si basino sulle evidenze solide che i dati permettono, né più né meno.

Citazione: Newer, H.A. Saddlepoint inference for rank-based k-sample tests in clustered survival trials. Sci Rep 16, 11372 (2026). https://doi.org/10.1038/s41598-026-44064-9

Parole chiave: studi randomizzati a cluster, analisi di sopravvivenza, approssimazione saddlepoint, test di permutazione, inferenza in piccoli campioni