Clear Sky Science · de

Sattelpunkt-Inferenz für rangbasierte k-Stichproben-Tests in clusterbasierten Überlebensstudien

Warum das für reale Studien wichtig ist

Viele moderne klinische Studien erfassen nicht mehr nur einen einfachen Endpunkt wie den Blutdruck bei einer einzigen Visite. Stattdessen werden Patienten über die Zeit beobachtet, mehrere Messungen zusammengeführt und oft mehrere Behandlungen gleichzeitig verglichen. Wenn Patienten in Gruppen behandelt werden, etwa in Krankenhäusern oder Kliniken, und die Endpunkte komplexe Verhältnisse oder Produkte über die Zeit sind, können Standard-Statistikmethoden zu optimistische oder sogar falsche Ergebnisse liefern. Dieser Beitrag stellt eine genauere Methode vor, um solche Studien zu analysieren, sodass Aussagen über Nutzen oder Schaden einer Behandlung weniger irreführend werden.

Studien, die von Gruppen gesteuert werden, nicht von Einzelpersonen

In öffentlicher Gesundheit und Medizin werden Behandlungen häufig auf Cluster-Ebene randomisiert: ganze Kliniken, Schulen oder Gemeinden werden verschiedenen Studienarmen zugewiesen, und alle innerhalb eines Clusters erhalten dieselbe Intervention. Dieses Design ist logistiscch attraktiv und verhindert oft eine „Kontamination“ zwischen Behandlungen, erzeugt aber gleichzeitig eine starke Ähnlichkeit innerhalb eines Clusters — die Ergebnisse der Personen tendieren dazu, gemeinsam zu schwanken. Zugleich fassen Studien Gesundheitsveränderungen immer häufiger mit abgeleiteten Maßen zusammen, etwa dem Verhältnis zweier Laborwerte oder dem kumulativen Produkt wiederholter Messungen. Wenn Forschende mehrere Behandlungsgruppen mit solchen komplexen, gruppenbasierten Endpunkten vergleichen wollen, versagen die üblichen rangbasierten Tests, die für große, unabhängige Stichproben gut funktionieren, unter Umständen. In kleinen oder mäßig großen Cluster-Studien führt die häufige Abkürzung, die die Teststatistik durch eine Chi-Quadrat-Verteilung zu approximieren versucht, oft zu überhöhten Fehlalarmen und zu zu schmalen Konfidenzintervallen.

Unordentliche Maße als vergleichbare „Zeiten“ ausdrücken

Der erste Schritt des Autors besteht darin, komplizierte Endpunkte in eine gemeinsame Sprache zu überführen: Zeit-bis-Ereignis-Daten. Verhältnisse, etwa ein Blutmarker geteilt durch einen anderen, werden als die „Zeit“ behandelt, bis ein kritisches Verhältnis erreicht ist; Produkte mehrerer Messungen werden zu einem einzigen kombinierten Wert zusammengefasst, häufig nach einer logarithmischen Transformation zur Stabilisierung der Varianz. Jeder Patient wird dann dadurch zusammengefasst, wann sein abgeleiteter Wert eine Schwelle überschreitet oder wie lange er beobachtet wird, ohne diese Schwelle zu überschreiten — analog zur üblichen Überlebensanalyse. Da Patienten innerhalb von Clustern leben, weist die Methode jeder Person eine gewichtete, rangbasierte Punktzahl zu, die Zensierung berücksichtigt — also das vorzeitige Ende der Nachbeobachtung vor Auftreten des Ereignisses — und summiert diese Punktzahlen innerhalb jedes Clusters. Das Ergebnis ist eine zusammenfassende Zahl pro Cluster, die sowohl das Timing der Ereignisse als auch die Korrelation innerhalb der Gruppe erfasst. Aus diesen Cluster-Summen wird dann eine globale quadratische Statistik aufgebaut, um alle Behandlungsarme gleichzeitig zu vergleichen.

Eine schärfere Sicht auf zufällige Variation

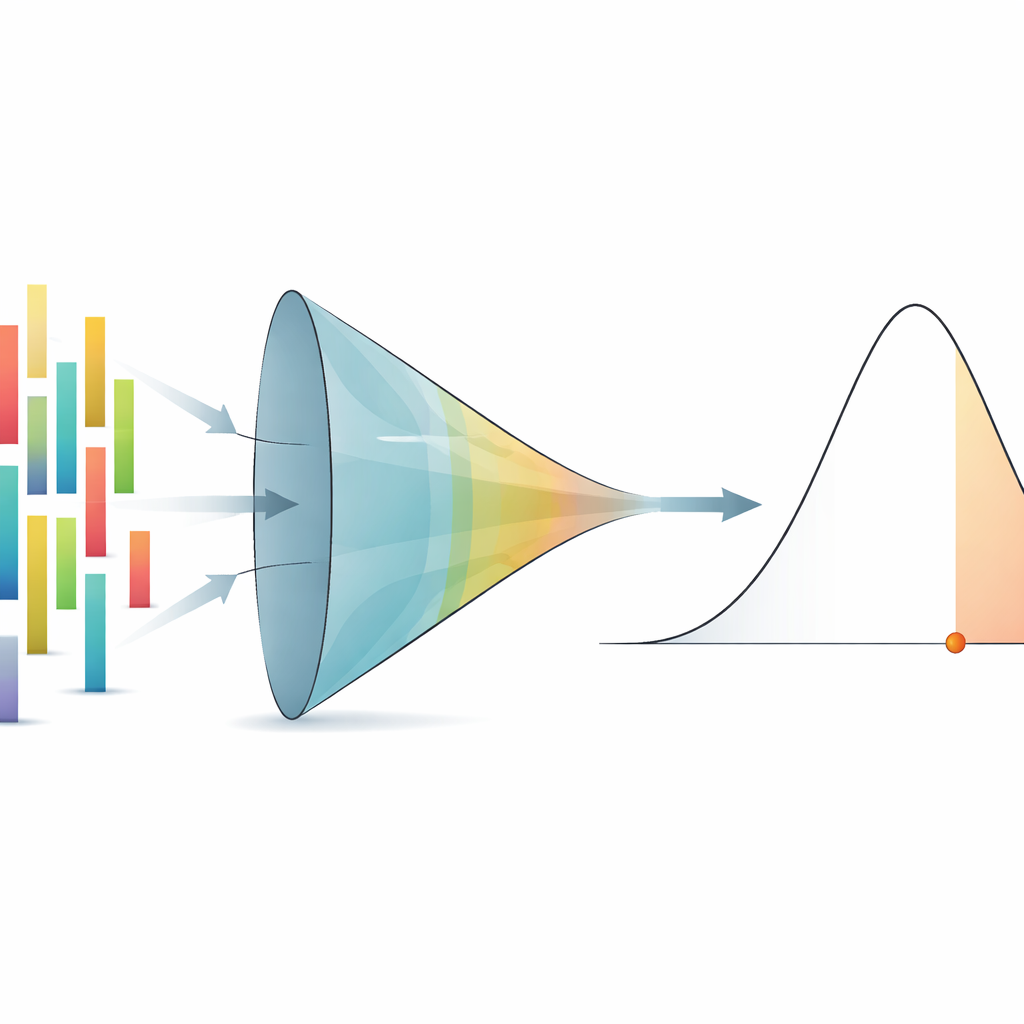

Im Prinzip ist die fairste Art zu prüfen, ob ein beobachteter Unterschied zwischen Behandlungsgruppen überraschend ist, alle möglichen Zuweisungen der Cluster zu Behandlungen gemäß dem tatsächlichen Randomisierungsschema zu betrachten und zu sehen, wie extrem die Teststatistik über diese Menge wird. Für Cluster-Studien mit urnenähnlicher Zuteilung — Behandlungslabels werden ohne Zurücklegen aus einem konzeptuellen Topf gezogen — bedeutet das, riesige Mengen an Permutationen zu durchdenken. Eine vollständige Aufzählung ist für realistische Studien unmöglich, und Tausende von Computersimulationen sind teuer, wenn sie für viele Tests oder zur Konstruktion von Konfidenzintervallen wiederholt werden müssen. Der Beitrag führt eine multivariate Sattelpunkt-Approximation ein, eine mathematische Abkürzung, die das vollständige Verhalten der erzeugenden Funktion der Teststatistik nutzt, statt nur ihren Mittelwert und ihre Varianz, und damit diese Permutationsverteilung mit bemerkenswerter Genauigkeit nachahmt — selbst in den fernen Rändern, wo p-Werte liegen.

Die Methode im Praxistest

Das neue Vorgehen wird durch umfangreiche Simulationen geprüft, die realistische multi-armige Cluster-Studien nachbilden mit variierender Zahl an Behandlungsgruppen, unterschiedlichen Clustern Größen, mehreren Stufen der inneren Cluster-Korrelation und sowohl moderater als auch starker Zensierung. In 20 anspruchsvollen Szenarien und für zwei Familien abgeleiteter Endpunkte — Verhältnisse und Produkte — stimmen die saddlepoint-basierten p-Werte eng mit den nahezu exakten „Goldstandard“-Werten überein, die aus großen Zahlen zufälliger Permutationen gewonnen wurden. Im Gegensatz dazu lehnt die vertraute Chi-Quadrat-Approximation in kleinen oder stark korrelierten Settings zu häufig die Nullhypothese ab, besonders wenn viele Behandlungsgruppen verglichen werden. Dasselbe Muster zeigt sich bei Konfidenzintervallen: Werden sie durch Invertierung des Sattelpunkt-Tests konstruiert, erreichen sie die beworbene 95%-Abdeckung des wahren Werts, während Chi-Quadrat-basierte Intervalle diesen Wert deutlich zu oft verfehlen können, insbesondere in Grenzdesigns, in denen Entscheidungen besonders sensibel sind.

Lehren aus realen klinischen Studien

Um die praktischen Konsequenzen zu zeigen, wendet der Autor die Methode auf drei multizentrische klinische Studien an: eine Leukämiestudie, die misst, wie schnell sich Blutwerte erholen, eine Studie zu altersbedingten Augenkrankheiten, die den kombinierten Sehverlust beider Augen verfolgt, und eine Parodontitis-Studie, die den Verlauf von Zahnfleischerkrankungen innerhalb von Mündern beurteilt. In zwei dieser Fälle erklärt die Standardanalyse unter Verwendung von Chi-Quadrat-Approximationen einen Behandlungseffekt auf dem konventionellen 5%-Niveau als „statistisch signifikant“, was potenziell starke klinische Schlussfolgerungen nach sich ziehen würde. Die Sattelpunkt-Methode zusammen mit nahezu exakten Permutationsergebnissen führt hingegen zu etwas größeren p-Werten und zu breiteren Intervallen, die „keinen Effekt“ einschließen und damit signalisieren, dass die Evidenz eher vage als ausschlaggebend ist. In einer großen, leistungsstarken Sehstudi e stimmen alle Methoden darin überein, dass die Behandlung vorteilhaft ist, aber die Sattelpunkt-Intervalle vermeiden erneut eine zu optimistische Genauigkeitsdarstellung und liefern ein ehrlicheres Bild der Unsicherheit.

Klarere Antworten aus komplexen Daten

Für nichtfachliche Leser lautet die Kernbotschaft: Nicht alle statistischen Werkzeuge sind gleichermaßen verlässlich, wenn Studien komplex werden und Stichproben begrenzt sind. Diese Arbeit bietet einen prinzipientreuen, rechnerisch effizienten Weg, das tatsächliche Randomisierungsschema von Cluster-Studien und die Eigenheiten moderner Endpunkte zu respektieren, ohne auf aufwändige Simulationen oder fragile Abkürzungen für große Stichproben zurückzugreifen. Indem sie Fehlalarme zuverlässig kontrolliert und Konfidenzintervalle liefert, die ihre Versprechen halten, hilft das Sattelpunkt‑Framework sicherzustellen, dass Schlussfolgerungen über neue Therapien — insbesondere in fein austarierten oder kleineren multizentrischen Studien — auf der so soliden Evidenz beruhen, wie die Daten es erlauben, nicht mehr und nicht weniger.

Zitation: Newer, H.A. Saddlepoint inference for rank-based k-sample tests in clustered survival trials. Sci Rep 16, 11372 (2026). https://doi.org/10.1038/s41598-026-44064-9

Schlüsselwörter: cluster-randomisierte Studien, Überlebensanalyse, Sattelpunkt-Approximation, Permutationstests, Inferenz bei kleinen Stichproben