Clear Sky Science · it

POLAR-DETR: Transformer di rilevamento in tempo reale con attenzione locale-globale sensibile all’occlusione polarizzata per l’automazione totale del laboratorio

Robot più intelligenti per laboratori medici affollati

Dietro ogni esame del sangue c’è una linea di produzione affollata dove portoirack di provette scorrono davanti a scanner e robot. Mentre gli ospedali puntano verso laboratori completamente automatizzati, queste linee devono identificare migliaia di provette simili e ravvicinate in tempo reale, anche quando si sovrappongono o si nascondono reciprocamente. Questo articolo presenta POLAR‑DETR, un nuovo sistema visivo progettato per aiutare i robot di laboratorio a vedere con affidabilità in questo mondo ingombro e ristretto, aprendo la strada a test più rapidi, sicuri e accurati.

Perché vedere le provette è difficile

I laboratori moderni utilizzano sempre più macchine per spostare e smistare i campioni, ma lo spazio attorno a queste linee è limitato. Invece di lunghi nastri trasportatori, i laboratori stanno adottando sistemi robotici compatti che fanno ampio affidamento sulle videocamere. Queste devono distinguere ogni provetta, rack e portatore in scene dove gli oggetti sono piccoli, fitti e spesso parzialmente nascosti. I rilevatori veloci popolari in altri settori, come la famiglia di algoritmi YOLO, iniziano a incontrare difficoltà in queste condizioni. Dipendono da un passaggio decisionale aggiuntivo per filtrare predizioni sovrapposte e possono perdere oggetti piccoli o occlusi, causando errori inaccettabili quando si trattano campioni medici.

Un nuovo motore visivo per il laboratorio

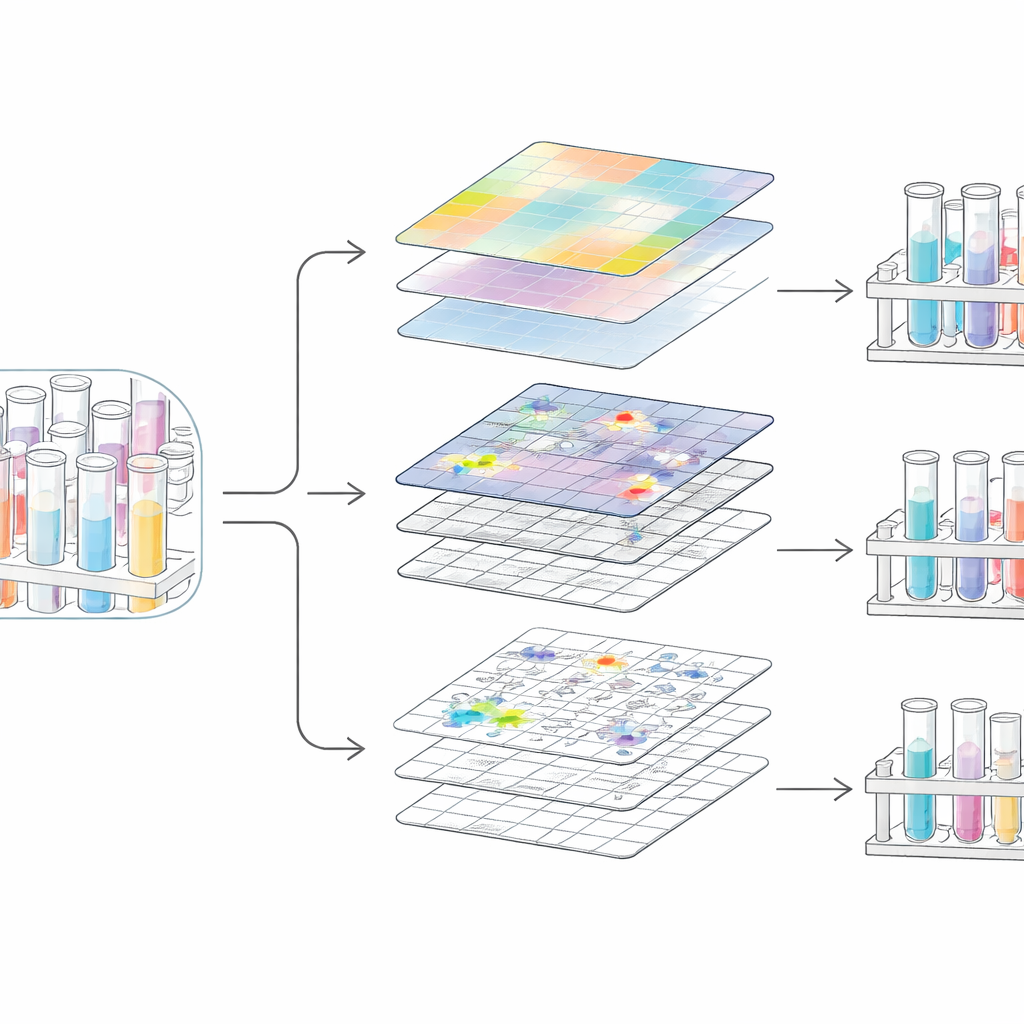

Sfruttando i recenti progressi nei modelli visivi basati su transformer, gli autori progettano POLAR‑DETR specificamente per le linee di produzione mediche. Invece di una catena di passaggi sintonizzati a mano, utilizza un design end‑to‑end che trasforma direttamente le immagini della camera in posizioni e tipi di provetta in un unico passaggio, evitando la consueta fase di filtraggio aggiuntiva. Al centro c’è un nuovo codificatore di caratteristiche che presta particolare attenzione a come gli oggetti si relazionano nello spazio e a come si nascondono a vicenda. Rimodellando il modo in cui il modello esplora ogni immagine, il codificatore lo aiuta a concentrarsi sulle regioni giuste, preservando i dettagli fini delle piccole provette pur comprendendo la scena nel suo insieme. Questo rende il sistema più resiliente quando le provette si sovrappongono, si raggruppano o variano molto per dimensione.

Combinare i dettagli e il quadro d’insieme

Per comprendere scene affollate, un sistema visivo deve bilanciare i dettagli minuti ai bordi delle provette con la disposizione complessiva di rack e portatori. POLAR‑DETR affronta questo problema con due moduli di fusione complementari. Un modulo collega informazioni attraverso più scale e posizioni, trattando gruppi di regioni d’immagine come relazioni flessibili piuttosto che semplici griglie. Questo aiuta il sistema a riconoscere, per esempio, che un bordo tenue di una provetta probabilmente appartiene a un gruppo di provette vicine piuttosto che allo sfondo. Un secondo modulo separa esplicitamente l’elaborazione in un ramo “locale” che affina texture e contorni e in un ramo “globale” che segue pattern a lunga distanza. I risultati di entrambi vengono poi ricombinati, producendo contorni più netti degli oggetti e meno scambi tra provette e attrezzature circostanti.

Snellire la rete per la velocità nel mondo reale

I modelli visivi ad alta accuratezza possono essere pesanti e lenti, un problema per macchine industriali che devono funzionare 24 ore su 24. Gli autori introducono una strategia di potatura che analizza quanto ogni percorso interno influisce sull’output del modello. I percorsi che contribuiscono poco vengono rimossi in modo informato, invece che casuale o con semplici regole di dimensione. Questo taglio selettivo riduce il numero di parametri di circa un quinto e il calcolo di quasi un quarto, eppure il modello diventa in realtà più accurato. Sul loro dataset di linea di produzione medica, POLAR‑DETR raggiunge il 70% di precisione media operando a circa 68 fotogrammi al secondo, abbastanza veloce per l’uso robotico in tempo reale.

Costruire un banco di prova realistico

Per valutare se POLAR‑DETR funziona davvero in pratica, il team ha assemblato un nuovo dataset da una linea di produzione medica operativa. Usando telecamere consumer in condizioni di illuminazione variabile, hanno acquisito migliaia di immagini ad alta risoluzione di rack, portatori e diversi tipi di provette, incluse provette con tappo, senza tappo e di varie categorie di test. Esperti hanno annotato più di ottantamila oggetti individuali. Hanno poi ampliato i dati di addestramento con rotazioni controllate, ritagli, variazioni di luminosità, rumore sintetico e combinazioni a mosaico, imitando spostamenti reali di orientamento, illuminazione e ingombro. Questo dataset non solo mette alla prova il modello con provette dense, piccole e occluse, ma fornisce anche un benchmark pubblico per altri ricercatori che lavorano sull’automazione di laboratorio.

Cosa significa per i laboratori del futuro

In termini semplici, POLAR‑DETR è un paio di occhi più acuti per i laboratori automatizzati. Ridisegnando con cura il modo in cui un sistema visivo presta attenzione alle scene affollate e quindi snellendolo per la velocità, gli autori raggiungono al tempo stesso maggiore accuratezza e minori costi computazionali rispetto a molte soluzioni esistenti. Il sistema individua più provette, commette meno errori in sfondi complessi e tiene il passo con il ritmo dell’hardware industriale. Man mano che i laboratori continuano ad automatizzarsi, approcci di questo tipo potrebbero rendere la gestione dei campioni più affidabile e flessibile, contribuendo in ultima analisi a risultati di test più rapidi e a flussi di lavoro sanitari più robusti.

Citazione: Zu, Y., Li, S. & Zhang, L. POLAR-DETR: Polarized occlusion-aware local-global attention real-time detection transformer for total laboratory automation. Sci Rep 16, 11949 (2026). https://doi.org/10.1038/s41598-026-42038-5

Parole chiave: automazione di laboratorio, rilevamento oggetti, linea di produzione medica, computer vision, modelli transformer