Clear Sky Science · de

POLAR-DETR: Polarisiertes, okklusionsbewusstes lokal‑globales Attention‑Echtzeit‑Detektions‑Transformer für vollständige Laborautomatisierung

Intelligentere Roboter für überfüllte medizinische Labore

Hinter jedem Bluttest steht eine geschäftige Produktionslinie, auf der Reihen von Röhrchen an Scannern und Robotern vorbeisausen. Während Krankenhäuser auf vollständig automatisierte Labore hinarbeiten, müssen diese Linien in Echtzeit Tausende dicht gepackter, einander sehr ähnlicher Röhrchen identifizieren — selbst wenn sie sich überlappen oder verdecken. Dieses Papier stellt POLAR‑DETR vor, ein neues Vision‑System, das Laborrobotern helfen soll, in dieser überfüllten, beengten Umgebung zuverlässig zu sehen und so schnellere, sicherere und genauere Tests zu ermöglichen.

Warum das Erkennen von Reagenzgläsern schwierig ist

Moderne Labore setzen zunehmend Maschinen zum Transport und Sortieren von Proben ein, doch der Platz an diesen Linien ist begrenzt. Statt langer Förderbänder nutzen Labore kompakte Robotersysteme, die stark auf Kameras angewiesen sind. Diese Kameras müssen jedes Röhrchen, Gestell und Trägersystem in Szenen erkennen, in denen Objekte klein, dicht gepackt und oft teilweise verdeckt sind. Beliebte schnelle Detektoren aus anderen Industrien, etwa die YOLO‑Familie, stoßen unter diesen Bedingungen an ihre Grenzen. Sie benötigen einen zusätzlichen Entscheidungsschritt, um überlappende Vorhersagen zu filtern, und übersehen leicht winzige oder okkludierte Objekte — Fehler, die bei medizinischen Proben inakzeptabel sind.

Eine neue Vision‑Engine für das Labor

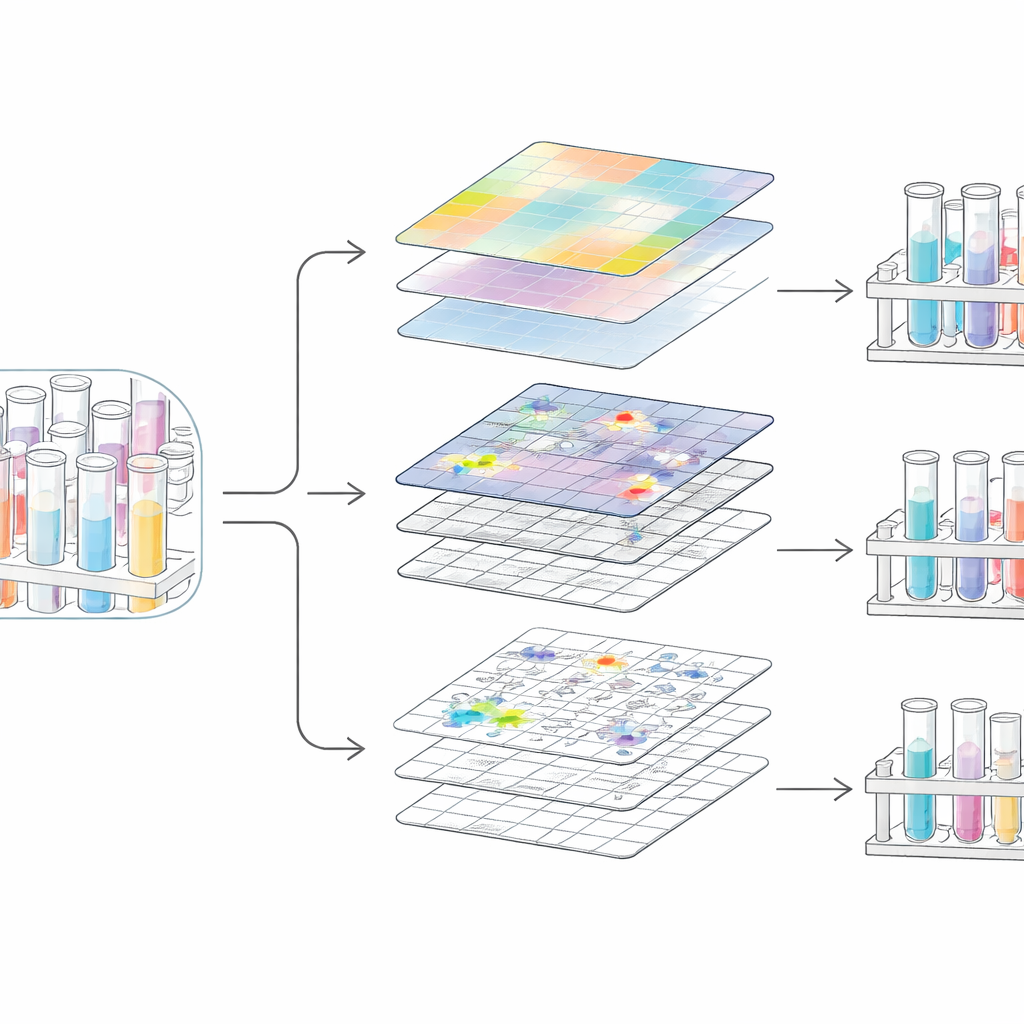

Aufbauend auf jüngsten Fortschritten bei transformerbasierten Vision‑Modellen entwerfen die Autoren POLAR‑DETR speziell für medizinische Produktionslinien. Statt einer Kette von handabgestimmten Zwischenschritten nutzt das System ein End‑to‑End‑Design, das Kamerabilder in einem Durchgang direkt in Röhrchenpositionen und -typen übersetzt und so die übliche zusätzliche Filterstufe vermeidet. Im Kern steht ein neuer Feature‑Encoder, der besonders darauf achtet, wie Objekte räumlich zueinander stehen und sich gegenseitig verdecken. Durch das Umgestalten der Art und Weise, wie das Modell jedes Bild durchsucht, hilft der Encoder, die Aufmerksamkeit auf die relevanten Regionen zu lenken, feine Details kleiner Röhrchen zu erhalten und gleichzeitig den größeren Kontext zu erfassen. Das macht das System widerstandsfähiger, wenn Röhrchen überlappen, dicht beieinander stehen oder stark in der Größe variieren.

Details und Gesamtbild vereinen

Um überfüllte Szenen zu verstehen, muss ein Vision‑System die kleinen Details an den Röhrchenkanten mit dem Gesamtaufbau von Gestellen und Trägern ausbalancieren. POLAR‑DETR löst das mit zwei komplementären Fusionsmodulen. Ein Modul verknüpft Informationen über mehrere Skalen und Positionen hinweg und behandelt Gruppen von Bildregionen als flexible Beziehungen statt als starre Gitter. Das hilft dem System beispielsweise zu erkennen, dass eine schwache Kante wahrscheinlich zu einer Gruppe benachbarter Röhrchen gehört und nicht zum Hintergrund. Ein zweites Modul teilt die Verarbeitung explizit in einen „lokalen“ Zweig, der Texturen und Konturen schärft, und einen „globalen“ Zweig, der langreichweitige Muster verfolgt. Die Ergebnisse beider Zweige werden anschließend wieder zusammengeführt, was zu klareren Objektgrenzen und weniger Verwechslungen zwischen Röhrchen und umgebender Ausrüstung führt.

Das Netzwerk für reale Geschwindigkeit beschneiden

Hochgenaue Vision‑Modelle können groß und langsam sein, was auf industriellen Maschinen, die rund um die Uhr laufen, problematisch ist. Die Autoren stellen eine Pruning‑Strategie vor, die analysiert, wie stark jeder interne Pfad das Modell‑Output beeinflusst. Pfade, die wenig beitragen, werden gezielt entfernt — nicht zufällig oder nach einfachen Größenregeln. Dieses selektive Beschneiden reduziert die Anzahl der Parameter um etwa ein Fünftel und den Rechenaufwand um nahezu ein Viertel, und dennoch wird das Modell tatsächlich genauer. Auf ihrem Datensatz für medizinische Produktionslinien erreicht POLAR‑DETR eine durchschnittliche Präzision von 70 % bei rund 68 Bildern pro Sekunde, schnell genug für den Echtzeit‑Einsatz mit Robotern.

Aufbau eines realistischen Testfelds

Um zu prüfen, ob POLAR‑DETR in der Praxis wirklich funktioniert, hat das Team einen neuen Datensatz aus einer betrieblichen medizinischen Produktionslinie zusammengestellt. Mit Verbraucher‑Kameras unter wechselnden Lichtverhältnissen erfassten sie Tausende hochaufgelöster Bilder von Gestellen, Trägern und mehreren Röhrchentypen, darunter verschlossene, offene und verschiedene Testkategorien. Experten annotierten über achtzigtausend einzelne Objekte. Anschließend erweiterten sie die Trainingsdaten durch kontrollierte Rotationen, Ausschnitte, Helligkeitsänderungen, synthetisches Rauschen und Mosaikkombinationen, um reale Verschiebungen in Orientierung, Beleuchtung und Unordnung nachzubilden. Dieser Datensatz fordert das Modell nicht nur mit dichten, kleinen und okkludierten Röhrchen, sondern liefert auch eine öffentliche Benchmark für andere Forscher im Bereich Laborautomatisierung.

Was das für zukünftige Labore bedeutet

Kurz gesagt ist POLAR‑DETR ein schärferes Augenpaar für automatisierte Labore. Durch das gezielte Redesign der Aufmerksamkeitsmechanismen für überfüllte Szenen und die anschließende Straffung für Geschwindigkeit erreichen die Autoren sowohl höhere Genauigkeit als auch geringere Rechenkosten im Vergleich zu vielen bestehenden Ansätzen. Das System erkennt mehr Röhrchen, macht weniger Fehler in unruhigem Hintergrund und hält mit dem Tempo industrieller Hardware Schritt. Während Labore weiter automatisieren, könnten Ansätze wie dieser die Probenhandhabung zuverlässiger und flexibler machen und so letztlich zu schnelleren Testergebnissen und robusteren Arbeitsabläufen im Gesundheitswesen beitragen.

Zitation: Zu, Y., Li, S. & Zhang, L. POLAR-DETR: Polarized occlusion-aware local-global attention real-time detection transformer for total laboratory automation. Sci Rep 16, 11949 (2026). https://doi.org/10.1038/s41598-026-42038-5

Schlüsselwörter: Laborautomatisierung, Objekterkennung, medizinische Produktionslinie, Computer Vision, Transformer‑Modelle