Clear Sky Science · it

Evoluzione dell’informazione sull’identità degli oggetti nella corteccia sensomotoria durante la presa

Come il cervello riconosce ciò che teniamo

Ogni volta che raccogli una tazza di caffè al buio o tiri fuori il telefono dalla tasca senza guardare, il tuo cervello in qualche modo sa cosa stai afferrando. Eppure i segnali che arrivano dalla mano e dal braccio cambiano drasticamente nel momento stesso del contatto con l’oggetto. Questo studio pone una domanda semplice ma profonda: come fa il cervello a tenere traccia di quale oggetto è nella tua mano mentre passi dall’allungare il braccio verso l’oggetto al tenerlo realmente?

Dall’allungamento alla presa

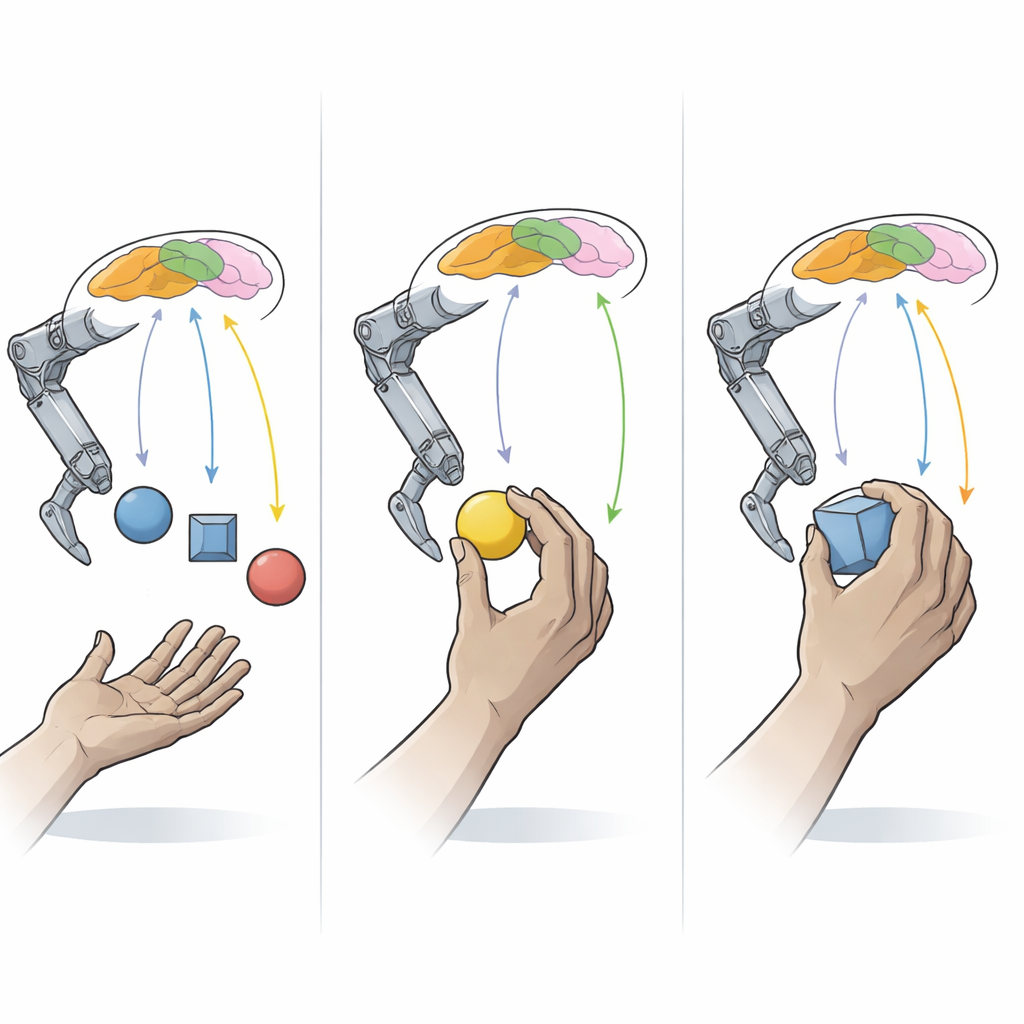

Per indagare questo, i ricercatori hanno lavorato con macachi addestrati a afferrare una serie di oggetti di uso quotidiano che variavano per dimensione, forma e orientamento. Un braccio robotico portava un oggetto alla volta direttamente nella mano della scimmia in modo che il braccio e la spalla potessero restare quasi immobili. Prima del contatto, la mano si apriva e si modella naturalmente per adattarsi all’oggetto; dopo il contatto, le dita si chiudevano con una forza sufficiente a rompere un collegamento magnetico e tenere l’oggetto. Durante tutto questo comportamento, il team ha registrato l’attività elettrica di centinaia di singoli neuroni in diverse aree che controllano il movimento e il tatto nella mano.

Aree cerebrali diverse, momenti diversi

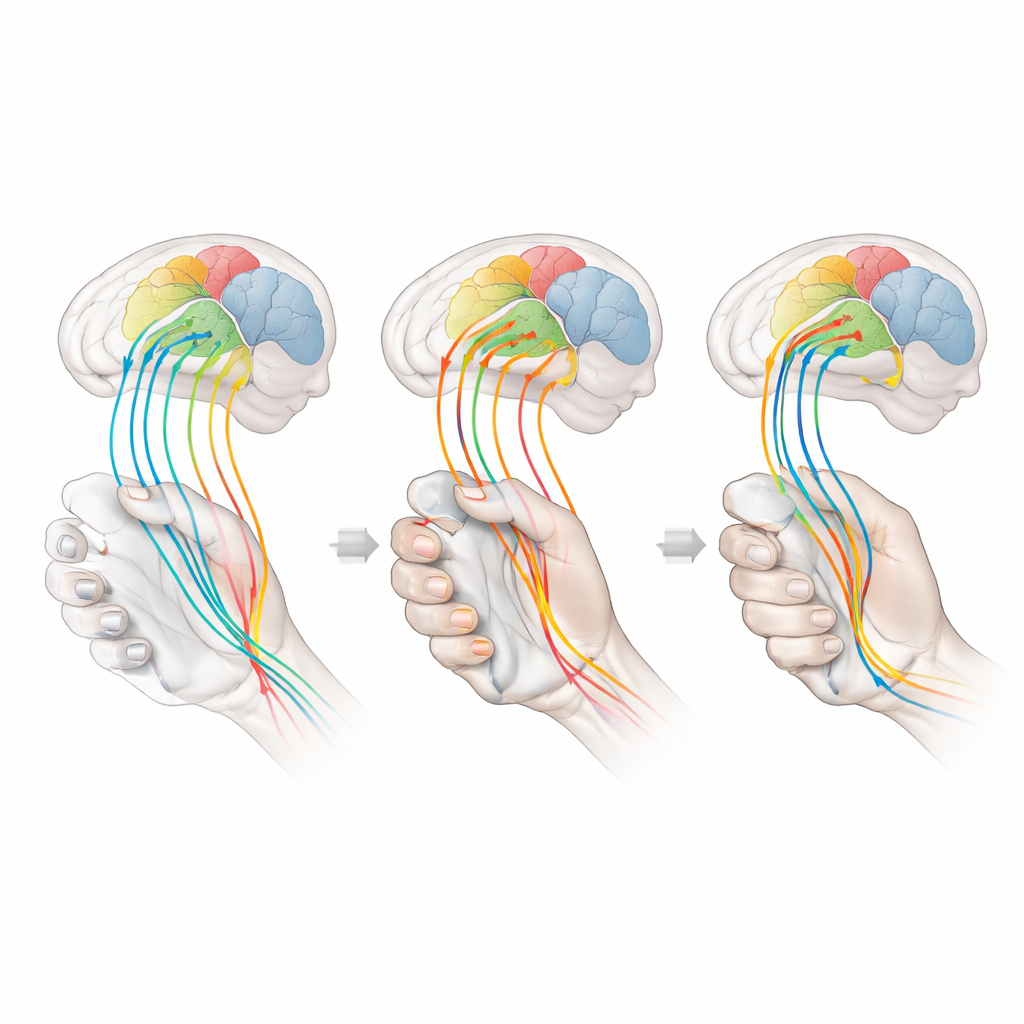

Le registrazioni provenivano da quattro regioni adiacenti lungo la scissura centrale del cervello. Una è la corteccia motoria primaria, che contribuisce a pilotare l’attività muscolare. Tre appartengono all’area tattile primaria: una che riceve principalmente segnali da muscoli e tendini riguardo agli angoli articolari, un’altra che riceve segnali dalla pelle e una terza che combina entrambi i tipi di input. Prima che la mano toccasse l’oggetto, i neuroni nelle regioni motorie e in quelle che rilevano i muscoli erano i più attivi e già trasmettevano informazioni che distingueva quale oggetto sarebbe stato afferrato. Al contrario, le regioni focalizzate sulla pelle erano relativamente silenziose e portavano poche o nessuna informazione sull’identità dell’oggetto durante questa fase di “pre-modellamento”.

Cosa cambia nel momento del contatto

Quando le dita incontravano l’oggetto, lo schema si ribaltava in modo inatteso. L’attività complessiva in molte regioni diminuiva dopo il contatto, anche se le scimmie continuavano a stringere gli oggetti. Eppure la quantità di informazione specifica sull’oggetto aumentava nelle aree tattili basate sulla pelle e nella regione che integra gli input, e rimaneva elevata nella corteccia motoria e in quella sensibile ai muscoli. In altre parole, meno spike elettrici contenevano informazioni più significative. Analisi che misuravano quanto efficacemente ogni neurone usava la sua attività hanno mostrato che l’identità dell’oggetto si consolidava attorno al momento del contatto per poi restare stabile, nonostante i livelli di attività grezza diminuissero.

Codici che si spostano, non mappe statiche

Un’intuizione chiave è emersa confrontando come si relazionavano i pattern di attività prima e dopo il contatto. Se il cervello usasse lo stesso “codice” per l’identità dell’oggetto durante tutto il movimento, allora un algoritmo addestrato a leggere gli oggetti dall’attività pre-contatto dovrebbe funzionare bene anche dopo il contatto, e viceversa. Invece, tali decodificatori incrociati tra epoche fallivano in ogni regione, specialmente nelle aree tattili basate sulla pelle e in quella a input combinato. Solo quando il decodificatore era addestrato su dati di entrambe le fasi poteva ricostruire una lettura unificata, seppur imperfetta, della postura della mano e dell’identità dell’oggetto. Questo mostra che, sebbene l’informazione su cosa si sta afferrando sia sempre presente, il modo in cui viene rappresentata nell’attività cerebrale cambia bruscamente quando la mano comincia a sentire e stringere l’oggetto.

Perché questo conta per mani e macchine

Questi risultati delineano l’immagine della corteccia sensomotoria come di un hub di comunicazione flessibile piuttosto che una mappa statica. Prima del contatto, le regioni motorie e quelle che rilevano i muscoli riflettono principalmente come la mano è modellata e si muove, permettendo al cervello di “indovinare” l’oggetto solo dalla postura. Dopo il contatto, le regioni sensibili al tatto diventano improvvisamente ricche di informazioni su quali superfici della mano sono caricate e su come l’oggetto preme sulla pelle, mentre le regioni motorie e muscolari integrano postura e le forze necessarie a sostenere l’oggetto. Per un lettore generale, il punto è che il tuo cervello non conserva un’impronta fissa di ogni oggetto. Piuttosto, riscrive continuamente la sua descrizione interna man mano che le dita si chiudono e toccano l’oggetto, tessendo insieme movimento e tatto così perfettamente che tu semplicemente percepisci l’impressione di avere un oggetto solido nella presa.

Citazione: Yan, Y., Sobinov, A.R., Goodman, J.M. et al. Evolution of object identity information in sensorimotor cortex throughout grasp. Nat Commun 17, 2784 (2026). https://doi.org/10.1038/s41467-026-69502-0

Parole chiave: presa, corteccia sensomotoria, tatto e propriocettività, riconoscimento degli oggetti con la mano, codifica neurale