Clear Sky Science · fr

Évaluation approfondie des outils de tri métagénomique révèle des facteurs clés pour améliorer la récupération des génomes

Pourquoi les minuscules voisins de votre intestin méritent qu’on s’y intéresse

Les microbes qui vivent dans nos intestins, les sols et les océans façonnent discrètement notre santé, nos systèmes alimentaires et le climat. Pourtant, la plupart d’entre eux ne peuvent pas être cultivés en laboratoire, si bien que les scientifiques s’appuient sur le séquençage de l’ADN pour observer ces mondes cachés. Cette étude pose une question apparemment simple mais aux grandes conséquences : lorsque nous transformons des données d’ADN brutes en génomes provisoires de microbes, quels outils informatiques fonctionnent le mieux, et dans quelles conditions réussissent-ils ou échouent-ils ?

Assembler des génomes à partir d’un casse‑tête génétique

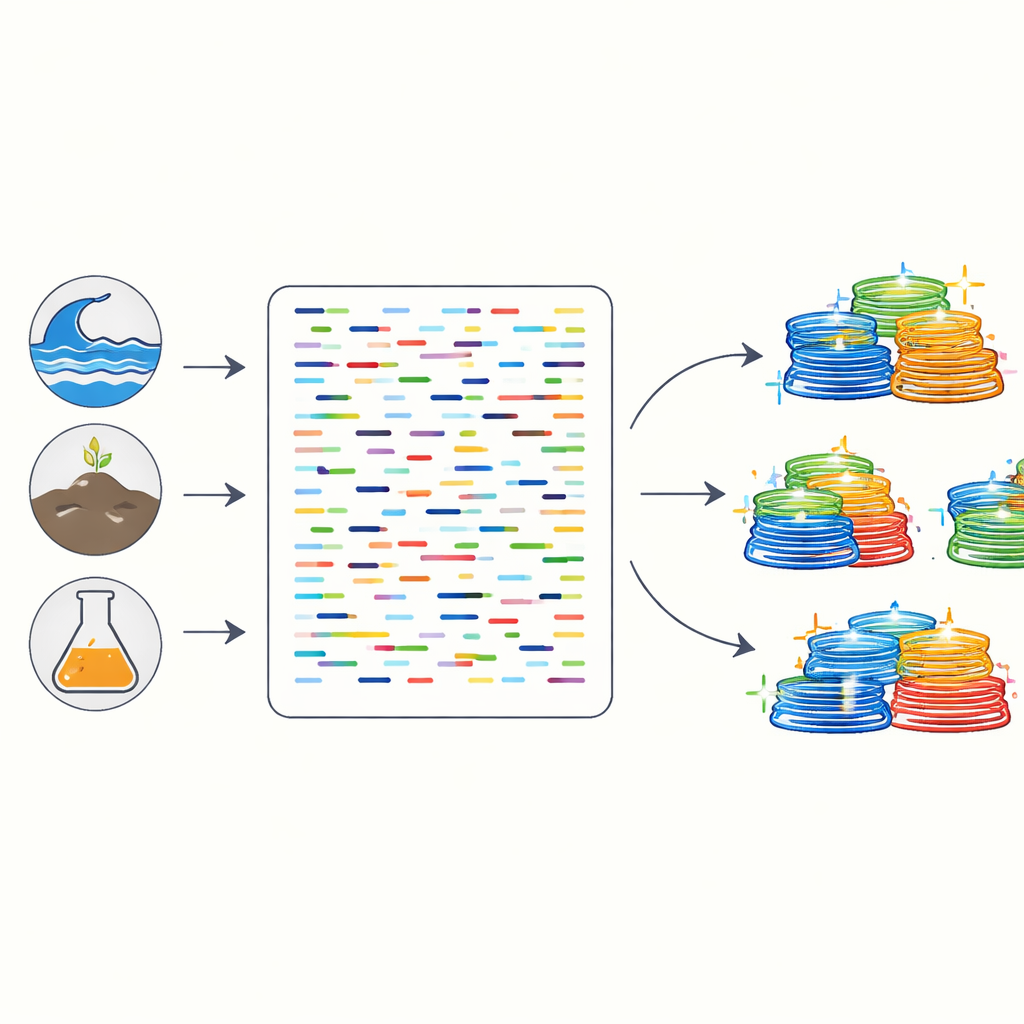

Les séquenceurs modernes transforment une poignée de sol ou un échantillon de selles en des milliards de courts fragments d’ADN mélangés provenant de centaines voire de milliers d’espèces. Les chercheurs assemblent d’abord ces fragments en séquences plus longues appelées contigs, puis utilisent des outils de « binning » pour regrouper les contigs susceptibles de provenir du même microbe, formant ce qu’on appelle des génomes assemblés à partir de métagénomes. De nombreux programmes de binning existent, fondés sur des approches mathématiques et d’apprentissage automatique différentes. Les auteurs ont comparé systématiquement neuf outils populaires, plus trois méthodes qui affinent et combinent leurs sorties, en utilisant un mélange de communautés simulées et de données réelles provenant d’échantillons de l’intestin humain, de l’océan et du sol.

Comment la complexité de la communauté et la profondeur de séquençage font pencher la balance

L’équipe a constaté que deux caractéristiques fondamentales d’un jeu de données influencent fortement le succès du binning : le nombre d’espèces présentes et la profondeur de séquençage de l’échantillon. Lorsque les communautés ne contenaient que quelques dizaines d’espèces, la plupart des outils s’en sortaient plutôt bien. Mais à mesure que le nombre d’espèces montait à des centaines ou des milliers — des niveaux plus proches des microbiomes réels de l’intestin ou du sol — de nombreuses méthodes plus anciennes ont montré leurs limites, ne parvenant pas à récupérer des génomes complets. Un séquençage plus profond aidait toujours, en particulier au‑delà d’environ 7 gigabases par échantillon, mais ne pouvait pas entièrement compenser des outils non conçus pour gérer une forte complexité. En revanche, une nouvelle génération de programmes de binning basés sur des réseaux neuronaux conservait de bonnes performances dans ces communautés denses, surtout lorsque des quantités importantes de données de séquençage étaient disponibles.

Algorithmes récents et problème caché des chimères

Une découverte marquante est que des outils neuronaux tels que COMEBin, SemiBin2 et VAMB (surtout lorsqu’ils exploitaient l’information de plusieurs échantillons simultanément) récupéraient systématiquement plus de génomes de haute qualité que les approches traditionnelles. Cependant, les auteurs sont allés au‑delà des simples comptes et ont évalué combien de génomes reconstruits étaient « chimériques » — des hybrides artificiels construits par erreur à partir de fragments de différentes espèces. En utilisant un contrôle spécialisé pour ce type de contamination, ils ont montré que les taux de chimères variaient largement selon les outils. Certaines méthodes qui semblaient performantes selon les mesures standards produisaient en réalité de nombreux génomes hybrides, tandis que d’autres, y compris certains outils basés sur des réseaux neuronaux, maintenaient des taux de chimères relativement faibles. Cela souligne que les contrôles de qualité doivent dépasser la simple évaluation de complétude et des taux d’erreur.

Pourquoi de nombreux échantillons et les lectures appariées comptent

L’étude a aussi abordé deux choix pratiques pour la conception de projets microbiomes : combien d’échantillons regrouper pour un binning « multi‑échantillons », et s’il vaut mieux utiliser un séquençage mono‑brin moins coûteux ou des lectures appariées plus informatives. Pour les outils capables d’apprendre des motifs de couverture à travers plusieurs échantillons, les performances s’amélioraient à mesure que l’on ajoutait des échantillons — mais seulement jusqu’à une vingtaine environ. En utiliser moins apportait peu de bénéfice, et en utiliser beaucoup plus pouvait même nuire aux résultats ou gaspiller des ressources informatiques. Par ailleurs, les auteurs ont montré que les jeux de données séquencés avec des lectures mono‑brin donnaient systématiquement des assemblages de moindre qualité et bien moins de bons génomes que les données appariées, même lorsque la quantité totale d’ADN séquencée était similaire, parce que l’absence d’information d’appariement conduit à des contigs plus fragmentés.

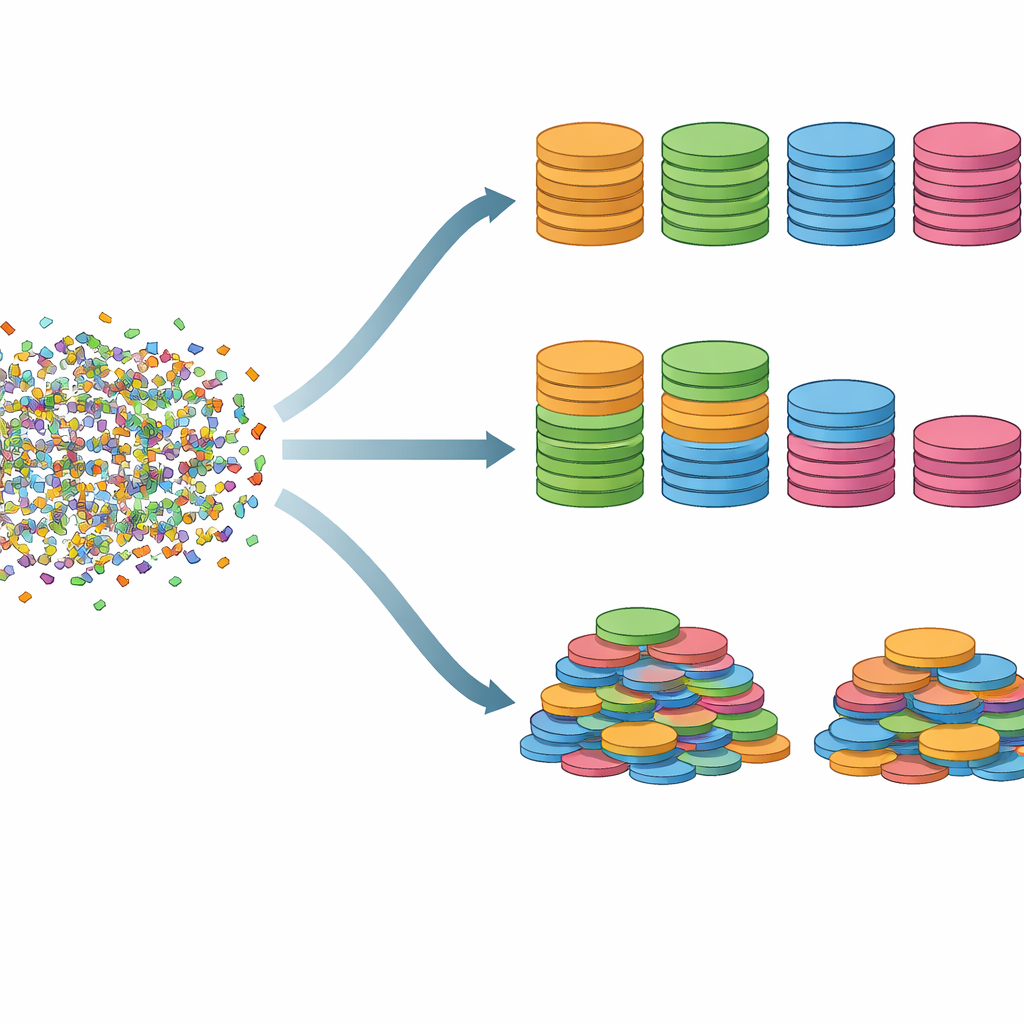

Combiner des outils pour construire de meilleurs catalogues microbiens

Parce que différents programmes excellent sur différents microbes, les auteurs ont testé si une approche ensembliste pouvait surpasser un outil isolé. En intégrant les bins de trois méthodes neuronales de premier plan puis en les affinant par un post‑traitement soigné, ils ont récupéré plus de 30 % de génomes de haute qualité supplémentaires par rapport aux pipelines plus anciens et largement utilisés qui combinent des outils de binning traditionnels. Ces génomes supplémentaires n’étaient pas simplement redondants : ils ont élargi l’arbre de la vie représenté dans les données et inclus davantage de régions difficiles à capturer, comme les gènes ARNr 16S, importants pour nommer et situer les microbes dans l’arbre phylogénétique microbien.

Ce que cela signifie pour les futures études sur le microbiome

Pour les non‑spécialistes, le message central est simple : la manière dont nous transformons des lectures d’ADN brutes en génomes provisoires influence fortement notre perception de ce qui vit dans un environnement donné. Ce travail de benchmarking montre qu’un séquençage plus profond, des lectures appariées, l’utilisation judicieuse d’une vingtaine d’échantillons apparentés et des outils de binning modernes basés sur des réseaux neuronaux — idéalement combinés dans une stratégie d’ensemble — peuvent considérablement augmenter le nombre et la fiabilité des génomes microbien récupérés. En retour, cela permet des cartes plus précises des communautés invisibles qui façonnent nos corps et la planète, et une base plus solide pour de futures découvertes en médecine, écologie et biotechnologie.

Citation: Kim, J., Kim, N., Cha, J.H. et al. Comprehensive benchmarking of metagenomic binning tools reveals key factors for improved genome recovery. Nat Commun 17, 3467 (2026). https://doi.org/10.1038/s41467-026-71521-w

Mots-clés: métagénomique, microbiome, reconstruction de génomes, outils d'apprentissage automatique, étude de benchmarking