Clear Sky Science · es

Evaluación de modelos lingüísticos grandes multimodales comerciales y de código abierto para astronomía dinámica: un estudio de referencia sobre la clasificación de comportamientos resonantes

Por qué esto importa para aficionados al cielo y a los datos

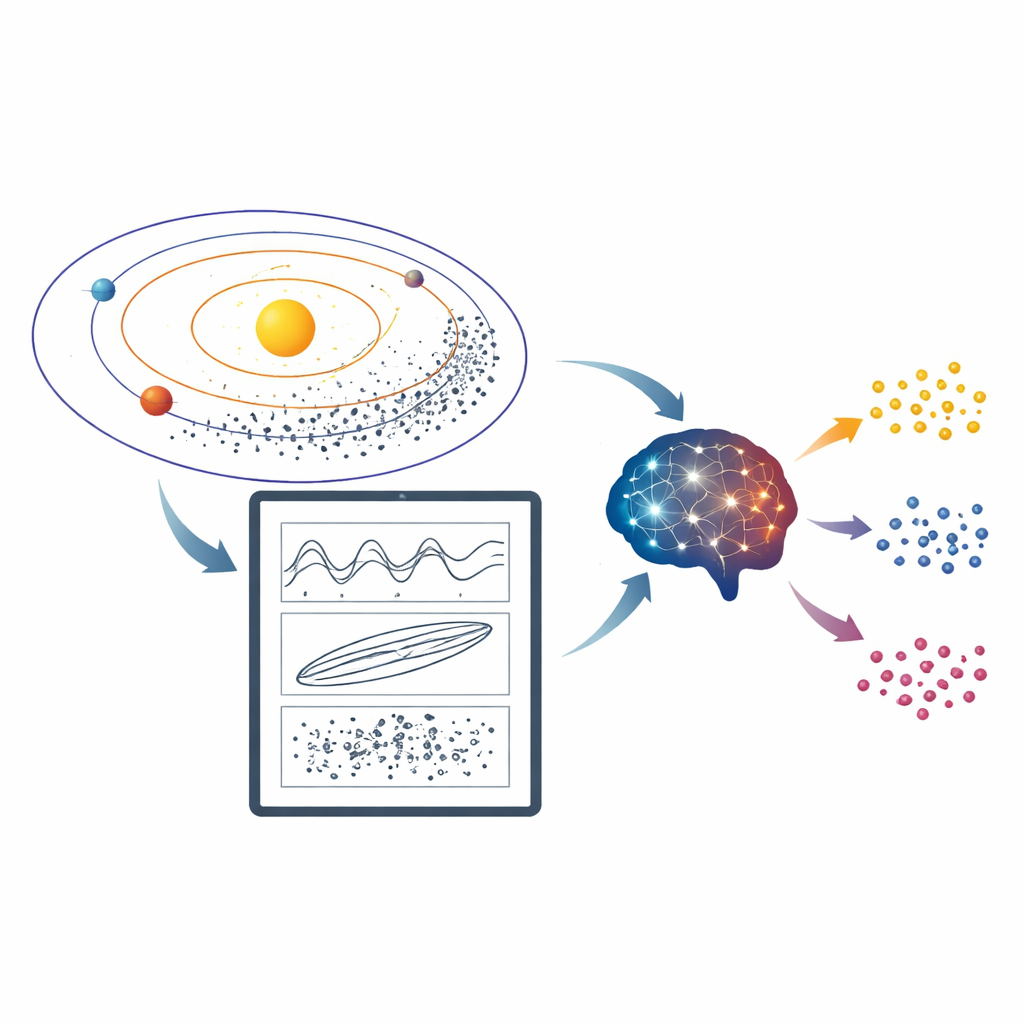

Los astrónomos dedican una sorprendente cantidad de tiempo a una tarea que parece muy terrenal: mirar gráficos y decidir cuáles “oscilan”, cuáles “derivan” y cuáles se comportan de forma caótica. Esos patrones revelan si los asteroides están atrapados en sutiles danzas orbitales con los planetas, lo que moldea la evolución de nuestro Sistema Solar a lo largo de miles de millones de años. Este artículo plantea una pregunta actual: ¿pueden los sistemas de IA modernos que entienden texto e imágenes intervenir y emitir esos juicios con la misma fiabilidad que expertos humanos, sin entrenamiento especial?

Las reglas de tráfico ocultas del Sistema Solar

Muchos asteroides no simplemente giran alrededor del Sol aislados. Sus trayectorias reciben empujones periódicos por las fuerzas gravitatorias de los planetas, una situación conocida como resonancia orbital. Cuando el movimiento de un asteroide coincide con el de un planeta en un ritmo sencillo, su órbita puede quedar atrapada, excitada o desestabilizada. Los astrónomos diagnostican esto trazando una cantidad llamada “ángulo resonante” en función del tiempo. Si los puntos en el gráfico oscilan dentro de una franja, el objeto está en resonancia; si se extienden diagonalmente a lo largo de todo el rango vertical, está fuera de resonancia; si cambian de un modo a otro, el comportamiento es más ambiguo o temporal. Para casos claros, reglas computacionales simples funcionan bien, pero en regiones abarrotadas del espacio, como el cinturón principal de asteroides, las influencias superpuestas generan gráficos desordenados y ruidosos que son difíciles de clasificar automáticamente y que tradicionalmente han requerido la mirada de expertos.

De algoritmos a medida a IA de propósito general

Hasta hace poco, los investigadores confiaban en dos estrategias generales. Los modelos clásicos de aprendizaje automático, como árboles de decisión y redes neuronales, pueden entrenarse para reconocer tipos específicos de resonancia, pero cada nuevo problema necesita su propio conjunto de datos etiquetados, ajuste y código. Los métodos deterministas, basados en reglas cuidadosamente diseñadas y análisis de frecuencia, pueden rendir bien cuando la señal es limpia, pero flaquean cuando las resonancias se solapan o aparecen solo temporalmente. Ambas aproximaciones fallan precisamente donde lo más interesante desde el punto de vista científico ocurre: en casos fronterizos con capturas temporales, “adhesión” a resonancias y movimiento caótico. En cambio, los modernos modelos lingüísticos grandes (LLM) capaces de inspeccionar imágenes prometen algo distinto: razonamiento en cero disparos. En lugar de entrenarse con miles de ejemplos especializados, se les da una instrucción en lenguaje natural y un gráfico y se les pide decidir qué categoría describe mejor el comportamiento.

Construyendo una prueba justa para ojos de IA

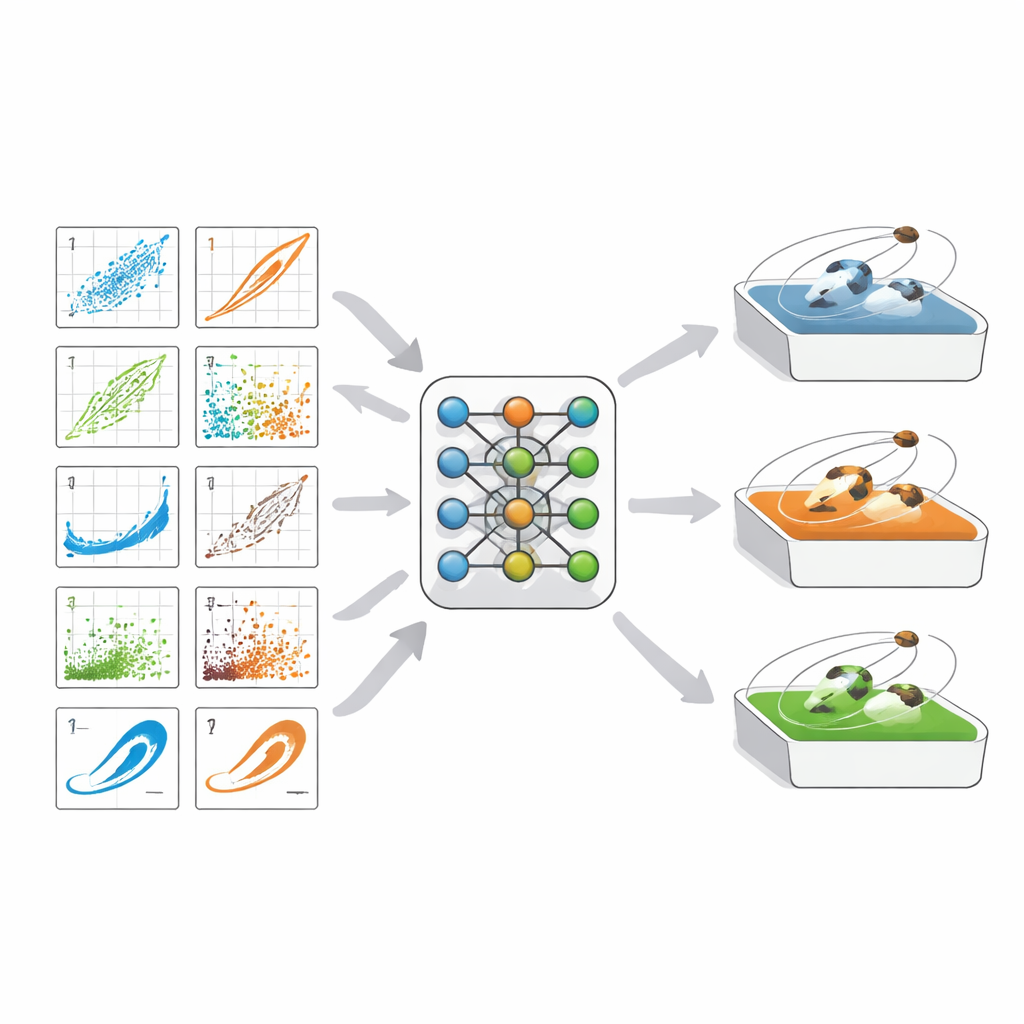

Para sondear cuán bien funcionan realmente estos modelos, los autores crearon una batería de conjuntos de imágenes de referencia que muestran ángulos resonantes tanto para resonancias de movimiento medio como secular, dos clases clave de interacciones orbitales. Cada imagen es un diagrama de dispersión de ángulo frente al tiempo compilado a partir de largas simulaciones numéricas, y cada una ha sido cuidadosamente etiquetada por expertos como resonante, no resonante, transitoria o, en los casos más extremos y límites, controvertida. Se ensamblaron cuatro conjuntos: un pequeño conjunto de “comprobación de cordura” (RB-TEST), un conjunto piloto de 50 imágenes comparable a trabajos anteriores (RB-PILOT), un conjunto de 50 imágenes lleno de casos ambiguos (RB-SMALL) y una gran colección de 450 imágenes muestreando todos los comportamientos (RB-FULL). Los autores luego proporcionaron estas imágenes a una amplia variedad de modelos: sistemas comerciales de primera línea, grandes modelos de código abierto y pequeños modelos de código abierto que pueden ejecutarse en un ordenador personal. A los modelos más grandes se les dieron instrucciones detalladas paso a paso; los más pequeños usaron un conjunto de reglas más simple y ligero.

Qué tan bien hicieron el trabajo de los astrónomos

En las pruebas más fáciles, muchos modelos —comerciales y de código abierto por igual— clasificaron cada imagen correctamente. En el conjunto de nivel medio RB-PILOT, los sistemas comerciales líderes mantuvieron puntuaciones casi perfectas, mientras que los mejores modelos de código abierto se acercaron bastante. El verdadero desafío fue RB-SMALL, donde muchos gráficos muestran mezclas de comportamientos que incluso los expertos discuten. Aquí, el mejor modelo comercial alcanzó aún alrededor del 94 por ciento en una puntuación combinada de precisión y recuperación, mientras que el mejor modelo de código abierto llegó a aproximadamente el 76 por ciento. El conjunto más grande RB-FULL confirmó este patrón: los modelos comerciales y los mejores sistemas de código abierto lograron alta precisión cuando la tarea se redujo a una decisión más simple de sí o no sobre la resonancia, con la mayoría de los errores concentrados en regímenes transitorios y de adhesión difíciles. Es notable que algunos modelos más pequeños que pueden ejecutarse localmente todavía ofrecieron un rendimiento prácticamente útil, especialmente para etiquetado sencillo de dos clases.

Qué implica esto para futuros sondeos del cielo

Para un no especialista, la conclusión es que los sistemas de IA de propósito general ya pueden mirar los mismos gráficos orbitales ruidosos que antes exigían el juicio experto humano y alcanzar conclusiones que, en muchos casos, rivalizan o incluso igualan a las herramientas tradicionales, sin haberse entrenado directamente en esa tarea. No son perfectos, especialmente cuando un asteroide solo coquetea con la resonancia en vez de comprometerse, pero ya pueden asumir gran parte de la tediosa inspección visual necesaria para grandes sondeos. El banco de pruebas publicado en este estudio ofrece a los astrónomos una manera estándar y reutilizable de evaluar nuevos modelos y elegir el equilibrio adecuado entre coste, apertura y precisión. A medida que la IA multimodal siga mejorando, es probable que se convierta en un socio de rutina para mapear la intrincada coreografía gravitatoria del Sistema Solar.

Cita: Smirnov, E., Carruba, V. Evaluating multimodal commercial and open-source large language models for dynamical astronomy: a benchmark study of resonant behavior classification. Sci Rep 16, 10785 (2026). https://doi.org/10.1038/s41598-026-45926-y

Palabras clave: resonancias orbitales, IA multimodal, dinámica de asteroides, clasificación de series temporales, modelos de lenguaje de código abierto