Clear Sky Science · de

Bewertung multimodaler kommerzieller und Open‑Source‑Großsprachmodelle für die dynamische Astronomie: Eine Benchmark‑Studie zur Klassifikation resonanter Verhaltensweisen

Warum das für Sternenbeobachter und Datenfans wichtig ist

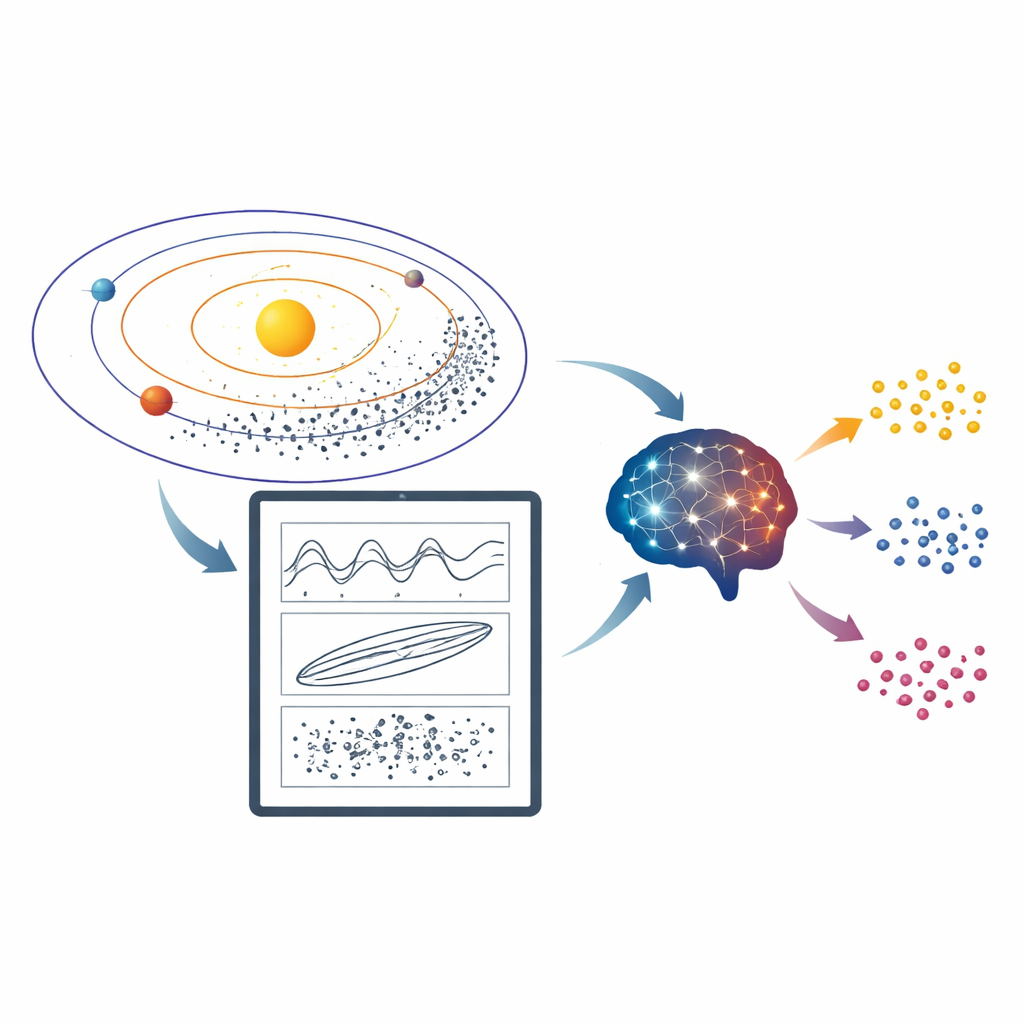

Astronominnen und Astronomen verbringen überraschend viel Zeit mit etwas, das sehr bodenständig wirkt: sie starren auf Diagramme und entscheiden, welche davon „schwingen“, welche „driften“ und welche sich chaotisch verhalten. Diese Muster verraten, ob Asteroiden in subtile Bahntänze mit den Planeten eingespannt sind, was die Entwicklung unseres Sonnensystems über Milliarden von Jahren prägt. Dieses Papier stellt eine aktuelle Frage: Können moderne KI‑Systeme, die sowohl Text als auch Bilder verstehen, diese Urteile ebenso zuverlässig wie menschliche Expertinnen und Experten fällen — ganz ohne spezielles Training?

Die verborgenen Verkehrsregeln des Sonnensystems

Viele Asteroiden umkreisen die Sonne nicht isoliert. Ihre Bahnen werden durch regelmäßige Gravitationsstöße von Planeten beeinflusst, ein Phänomen, das als Bahnresonanz bekannt ist. Wenn die Bewegung eines Asteroiden in einem einfachen Rhythmus mit der eines Planeten übereinstimmt, kann seine Bahn eingefangen, aufgeregt oder destabilisiert werden. Astronominnen und Astronomen diagnostizieren dies, indem sie über die Zeit eine Größe namens „Resonanzwinkel“ auftragen. Schwingen die Punkte im Diagramm innerhalb eines Bandes, ist das Objekt resonant; wickeln sie sich diagonal über den gesamten vertikalen Bereich, liegt keine Resonanz vor; wechseln sie hin und her, ist das Verhalten ambiger oder vorübergehend. In klaren Fällen funktionieren einfache Computerregeln gut — in dicht bevölkerten Bereichen des Weltraums, wie dem Hauptgürtel, erzeugen überlappende Einflüsse jedoch unordentliche, rauschende Plots, die sich schwer automatisch klassifizieren lassen und traditionell Expertenaugen erfordern.

Von maßgeschneiderten Algorithmen zu universeller KI

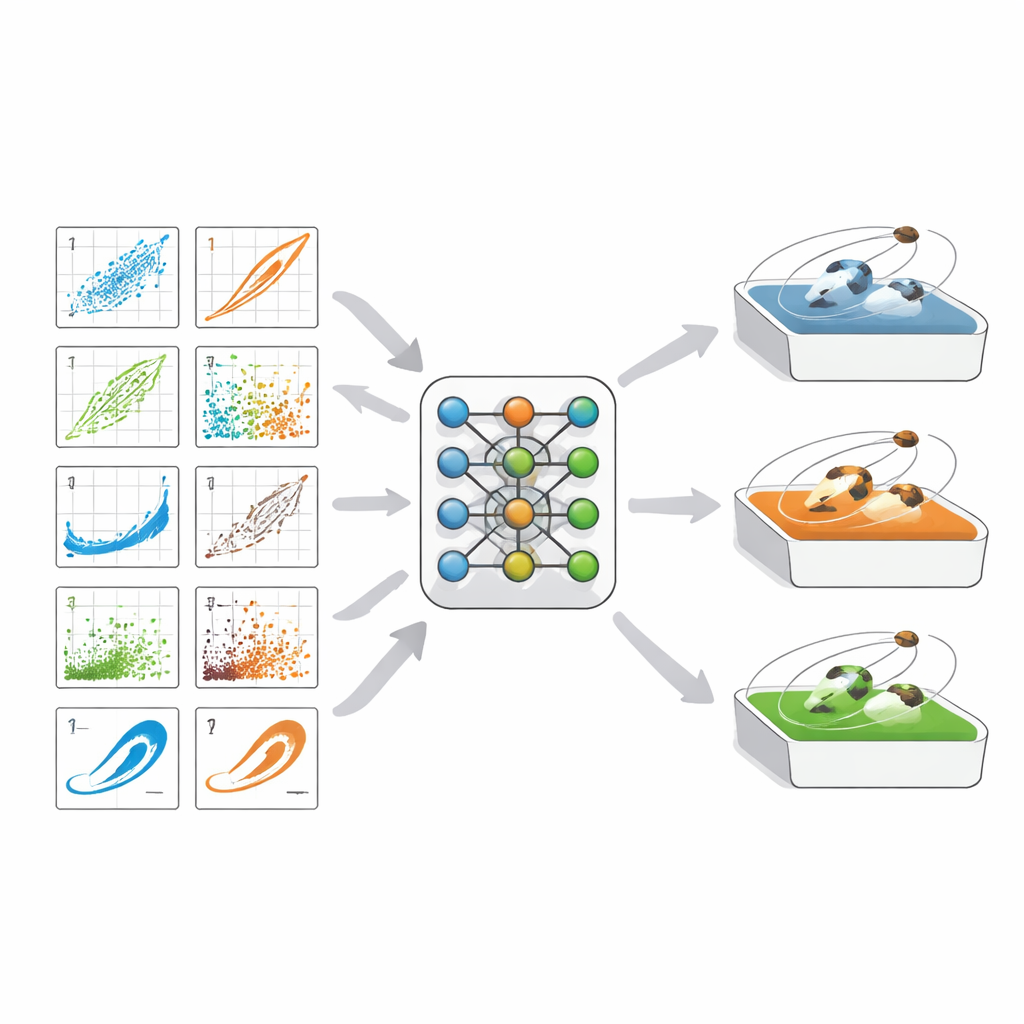

Bisher verfolgten Forschende zwei allgemeine Strategien. Klassische Machine‑Learning‑Modelle wie Entscheidungsbäume und neuronale Netze können darauf trainiert werden, bestimmte Resonanztypen zu erkennen, aber jedes neue Problem braucht einen eigenen gelabelten Datensatz, Feineinstellungen und Code. Deterministische Methoden, die auf sorgfältig entworfenen Regeln und Frequenzanalysen basieren, leisten gute Arbeit, wenn das Signal sauber ist, tun sich aber schwer, wenn Resonanzen sich überlappen oder nur vorübergehend auftreten. Beide Ansätze versagen genau dort, wo es wissenschaftlich besonders interessant ist: in Grenzfällen mit temporären Einfängen, Resonanz‑„Sticking“ und chaotischer Bewegung. Dagegen versprechen moderne Großsprachenmodelle (LLMs) mit Bildverstehensfähigkeit etwas anderes: Zero‑Shot‑Schlussfolgerungen. Anstatt auf tausenden spezialisierten Beispielen trainiert zu werden, erhalten sie eine natürliche Sprachanweisung und ein Diagramm und sollen entscheiden, welche Kategorie das Verhalten am besten beschreibt.

Ein fairer Test für die KI‑Augen

Um zu prüfen, wie gut diese Modelle wirklich sind, stellten die Autorinnen und Autoren eine Reihe von Benchmark‑Bildersätzen zusammen, die Resonanzwinkel sowohl für mittlere Bewegungs‑ (mean‑motion) als auch säkulare Resonanzen zeigen — zwei Schlüsselklassen orbitaler Wechselwirkungen. Jedes Bild ist ein Streudiagramm von Winkel gegen Zeit, zusammengestellt aus langen numerischen Simulationen, und wurde von Expertinnen und Experten sorgfältig als resonant, nicht resonant, transient oder, in den extremsten Randfällen, kontrovers beschriftet. Vier Datensätze wurden erstellt: ein winziger „Sanity‑Check“‑Satz (RB‑TEST), ein 50‑Bild‑Pilotset vergleichbar mit früheren Arbeiten (RB‑PILOT), ein 50‑Bild‑Satz voll mit mehrdeutigen Fällen (RB‑SMALL) und eine große 450‑Bild‑Sammlung, die alle Verhaltensweisen abdeckt (RB‑FULL). Die Autorinnen und Autoren fütterten diese Bilder dann in ein breites Spektrum von Modellen: erstklassige kommerzielle Systeme, große Open‑Source‑Modelle und kleine Open‑Source‑Modelle, die auf einem PC laufen können. Größere Modelle erhielten detaillierte Schritt‑für‑Schritt‑Prompts; kleinere nutzten eine einfachere, leichtere Regelmenge.

Wie gut die Maschinen die Arbeit der Astronomen erledigten

Bei den einfachsten Tests klassifizierten viele Modelle — kommerziell wie Open‑Source — jede Grafik korrekt. Im mittleren RB‑PILOT‑Satz hielten führende kommerzielle Systeme nahezu perfekte Werte, während die besten Open‑Source‑Modelle sehr nah herankamen. Die eigentliche Herausforderung war RB‑SMALL, in dem viele Plots Verhaltensgemische zeigen, über die selbst Fachleute debattieren. Hier erreichte das beste kommerzielle Modell noch etwa 94 Prozent auf einer kombinierten Metrik aus Präzision und Recall, während das beste Open‑Source‑Modell rund 76 Prozent erreichte. Der größere RB‑FULL‑Satz bestätigte dieses Muster: Kommerzielle Modelle und führende Open‑Source‑Systeme erzielten beide hohe Genauigkeit, wenn die Aufgabe auf eine vereinfachte Ja‑oder‑Nein‑Entscheidung über Resonanz reduziert wurde, wobei die meisten Fehler in den kniffligen transienten und Sticking‑Regimen konzentriert waren. Bemerkenswert ist, dass einige kleinere lokal laufende Modelle praktisch nützliche Leistungen lieferten, insbesondere für einfache Zwei‑Klassen‑Etikettierung.

Was das für kommende Himmelsdurchmusterungen bedeutet

Für Nicht‑Spezialisten lautet die Schlussfolgerung: Allgemein einsetzbare KI‑Systeme können inzwischen dieselben verrauschten Bahndiagramme betrachten, die früher fachkundige menschliche Beurteilung erforderten, und in vielen Fällen zu Schlussfolgerungen kommen, die mit traditionellen Werkzeugen konkurrieren oder sie erreichen — ohne direkt für diese Aufgabe trainiert worden zu sein. Sie sind nicht perfekt, besonders wenn ein Asteroid nur mit einer Resonanz spielt, statt sich fest daran zu binden, aber sie können bereits einen großen Teil der mühsamen visuellen Kontrolle für große Durchmusterungen übernehmen. Der in dieser Studie veröffentlichte Benchmark bietet Astronominnen und Astronomen eine standardisierte, wiederverwendbare Möglichkeit, neue Modelle zu testen und den passenden Kompromiss zwischen Kosten, Offenheit und Genauigkeit zu wählen. Während multimodale KI sich weiter verbessert, wird sie voraussichtlich zu einer routinemäßigen Partnerin bei der Kartierung der komplexen gravitativen Choreographie des Sonnensystems.

Zitation: Smirnov, E., Carruba, V. Evaluating multimodal commercial and open-source large language models for dynamical astronomy: a benchmark study of resonant behavior classification. Sci Rep 16, 10785 (2026). https://doi.org/10.1038/s41598-026-45926-y

Schlüsselwörter: Bahnmessige Resonanzen, multimodale KI, Asteroidendynamik, Zeitreihenklassifikation, Open‑Source‑Sprachmodelle