Clear Sky Science · es

Mecanismo de atención mixta y aprendizaje multitarea para el reconocimiento del plano abdominal fetal estándar y la detección de estructuras anatómicas clave

Ayudando a los médicos a ver antes del nacimiento

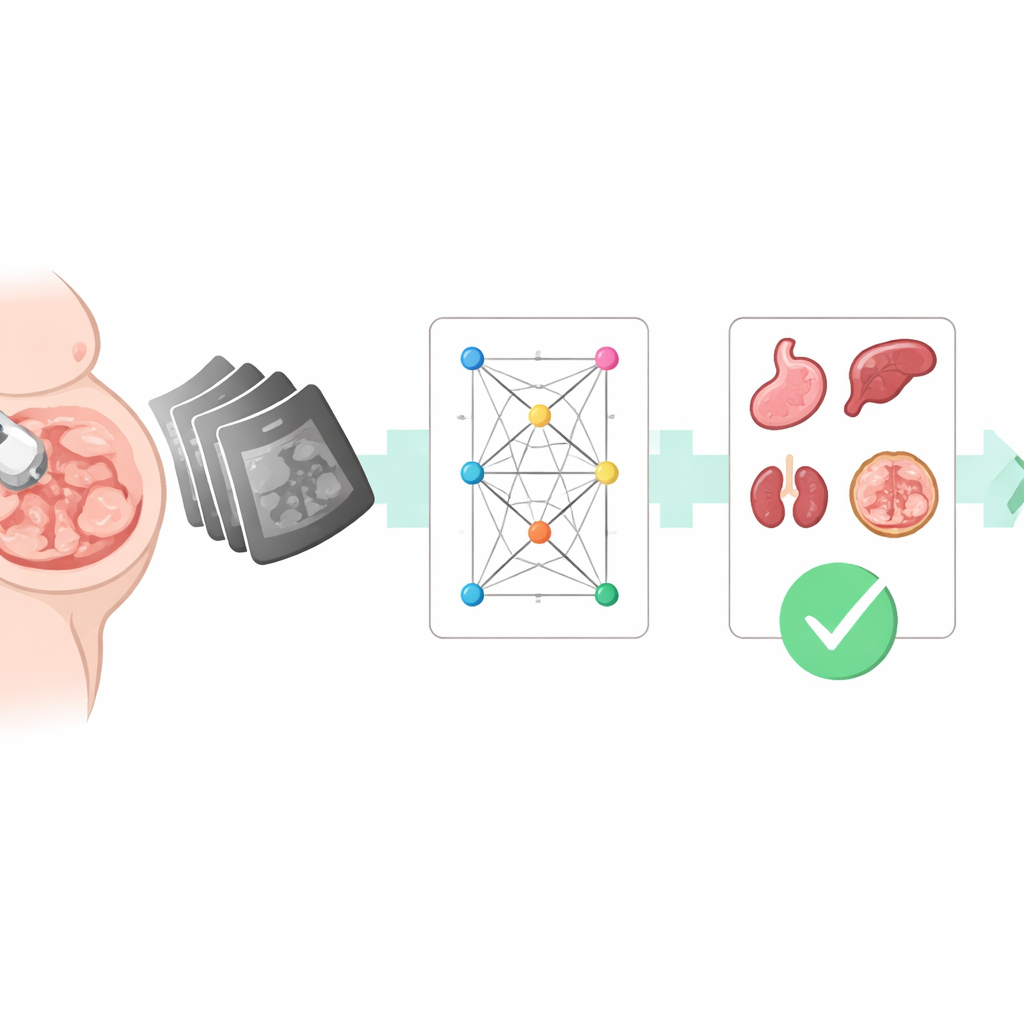

La ecografía prenatal es una de las primeras ventanas que tienen los padres y los médicos para conocer la salud de un bebé. Pero interpretar esas imágenes granuladas en blanco y negro es una habilidad que lleva años dominar, y los pequeños detalles pueden marcar la diferencia entre detectar un problema a tiempo o pasarlo por alto. Este estudio presenta un sistema informático diseñado para ayudar: una herramienta de inteligencia artificial que puede reconocer rápidamente vistas estándar del abdomen fetal y destacar los órganos clave que los médicos buscan durante las ecografías rutinarias del embarazo.

Por qué importan las vistas estándar

Cuando una mujer embarazada se somete a una ecografía a mitad del embarazo, el clínico no se limita a “mirar alrededor”. Busca deliberadamente un conjunto de vistas estándar del feto. Para el abdomen, estas incluyen cortes transversales usados para medir el tamaño abdominal, vistas centradas en la vejiga, el cordón umbilical y varios ángulos de los riñones y la columna. En conjunto, estos planos permiten a los médicos estimar el crecimiento, comprobar problemas estructurales y evaluar riesgos relacionados con el parto. Obtener cada vista estándar requiere movimientos precisos de la mano y un buen conocimiento de la anatomía, y rebanadas de aspecto similar pueden confundirse con facilidad, sobre todo para el personal menos experimentado o cuando las imágenes son ruidosas.

Convertir imágenes ecográficas en datos

Para entrenar a un ordenador que ayude en esta tarea, los investigadores primero reunieron una amplia colección de imágenes del mundo real. Durante cuatro años, recopilaron más de 6.700 imágenes abdominales de ecografías procedentes de más de 3.100 gestantes en varios hospitales, usando distintos aparatos. Médicos ecografistas experimentados trazaron cuidadosamente 14 estructuras anatómicas clave en cada imagen —como el estómago, la vejiga, los riñones, los principales vasos sanguíneos, la columna, las costillas y el cordón umbilical— y etiquetaron cuál de las siete vistas abdominales estándar representaba cada imagen. Este proceso de etiquetado, intensivo en mano de obra, creó un “mapa” detallado que relaciona patrones de píxeles con estructuras de significado clínico.

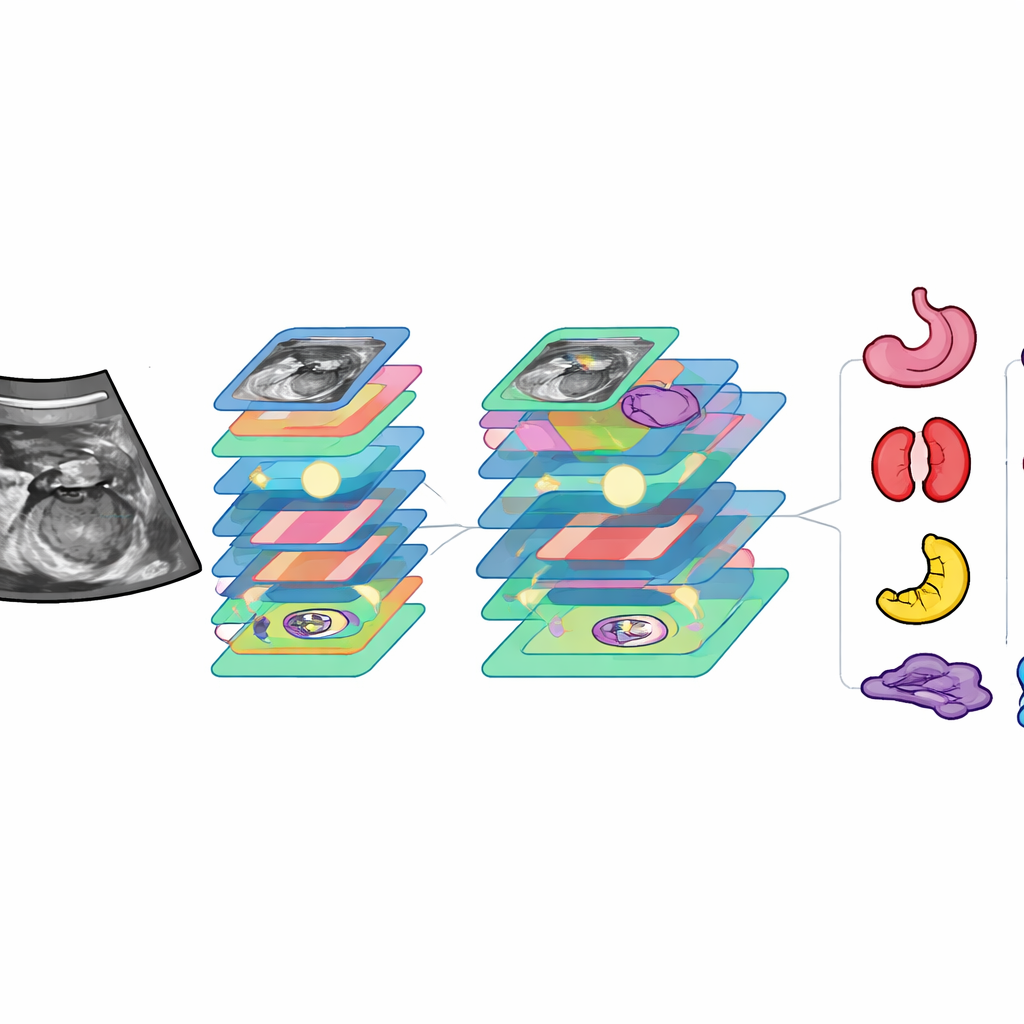

Una IA con doble propósito y atención focalizada

Partiendo de este conjunto de datos, el equipo desarrolló un modelo de aprendizaje profundo al que denominan FAUSP‑NET. A diferencia de los sistemas que realizan solo una tarea, FAUSP‑NET es una red multitarea: en una sola pasada dibuja cajas alrededor de los órganos clave y decide a qué vista estándar pertenece la imagen. En su interior, el modelo usa una columna vertebral moderna de detección de objetos, mejorada con varios componentes de “atención” que le ayudan a centrarse en las regiones y escalas más informativas. Algunos bloques de atención enfatizan diferencias sutiles entre estructuras de aspecto parecido (por ejemplo, riñón izquierdo frente a derecho, o cordón umbilical frente a vasos próximos), mientras que otros se adaptan a órganos de tamaños muy distintos. Una función de pérdida diseñada específicamente ayuda al sistema a aprender de las estructuras raras o difíciles de ver, mejorando la precisión con la que las delimita.

Qué tan bien funciona el sistema

Una vez entrenado, FAUSP‑NET se probó en imágenes reservadas y se comparó con 24 modelos de visión por ordenador existentes, incluidos detectores de objetos e clasificadores de imágenes populares. Demostró ser más preciso que todos ellos tanto en la detección de órganos como en el reconocimiento de vistas estándar. En la detección de órganos, coincidió correctamente con las marcaciones de los médicos en la gran mayoría de los casos y manejó la mayoría de las estructuras con fiabilidad casi perfecta; solo las características más tenues y pequeñas, como ciertos vasos y el diafragma, siguieron siendo un reto. En el reconocimiento de vistas, el sistema clasificó correctamente las imágenes como una de las siete planos abdominales en más del 97% de los casos. En hardware estándar, procesó cada imagen en alrededor de 24 milisegundos, lo suficientemente rápido para su uso en tiempo real durante un examen.

Comparando la IA con expertos humanos

Para evaluar cómo se compara esta herramienta con los clínicos reales, los investigadores la probaron con un conjunto completamente separado de imágenes procedentes de otro hospital y compararon su rendimiento con el de médicos ecografistas de nivel junior, intermedio y sénior. La precisión de FAUSP‑NET en la detección de estructuras e identificación de vistas estándar se acercó o igualó a la de médicos sénior experimentados, y superó claramente a la de los profesionales menos experimentados. De forma crucial, el sistema completó su análisis en menos de una centésima parte del tiempo que un médico sénior necesitaba para revisar los mismos casos. Técnicas de visualización mostraron que el modelo tiende a centrarse en las mismas regiones en las que confían los expertos humanos, lo que respalda su interpretabilidad y su posible aceptación en la práctica clínica.

Qué significa esto para las familias expectantes

En términos cotidianos, este trabajo muestra que un sistema de IA cuidadosamente entrenado puede actuar como un segundo par de ojos durante las ecografías prenatales del abdomen fetal. FAUSP‑NET puede señalar rápidamente si se ha capturado la vista abdominal correcta y si los órganos cruciales son claramente visibles, ayudando a los ecografistas menos experimentados a evitar errores y liberando a los especialistas para que se concentren en los casos complejos. Aunque aún se necesitan pruebas adicionales en más hospitales y con más aparatos, la tecnología apunta hacia un futuro en el que las ecografías rutinarias del embarazo sean más consistentes, rápidas y menos dependientes de quién sostenga la sonda, lo que podría mejorar la atención de madres y bebés por igual.

Cita: Li, Y., Huang, Y., Liu, Z. et al. Mixed attention mechanism multi-task learning for fetal abdominal standard plane recognition and key anatomical structure detection. Sci Rep 16, 12324 (2026). https://doi.org/10.1038/s41598-026-40590-8

Palabras clave: ecografía prenatal, abdomen fetal, aprendizaje profundo, detección de planos estándar, análisis de imágenes médicas