Clear Sky Science · de

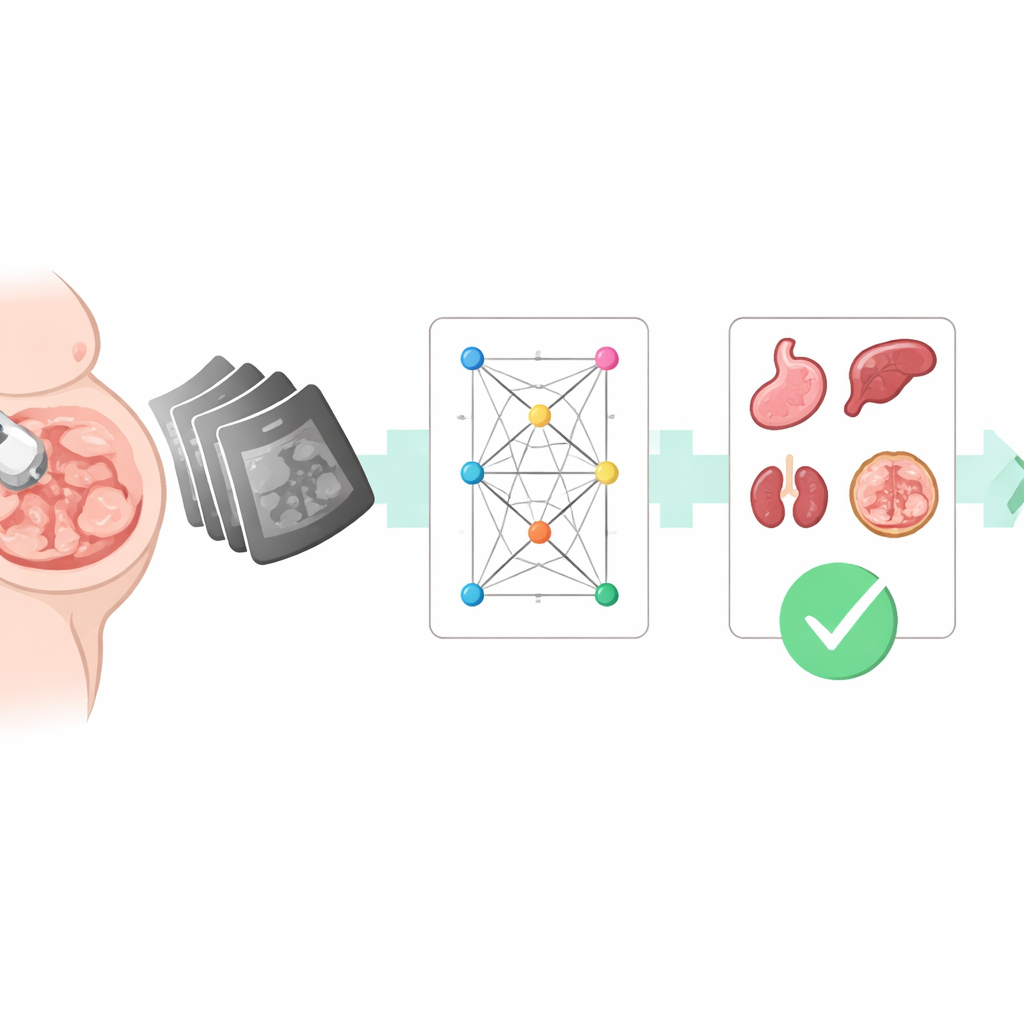

Gemischter Aufmerksamkeitsmechanismus für Multi‑Task‑Learning zur Erkennung standardisierter fetaler Abdomenebenen und Erkennung wichtiger anatomischer Strukturen

Ärzten vor der Geburt besser sehen helfen

Der pränatale Ultraschall ist eines der ersten Fenster, das Eltern und Ärzten Einblick in die Gesundheit eines Babys gibt. Das Lesen dieser körnigen Schwarz‑weiß‑Bilder ist jedoch eine Fertigkeit, die Jahre der Übung erfordert, und kleine Details können darüber entscheiden, ob ein Problem früh erkannt oder übersehen wird. Diese Studie stellt ein Computersystem vor, das helfen soll: ein KI‑Werkzeug, das standardisierte Ansichten des kindlichen Abdomens schnell erkennt und die wichtigsten Organe hervorhebt, auf die Ärzte bei routinemäßigen Schwangerschaftsuntersuchungen achten.

Warum standardisierte Ansichten wichtig sind

Wenn eine werdende Mutter in der Schwangerschaft einen Ultraschall erhält, „schaut“ der Untersucher nicht einfach zufällig herum. Er sucht gezielt nach einer Reihe standardisierter Ebenen des Fötus. Für das Abdomen gehören dazu Querschnitte zur Messung des Bauchumfangs, Aufnahmen mit Fokus auf die Blase, die Nabelschnur sowie mehrere Blickwinkel auf Nieren und Wirbelsäule. Zusammengenommen erlauben diese Ebenen Ärzten, das Wachstum abzuschätzen, strukturelle Probleme zu prüfen und geburtsbezogene Risiken zu bewerten. Das Erreichen jeder standardisierten Ansicht erfordert präzise Handbewegungen und ein solides anatomisches Verständnis; ähnlich wirkende Schnitte können leicht verwechselt werden – vor allem bei weniger erfahrenem Personal oder bei verrauschten Bildern.

Ultraschallbilder in Daten verwandeln

Um einen Computer für diese Aufgabe zu trainieren, stellten die Forscher zunächst eine große Sammlung realer Bilder zusammen. Innerhalb von vier Jahren sammelten sie mehr als 6.700 abdominale Ultraschallbilder von über 3.100 schwangeren Frauen in mehreren Krankenhäusern und an unterschiedlichen Geräten. Erfahrene Ultraschallärzte zeichneten auf jedem Bild 14 wichtige anatomische Strukturen nach – etwa Magen, Blase, Nieren, große Gefäße, Wirbelsäule, Rippen und Nabelschnur – und kennzeichneten, welche der sieben standardisierten abdominalen Ebenen jedes Bild darstellte. Dieser arbeitsintensive Beschriftungsprozess schuf eine reichhaltige „Karte“, die Pixelmuster mit klinisch bedeutsamen Strukturen verknüpft.

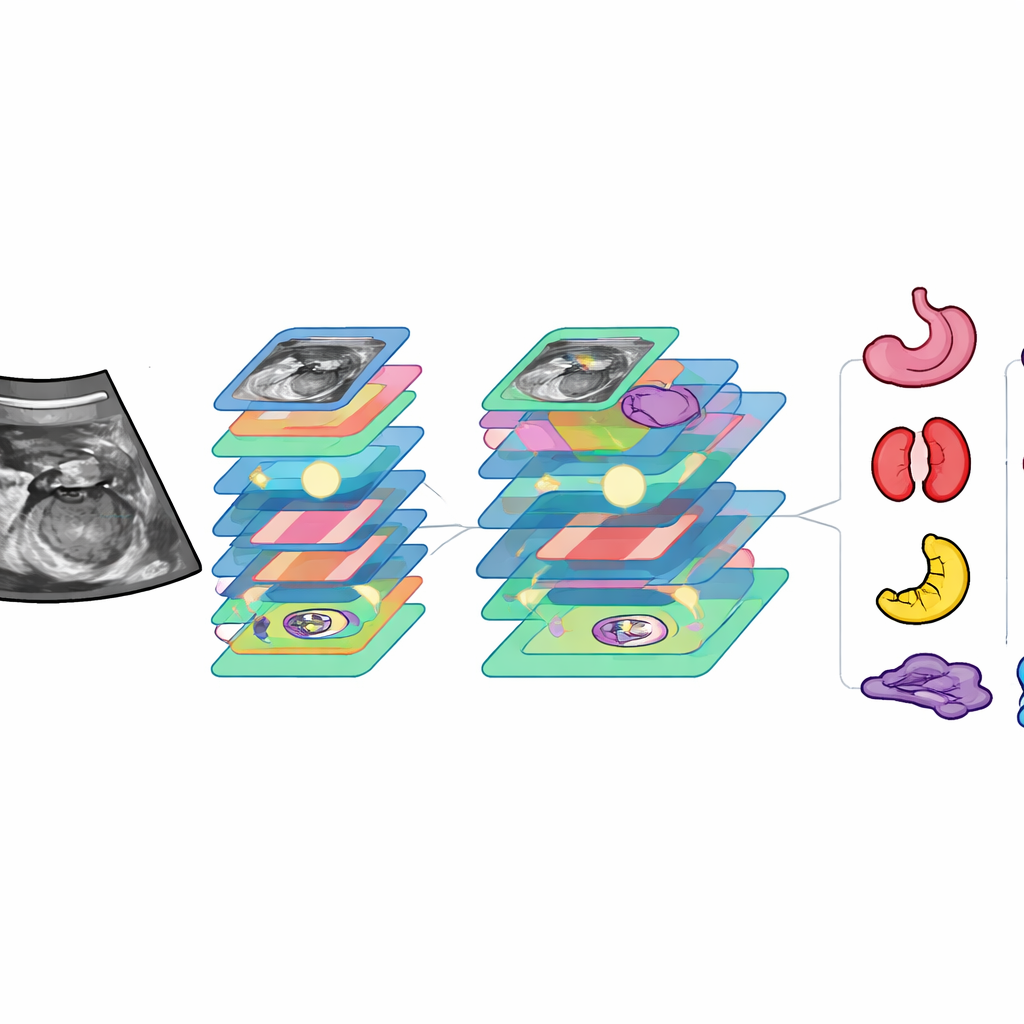

Eine doppelt nutzbare KI mit gezielter Aufmerksamkeit

Auf Basis dieses Datensatzes entwickelte das Team ein Deep‑Learning‑Modell, das sie FAUSP‑NET nennen. Im Gegensatz zu Systemen, die nur eine Aufgabe erfüllen, ist FAUSP‑NET ein Multi‑Task‑Netzwerk: in einem Durchgang zieht es sowohl Begrenzungsrahmen um Schlüsselorgane als auch bestimmt, zu welcher standardisierten Ansicht das Bild gehört. Im Kern nutzt das Modell eine moderne Objekt‑Erkennungs‑Backbone, ergänzt durch mehrere „Aufmerksamkeits“-Komponenten, die ihm helfen, sich auf die informativsten Regionen und Maßstäbe zu konzentrieren. Einige Aufmerksamkeitsblöcke betonen feine Unterschiede zwischen ähnlich aussehenden Strukturen (zum Beispiel linke versus rechte Niere oder Nabelschnur versus benachbarte Gefäße), während andere sich an Organe sehr verschiedener Größe anpassen. Eine speziell entworfene Verlustfunktion hilft dem System, von seltenen oder schwer erkennbaren Strukturen zu lernen und verbessert so die Präzision ihrer Umrissgebung.

Wie gut das System funktioniert

Nach dem Training wurde FAUSP‑NET an zurückgehaltenen Bildern getestet und mit 24 bestehenden Computer‑Vision‑Modellen verglichen, darunter verbreitete Objektdetektoren und Bildklassifikatoren. Es erwies sich als genauer als alle diese Modelle sowohl bei der Erkennung von Organen als auch bei der Klassifikation standardisierter Ansichten. Bei der Organerkennung stimmten die Erkennungen in der großen Mehrzahl der Fälle mit den Markierungen der Ärzte überein, und die meisten Strukturen wurden mit nahezu perfekter Zuverlässigkeit erfasst; nur die schwächsten, kleinsten Merkmale, wie bestimmte Gefäße und das Zwerchfell, blieben herausfordernd. Bei der Ansichtserkennung klassifizierte das System Bilder in mehr als 97 % der Fälle korrekt einer der sieben abdominalen Ebenen zu. Auf Standardhardware verarbeitete es jedes Bild in etwa 24 Millisekunden – schnell genug für die Echtzeitanwendung während einer Untersuchung.

Vergleich von KI und menschlichen Experten

Um zu prüfen, wie sich dieses Werkzeug gegenüber klinischen Anwendern verhält, bewerteten die Forscher es an einem vollständig separaten Bildsatz aus einem anderen Krankenhaus und verglichen die Leistung mit der von Assistenz-, Fach‑ und Oberärzten. FAUSP‑NETs Genauigkeit bei der Strukturerkennung und der Identifikation standardisierter Ansichten kam an die erfahrener Oberärzte heran oder erreichte deren Niveau und übertraf deutlich die Leistung weniger erfahrener Ärzte. Entscheidend ist, dass das System seine Analyse in weniger als einem Hundertstel der Zeit abschloss, die ein Oberarzt für dieselben Fälle benötigte. Visualisierungsmethoden zeigten, dass sich das Modell tendenziell auf dieselben Bereiche konzentriert wie menschliche Experten, was seine Interpretierbarkeit und mögliche Akzeptanz in der klinischen Praxis unterstützt.

Was das für werdende Familien bedeutet

Einfach gesagt zeigt diese Arbeit, dass ein sorgfältig trainiertes KI‑System während pränataler Ultraschalluntersuchungen des kindlichen Abdomens als zweite Augenpaar dienen kann. FAUSP‑NET kann schnell melden, ob die richtige abdominale Ansicht erfasst wurde und ob entscheidende Organe klar sichtbar sind, wodurch weniger erfahrene Sonographen Fehler vermeiden und Spezialisten sich auf komplexe Fälle konzentrieren können. Zwar sind weitere Tests über mehr Krankenhäuser und Geräte hinweg nötig, doch die Technologie weist in eine Zukunft, in der routinemäßige Schwangerschaftsultraschalluntersuchungen konsistenter, schneller und weniger abhängig von der Person an der Sonde sind – womöglich verbessert sie so die Versorgung von Müttern und Babys gleichermaßen.

Zitation: Li, Y., Huang, Y., Liu, Z. et al. Mixed attention mechanism multi-task learning for fetal abdominal standard plane recognition and key anatomical structure detection. Sci Rep 16, 12324 (2026). https://doi.org/10.1038/s41598-026-40590-8

Schlüsselwörter: pränatale Ultraschalluntersuchung, fetales Abdomen, Deep Learning, Erkennung standardisierter Ebenen, medizinische Bildanalyse