Clear Sky Science · es

Deconvolución dual en iluminación estructurada multiphotónica para imágenes de superresolución en tejidos profundos

Ver más profundo en tejidos vivos

La biología moderna suele depender de observar los detalles más diminutos dentro de piezas gruesas de tejido, como cortes cerebrales o embriones en desarrollo. Desafortunadamente, a medida que la luz atraviesa estos entornos densos se dobla y se dispersa, haciendo que las imágenes se vuelvan borrosas justo cuando los científicos más necesitan vistas nítidas. Este artículo presenta una forma de «desempañar» digitalmente esas imágenes, permitiendo que un microscopio avanzado estándar revele estructuras extremadamente finas en lo profundo del tejido sin añadir hardware costoso o complejo.

Por qué la imagen en profundidad es tan difícil

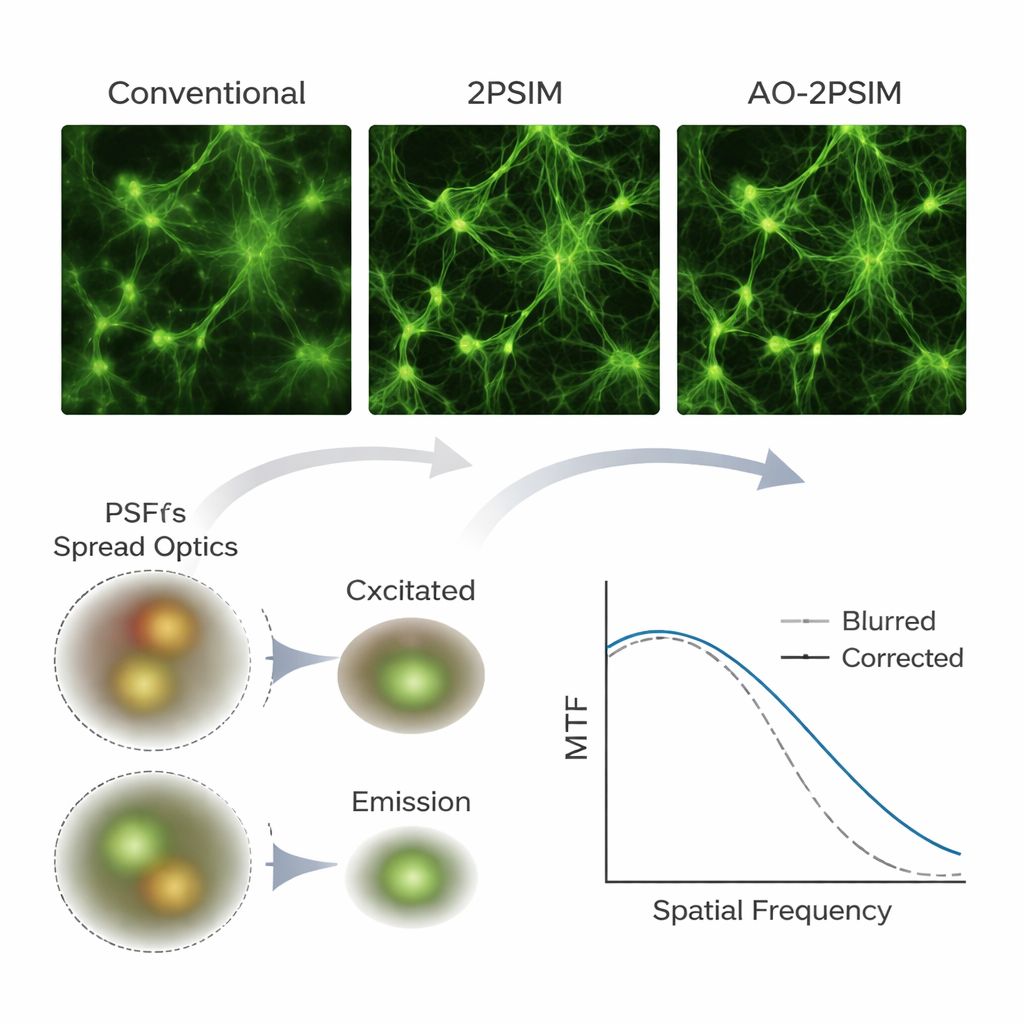

Los microscopios de fluorescencia permiten a los investigadores etiquetar moléculas específicas y observar cómo se estructuran y comportan las células y los tejidos. En las últimas décadas, varios métodos de “superresolución” han superado los límites tradicionales de nitidez, revelando detalles muy por debajo de los 200 nanómetros. Sin embargo, la mayoría de estos métodos funcionan bien sólo cerca de la superficie de la muestra. En tejidos gruesos, como el cerebro de ratón, la luz usada para excitar las etiquetas fluorescentes y la luz emitida de vuelta al detector se distorsionan por pequeñas variaciones en la estructura del tejido. Estas distorsiones, llamadas aberraciones, desenfocan la imagen del microscopio y borran la información de alto detalle, especialmente a profundidades superiores a varias decenas de micrómetros.

De las correcciones de hardware a una solución por software

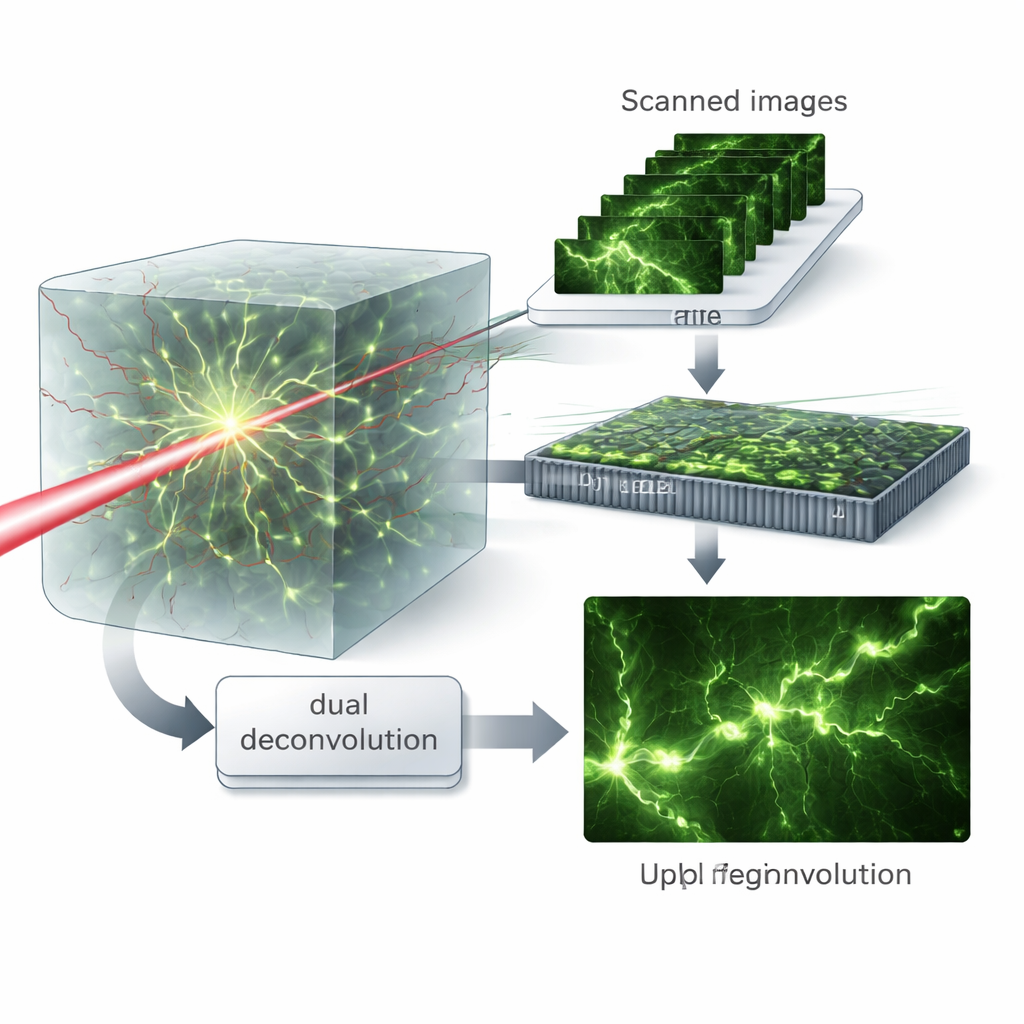

Una forma popular de combatir las aberraciones es la óptica adaptativa basada en hardware, que usa espejos móviles u otros dispositivos para remodelar el frente de onda de la luz y restaurar un enfoque nítido. Aunque poderosa, esta tecnología es cara, técnicamente exigente y a menudo sólo corrige distorsiones para un color o una dirección de la luz a la vez. Los autores proponen en cambio un enfoque computacional que funciona con un tipo de microscopio ya común en muchos laboratorios: el microscopio de escaneo por láser multiphotónico. Sustituyendo el detector único habitual por una cámara, registran una rica pila de imágenes escaneadas que codifica cómo tanto la luz de excitación entrante como la fluorescencia saliente han sido distorsionadas por el tejido.

Patrones virtuales y limpieza dual

La idea clave es tratar las imágenes escaneadas como si la muestra hubiese sido iluminada con muchos patrones finos de luz distintos, un concepto que los autores llaman iluminación estructurada virtual. Recombinar matemáticamente estos datos en el dominio de la frecuencia permite separar los papeles de los procesos de excitación y emisión. Luego introducen un algoritmo de “deconvolución dual” que estima y corrige de forma alterna el desenfoque de cada lado —la luz entrante y la saliente— en lugar de agruparlos en un único desenfoque efectivo. Este tratamiento matricial preserva más detalles de alta frecuencia y permite al algoritmo recuperar estructuras finas incluso cuando las aberraciones son fuertes.

Vistas más nítidas en simulaciones y muestras reales

Para evaluar su método, el equipo primero usó simulaciones por ordenador de microscopía de dos fotones, una técnica de imagen profunda que emplea pares de fotones de menor energía para excitar la fluorescencia sólo en el punto de foco. Bajo distorsiones severas simuladas, las reconstrucciones convencionales de dos fotones y la iluminación estructurada estándar produjeron imágenes visiblemente borrosas. En contraste, la deconvolución dual restituyó patrones nítidos cuya resolución se acercó a una cuarta parte de la longitud de onda de la fluorescencia —unos 130 nanómetros—, acorde con las expectativas teóricas. Posteriormente, los autores construyeron un montaje de dos fotones personalizado con una cámara científica y aplicaron su algoritmo a muestras reales, incluyendo microesferas fluorescentes, patrones de prueba ocultos tras capas dispersantes, células cultivadas, tejido cerebral de ratón y peces cebra en montaje entero. Una y otra vez, estructuras que aparecían difusas o duplicadas en las imágenes convencionales emergieron como rasgos claramente separados tras el procesamiento, y elementos neuronales finos como las espinas dendríticas permanecieron resolubles a profundidades de hasta 180 micrómetros en cerebro de ratón.

Qué implica esto para la imagen biológica

Para quienes no son especialistas, el mensaje principal es que los autores han demostrado cómo convertir microscopios multiphotónicos existentes en herramientas de imagen en tejido profundo mucho más potentes usando principalmente software y una mejora con cámara. Al modelar y corregir cuidadosamente cómo los tejidos desvían la luz tanto a la entrada como a la salida, su enfoque de deconvolución dual duplica el límite de resolución habitual en muestras gruesas y desafiantes sin depender de espejos adaptativos complejos. Aunque el método sigue dependiendo de recopilar suficiente señal y actualmente requiere escaneos relativamente lentos, ofrece una vía práctica y rentable hacia vistas ultra‑nítidas tridimensionales del cerebro y otros órganos, abriendo la puerta a estudios más detallados sobre cómo se organizan y cambian las estructuras biológicas a lo largo del tiempo.

Cita: Lim, S., Kang, S., Hong, J.H. et al. Dual deconvolution in multiphoton structured illumination microscopy for deep-tissue super-resolution imaging. Nat Commun 17, 2123 (2026). https://doi.org/10.1038/s41467-026-69798-y

Palabras clave: microscopía de superresolución, imagen por dos fotones, óptica adaptativa, imagen en tejidos profundos, imagen computacional