Clear Sky Science · de

Ein kontrastives Lernframework mit adaptiver Merkmalsfusion zur Klassifikation von Hirntumoren

Warum ein klügeres Lesen von Hirnscans wichtig ist

Hirntumoren sind nicht nur gefährlich, weil sie lebenswichtiges Gewebe infiltrieren, sondern auch, weil sie auf medizinischen Bildern schwer zu unterscheiden sein können. Ärztinnen und Ärzte verlassen sich stark auf MRT-Aufnahmen, um das Schweregrad eines Tumors und die passende Behandlung zu bestimmen. Dennoch können Tumoren, die sich im Körper sehr unterschiedlich verhalten, auf dem Bild überraschend ähnlich aussehen. Diese Studie stellt eine neue computergestützte Methode vor, die lernt, subtile Unterschiede in MRT-Bildern zu erkennen, mit dem Ziel, Ärzten eine schnellere und zuverlässigere Tumorklassifikation zu ermöglichen.

Die Herausforderung im Schädel sichtbar machen

Hirntumoren entstehen, wenn Zellen im Schädel unkontrolliert wachsen, auf benachbarte Bereiche drücken und Symptome wie Kopfschmerzen, Anfälle oder Sehstörungen verursachen. Auf MRT-Aufnahmen überlappen sich drei häufige Tumorarten – Meningeom, Gliom und Hypophysentumor – oft im Erscheinungsbild. Erschwerend kommt hinzu, dass Krankenhäuser das Gehirn aus mehreren Ebenen aufnehmen (axial, koronial, sagittal), sodass derselbe Tumor von Schnitt zu Schnitt sehr unterschiedlich aussehen kann. Bestehende Deep-Learning-Systeme erkennen grobe Muster in diesen Bildern, übersehen jedoch häufig die sehr feinen Details in Form, Randführung und Textur, die eine Tumorart von der anderen unterscheiden.

Ein neuer Weg, Computern beizubringen, worauf sie achten sollen

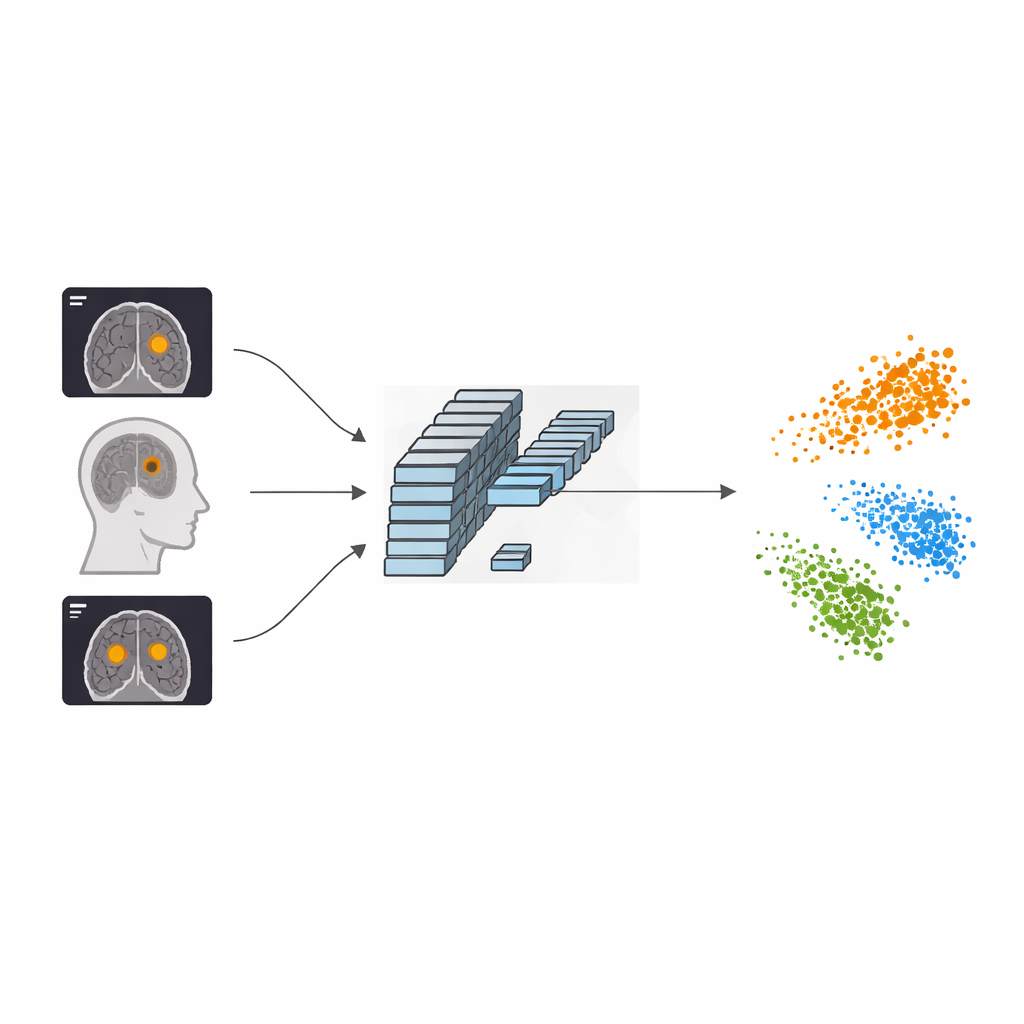

Die Autoren schlagen ein Framework namens AFF-CL vor, das die Art und Weise verändert, wie ein neuronales Netzwerk aus MRT-Scans lernt. Anstatt nur zu lernen, ein Bild einem Label zuzuordnen (zum Beispiel „Gliom“), lernt das System zusätzlich durch Kontrastierung von Bildern untereinander. Es baut eine Art Memory-Queue auf, die Merkmalsfingerabdrücke vieler früherer Bilder zusammen mit ihren Tumortypen speichert. Wenn ein neuer Scan eingeht, vergleicht das Modell seinen internen Fingerabdruck nicht nur mit einem Partnerbild, sondern mit vielen gespeicherten Beispielen derselben und anderer Tumortypen. Merkmale derselben Kategorie werden einander angenähert, während Merkmale unterschiedlicher Kategorien auseinander gedrängt werden, was dem Computer hilft, in seiner internen „Karte“ der Bilder klarere Grenzen zwischen Tumorklassen zu ziehen.

Das Gehirn sowohl im Überblick als auch im Detail betrachten

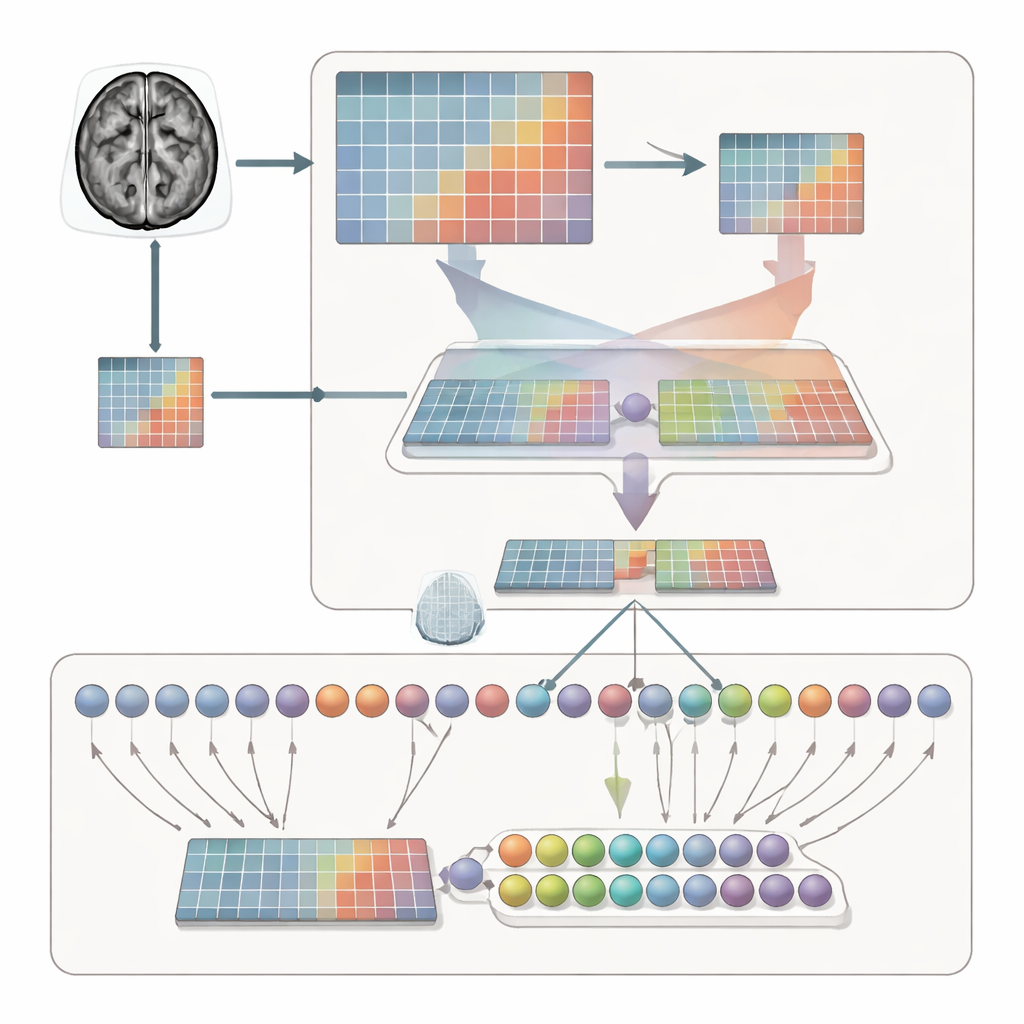

Allein das Separieren von Kategorien reicht nicht aus; das System muss auch lernen, wo es innerhalb jeder MRT-Scheibe hinschauen soll. Dazu verarbeitet das Framework jeden Scan auf zwei komplementäre Arten. Ein Pfad sieht das ganze Gehirn und erfasst Kontext, Größe und Lage des Tumors. Der andere Pfad zoomt in einen ausgeschnittenen Bereich hinein und zwingt das Modell dazu, lokale Struktur, Kanten und Texturen zu untersuchen. Ein adaptives Merkmalsfusionsmodul (AFF) agiert dann wie ein intelligenter Mischer und entscheidet Punkt für Punkt, wie viel auf die Gesamtansicht gegenüber der Nahaufnahme zu vertrauen ist. Mithilfe eines eingebauten Aufmerksamkeitsmechanismus verstärkt es Signale, wo lokale Details entscheidend sind, und stützt sie mit dem breiteren anatomischen Kontext, wodurch eine reichhaltigere kombinierte Darstellung für die finale Klassifikation entsteht.

Die Methode auf die Probe stellen

Die Forschenden evaluierten AFF-CL an einem weit verbreiteten öffentlichen Datensatz mit 3.064 Hirn-MRT-Bildern von 233 Patientinnen und Patienten. Der Datensatz enthält die drei Haupttumorarten und Aufnahmen aus mehreren Blickwinkeln. Nach dem Training erreichte die neue Methode etwa 99,35% Genauigkeit und übertraf damit viele aktuelle Deep-Learning-Ansätze, die auf tiefere Netze oder herkömmliche Attention-Mechanismen setzen. Die Autoren zeigten außerdem, dass ihr Ansatz die Leistung über verschiedene Backbone-Architekturen hinweg verbessert – von leichten Faltungsnetzen, die für kleinere Kliniken geeignet sind, bis zu fortgeschritteneren Transformermodellen. Visualisierungen der internen Netzwerkaktivität deuten darauf hin, dass sich mit AFF-CL die Aufmerksamkeit stärker auf die tatsächlichen Tumorregionen konzentriert und die drei Tumortypen im Merkmalsraum in klar definierten Clustern getrennt werden.

Was das für Patientinnen, Patienten und Kliniken bedeutet

Für Nicht-Fachleute ist die Kernbotschaft, dass AFF-CL Computern hilft, Hirntumoren in MRT-Bildern mit außergewöhnlicher Präzision zu erkennen, indem es Bilder intelligenter vergleicht und „aufgeweitete“ sowie „herangezoomte“ Blickwinkel des Gehirns kombiniert. Obwohl die Methode derzeit mehr Rechenleistung zum Training benötigt und noch strengere Tests auf Patientenebene erfordert, übertrifft sie bereits bestehende Werkzeuge in zwei verschiedenen Datensätzen. Langfristig könnten solche Systeme als zweite Augen für Radiologinnen und Radiologen dienen, Fehlinterpretationen reduzieren, Behandlungsentscheidungen beschleunigen und fortgeschrittene Hirntumoranalyse in einer größeren Zahl von Krankenhäusern zugänglicher machen.

Zitation: Peng, Y., He, S. & Chang, L. A contrastive learning framework with adaptive feature fusion for brain tumor classification. Sci Rep 16, 14504 (2026). https://doi.org/10.1038/s41598-026-44887-6

Schlüsselwörter: Hirntumor-MRT, Deep-Learning-Diagnostik, medizinische Bildanalyse, kontrastives Lernen, Merkmalsfusion