Clear Sky Science · de

Ein intelligentes monokulares Sichtmetrologie‑System auf Computerbasis für den Standweitsprung

Warum die Sprungweite wichtig ist

Der Standweitsprung ist eine der einfachsten Methoden, mit denen Schulen weltweit die Fitness von Schülern prüfen: an einer Linie stehen, so weit wie möglich springen und die Distanz messen. In überfüllten Pausenhöfen kann dieser vermeintlich einfache Test jedoch unordentlich werden. Lehrkräfte bücken sich noch immer mit Maßbändern, Messentscheidungen sind anfechtbar, und das Erfassen Tausender Sprünge ist langsam und ermüdend. Diese Studie stellt ein kamera‑basiertes System vor, das aus gewöhnlichem Video automatisch und präzise die Sprungweite bestimmt und schnellere, objektivere Tests ohne teure Spezialhardware verspricht.

Vom Maßband zur intelligenten Kamera

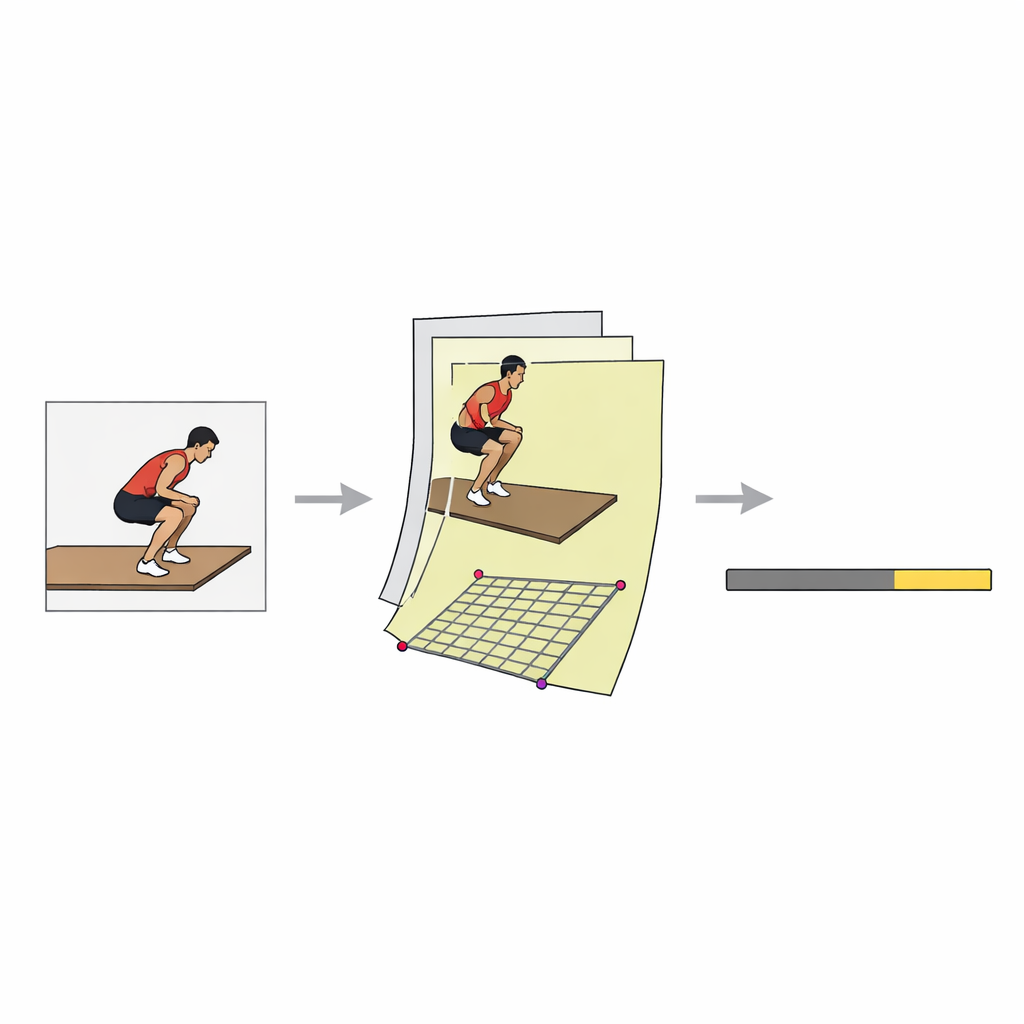

Heutige automatisierte Long‑Jump‑Systeme stützen sich oft auf Ultraschallsensoren, Druckmatten oder Lichtschranken im Sand. Zwar wirkungsvoll, sind sie aber kostenintensiv in der Installation, wetteranfällig und schwer für großflächigen schulischen Einsatz zu warten. Die Autoren betrachten die Aufgabe stattdessen als ein Sichtproblem: Wenn eine einzelne Kamera sowohl die Füße der Athletin/des Athleten als auch die Sprungmatte sieht, sollte Software ausrechnen können, wie weit die Person gesprungen ist. Sie entwerfen eine vollständige Pipeline, die Rohvideo in eine endgültige Distanzzahl verwandelt — in Echtzeit und mit einer Kombination aus moderner Computer‑Vision und sorgfältiger geometrischer Überlegung.

Wie das System einen Sprung sieht

Der Prozess beginnt mit einer Hochgeschwindigkeitskamera, die ein paar Meter seitlich der Sprungmatte positioniert ist und klares Video mit 240 Bildern pro Sekunde aufnimmt. Die Software zerlegt das Video zunächst in Einzelbilder und nutzt einen handelsüblichen Detektor, um schnell zu erkennen, wann eine/n Athlet/in in die Szene eintritt und sie wieder verlässt. Innerhalb dieses Zeitfensters sucht sie den Moment, in dem die Ferse im Bild am höchsten ist (der Sprungpeak) und anschließend die späteren Frames, in denen sich die Fersenposition nicht mehr ändert, was auf eine stabile Landung hinweist. Diese automatische Auswahl von Schlüsselbildern verhindert, dass das System jede einzelne Bildfolge analysiert, und reduziert Fehler durch teilweise sichtbare Athletinnen/Athleten, die nur zur Hälfte im Bild sind.

Matten, Fersen und die wahre Distanz finden

Sobald das Landungsbild identifiziert ist, übernimmt ein maßgeschneidertes Modell namens FastNetSeg. Dieses leichte Netzwerk kombiniert zwei Ideen: einen Transformer‑Zweig, der das Gesamtlayout der Szene erfasst, und einen kompakten Faltungszweig, der sich auf lokale Details konzentriert. Gemeinsam kolorieren sie die Pixel, die zur Athletin/zum Athleten und zur Sprungmatte gehören. Aus der Mattenmaske verfolgt ein Algorithmus die Außenkontur, glättet kleine Unregelmäßigkeiten und reduziert sie auf vier verlässliche Eckpunkte. Aus der Athletenmaske betrachtet ein anderer Algorithmus die Kontur des unteren‑linken Körperbereichs, filtert irrelevante Bereiche heraus und lokalisiert die Ferse über Krümmungsanalyse — im Wesentlichen die scharfe Wende, wo der Fußrücken auf den Boden trifft. Diese wenigen Schlüsselpunkte liefern die Rohdaten für die Messung.

Wie Pixel in Zentimeter verwandelt werden

Da die Kamera die Matte in einem Winkel sieht, entsprechen Bildabstände nicht direkt den realen Zentimetern: Ein Pixel nahe der entfernten Kante der Matte kann mehr physische Distanz repräsentieren als ein Pixel nahe an der Kamera. Um das zu beheben, lernt das System eine „Abbildung“ von Bildkoordinaten auf die ebene Oberfläche der Matte mit einem Standardwerkzeug der Geometrie, der Perspektivtransformation. Kennt die Software die tatsächliche Länge und Breite der Matte, berechnet sie, wie jeder sichtbare Punkt — besonders die Ferse — auf einer Draufsicht der Bodenfläche liegen würde. Anschließend wendet sie einen zusätzlichen Korrekturschritt an, basierend auf einer einfachen Polynomialkurve, die aus Kalibrierungssprüngen angepasst wird, um verbleibende systematische Fehler nahe den Bildrändern zu reduzieren.

Wie gut es in der Praxis funktioniert

Um das System unter realistischen Bedingungen zu testen, bauten die Forschenden einen eigenen Datensatz auf: 1.200 Sprünge von 200 Studierenden, im Freien zu verschiedenen Tageszeiten und bei wechselhaftem Wetter gefilmt. Menschliche Annotator/innen zeichneten Pixel‑genaue Umrisse von Athletinnen/Athleten und Matten, um das Modell zu trainieren und zu bewerten. Auf moderner, aber leicht verfügbarer GPU‑Hardware verarbeitet das komplette System etwa 23 Bilder pro Sekunde, schnell genug für den Live‑Einsatz bei Schultests. Entscheidender ist: Verglichen mit sorgfältigen Messungen mit dem Maßband beträgt der mittlere Fehler nur rund 0,71 Zentimeter — weniger als die Breite eines Fingers. Das Entfernen einzelner Schlüsselmodule, etwa des Filters für unvollständig sichtbare Athleten, der Einzelbildabbildung oder des präzisen Fersen‑Finders, führt zu einem starken Genauigkeitsverlust und unterstreicht die Bedeutung des vollständigen Designs.

Ein klarerer, fairerer Sprungtest

Einfach gesagt zeigt diese Arbeit, dass eine einzelne smarte Kamera das manuelle Maßband und teure Sensorsysteme für den Standweitsprung ersetzen kann, ohne Genauigkeit einzubüßen. Durch die Kombination schneller Videoanalyse, präziser Konturierungen von Springer und Matte, sorgfältiger geometrischer Umrechnung von Bild zu Boden und einem abschließenden Fehler‑Glättungsschritt liefert das System Zentimeter‑genaue Zuverlässigkeit in Echtzeit. Mit geteilter Software und Kalibrierungswerkzeugen könnten Schulen und Sportprogramme diesen Ansatz breit einsetzen und Fitnesstests schneller, fairer und weniger abhängig von menschlichem Urteil machen.

Zitation: Kuang, G., Li, S., Liu, Y. et al. A smart monocular vision metrology system based on computer for standing long jump. Sci Rep 16, 14611 (2026). https://doi.org/10.1038/s41598-026-44523-3

Schlüsselwörter: Standweitsprung, Computer Vision, Sportmessung, Deep Learning, Fitnesstests