Clear Sky Science · de

Multimodale generative gegnerische Netze zur Korrektur von Klavierfingerführung und Modellierung von Spielausdruck durch Audio‑Video‑Merkmalsfusion

Intelligenteres Üben für Alltagsklavierspieler

Klavierlernen bedeutet in der Regel Jahre von Unterricht mit einer aufmerksamen Lehrperson, die jede Note hört und jede Handbewegung beobachtet. Diese Forschung untersucht, wie künstliche Intelligenz einen Teil dieser Aufgabe übernehmen kann, indem ein gewöhnliches Klavier, ein Mikrofon und eine Kamera in einen digitalen Coach verwandelt werden, der unbequeme Fingerwahl und flaches, mechanisches Spielen erkennt und dann nahezu in Echtzeit sanfte Korrekturvorschläge anbietet.

Warum Beobachten genauso wichtig ist wie Hören

Die meisten Musikprogramme konzentrieren sich allein auf den Klang und beurteilen, welche Töne getroffen werden und wie genau das Rhythmusgefühl ist. Menschliche Lehrkräfte hingegen legen gleichermaßen Wert auf die Bewegung: welcher Finger gewählt wird, wie das Handgelenk über die Tasten führt und wie die Anschlagstechnik den Klang formt. Die Autoren argumentieren, dass ein nützlicher Klavierassistent beides gleichzeitig tun muss. Ihr System hört das Audio und analysiert zugleich das Videomaterial der Hände, um zu lernen, wie physische Gesten und die daraus resultierenden Klänge zusammenspielen. Diese doppelte Sichtweise lässt den Computer beispielsweise bemerken, wenn die richtige Note gespielt wird, aber eine ungünstige Fingerwahl verwendet wird, die später Geschwindigkeit, Komfort oder Ausdruck einschränken könnte.

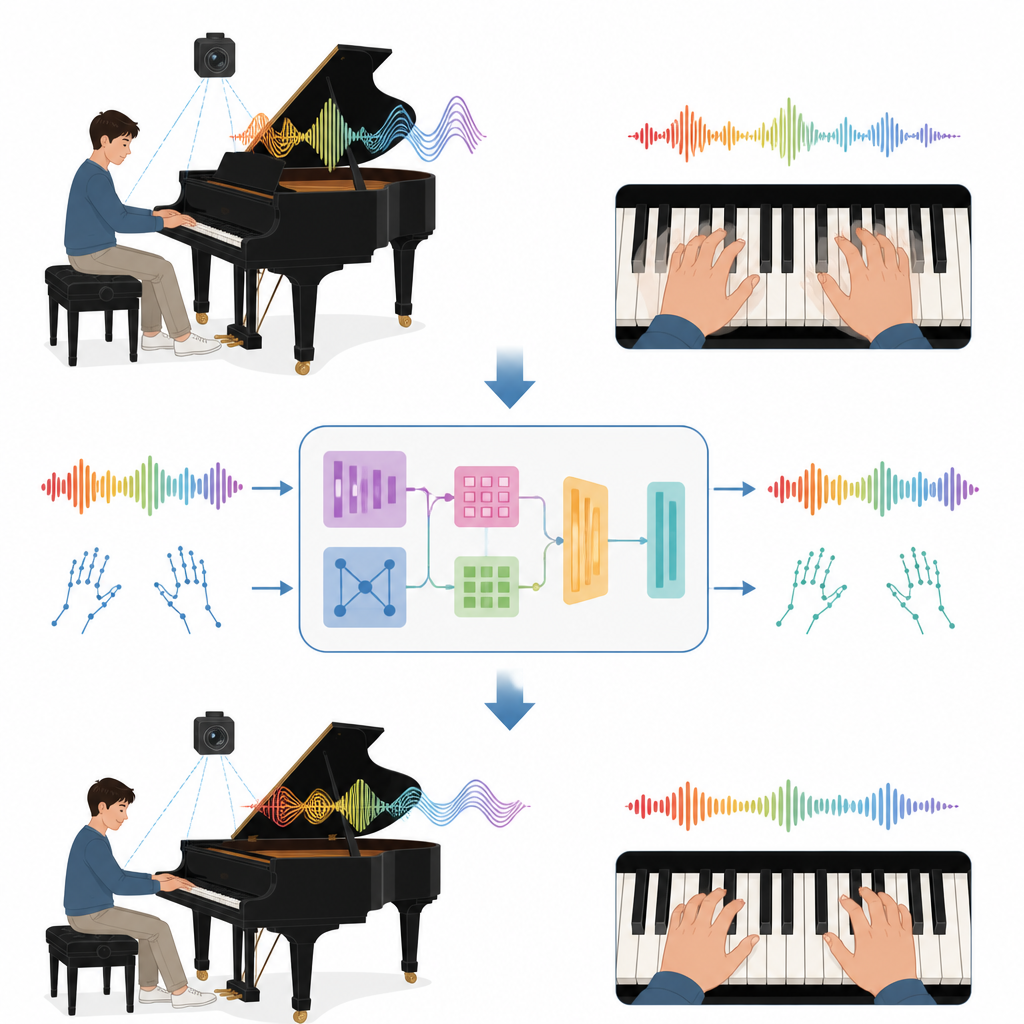

Wie der digitale Coach Sie sieht und hört

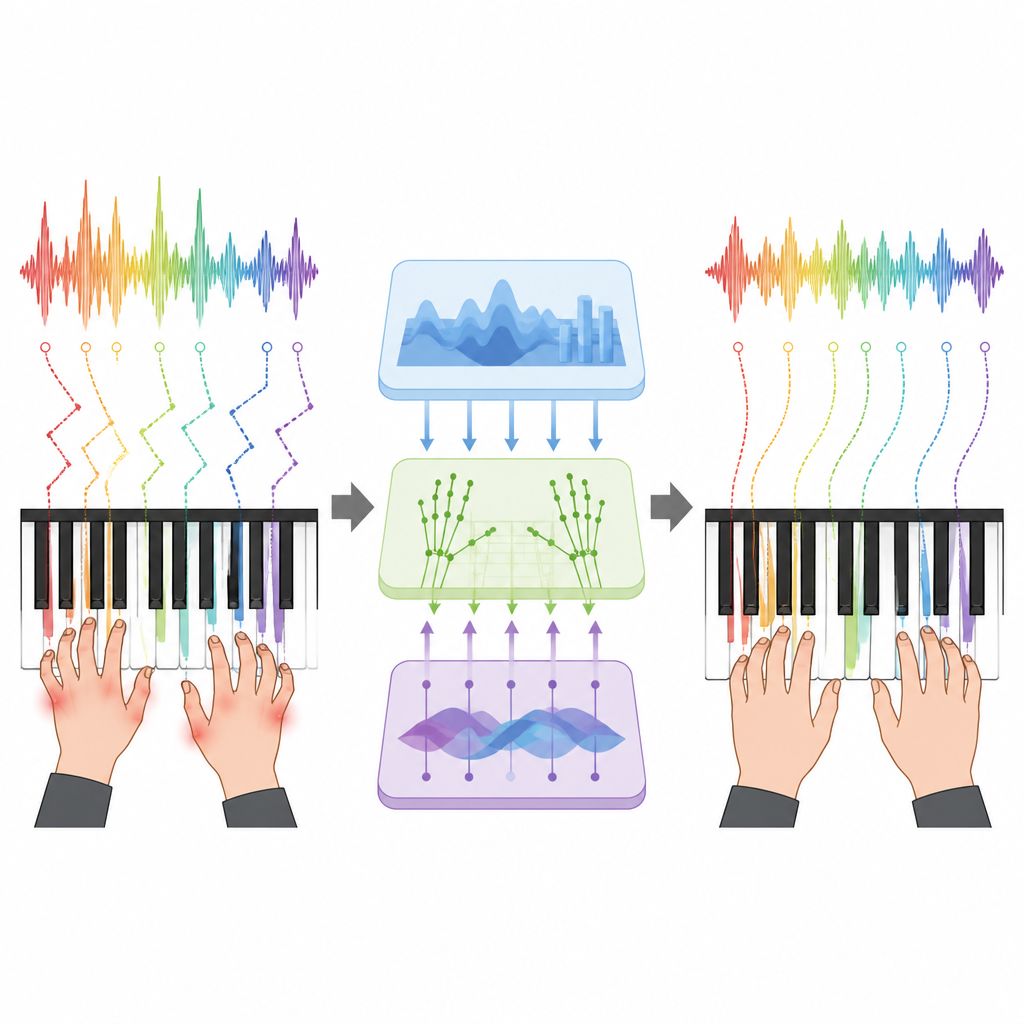

Im Hintergrund zerlegt das System Ton und Video in winzige Abschnitte und lernt dann Muster über die Zeit. Aus dem Audio extrahiert es reichhaltige Fingerabdrücke jedes Moments, die Tonhöhe, Lautstärke und Klanghelligkeit erfassen. Aus dem Video verfolgt es die Positionen von 21 Punkten an jeder Hand und beobachtet, wie sich die Finger über die Tastatur bewegen. Ein spezieller Angleichungsschritt koppelt den Klang jeder Note mit dem Zeitpunkt, an dem ein Finger eine Taste drückt. Ein zentrales „Fusions“-Modul entscheidet anschließend, wie viel Vertrauen jeder Quelle in jedem Moment geschenkt wird, und gewichtet die Kamera stärker, wenn die Hände klar zu sehen sind, oder das Audio, wenn Finger verdeckt sind oder das Video verrauscht ist. Dieses gemischte Bild wird zur besten Schätzung des Systems dafür, was der Spieler tatsächlich tut.

Bessere Fingerführung lehren und ausdrucksvolleres Spielen fördern

Um dieses Verständnis in Hilfestellung für Lernende zu verwandeln, bauen die Autoren ein generatives Modell, das mehr kann als nur richtig und falsch zu markieren. Statt eine einzelne "korrekte" Fingerzahl zu wählen, lernt es die Bandbreite an Fingerführungen, die erfahrene Pianisten für eine Passage verwenden, unter Berücksichtigung von Komfort und musikalischem Fluss. In Tests an einer umfangreichen Sammlung von 3.847 aufgezeichneten Aufführungen stimmten die Vorschläge des Systems auf Notenebene fast 90 Prozent der Zeit mit den Expertenentscheidungen überein und blieben auch in langen, schwierigen Phrasen nah dran. Gleichzeitig untersuchte es Ausdrucksaspekte wie zeitliche Flexibilität, Lautstärkeänderungen und subtile Klangunterschiede und lernte, wie Experten die Lebendigkeit einer Aufführung bewerten würden, wobei die Vorhersagen stark mit menschlichen Bewertungen korrelierten.

Vom Laborprototyp zum Übungsraum‑Assistenten

Da die Algorithmen effizient sind, können sie etwa eine Sekunde Musik in unter zwei Zehntelsekunden verarbeiten, schnell genug, um am Ende jeder Phrase während des realen Übens Feedback zu geben. Die Autoren testeten verschiedene Wege, diese Hinweise darzustellen, von einfachen Farbsignalen zur Körperhaltung bis hin zu detaillierteren Diagrammen, die vorgeschlagene Fingeränderungen zeigen und wie man ein Crescendo formt oder ein zu striktes Tempo entspannt. Lehrkräfte, die die Vorschläge überprüften, bewerteten die meisten davon nicht nur als körperlich praktikabel, sondern auch als musikalisch sinnvoll, wiesen jedoch darauf hin, dass das Werkzeug manchmal fortgeschrittene Lösungen empfiehlt, die für Anfänger zu schwierig sein könnten.

Was das für künftiges Musizierenlernen bedeutet

Die Studie zeigt, dass ein Computer durch gleichzeitiges Beobachten und Hören einige der feinen Verbindungen zwischen der Bewegung eines Pianisten und dem musikalischen Gefühl erfassen kann. Zwar ersetzt er keinen menschlichen Mentor und hat außerhalb kontrollierter Aufnahmebedingungen noch Schwierigkeiten, doch weist der Ansatz in Richtung breit zugänglicher Übungstools, die personalisierte Fingerführungstipps und sanfte Anstöße zu ausdrucksvollerer Spielweise bieten. Für Studierende ohne regelmäßigen Zugang zu Expertinnen und Experten könnten solche Systeme das Üben informativer machen, die Hände schonen und musikalisch lohnender gestalten.

Zitation: Li, J. Multimodal generative adversarial networks for piano fingering correction and performance expressiveness modeling through audio-visual feature fusion. Sci Rep 16, 15076 (2026). https://doi.org/10.1038/s41598-026-44473-w

Schlüsselwörter: Klavierfingerführung, Musikausbildung, audio‑visuelles Lernen, Spielausdruck, generative gegnerische Netze