Clear Sky Science · de

BigEye: ein klinisch interpretierbares Deep‑Learning‑Framework zur Erkennung und Stadieneinteilung der diabetischen Retinopathie

Warum ein einfaches Augenfoto das Sehvermögen retten kann

Bei vielen Menschen mit Diabetes schleicht sich Sehverlust unbemerkt ein. Ein einziges Augenfoto, das in der Praxis aufgenommen wird, kann frühe Schäden offenbaren, lange bevor Symptome auftreten — doch zur Interpretation dieser Bilder sind Fachleute nötig. Diese Studie stellt „BigEye“ vor, ein Computersystem, das nicht nur diabetische Augenerkrankungen auf solchen Fotos erkennt, sondern seine Entscheidungen auch in Begriffen erklärt, die Ärztinnen und Ärzte bereits verwenden. Das könnte das Screening schneller, konsistenter und vertrauenswürdiger machen.

Wie Diabetes das Auge still und leise schädigt

Die diabetische Retinopathie ist eine Folgeerkrankung des Diabetes, die das lichtempfindliche Gewebe im hinteren Teil des Auges, die Netzhaut, schädigt. Hoher Blutzucker schwächt die winzigen Blutgefäße, die dieses Gewebe versorgen, sodass sie undicht werden, verstopfen oder abnormal wachsen. Mit der Zeit zeigen sich charakteristische Zeichen — kleine Ausbuchtungen an Gefäßen, winzige Blutungen, gelbliche Ablagerungen von Fett und Proteinen, flockige weiße Flecken durch Nervengewebsverlust und fragile neue Gefäße, die die Netzhaut lösen können. Ärztinnen und Ärzte untersuchen diese Veränderungen auf speziellen Fotografien, sogenannten Fundusbildern, und verwenden eine internationale fünfstufige Skala, um den Fortschritt der Erkrankung von keinem Befund bis zu fortgeschrittenen, das Sehvermögen bedrohenden Stadien einzuordnen.

Warum Ärzte Maschinen wollen, die man befragen kann

Computerprogramme auf Basis von Deep Learning erreichen bereits die Leistung von Augenärzten bei der Erkennung diabetischer Augenerkrankungen in Fotos, und einige sind zur klinischen Nutzung zugelassen. Viele dieser Systeme verhalten sich jedoch wie „Black Boxes“: sie können sehr genau sein, liefern aber wenig Einsicht, wie sie zu einer bestimmten Entscheidung gelangt sind. Für Ärztinnen und Ärzte, die Diagnosen erklären, Therapieentscheidungen abwägen und sich gegen seltene, aber schwerwiegende Fehler absichern müssen, ist dieser Mangel an Transparenz ein erhebliches Hindernis. Was sie wirklich wollen, sind Werkzeuge, die in ähnlichen Begriffen denken wie menschliche Expertinnen und Experten — Werkzeuge, die im Grunde sagen können: „Ich habe diesen Fall als moderat eingestuft, weil ich an diesen Stellen viele kleine Gefäßausbuchtungen und einige fettige Ablagerungen sehe.“

Was BigEye anders macht

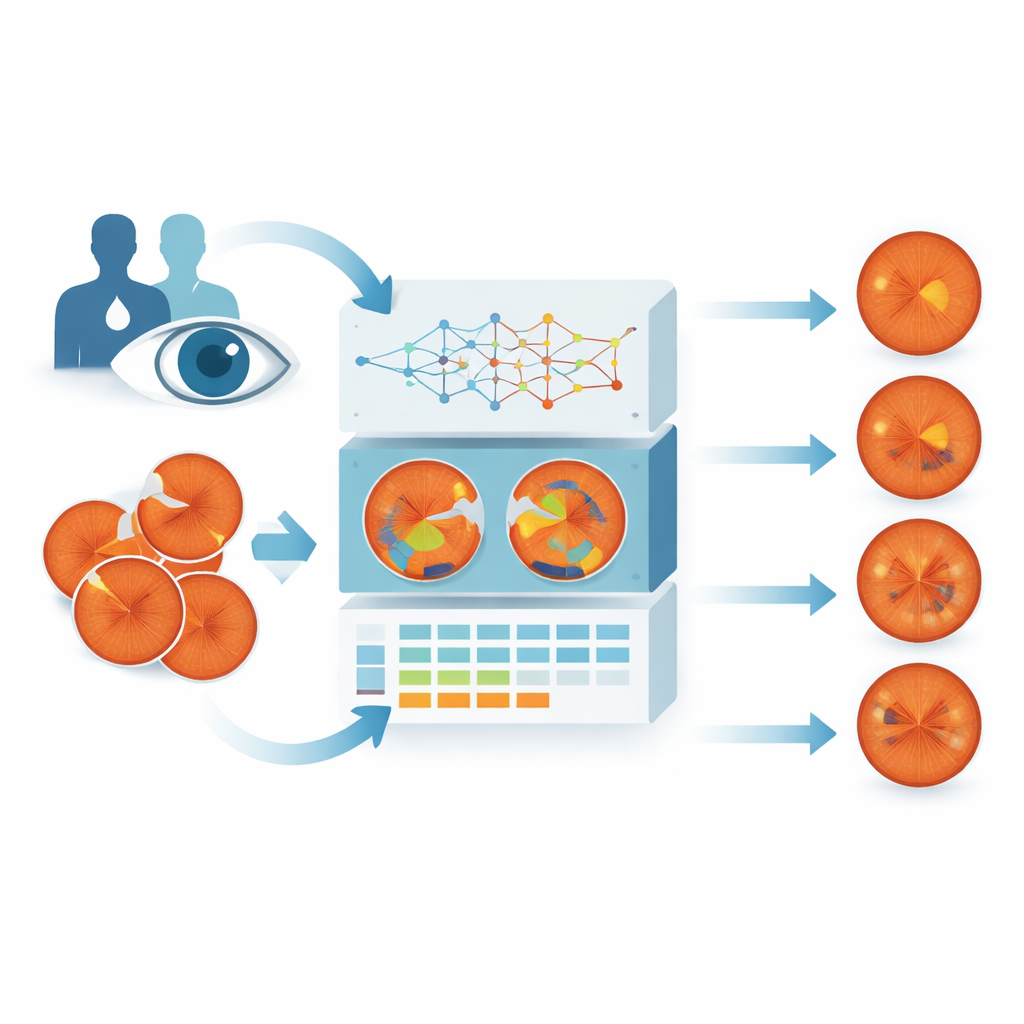

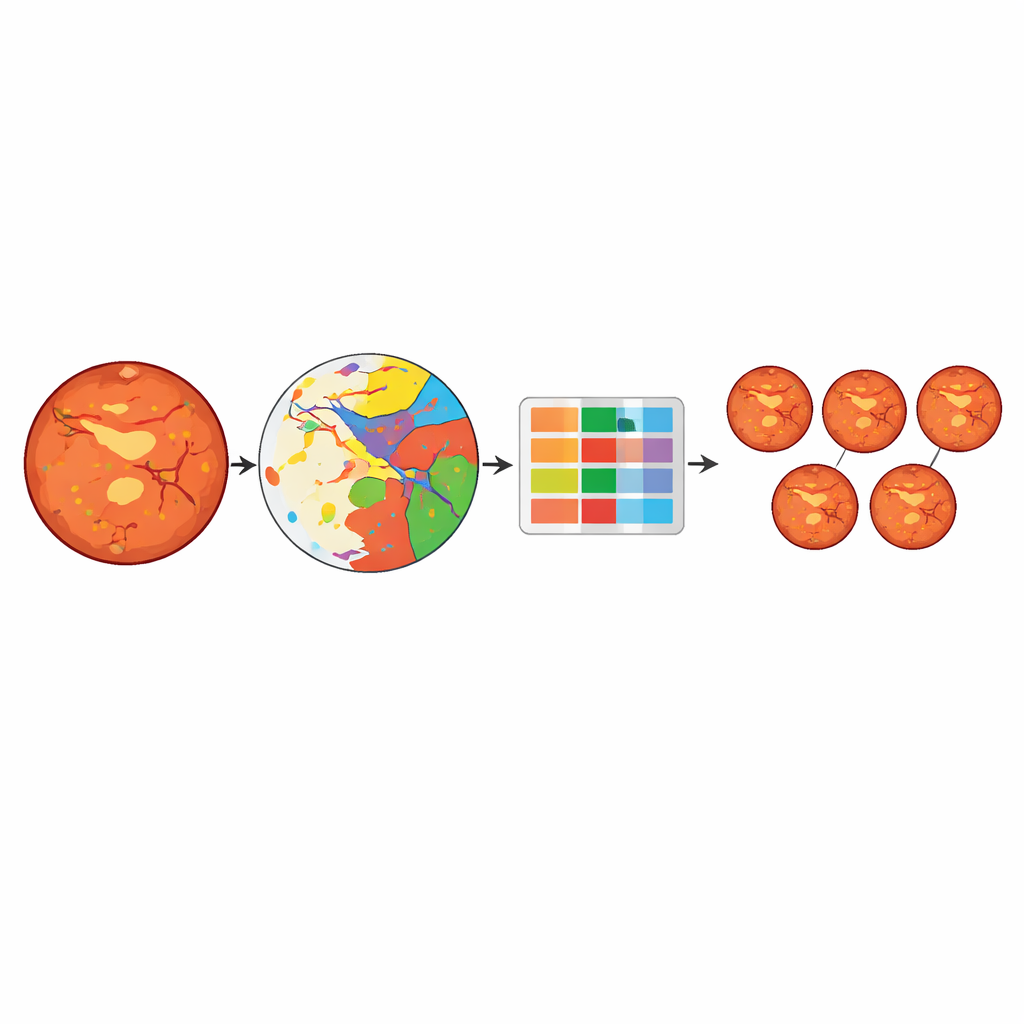

BigEye wurde so entwickelt, dass es die Denkweise von Klinikerinnen und Klinikern bei der Beurteilung von Netzhautschäden nachahmt. Die Forschenden kombinierten Augenfotos aus einem lokalen Krankenhaus und einem öffentlichen französischen Screeningprogramm und sammelten über 600 Bilder, die alle fünf Krankheitsstadien abdeckten. Spezialisten zeichneten akribisch sechs Schädigungsformen auf diesen Bildern nach: kleine Gefäßausbuchtungen, Blutungsareale, fettige Ablagerungen, flockige weiße Nervflecken, abnorme neue Gefäße und Narben durch Laserbehandlung. Ein Deep‑Learning‑Modell wurde dann darauf trainiert, diese Konturen automatisch zu reproduzieren — im Wesentlichen lernte es, jede Schadensart eigenständig einzufärben, wenn es ein neues Foto sieht.

Vom Punkt und der Narbe zum Stadium

Sobald BigEye diese geschädigten Bereiche hervorheben kann, wandelt das System sie in einfache Messwerte um: wie viele Exemplare jeder Läsionsart vorhanden sind und welchen Flächenanteil sie relativ zur Netzhaut einnehmen. Diese Messwerte bilden eine Zahlenmatrix, die verschiedenen Machine‑Learning‑Modellen zugeführt wird, deren Aufgabe es ist, das offizielle Krankheitsstadium vorherzusagen. Das leistungsstärkste Modell, ein baumbasierter Ansatz namens Light Gradient Boosting, klassifizierte die Stadien in etwa 83 % der Fälle korrekt. Es erzielte besonders gute Ergebnisse beim Unterscheiden gesunder Augen von solchen mit ernsthafteren Schäden, verwirrte aber gelegentlich benachbarte Stadien, etwa moderat versus schwer, wenn deren Muster sehr ähnlich waren.

Einen Blick in das Modellverständnis werfen

Um zu testen, ob BigEye ähnlich wie ein Kliniker urteilt, nutzte das Team eine Technik namens SHAP, um zu sehen, welche Läsionsmesswerte die Stadienvorhersage am stärksten beeinflussen. Die Muster spiegelten das medizinische Regelwerk genau wider. Bilder, die als frei von Erkrankung gekennzeichnet waren, zeigten sehr niedrige Werte aller Läsionen. Leichte Erkrankung wurde hauptsächlich durch kleine Gefäßausbuchtungen geprägt, wie menschliche Gutachter erwarten. Moderate Erkrankung zeigte eine Mischung aus diesen Ausbuchtungen und fettigen Ablagerungen, während schwere Erkrankung mit größeren Anzahlen von Blutungsherden und flockigen weißen Flecken verbunden war. Das fortgeschrittenste Stadium hing stark von Zeichen für Neovaskularisation und den durch Laserbehandlung hinterlassenen Narben ab — wiederum im Einklang mit dem Urteil von Spezialisten.

Was das für Menschen mit Diabetes bedeutet

BigEye zeigt, dass ein Computer die diabetische Augenerkrankung anhand derselben sichtbaren Warnzeichen einstufen kann, denen Ärztinnen und Ärzte vertrauen, statt sich auf undurchsichtige interne Muster zu stützen. Obwohl die Studie eine überschaubare Datengrundlage verwendete und bei den kleinsten und subtilsten Läsionen noch Schwierigkeiten hatte, demonstriert der Ansatz eine vielversprechende Richtung: Systeme, die große Patientengruppen schnell screenen können und gleichzeitig klar zeigen, welche Schadensarten jede Entscheidung beeinflusst haben. Für Menschen mit Diabetes könnte das frühere Entdeckungen, konsistentere Versorgung und bessere Gespräche mit den behandelnden Ärztinnen und Ärzten darüber bedeuten, was im Inneren ihrer Augen vor sich geht und wie sie ihr Sehvermögen schützen können.

Zitation: Gill, H.M., Salem, D.H., Omoru, O.B. et al. BigEye: a clinically interpretable deep learning framework for diabetic retinopathy detection and stage prediction. Sci Rep 16, 12574 (2026). https://doi.org/10.1038/s41598-026-43573-x

Schlüsselwörter: diabetische Retinopathie, retinale Bildgebung, erklärbare KI, medizinisches Deep Learning, Ophthalmologie