Clear Sky Science · de

Erkennung von MCI anhand handschriftlicher Zeichentests mithilfe eines residualen Vision Transformers

Warum einfache Zeichnungen verborgene Gedächtnisprobleme verraten können

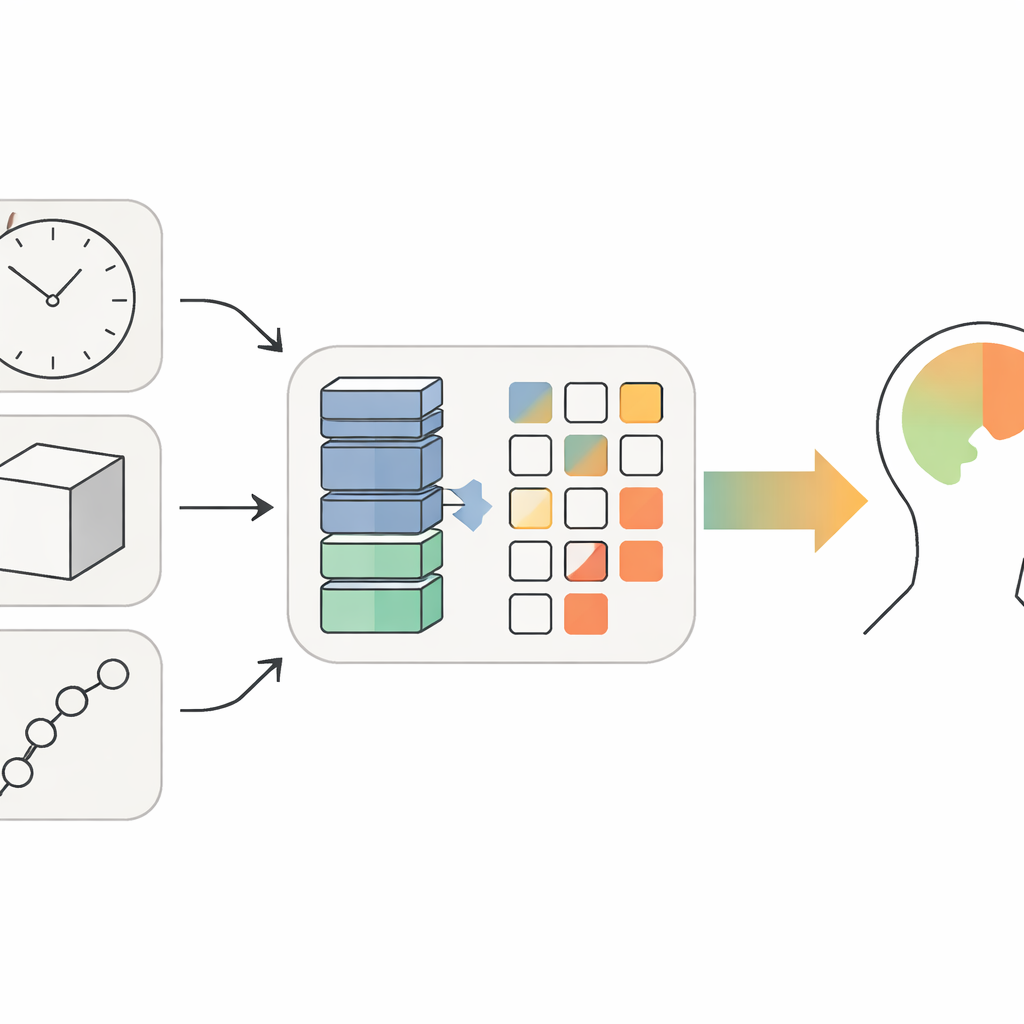

Stellen Sie sich vor, ein Arzt könnte frühe Warnzeichen einer Demenz allein daran erkennen, wie Sie eine Uhr, einen Würfel oder eine Reihe verbundener Kreise zeichnen. Diese schnellen Skizzen werden bereits in Kliniken eingesetzt, werden aber manuell beurteilt und hängen stark vom Urteil des Arztes ab. Diese Arbeit zeigt, wie ein System der künstlichen Intelligenz (KI) namens ResViT diese Zeichnungen automatisch „lesen“ kann und Stiftstriche in einen Frühwarnhinweis für leichte kognitive Beeinträchtigung (MCI) verwandelt — einen Zustand zwischen normaler Alterung und Demenz, in dem Behandlung und Planung noch viel bewirken können.

Von Stift‑und‑Papier‑Tests zu intelligentem Screening

Leichte kognitive Beeinträchtigung zeigt sich oft zuerst bei Alltagsaufgaben, die Planung, Aufmerksamkeit und räumliches Vorstellungsvermögen erfordern — genau das, was Zeichentests prüfen sollen. Ärztinnen und Ärzte bitten Patienten häufig, eine Uhr zu zeichnen, die eine bestimmte Uhrzeit zeigt, einen dreidimensionalen Würfel zu kopieren oder verstreute Zahlen und Buchstaben der Reihe nach zu verbinden. Früher musste jede Zeichnung visuell bewertet werden, was langsam ist und zwischen Behandelnden variieren kann. Die Autoren entwickelten ein objektiveres System, das alle drei Zeichnungen gemeinsam betrachtet und computerbasiert Muster erkennt, die selbst geschulte Augen übersehen könnten. Ihr Ziel ist nicht, Ärztinnen und Ärzte zu ersetzen, sondern ihnen eine schnelle, konsistente Zweitmeinung zu liefern.

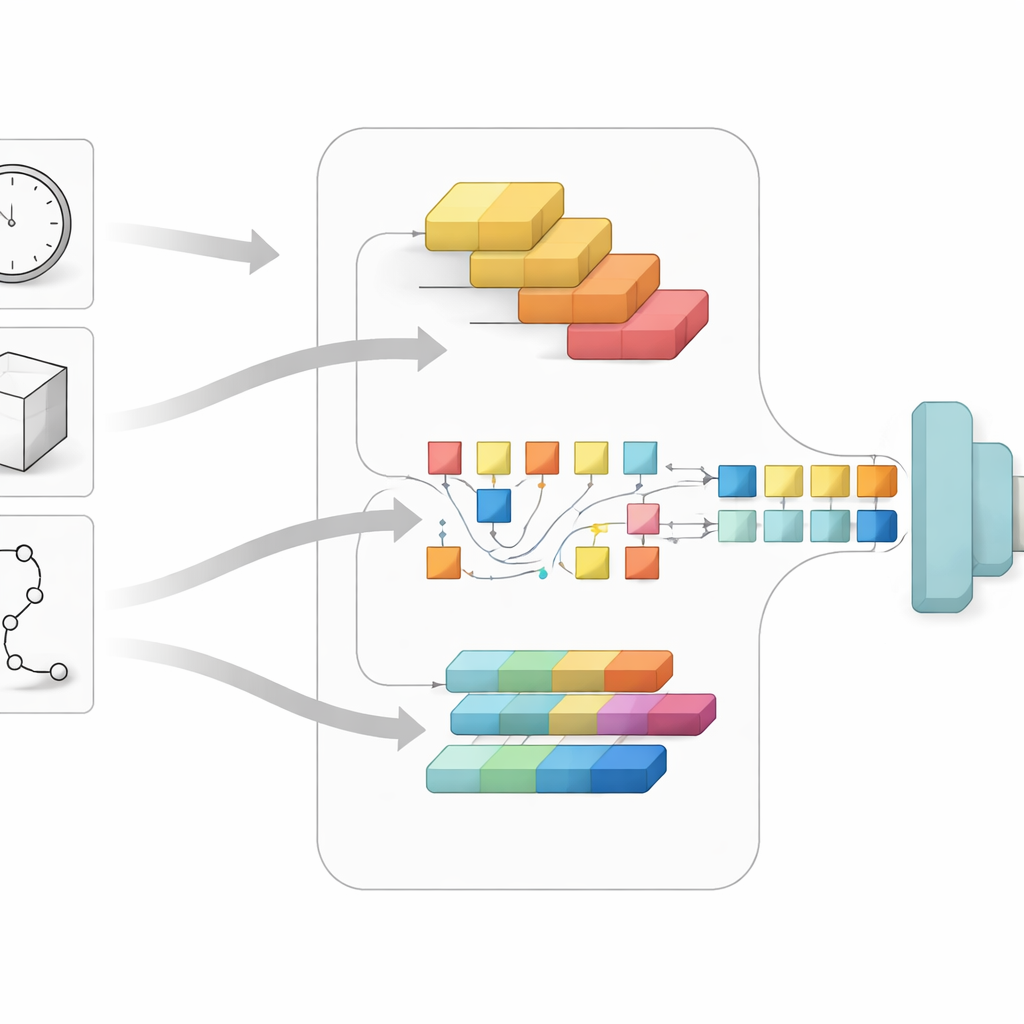

Zwei Sichtweisen vereinen: Details und das große Ganze

Kern der Studie ist ein hybrides KI‑Modell namens ResViT, das zwei sich ergänzende Arten der Bildanalyse kombiniert. Ein Teil, basierend auf der Technik ResNet, ist besonders gut darin, feine Details wie Kanten, Ecken und kleine Verzerrungen in Linien zu erkennen. Der andere Teil, ein Vision Transformer, versteht besonders gut das Gesamtbild — wie sich die Teile einer Uhr, eines Würfels oder eines Pfads über die Seite verteilen. Anstatt die Zeichnungen nacheinander durch diese Module laufen zu lassen, verarbeitet das System sie parallel und verschmilzt dann die beiden Informationsströme zu einem einzigen, reicheren Bild des kognitiven Zustands einer Person.

Wie das System aus echten Patientenzeichnungen lernt

Um ihre Idee zu testen, nutzten die Forschenden eine öffentliche Sammlung von Zeichnungen von 918 Personen, die jeweils die Aufgaben Uhr, Würfel und Trail‑Making ausgefüllt hatten. Der kognitive Status jeder Person war bereits mithilfe eines standardisierten klinischen Tests beurteilt worden, wodurch ein Ground‑Truth‑Label entweder „gesund“ oder „MCI“ vorlag. Das Team wandelte die Zeichnungen in Graustufenbilder um, skalierte sie und wandte einfache Modifikationen wie Drehungen und Helligkeitsänderungen an, um das Modell robuster zu machen. Während des Trainings verglich ResViT wiederholt seine Vorhersagen mit den bekannten Labels und passte seine internen Parameter an, mit Schutzmaßnahmen wie Early Stopping und Dropout, um ein Auswendiglernen der Trainingsdaten statt das Erlernen allgemeiner Regeln zu vermeiden.

Wie gut es funktioniert und was es aufdeckt

Bei der Bewertung an bisher unbekannten Personen unterschied ResViT gesunde von MCI‑Betroffenen in etwa drei Viertel der Fälle korrekt, mit einer Genauigkeit von 74,09 % und einem balancierten F1‑Score von etwa 0,67. Damit übertraf es mehrere starke Alternativen, darunter Varianten, die nur den ResNet‑Part, nur den Vision Transformer oder ein anderes populäres Netzwerk namens EfficientNet nutzten. Der hybride Ansatz, mit etwa einem Drittel der internen Parameter eines großen eigenständigen Transformers, erwies sich als besonders gut darin, Sensitivität für Krankheit und Vermeidung von Fehlalarmen auszubalancieren. Mithilfe von Heat‑Map‑Visualisierungen zeigten die Autoren außerdem, dass das Modell dazu neigt, sich auf klinisch aussagekräftige Bereiche zu konzentrieren — etwa Ziffern auf der Uhr, Kanten des Würfels und Verzweigungspunkte in Trails — was darauf hindeutet, dass es auf ähnliche Hinweise achtet wie menschliche Expertinnen und Experten.

Heutige Grenzen und Möglichkeiten für morgen

Die Autoren betonen, dass ihr System noch nicht als universelles Screening‑Instrument bereit ist. Der Datensatz ist moderat groß, zugunsten älterer Erwachsener gewichtet und es fehlen wichtige Hintergrundinformationen wie Bildungsstand und kulturelle Unterschiede, die das Zeichenverhalten beeinflussen können. Das Modell kann zudem auf leistungsschwachen Geräten rechnerisch anspruchsvoll sein. Dennoch kann ResViT mit relativ wenigen neuen Beispielen angepasst werden und könnte daher auf andere kognitive Störungen oder neue Zeichentasks erweitert werden, sobald mehr Daten verfügbar sind. Die Integration größerer und vielfältigerer Datensätze sowie die Entwicklung schlankerer Modellvarianten werden entscheidende Schritte auf dem Weg zur täglichen Anwendung sein.

Was das für Patientinnen, Patienten und Familien bedeutet

Einfach gesagt zeigt diese Arbeit, dass sorgfältig gestaltete KI einfache Stift‑und‑Papier‑Skizzen in ein praktisches Werkzeug verwandeln kann, um frühe Zeichen von Gedächtnis‑ und Denkproblemen zu erfassen. Zwar ist eine Genauigkeit von 74 % nicht perfekt, doch ist sie vielversprechend für eine erste Abklärung, die günstig, schnell und leicht wiederholbar ist. In Zukunft könnte eine eingescanntes Klinikbild oder sogar eine Zeichnung auf einem Tablet zu Hause subtile Veränderungen still melden, lange bevor sie im Alltag auffallen, und so Ärztinnen, Ärzte und Familien mehr Zeit zum Handeln geben. Systeme wie ResViT sollen menschliches Urteilsvermögen nicht ersetzen, sondern es konsistenter und zeitgerechter machen und Frühunterstützung für Menschen mit Demenzrisiko ermöglichen.

Zitation: Sirshar, M., Matloob, I., Tayyabah, A. et al. MCI detection from handwritten drawing test using residual vision transformer. Sci Rep 16, 10334 (2026). https://doi.org/10.1038/s41598-026-40716-y

Schlüsselwörter: leichte kognitive Beeinträchtigung, Zeichentests, Deep Learning, Vision Transformer, früherkennung von Demenz