Clear Sky Science · de

Shack‑Hartmann‑Wellenfrontmessung mit großem Dynamikumfang auf Basis eines graphentheoretischen Rechenmodells

Verdrehtes Licht klarer sehen

Viele der heute fortschrittlichsten optischen Systeme – von riesigen Teleskopen bis zu präzisen Augenbildgebungsgeräten – hängen von einer Klasse von Sensoren ab, die winzige Falten in Lichtwellen „fühlen“ können. Wenn diese Wellen jedoch stark verdreht sind, kommen die Standardwerkzeuge durcheinander und versagen. Dieses Papier stellt eine neue, softwaregetriebene Methode vor, um solche Messungen zu retten und vorhandener Hardware zu ermöglichen, deutlich stärkere Verzerrungen zu messen als bisher.

Wie ein Gitter aus winzigen Linsen eine Welle liest

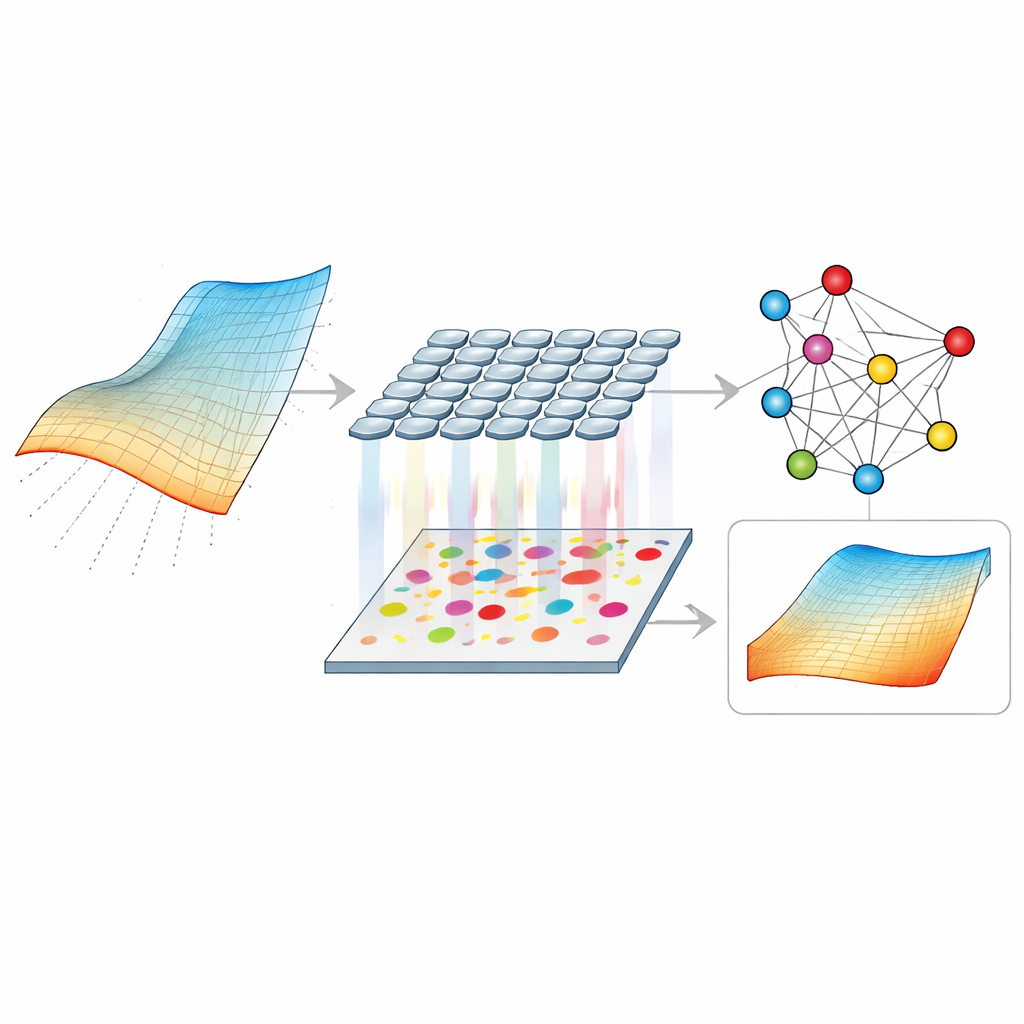

Ein Shack–Hartmann‑Wellenfrontsensor arbeitet ein wenig wie das Facettenauge einer Fliege vor einer Kamera. Ein Gitter aus winzigen Linsen zerlegt die eintreffende Wellenfront in viele kleine Strahlen, die jeweils einen hellen Fleck auf dem Detektor erzeugen. Ist die Wellenfront glatt und sanft, bleibt jeder Fleck ordentlich in seiner zugewiesenen Zelle, und seine Verschiebung gibt die lokale „Neigung“ der Wellenfront an dieser Stelle an. Durch die Kombination von Tausenden solcher lokaler Neigungen lässt sich die vollständige dreidimensionale Form der Lichtwelle rekonstruieren – entscheidend, um Teleskopbilder zu schärfen, Verzerrungen in Mikroskopen zu korrigieren und Laserstrahlen zu stabilisieren.

Wenn Licht zu wild wird

Das Problem beginnt, wenn die Wellenfront sehr steil oder stark verzerrt ist, etwa bei starker atmosphärischer Turbulenz, Hochleistungs‑Lasern oder stark aberrierten Augen. In solchen Fällen wandern viele Flecken weit über ihre Heimatzellen hinaus und überlappen mit Nachbarn; zudem werden ihre Formen gedehnt und verzerrt. Traditionelle Methoden gehen davon aus, dass jeder Fleck in seiner eigenen Box bleibt und sich durch einen einzigen Mittelpunkt zusammenfassen lässt. Bei starker Verzerrung bricht diese Annahme zusammen: Flecken werden falschen Linsen zugeordnet, ihre gemessenen Mittelpunkte werden unzuverlässig, und der nutzbare „Dynamikbereich“ des Sensors bricht zusammen. Hardware‑Lösungen – etwa geänderte Linsendesigns oder das Hinzufügen von Masken – können helfen, opfern aber oft Empfindlichkeit, Geschwindigkeit oder Kosten und erzielen nur moderate Verbesserungen.

Aus chaotischen Flecken ein Graphproblem machen

Die Autor:innen schlagen G‑SHWS vor, ein neues rechnerisches Framework, das das durcheinandergeratene Fleckenmuster als Zuordnungsrätsel auf einem Graphen behandelt. Zuerst erzeugen sie ein vorhergesagtes Fleckenmuster aus einer Test‑Wellenfront, beschrieben durch eine Menge Zernike‑Koeffizienten, eine übliche Darstellung gängiger Verzerrungsformen. Die gemessenen Flecken und die vorhergesagten Flecken werden dann als Knoten in zwei Gruppen eines gewichteten bipartiten Graphen behandelt, wobei jede mögliche Paarung Kosten in Abhängigkeit von der Distanz trägt. Eine spezialisierte Optimierungsroutine durchsucht den Raum der Wellenfrontparameter, um die Konfiguration zu finden, die die geringsten gesamten Zuordnungskosten ergibt. Während dieser Iteration verwandeln sich die vorhergesagten Flecken, bis ihr Muster dem gemessenen sehr ähnlich ist; dann lassen sich die richtigen „welcher‑Fleck‑stammt‑von‑welcher‑Linse“‑Beziehungen zuverlässig wiederherstellen – selbst wenn Flecken Zellgrenzen überschritten, sich überlappt oder einige fehlen.

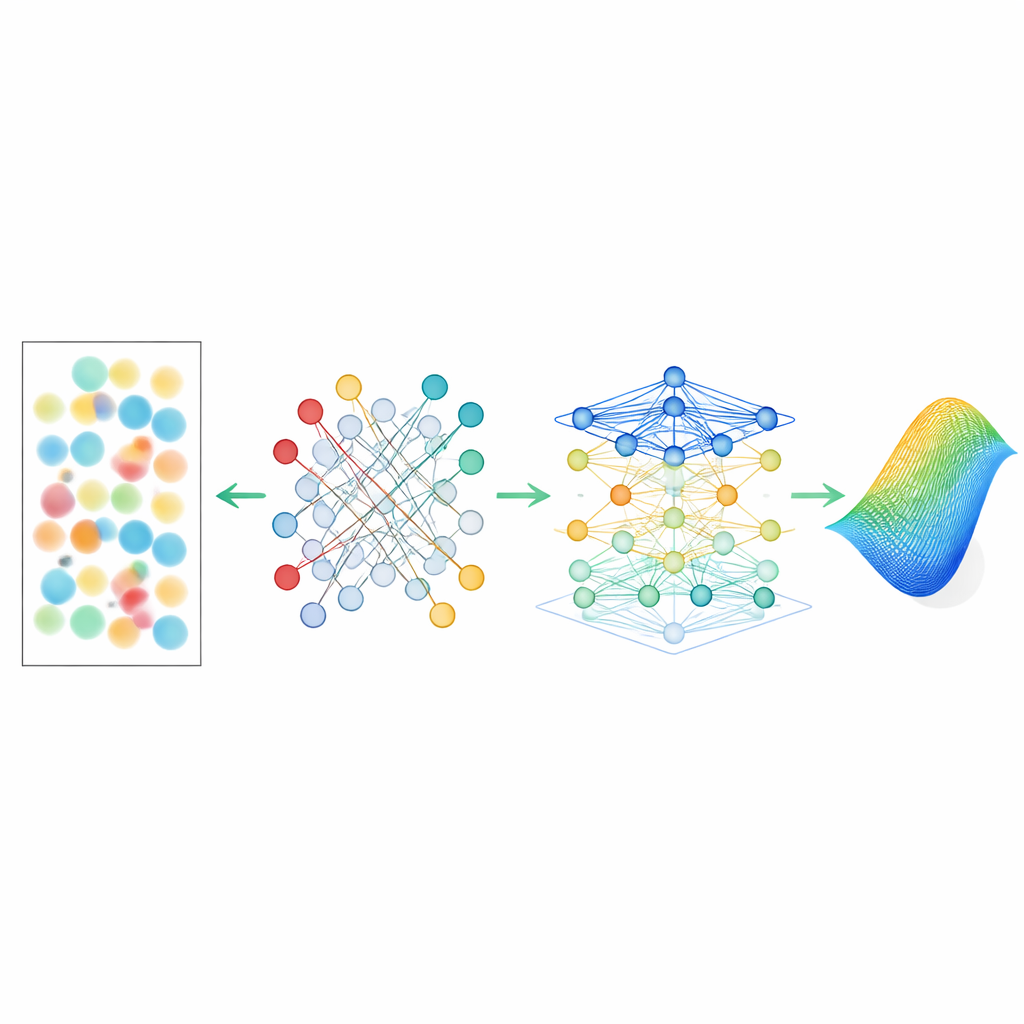

Ein Netzwerk aus Fleckenformen lernen lassen

Die richtige Zuordnung wiederherzustellen ist nur die halbe Aufgabe: Verzerrte Flecken enthalten auch reichhaltige Informationen in ihren Formen, nicht nur in ihren Mittelpunkten. Um dies zu nutzen, baut G‑SHWS ein Graph‑Attention‑Netzwerk auf – eine Form eines maschinellen Lernmodells, das natürlich auf Knoten und Kanten arbeitet. Jeder Fleck wird zu einem Knoten beschrieben durch seine Lage und detaillierte Formdeskriptoren, und jede Linsenposition ist ein weiterer Knoten. Kanten kodieren, welcher Fleck zu welcher Linse gehört und welche Linsen Nachbarn im Gitter sind. Der Attention‑Mechanismus lernt dann, wie stark jeder Fleck auf seine Nachbarn „hört“ und gewichtet stärker Knoten, die ähnliche Verzerrungsmuster teilen. Aus diesem strukturierten Netz von Beziehungen und Formen leitet das Netzwerk direkt die zugrunde liegenden Wellenfrontparameter ab und umgeht so die grobe Ein‑Punkt‑Approximation, die konventionelle Methoden einschränkt.

Die Grenzen verschieben und Messungen robust halten

In Simulationen erweitert die neue Methode die nutzbare Fleckverschiebung eines typischen Sensors auf das 21‑fache seines geometrischen Limits, während die Rekonstruktionsfehler unter etwa einem Zwanzigstel einer Wellenlänge bleiben – ausreichend für anspruchsvolle optische Anwendungen. Sie gelingt bei einer großen Bandbreite von Verzerrungstypen, von einfachen sphärischen und astigmatischen Mustern bis zu komplexen Mischungen und synthetischer atmosphärischer Turbulenz mit sehr steilen lokalen Neigungen. Entscheidenderweise bleibt der Ansatz auch dann zuverlässig, wenn viele Flecken durch Blockaden verloren gehen: Durch das Einfügen hochbestrafter „virtueller“ Knoten während der Zuordnung und das Auffüllen fehlender Bereiche mit Platzhalterflecken während der Rekonstruktion kann das Graphmodell kontinuierliche oder verstreute Verluste eines großen Teils der Daten tolerieren, ohne zusammenzubrechen.

Was das für zukünftige optische Systeme bedeutet

Für Nicht‑Spezialistinnen und Spezialisten lautet die Kernbotschaft, dass die Autor:innen einen Weg gefunden haben, ein empfindliches optisches Gerät in ein deutlich robusteres, softwaregestütztes Instrument zu verwandeln. Indem das Problem als globales Musterabgleichsproblem auf einem Graphen neu formuliert und sowohl die Positionen der Flecken als auch ihre Erscheinungsformen gelernt werden, erlaubt G‑SHWS bestehenden Shack‑Hartmann‑Sensoren, weitaus stärkere Verzerrungen zu messen, als sie jemals dafür ausgelegt waren – ganz ohne Hardwareänderungen. Das öffnet die Tür zu schärferen astronomischen Bildern durch turbulente Luft, genaueren Messungen in rauen Umgebungen und einer besseren Korrektur komplexer Sehmängel im menschlichen Auge – alles dadurch, dass der Sensor lernt, seine eigenen chaotischen Daten klüger zu interpretieren.

Zitation: Du, L., Xu, R., Liu, S. et al. Large dynamic range Shack-Hartmann wavefront sensing based on a graph-theoretic computational model. Light Sci Appl 15, 199 (2026). https://doi.org/10.1038/s41377-026-02273-x

Schlüsselwörter: Wellenfrontmessung, adaptive Optik, graphische neuronale Netze, Shack‑Hartmann‑Sensor, optische Aberrationen