Clear Sky Science · pt

TrustNet: uma rede leve com quantificação integrada de incerteza e IA explicável quantitativa para detecção de AVC isquêmico em imagens de TC

Por que exames de AVC mais inteligentes importam

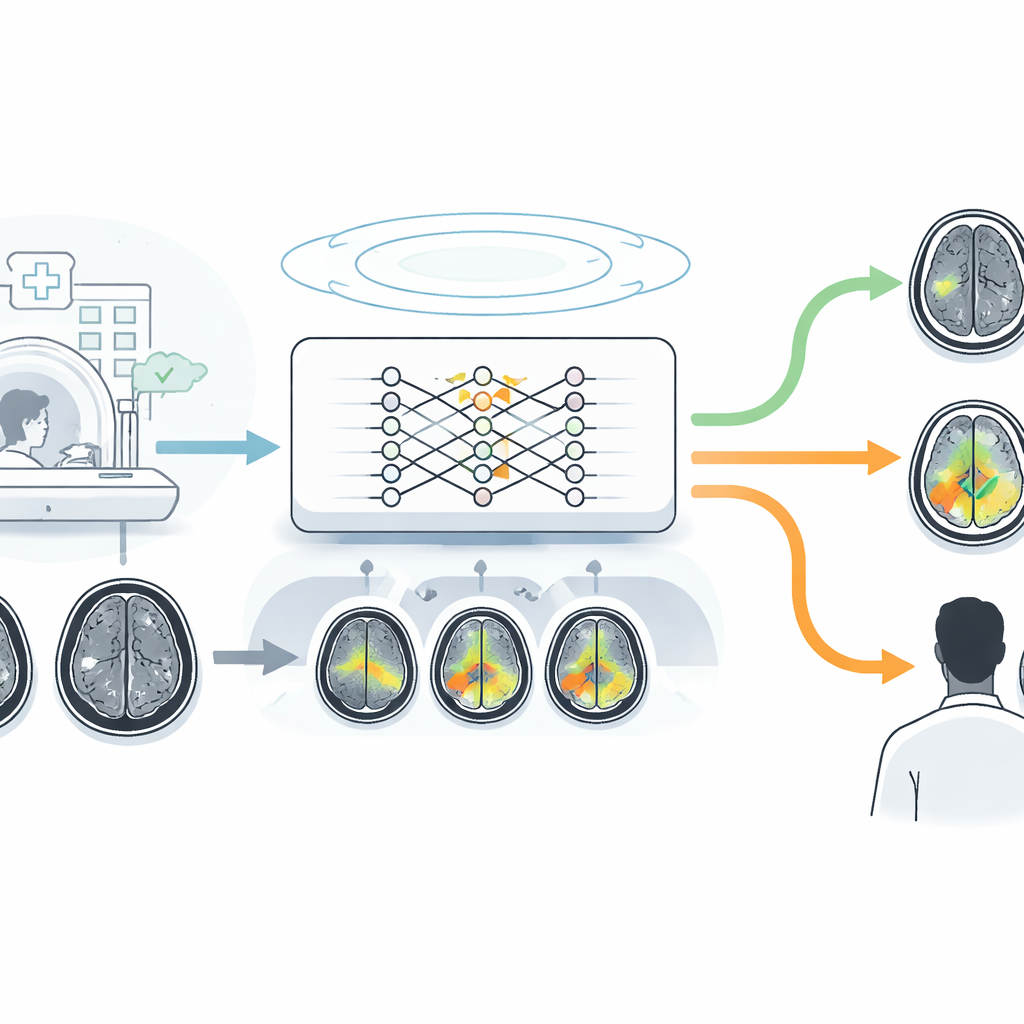

Quando alguém sofre um AVC, cada minuto de atraso pode custar tecido cerebral e, em última instância, qualidade de vida. Os médicos frequentemente dependem de tomografias rápidas da cabeça para decidir quem precisa de tratamento urgente, mas os sinais iniciais de AVC isquêmico nessas imagens são sutis e fáceis de perder, mesmo para especialistas. Muitos sistemas de inteligência artificial conseguem identificar padrões em exames, mas costumam agir como “caixas-pretas” opacas e não fornecem qualquer noção de quão certos estão. Este estudo apresenta uma nova abordagem de IA, chamada TrustNet, projetada não apenas para ser precisa, mas também para mostrar onde está olhando e quão confiante está, para que os clínicos possam decidir quando confiar nela e quando ser cautelosos.

Uma ferramenta pequena para uma emergência grande

TrustNet é um sistema compacto de visão computacional construído para distinguir tomografias cerebrais normais daquelas que mostram AVC isquêmico, um tipo de acidente vascular causado por vasos sanguíneos bloqueados. Ao contrário de muitas redes pesadas de análise de imagem que exigem hardware potente, o TrustNet usa um desenho leve com apenas 0,66 milhão de parâmetros ajustáveis, tornando-o adequado para hospitais com recursos computacionais limitados e para uso potencial à beira do leito ou móvel. Os pesquisadores o treinaram e testaram em uma coleção privada cuidadosamente selecionada de 2.023 imagens de TC de um hospital indiano, dividida igualmente entre casos saudáveis e de AVC, e depois o desafiaram usando um conjunto de dados público de um repositório online para verificar quão bem ele se generalizava além de sua instituição de origem.

Ensinando a rede a saber quando pode estar errada

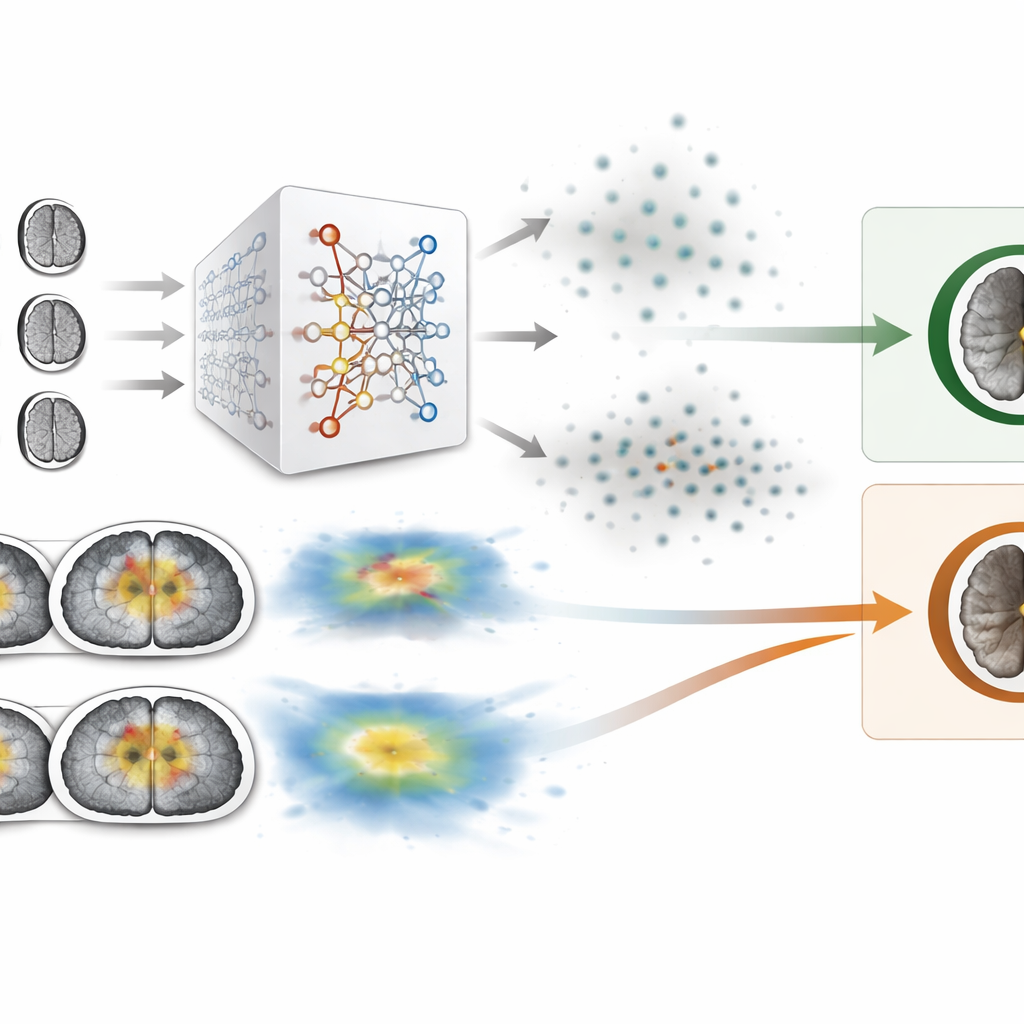

Uma inovação chave neste trabalho é que o TrustNet foi projetado para estimar sua própria incerteza. Em vez de produzir uma resposta rígida única para cada exame, o sistema processa a mesma imagem múltiplas vezes enquanto desativa aleatoriamente algumas de suas conexões internas. Ao observar quanto essas execuções repetidas discordam, o modelo pode atribuir a cada predição uma medida numérica de incerteza, variando de muito certo a altamente duvidoso. Se um caso ultrapassa um limiar de incerteza escolhido, ele é sinalizado para revisão por um especialista em vez de ser tratado como uma decisão automática confiável. Esse mecanismo simples reduziu fortemente tanto AVCs perdidos quanto alarmes falsos, elevando a acurácia nos testes de cerca de 88% na configuração de base para quase 95% na avaliação por paciente, com 100% de especificidade e 100% de precisão na coorte privada.

Tornando o raciocínio da máquina visível na imagem

Além das pontuações de confiança, os autores queriam saber se o TrustNet estava “olhando” para as partes corretas do cérebro quando classificava um exame como normal ou anormal. Eles utilizaram uma técnica de visualização que sobrepõe um mapa de calor colorido à imagem de TC, destacando as regiões que mais influenciaram a decisão. Para ir além da inspeção puramente qualitativa, desenvolveram uma nova métrica simples que faz a média da intensidade desses mapas de calor. Constatou-se que exames corretamente classificados tendiam a mostrar destaque focalizado de intensidade moderada sobre áreas plausíveis de lesão, enquanto exames mal classificados frequentemente acendiam grandes regiões dispersas com intensidade muito alta. Ao definir um limiar nessa medida de intensidade do mapa de calor, o sistema pôde detectar algumas explicações não confiáveis e corrigir um subconjunto de erros, oferecendo uma segunda rede de segurança além da estimativa de incerteza.

Como o novo sistema se compara

A equipe comparou o TrustNet com uma gama de redes de reconhecimento de imagem bem conhecidas, desde modelos profundos clássicos como VGG e ResNet até desenhos eficientes mais recentes. Muitos desses concorrentes ou exigiam muito mais memória e processamento, ou mostravam fraquezas como overfitting ou equilíbrio ruim entre sensibilidade e precisão. O TrustNet alcançou desempenho equivalente ou superior ao de modelos muito maiores, mantendo-se compacto e rápido. Em testes em nível de fatia dos dados privados, chegou a quase 99% de acurácia, e no conjunto de dados público externo atingiu mais de 98% de acurácia após a adição dos módulos de incerteza e explicação. Testes de calibração, que verificam se a confiança declarada pelo modelo está alinhada com sua correção real, indicaram que as probabilidades do TrustNet estavam razoavelmente bem ajustadas à realidade, especialmente após um simples passo de pós-processamento.

O que isso significa para o cuidado do AVC

Para o leitor leigo, a mensagem central é que este estudo aproxima a IA de detecção de AVC do que os clínicos realmente precisam na prática: não apenas um sim-não de um algoritmo misterioso, mas uma indicação visual rápida de onde o modelo vê problema e uma estimativa honesta de quão certo ele está. O TrustNet demonstra que é possível construir um sistema pequeno e eficiente que detecta AVC isquêmico em tomografias com alta acurácia, ao mesmo tempo em que sinaliza casos incertos e expõe seu raciocínio na própria imagem. Embora o trabalho até agora foque em uma escolha simples de duas vias — AVC ou sem AVC — e venha principalmente de um único hospital, ele aponta um caminho promissor para ferramentas de IA mais transparentes e confiáveis que possam apoiar, em vez de substituir, o julgamento humano em cuidados de AVC críticos no tempo.

Citação: Inamdar, M.A., Gudigar, A., Raghavendra, U. et al. TrustNet: a lightweight network with integrated uncertainty quantification and quantitative explainable AI for ischemic stroke detection in CT images. Sci Rep 16, 9861 (2026). https://doi.org/10.1038/s41598-026-37169-8

Palavras-chave: AVC isquêmico, TC cerebral, IA médica, quantificação de incerteza, IA explicável