Clear Sky Science · pt

Detectando a topologia trançada em energia complexa em um simulador atômico dissipativo com tomografia geométrica baseada em Transformer

Por que laços de energia emaranhados importam

Quando pensamos em nós e tranças, imaginamos cadarços ou mechas de cabelo. Mas na física moderna, emaranhados semelhantes podem surgir nos níveis de energia de sistemas quânticos, especialmente quando partículas podem escapar ou ser perdidas. Essas "tranças de energia" torcidas carregam informação topológica robusta que pode ser útil para tecnologias quânticas futuras — contudo, são notoriamente difíceis de observar e interpretar em experimentos. Este artigo mostra como um modelo de ponta em aprendizado de máquina, o Transformer, pode tanto detectar esses padrões topológicos sutis quanto revelar as características geométricas que os sustentam, usando uma nuvem cuidadosamente controlada de átomos ultrafrios como bancada de testes.

De paisagens suaves a energia emaranhada

Em muitos materiais quânticos, a “fase” da matéria não é definida por um parâmetro de ordem simples, como magnetização, mas por propriedades globais e topológicas. Essas propriedades estão ligadas à geometria dos estados quânticos ou ao espectro de energia do sistema. Em sistemas abertos, ou não-Hermitianos, onde partículas podem ser perdidas, as energias tornam-se números complexos com partes real e imaginária. Ao varrer o momento, as energias de diferentes estados quânticos descrevem laços em um espaço tridimensional de energia e momento. Esses laços podem se entrelaçar e formar nós uns com os outros, gerando tranças cuja conectividade codifica um invariante topológico — um inteiro que conta quantas vezes as bandas se enrolam e se trocam. Tais estruturas foram previstas e observadas em fotônica e outras plataformas, mas conectar diretamente a topologia dessas tranças à sua origem geométrica em um experimento é um desafio importante.

Por que o aprendizado de máquina padrão falha

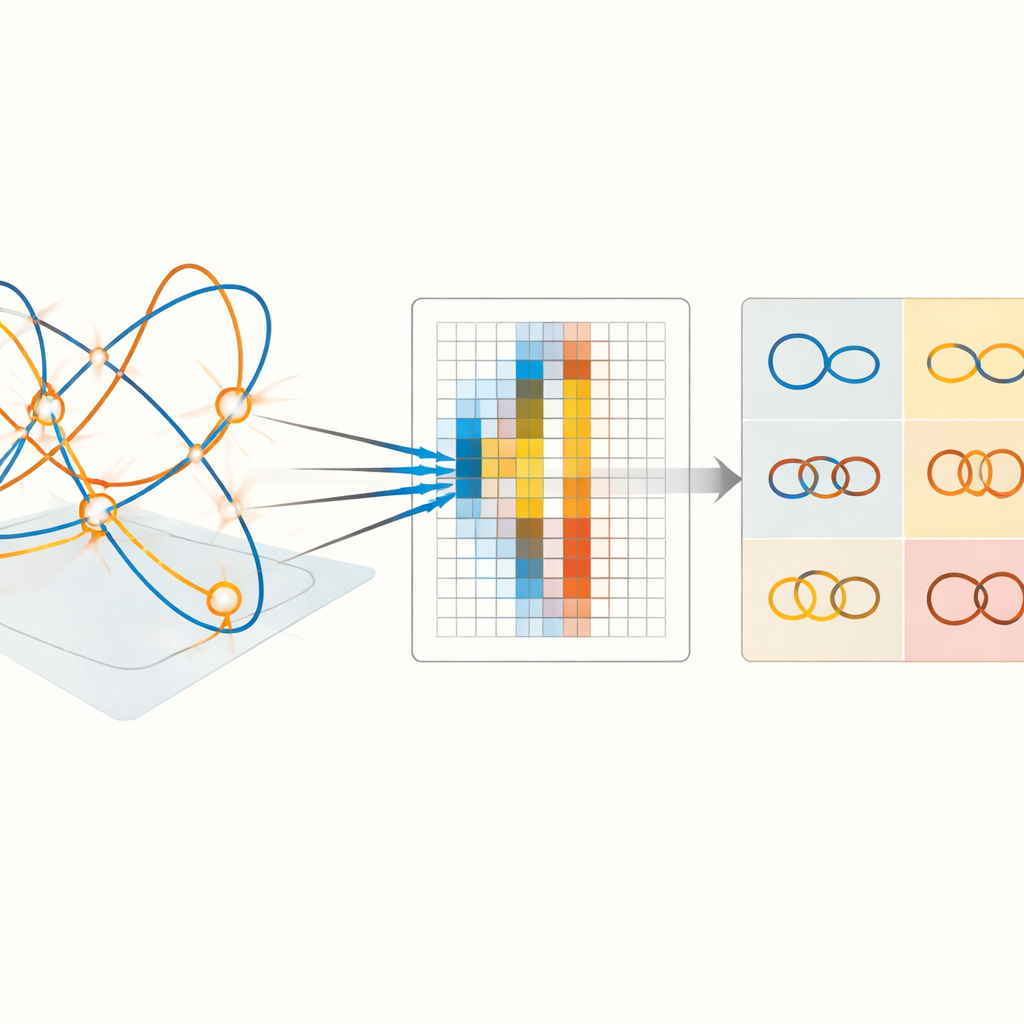

O aprendizado de máquina já ajudou a classificar fases topológicas a partir de dados brutos, usando ferramentas como redes neurais convolucionais ou agrupamento não supervisionado. No entanto, essas abordagens frequentemente se comportam como caixas-pretas: podem fornecer o rótulo topológico correto, mas não mostram claramente quais características físicas importam mais, nem como a resposta está ligada à forma detalhada das bandas de energia. Em muitos casos, elas dependem de padrões locais e têm dificuldade em capturar a estrutura não local que define a topologia. Os autores, em vez disso, recorrem aos Transformers, uma família de modelos originalmente desenvolvida para linguagem, cujo mecanismo de self-attention compara naturalmente cada ponto dos dados com todos os outros. Isso permite ao modelo não apenas atribuir o “grau de trança” correto a um espectro, mas também destacar quais partes do espectro são decisivas.

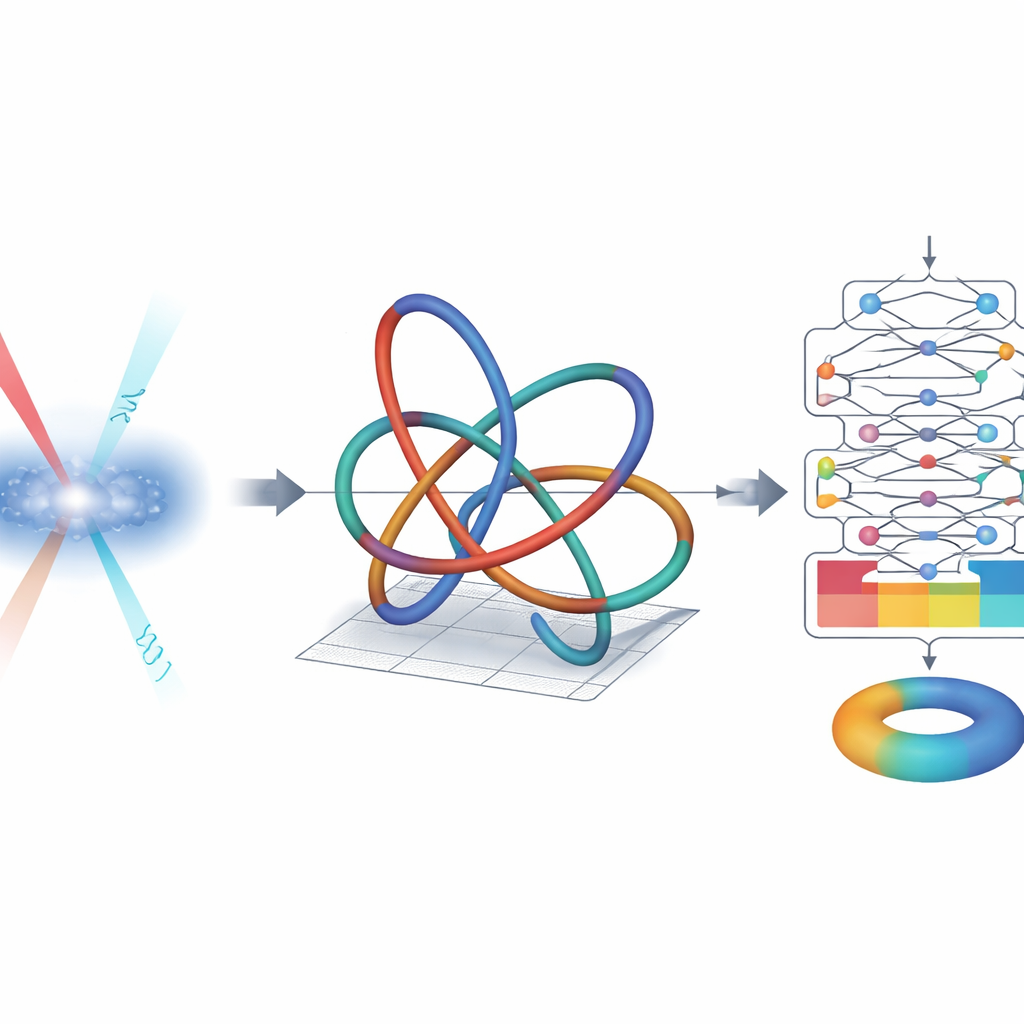

Ensinando um Transformer a ler tranças

Os pesquisadores primeiro geram muitos exemplos sintéticos de espectros de energia complexa de duas bandas com diferentes tipos de tranças — desde laços simples não conectados até nós mais intrincados. Cada espectro é representado como uma sequência de pontos ao longo do momento, onde cada ponto contém as partes real e imaginária dos dois níveis de energia. Eles treinam um Transformer para receber essa sequência como entrada e retornar o grau da trança, um número que classifica a topologia. Internamente, as camadas de self-attention produzem um mapa de quão fortemente cada ponto de momento influencia todos os outros. Projetando esses pesos de atenção de volta nos espectros, a equipe pode visualizar quais regiões o modelo considera mais importantes. O Transformer treinado alcança precisão extremamente alta ao distinguir diferentes tipos de tranças, superando mesmo redes convolucionais comparáveis.

Testando o método com átomos ultrafrios

Para verificar se essa ferramenta de aprendizado de máquina lida bem com dados do mundo real, os autores constroem um simulador atômico usando um condensado de Bose–Einstein de átomos de rubídio. Eles criam um sistema efetivo de dois níveis acoplando dois estados internos com radiação de micro-ondas, enquanto um laser ressonante introduz perda controlada em um dos estados. Ao ajustar a frequência das micro-ondas e a potência do laser, eles mapeiam como as energias complexas dos dois níveis variam conforme um parâmetro de controle é varrido, formando tranças no espaço de energia. Como a dissipação depende da densidade atômica, essas tranças mudam de forma ao longo do tempo: em tempos curtos podem formar nós ou elos não triviais, enquanto em tempos longos, à medida que os átomos são perdidos, as tranças podem se desatar em uma configuração topologicamente trivial. Após suavizar e reamostrar os espectros medidos, a equipe os alimenta no Transformer treinado.

Vendo para onde o modelo “olha”

O Transformer identifica corretamente o grau da trança dos espectros experimentais, tanto nos regimes de tempos iniciais quanto tardios, detectando assim transições de fase topológicas impulsionadas unicamente pela variação da dissipação. Crucialmente, os mapas de atenção revelam que o modelo foca nas interseções de bandas — os pontos onde as partes real ou imaginária dos dois níveis de energia se encontram ou quase se encontram. Essas interseções são precisamente onde a fase dos estados quânticos varia mais abruptamente, e onde as bandas podem trocar-se e formar tranças não triviais. Mesmo que o sistema experimental quebre algumas das simetrias assumidas no treinamento e apresente perda dependente da densidade e muitos corpos, o Transformer generaliza bem, confirmando que essas interseções são a espinha dorsal geométrica da topologia.

Desembaralhando nós quânticos com ferramentas inteligentes

No geral, o estudo demonstra uma combinação poderosa: um sistema quântico dissipativo experimentalmente ajustável que naturalmente abriga estruturas de energia emaranhadas, e um modelo de aprendizado de máquina interpretável que pode tanto classificar sua topologia quanto apontar as características geométricas chave responsáveis. Para um público não especialista, a conclusão é que ferramentas avançadas de IA podem fazer mais do que apenas rotular fases quânticas complexas — elas podem ajudar cientistas a “ver” como e onde o sistema faz seus nós. Essa abordagem pode orientar a busca por novos efeitos topológicos em uma ampla gama de plataformas quânticas abertas e nos aproximar do controle prático de comportamentos robustos, dirigidos pela geometria, em dispositivos quânticos futuros.

Citação: Yue, Y., Li, N., Zhang, X. et al. Detecting complex-energy braiding topology in a dissipative atomic simulator with transformer-based geometric tomography. Nat Commun 17, 3539 (2026). https://doi.org/10.1038/s41467-026-71880-4

Palavras-chave: fases topológicas, física não-Hermitiana, condensado de Bose–Einstein, aprendizado de máquina Transformer, entrelaçamento de bandas de energia