Clear Sky Science · pt

Abordagem colaborativa humano–computador para a decifração de inscrições em ossos oraculares com redes adversariais generativas

Escrita antiga encontra máquinas modernas

Há mais de três mil anos, adivinhos na China gravavam perguntas sobre guerra, clima e colheitas em carapaças de tartaruga e ossos de animais. Hoje, essas inscrições em ossos oraculares são um tesouro para entender como a escrita chinesa e a sociedade chinesa primitiva se formaram. Mas muitos desses símbolos pequenos e desgastados continuam indecifráveis e são numerosos demais para que alguns poucos especialistas humanos deem conta sozinhos. Este artigo mostra como a inteligência artificial, trabalhando em colaboração com estudiosos, pode ajudar a ler esses riscos antigos transformando-os em caracteres chineses de estilo moderno.

De imagens no osso para imagens para o computador

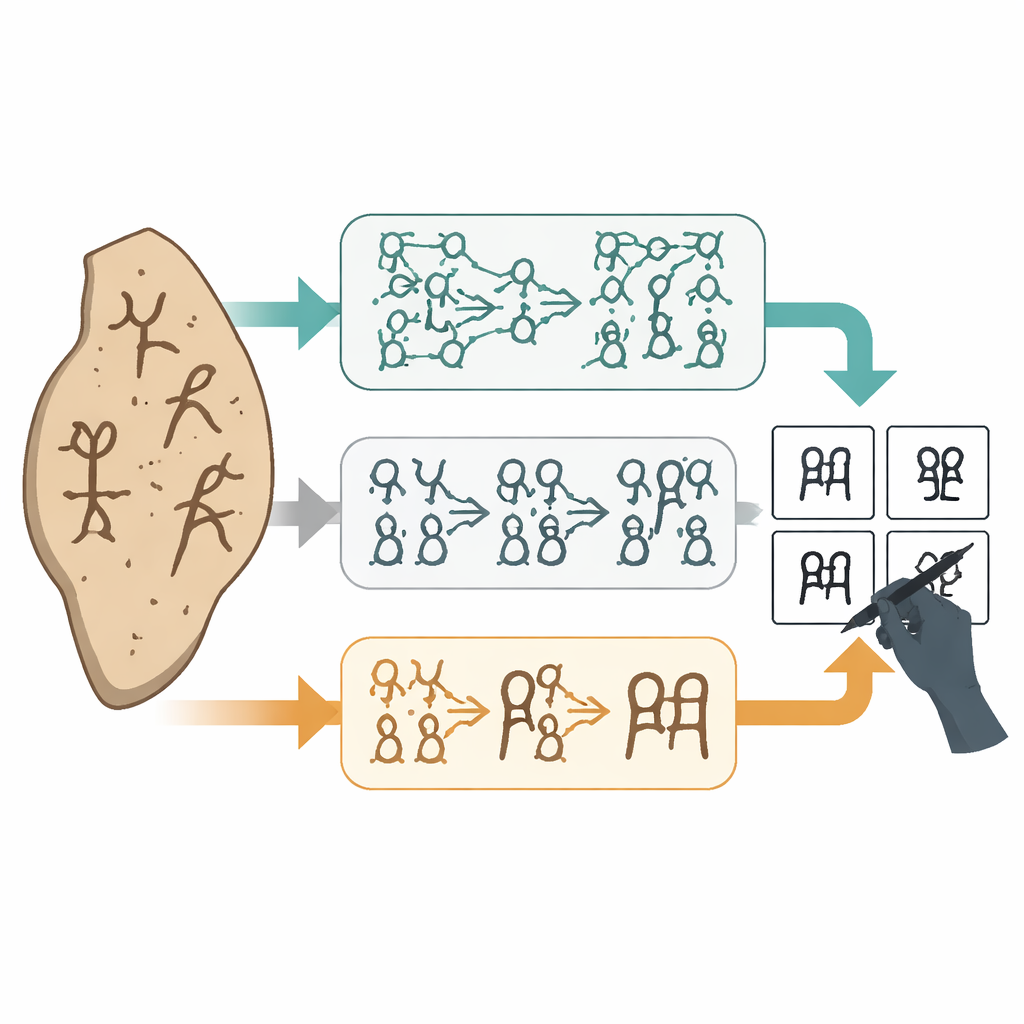

A escrita em ossos oraculares é incomumente visual. Os primeiros escribas gravavam imagens simplificadas de tigres, sóis, pessoas e ferramentas diretamente no osso, de modo que cada carácter é quase como um pequeno desenho. Os autores aproveitam isso tratando cada carácter como uma imagem em vez de uma linha de código ou texto. Eles reúnem mais de mil pares de imagens: de um lado um glifo fotografado em osso, do outro seu correspondente conhecido em chinês moderno. Ao redimensionar e limpar essas imagens, constroem uma biblioteca padronizada que um computador pode aprender, transformando o antigo problema da decifração em uma tarefa moderna de tradução imagem-para-imagem.

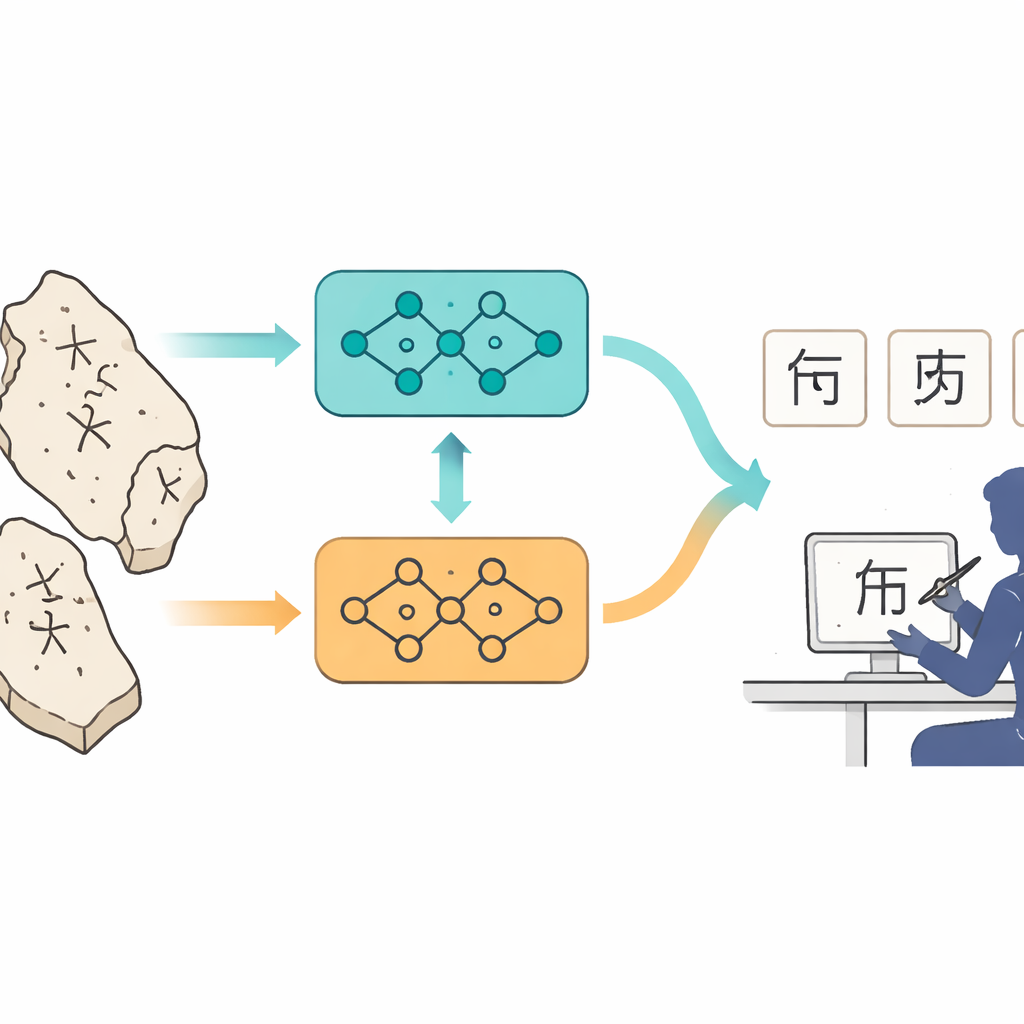

Dois artistas digitais: modelos de IA complementares

A equipe treina dois tipos relacionados, porém diferentes, de redes adversariais generativas (GANs), que são modelos de IA que aprendem a criar imagens realistas colocando um “gerador” contra um “crítico”. Um modelo, baseado em um sistema chamado Pix2Pix, aprende a partir de exemplos pareados: ele vê um carácter em osso e o carácter moderno exato que ele deve se tornar. Este modelo se destaca em produzir glifos modernos nítidos e bem formados que correspondem de perto às formas esperadas. O segundo modelo, baseado em CycleGAN, foi concebido para trabalhar mesmo quando os exemplos não estão perfeitamente casados. Ele tende a preservar o esqueleto e o estilo originais do script oracular enquanto o regulariza suavemente em direção a formas modernas. Juntos, os dois modelos oferecem diferentes “leituras” de como um glifo antigo e danificado poderia ter parecido em um estilo mais regular e legível.

Testando as máquinas e comparando alternativas

Para verificar se esses sistemas fazem algo além de desenhar imagens atraentes, os autores executam um conjunto cuidadoso de testes. Eles reservam 160 pares conhecidos oráculo–moderno que a IA nunca vê durante o treinamento e pedem a cada modelo que preveja os caracteres modernos a partir das imagens oraculares. Compararam as saídas com as respostas verdadeiras usando medidas padrão de qualidade e estrutura de imagem, e também inspecionaram os resultados visualmente. Em uma comparação mais ampla, colocaram suas duas GANs contra outros métodos populares de imagem, incluindo modelos de difusão, transformers e redes clássicas no estilo U‑Net. O par de GANs se destaca: o Pix2Pix produz os caracteres mais claros e legíveis, enquanto o CycleGAN oferece alternativas conservadoras que preservam a estrutura. Outros métodos frequentemente borram traços, quebram o esqueleto do carácter ou geram formas que não mais se assemelham à escrita, tornando-os ferramentas fracas para decifração séria.

Humanos no circuito: colaboração, não substituição

O cerne do estudo não é a IA sozinha, mas uma parceria estruturada entre máquinas e especialistas. Para 150 inscrições cujo significado era previamente desconhecido, os modelos geram múltiplos candidatos de glifos modernos. Especialistas humanos então selecionam candidatos promissores e redesenham traços faltantes ou incertos à mão, guiados tanto pelas sugestões da IA quanto por seu conhecimento da história da língua e das cenas da vida cotidiana refletidas nos textos. Em estudos de caso detalhados — como a proposta de que um glifo desconhecido signifique “caverna” ou “toca” — os autores combinam formas sugeridas pela IA, comparações com caracteres relacionados e informações históricas sobre habitações e rituais antigos. Eles também conduzem experimentos controlados em 160 casos conhecidos, comparando três modos: IA sozinha, humanos desenhando do zero e humanos refinando rascunhos da IA. A abordagem combinada produz consistentemente imagens mais próximas dos caracteres verdadeiros, avaliadas tanto por pontuações numéricas de imagem quanto por painéis de especialistas, além de economizar tempo e esforço dos estudiosos.

Por que isso importa para história e patrimônio

Para não especialistas, a recompensa é clara: cada carácter oracular recém‑decifrado afia nossa imagem da história chinesa primitiva, desde sacrifícios reais até agricultura e doenças. Este trabalho mostra que a IA pode fazer mais do que reconhecer caligrafia moderna ou gerar arte; ela pode ajudar a destravar as camadas mais antigas da cultura escrita quando emparelhada com juízo humano cuidadoso. Em vez de substituir especialistas, o sistema age como um assistente inteligente que propõe formas, acelera o redesenho tedioso e torna todo o processo mais transparente e mensurável. Os autores argumentam que essa parceria humano–computador poderia ser estendida a outros scripts antigos e documentos danificados, transformando marcas frágeis em osso, argila ou pergaminho em histórias legíveis sobre como as pessoas viviam, acreditavam e registravam seu mundo.

Citação: Zeng, S., Bai, J., Shi, J. et al. Human–computer collaborative approach to the decipherment of racle bone inscriptions with generative adversarial networks. npj Herit. Sci. 14, 232 (2026). https://doi.org/10.1038/s40494-026-02509-4

Palavras-chave: escrita em ossos oraculares, escrita antiga, IA para patrimônio cultural, colaboração humano–IA, evolução dos caracteres chineses