Clear Sky Science · pl

Nowe hybrydowe, dostosowane podejście do korekcji kolorów i rekurencyjne konwolucyjne sieci neuronowe do poprawy obrazów podwodnych

Dlaczego wyraźniejsze zdjęcia pod wodą są ważne

Czy to biologowie morscy badający rafy koralowe, inżynierowie kontrolujący kable podmorskie, czy nurkowie udostępniający nagrania z weekendowej wyprawy — wszyscy mają ten sam problem: zdjęcia pod wodą często wyglądają zamglone, z niebiesko-zielonym zafarbowaniem i ubogie w detale. W badaniu przedstawiono nowy sposób oczyszczania takich obrazów, dzięki czemu sceny poniżej powierzchni wyglądają bliżej tego, jak widzimy je w czystym powietrzu, co pomaga zarówno obserwatorom, jak i systemom komputerowym lepiej rozumieć podwodny świat.

Problem z robieniem zdjęć pod wodą

Woda to coś znacznie więcej niż gęstsze powietrze. Gdy światło przez nią przechodzi, niektóre barwy są pochłaniane i rozpraszane silniej niż inne. Czerwienie i żółcie znikają szybko wraz z głębokością lub odległością, podczas gdy błękity i zielenie przemieszczają się dalej — dlatego wiele podwodnych scen wygląda na niebieskawe i matowe. Drobne cząstki zawieszone w wodzie rozpraszają światło we wszystkich kierunkach, wypłukując kontrast i maskując drobne szczegóły. Te zjawiska frustrują nie tylko amatorów fotografii, ale też pogarszają skuteczność algorytmów, które próbują wykrywać obiekty, mapować dno czy monitorować życie morskie na podstawie obrazów i wideo.

Istniejące triki i dlaczego zawodzą

Naukowcy próbowali wielu strategii poprawiania obrazów podwodnych. Niektóre metody opierają się na modelach fizycznych opisujących, jak światło jest pochłaniane i rozpraszane, próbując odwrócić ten proces. Inne dostosowują jasność i kontrast, zmieniają balans kolorów lub pracują w specjalnych przestrzeniach barw, które oddzielają jasność od barwy. Nowsze techniki wykorzystują głębokie uczenie, trenując sieci neuronowe na dużych zbiorach zdjęć podwodnych, aby systemy nauczyły się, jak wygląda „dobry” obraz. Jednak wiele z tych podejść to ręcznie zdefiniowane potoki z ustalonymi krokami albo jednoprzebiegowe sieci neuronowe. Słabo radzą sobie przy zmiennych warunkach wodnych, nierównym oświetleniu czy silnym szumie, ponieważ trudno im adaptować się i wielokrotnie udoskonalać wynik.

Hybrydowa droga od mętnych do przejrzystych scen

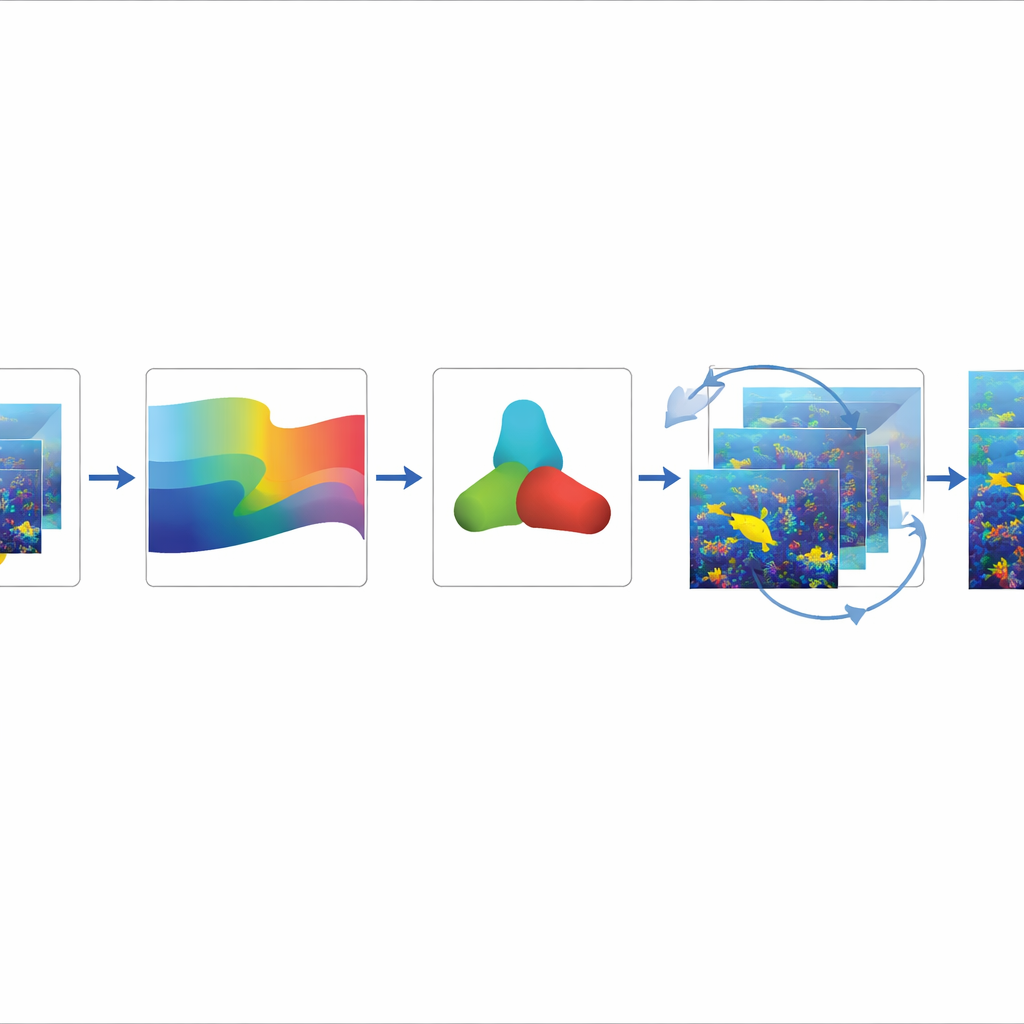

Autorzy proponują podejście hybrydowe łączące moc klasycznej korekcji kolorów z nowoczesną rekurencyjną konwolucyjną siecią neuronową — rodzajem modelu głębokiego uczenia zaprojektowanego do wielokrotnego poprawiania swoich predykcji. Najpierw etap dostosowanej korekcji kolorów analizuje, jak różne długości fal zostały osłabione i odpowiednio koryguje każdy kanał koloru. Zamiast bezmyślnie wzmacniać czerwienie czy tłumić błękity, estymuje, jak silne jest tłumienie światła w danym środowisku podwodnym i przywraca bardziej naturalne tonacje. Obraz jest następnie konwertowany do przestrzeni barw odzwierciedlającej percepcję człowieka, oddzielając ogólną jasność od składowych kolorystycznych, co ułatwia korygowanie zniekształceń bez utraty detali.

Pozwalanie sieci na ponowne przeanalizowanie obrazu

Po wstępnej korekcji kolorów poprawiony obraz trafia do rekurencyjnej sieci neuronowej. W przeciwieństwie do standardowej sieci, która analizuje obraz jednokrotnie, to rozwiązanie sprzęga wyjście z powrotem na wejście, pozwalając modelowi ponownie rozważyć scenę na kilku iteracjach. Z każdym przebiegiem ostrzejsze stają się krawędzie, usuwany jest szum i poprawia się kontrast, przy jednoczesnym unikaniu sztucznych aureoli czy nadmiernego wzmocnienia fragmentów. Dodatkowe kroki przetwarzania wygładzają szumy w sposób chroniący granice między obiektami, a specjalne traktowanie kanałów niebieskiego i zielonego pomaga skorygować najpowszechniejsze odchylenia kolorystyczne pod wodą. Cały potok prowadzi więc od surowych, zabarwionych obrazów do kolejnych, coraz czytelniejszych i dokładniejszych reprezentacji.

Dowody z różnych scen podwodnych

Aby ocenić skuteczność metody, badacze testowali ją na różnych publicznych zbiorach obrazów podwodnych, obejmujących sceny syntetyczne i rzeczywiste, a także zdjęcia i wideo. Oceniali jakość za pomocą standardowych miar porównujących ostrość, podobieństwo strukturalne i poziomy szumu, a także miar, które nie wymagają idealnego obrazu referencyjnego — co jest istotne w oceanie, gdzie „prawdziwy” widok rzadko bywa dostępny. W obrazach raf koralowych, rzeźb na dnie, pływających ryb i nurków ich podejście konsekwentnie dawało wyższe wyniki od konkurencyjnych technik i dostarczało obrazów, które ludzie oceniali jako bardziej wyraźne, bardziej kolorowe i bogatsze w detale.

Co to znaczy dla obserwacji pod powierzchnią

Mówiąc krótko, badanie pokazuje, że staranna najpierw korekcja kolorów, a potem pozwolenie inteligentnej sieci na wielokrotne dopracowanie wyniku prowadzi do zdjęć podwodnych wyglądających bardziej naturalnie i ujawniających więcej informacji. Choć metoda może mieć trudności w bardzo ciemnych warunkach, a obecne miary jakości nie oddają jeszcze perfekcyjnie ludzkich ocen, to hybrydowe podejście już teraz daje praktyczny wzrost jakości dla zadań takich jak wykrywanie obiektów, inspekcja czy monitorowanie środowiska poniżej powierzchni. Przy dalszych udoskonaleniach i lepszych sposobach oceny jakości obrazu narzędzia tego typu mogą stać się standardowymi komponentami aparatów i robotów podwodnych, dając nam wyraźniejsze okno na oceany.

Cytowanie: Natarajan, D., Sudhakaran, P. & Bereznychenko, V. A novel hybrid customized color correction and Recurrent Convolutional Neural Networks approach for underwater image enhancement. Sci Rep 16, 14006 (2026). https://doi.org/10.1038/s41598-026-44535-z

Słowa kluczowe: obrazowanie podwodne, poprawa obrazu, korekcja kolorów, głębokie uczenie, widzenie morskie