Clear Sky Science · it

Determinanti della risoluzione dell’ambiguità visiva

Mistero nella vista di tutti i giorni

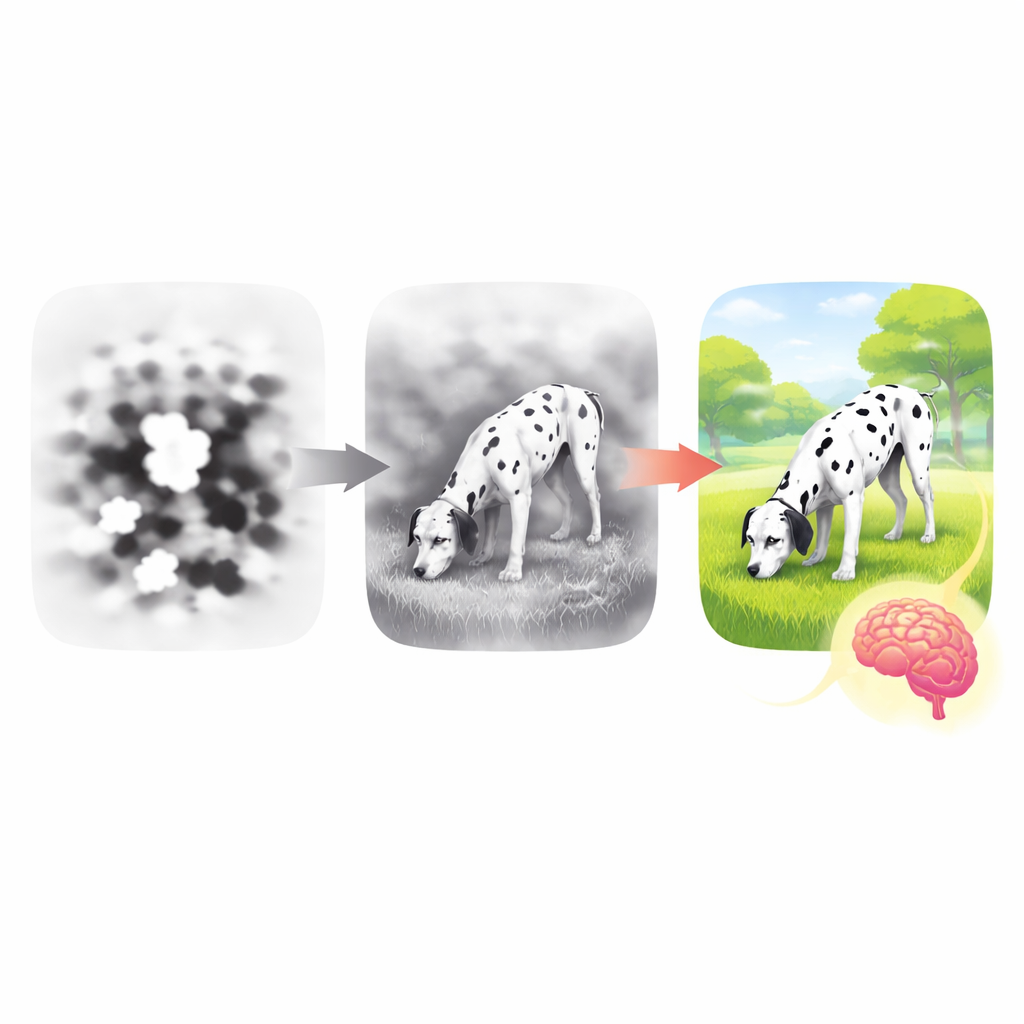

Ti è mai capitato di fissare un’immagine sfocata in bianco e nero che all’improvviso “scatta” e diventa un oggetto nitido, dopo che qualcuno ti dice di che cosa si tratta? Questo studio indaga quel tipo di magia quotidiana. I ricercatori si chiedono perché alcune immagini sfuocate restino ostinatamente confuse mentre altre scattano nella nostra mente, e che cosa cambia realmente nel cervello quando finalmente «capiciamo» ciò che stiamo guardando.

Trasformare immagini chiare in enigmi visivi

Per esplorare queste domande, il team ha creato un’enorme raccolta di enigmi visivi. Hanno iniziato con 1.854 foto di oggetti quotidiani — dagli uccelli e gli utensili a frutta e veicoli — e le hanno convertite in nette immagini in bianco e nero chiamate «Mooney». Queste immagini conservano soltanto ampie macchie di chiaro e scuro, eliminando i dettagli fini e le sfumature. Più di 900 volontari hanno guardato queste immagini online. Per ciascuna immagine, le persone hanno prima detto se riuscivano a identificare l’oggetto e poi hanno scelto un nome da una lista. Crucialmente, ogni immagine ambigua è stata mostrata due volte: una volta prima e una volta dopo che i partecipanti avevano visto brevemente la versione originale e nitida in scala di grigi. Questo ha permesso ai ricercatori di osservare come la percezione cambiava mentre le persone acquisivano più informazioni.

Cosa rende difficile vedere un’immagine?

Per capire perché alcune immagini risultavano più ambigue di altre, i ricercatori si sono rivolti a una rete neurale artificiale ispirata al cervello che imita le fasi di elaborazione visiva umana. Hanno confrontato quanto ogni immagine chiara e la sua controparte Mooney apparissero simili al modello in diverse fasi, dalla semplice rilevazione dei bordi fino al riconoscimento complesso degli oggetti. Hanno scoperto che la trasformazione in Mooney danneggiava prevalentemente gli stadi di alto livello che portano informazioni su cosa sia l’oggetto, mentre caratteristiche di basso livello come i bordi e le forme grossolane risultavano relativamente preservate. Le immagini che mantenevano più di queste caratteristiche di alto livello erano quelle che le persone trovavano più facili da riconoscere. In altre parole, ciò che rende un’immagine confusa non è tanto la perdita del dettaglio grezzo quanto la perdita della struttura astratta che segnala “questo è un cane” o “questa è una sedia”.

Come l’apprendimento cambia il nostro sguardo

Vedere la versione chiara dell’immagine — la «disambiguazione» — ha avuto un effetto potente. Successivamente, le persone erano più veloci e più sicure nel dire di riconoscere l’immagine Mooney, e la nominavano correttamente molto più spesso. Ma è cambiato anche il peso delle caratteristiche. Prima della disambiguazione, il riconoscimento dipendeva fortemente dal fatto che l’immagine preservasse quei pattern di alto livello simili a oggetti. Dopo, caratteristiche visive di basso livello come forme e contorni hanno giocato un ruolo maggiore. È come se, una volta vista la risposta, le persone iniziassero ad abbinare le macchie in bianco e nero di Mooney a un modello interno appena formato dall’immagine chiara, usando la struttura più fine dell’immagine invece di indovinare a partire da impressioni vaghe.

Dalle congetture selvagge a un significato condiviso

Il team ha anche analizzato le parole che le persone usavano per nominare ciascun oggetto. Hanno misurato quanto ogni etichetta fosse «lontana» dal significato reale dell’oggetto in uno spazio semantico costruito sui dati linguistici, e quanto variassero le etichette delle persone per la stessa immagine. Prima della disambiguazione, le ipotesi erano sparse e incoerenti: alcune risposte erano vagamente correlate («cavallo» per «zebra»), altre completamente sbagliate. Dopo aver visto l’immagine chiara, le etichette delle persone si avvicinavano di significato all’oggetto reale e diventavano più simili tra loro. È interessante notare che la quantità di informazione ricavata dall’immagine chiara non migliorava il riconoscimento in modo semplice e lineare. Invece, emergeva un andamento a U: le persone rendevano meglio o quando la nuova informazione confermava nettamente ciò che già sospettavano o quando ribaltava chiaramente un’ipotesi errata. Correzioni moderate e ambigue erano meno utili.

Come la nostra mente doma la confusione visiva

Questo lavoro suggerisce che risolviamo la confusione visiva tramite una danza flessibile tra congetture generali e confronti precisi. All’inizio, il cervello si appoggia a aspettative di alto livello: cerchiamo di adattare forme vaghe a oggetti familiari. Una volta che ci viene mostrata la risposta, passiamo a verificare se la disposizione esatta di bordi e macchie corrisponde all’oggetto che ora «sappiamo» essere lì. Allo stesso tempo, la nostra descrizione mentale dell’oggetto diventa sia più nitida sia più condivisa tra le persone. Il risultato, che più informazione non è sempre meglio e che una conferma chiara o una smentita netta possono essere le più utili, offre un quadro più ricco di come estraiamo significato da viste incomplete — un processo al cuore di come vediamo nel mondo reale, disordinato e ambiguo.

Citazione: Linde-Domingo, J., Ortiz-Tudela, J., Völler, J. et al. Determinants of visual ambiguity resolution. Commun Psychol 4, 78 (2026). https://doi.org/10.1038/s44271-026-00441-8

Parole chiave: percezione visiva, ambiguità, riconoscimento degli oggetti, elaborazione predittiva, immagini di Mooney