Clear Sky Science · it

Influenza delle proprietà degli impulsi di programmazione sulle caratteristiche di aggiornamento del peso dei transistor sinaptici IGZO a intrappolamento di carica

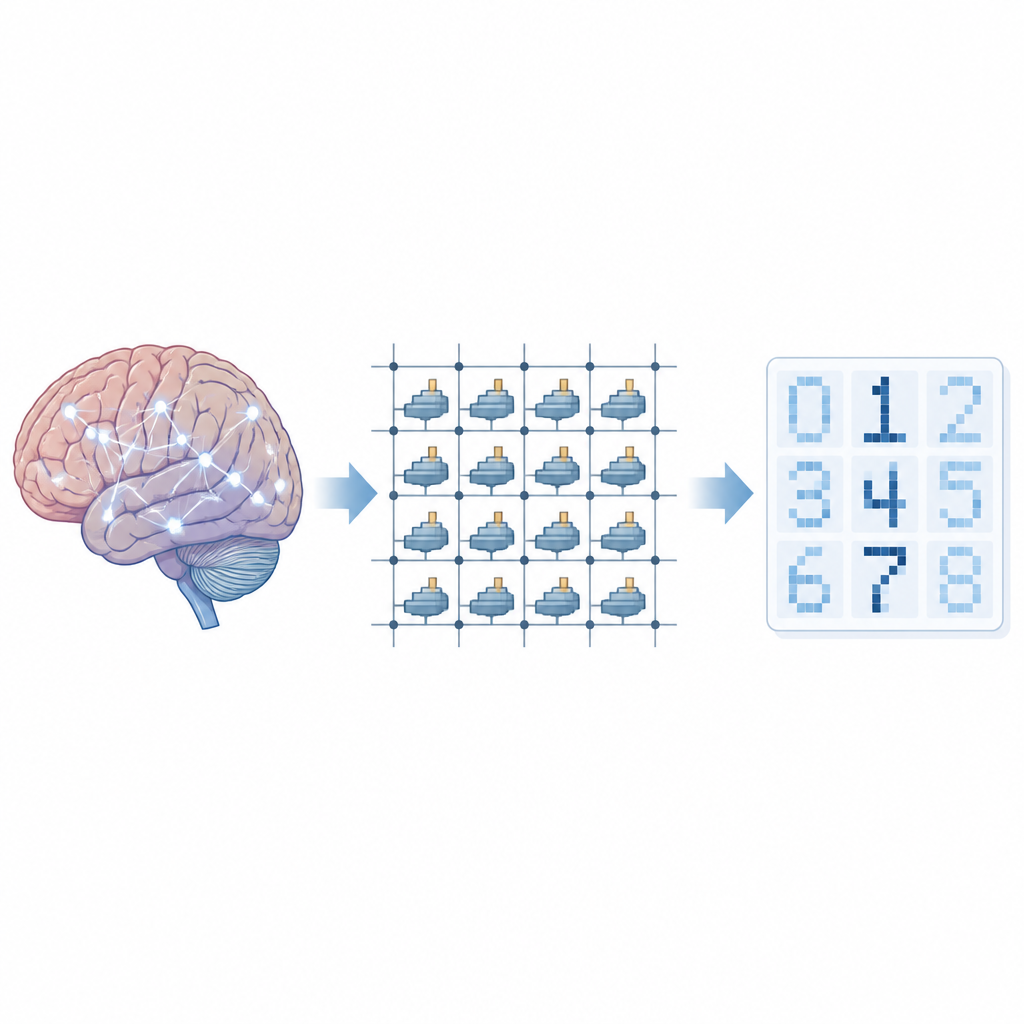

Hardware per l’IA più intelligente ispirato al cervello

L’intelligenza artificiale di oggi funziona per lo più su chip digitali ad alto consumo energetico. Questo studio esplora una strada diversa, usando dispositivi elettronici speciali che si comportano più come sinapsi cerebrali e possono immagazzinare l’apprendimento direttamente nell’hardware. I ricercatori mostrano come modellare con cura la temporizzazione degli impulsi di tensione possa rendere questi piccoli dispositivi migliori nel ricordare, pur consumando pochissima energia, un passo verso un’IA più efficiente per telefoni, sensori e dispositivi edge.

Piccoli interruttori che apprendono come le sinapsi

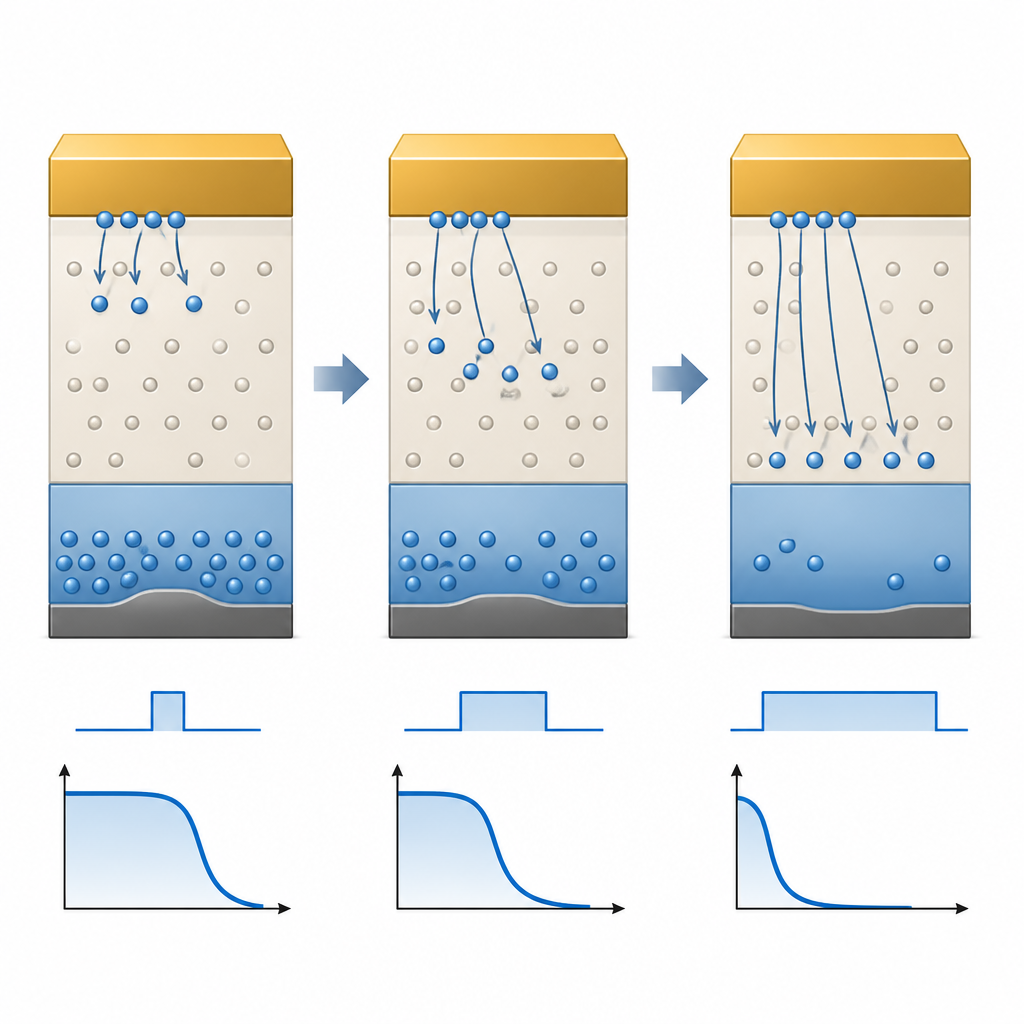

Il lavoro si concentra su transistor a film sottile realizzati con ossido amorfo di indio-gallio-zinco, un semiconduttore trasparente già impiegato in alcune tecnologie per display. In questi dispositivi, uno strato di ossido di silicio a bassa temperatura sotto il canale contiene molti difetti che possono intrappolare e rilasciare elettroni temporaneamente. Ogni transistor si comporta come una sinapsi il cui “peso” è determinato da quanti elettroni si trovano in queste trappole, analogamente a come le sinapsi biologiche si rafforzano o indeboliscono al passaggio dei segnali tra neuroni. Inviando una sequenza di impulsi elettrici al gate del transistor, il team può abbassare o aumentare gradualmente la corrente che scorre, imitando come cambia il peso sinaptico durante l’apprendimento.

Come la temporizzazione degli impulsi plasma la memoria elettronica

Una domanda cruciale è come la durata di ciascun impulso di programmazione influenzi questa memoria elettronica. Gli autori confrontano tre durate di impulso pari a 1,5, 3 o 6 secondi mantenendo sotto stretto controllo altre condizioni come l’ampiezza dell’impulso, il tempo totale di addestramento e il duty cycle. Gli impulsi brevi trasportano meno energia, quindi meno elettroni raggiungono trappole più profonde, mentre impulsi molto lunghi danno più tempo al dispositivo per rilassarsi o recuperare durante le fasi di lettura. Quando tutti e tre gli schemi di impulso ricevono lo stesso tempo totale di accensione e spegnimento, il caso intermedio di 3 secondi produce la variazione maggiore tra gli stati sinaptici più deboli e più forti, offrendo la più ampia gamma utilizzabile per immagazzinare i pesi appresi.

Separare il vero apprendimento dal semplice recupero

Poiché il transistor tende naturalmente a tornare al suo stato originale durante la lettura, il team esegue un secondo insieme di esperimenti per separare questo recupero dall’apprendimento genuino. Questa volta fissano il numero di impulsi e il tempo di recupero tra di essi, aggiustando il duty cycle in modo che impulsi più lunghi condividano comunque le stesse condizioni di lettura. In questo confronto più equo, più è lungo l’impulso, più elettroni si intrappolano nell’ossido e più profondamente il dispositivo entra nel suo stato di memoria. Il risultato è un rapporto dinamico in aumento costante, una misura di quanto la conduttanza del dispositivo può essere modulata, con gli impulsi da 6 secondi che forniscono la gamma di pesi più ampia e più controllabile.

Da singoli dispositivi al riconoscimento di cifre scritte a mano

Per vedere cosa significa per il calcolo reale, i ricercatori inseriscono il comportamento misurato dei loro dispositivi in un simulatore di acceleratore per IA analogica. Modellano una rete neurale artificiale che riconosce cifre scritte a mano dal dataset MNIST, collegando molti di questi transistor sinaptici in una matrice a croce virtuale. Poiché i dispositivi operano a correnti molto basse nella regione subthreshold, rumore ed effetti di recupero possono sfocare i pesi memorizzati. Anche così, la rete raggiunge accuratezze di riconoscimento intorno all’80%, all’87% e al 90% per larghezze d’impulso di 1,5, 3 e 6 secondi, rispettivamente. Questo stretto legame tra la gamma di pesi utilizzabile e l’accuratezza del riconoscimento dimostra che un migliore controllo dell’intrappolamento di carica migliora direttamente la qualità dell’apprendimento.

Perché il design degli impulsi è importante per l’IA a basso consumo del futuro

In termini semplici, lo studio mostra che questi transistor ad ossido memorizzano informazioni in funzione di quanto a lungo e con quanta intensità vengono stimolati, proprio come una sinapsi cerebrale cambia con attività ripetute. Impulsi molto brevi non spingono abbastanza carica in stati di memoria profondi, mentre impulsi molto lunghi devono essere bilanciati rispetto alla rapidità con cui il dispositivo dimentica durante la lettura. Regolando sia la durata dell’impulso sia la frequenza di riposo del dispositivo tra gli impulsi, gli ingegneri possono ampliare l’intervallo di memoria e migliorare il riconoscimento di pattern senza aumentare la tensione di funzionamento. Questa intuizione indica verso hardware ispirato al cervello in grado di eseguire compiti di IA in modo efficiente immagazzinando e aggiornando la conoscenza direttamente in vaste griglie di transistor sinaptici.

Citazione: Ko, Y., Ryu, J., Pi, J. et al. Influence of programming-pulse properties on weight-update characteristics of charge-trapping IGZO synaptic transistors. Sci Rep 16, 15031 (2026). https://doi.org/10.1038/s41598-026-44949-9

Parole chiave: hardware neuromorfico, transistor sinaptico, IGZO, larghezza impulso di programmazione, IA analogica