Clear Sky Science · fr

Évaluation automatique de la lisibilité des contenus pédagogiques basée sur l'apprentissage de représentations par graphes

Pourquoi c’est important pour les enseignants et les apprenants

Lorsque les enseignants choisissent un passage à lire, ils doivent trouver un équilibre délicat : le texte doit être suffisamment stimulant pour favoriser la progression, sans être si difficile que les élèves abandonnent. Cet article présente une nouvelle méthode d’intelligence artificielle capable d’estimer la difficulté de lecture d’un passage, en particulier pour des contenus éducatifs. En allant au-delà des simples décomptes de mots et de phrases pour prendre en compte la structure profonde du langage, le système vise à mieux faire correspondre le bon texte au bon lecteur que les formules classiques de lisibilité.

Limites des scores de lisibilité traditionnels

Pendant des décennies, les écoles se sont appuyées sur des formules comme Flesch–Kincaid qui exploitent des indices de surface — tels que la longueur des phrases et le nombre de syllabes — pour juger la difficulté. Ces méthodes sont faciles à calculer mais ignorent de nombreux aspects de la complexité réelle. Un paragraphe scientifique court mais chargé de termes techniques, ou une phrase à la structure tortueuse, peut être étiqueté « facile » parce que ses mots sont courts et ses phrases succinctes. En conséquence, les enseignants peuvent involontairement assigner des textes trop denses pour certains élèves ou trop simples pour d’autres, notamment dans des matières riches en contenu comme les sciences et les sciences sociales.

Regarder à l’intérieur de la phrase

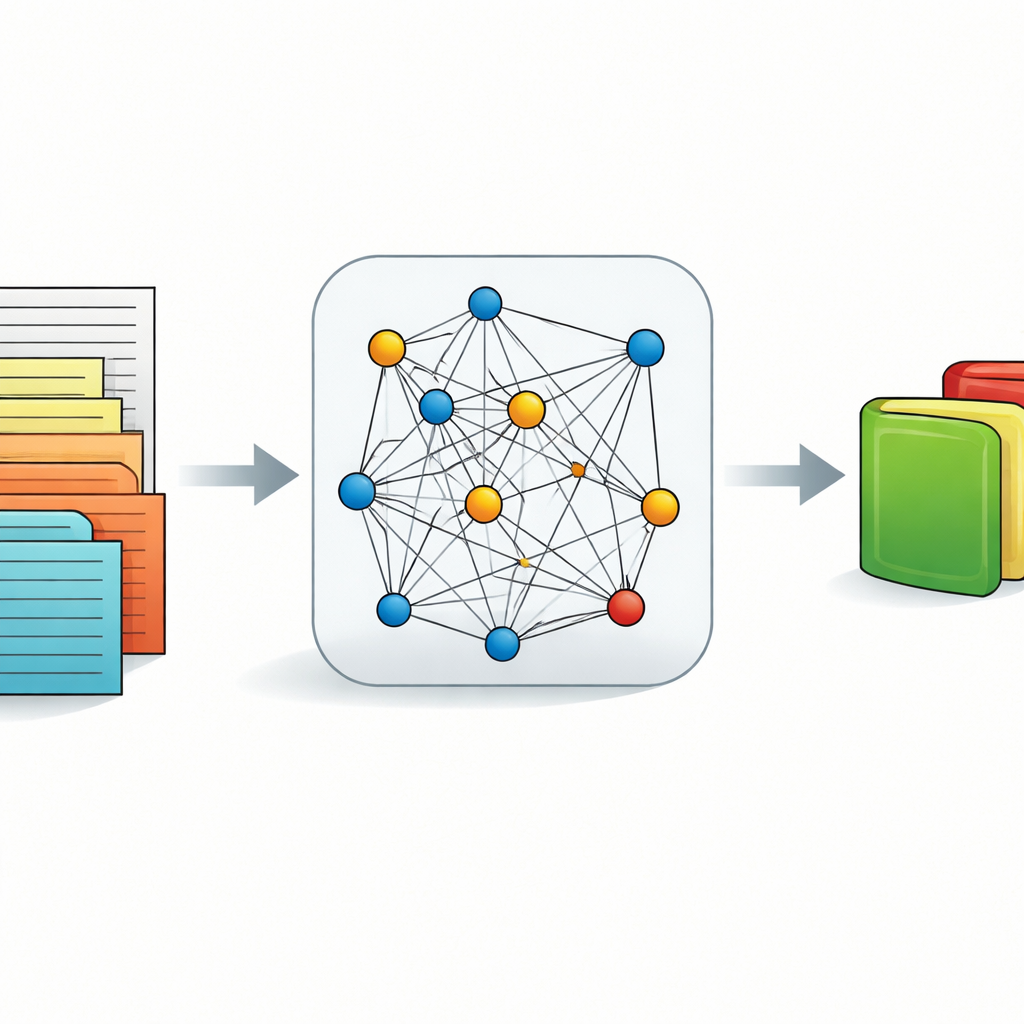

Les auteurs proposent une approche différente qui traite chaque phrase comme un réseau. Chaque mot devient un point (ou nœud) et les liens grammaticaux entre les mots — comme sujet–verbe ou verbe–objet — deviennent des connexions (arêtes). De façon cruciale, la force de chaque connexion dépend non seulement de la distance dans la phrase mais aussi des types de mots qui se trouvent entre les deux. Un long segment rempli de mots de contenu tels que noms, verbes et adjectifs suggère un saut mental exigeant ; un chemin plus court ou composé principalement de petits mots de fonction suggère une étape plus aisée. La recherche psycholinguistique montre que ces détours longs et riches en contenu sollicitent la mémoire de travail et ralentissent la compréhension, si bien que le modèle les utilise comme signaux d’une difficulté accrue.

Apprendre à un réseau à lire le réseau

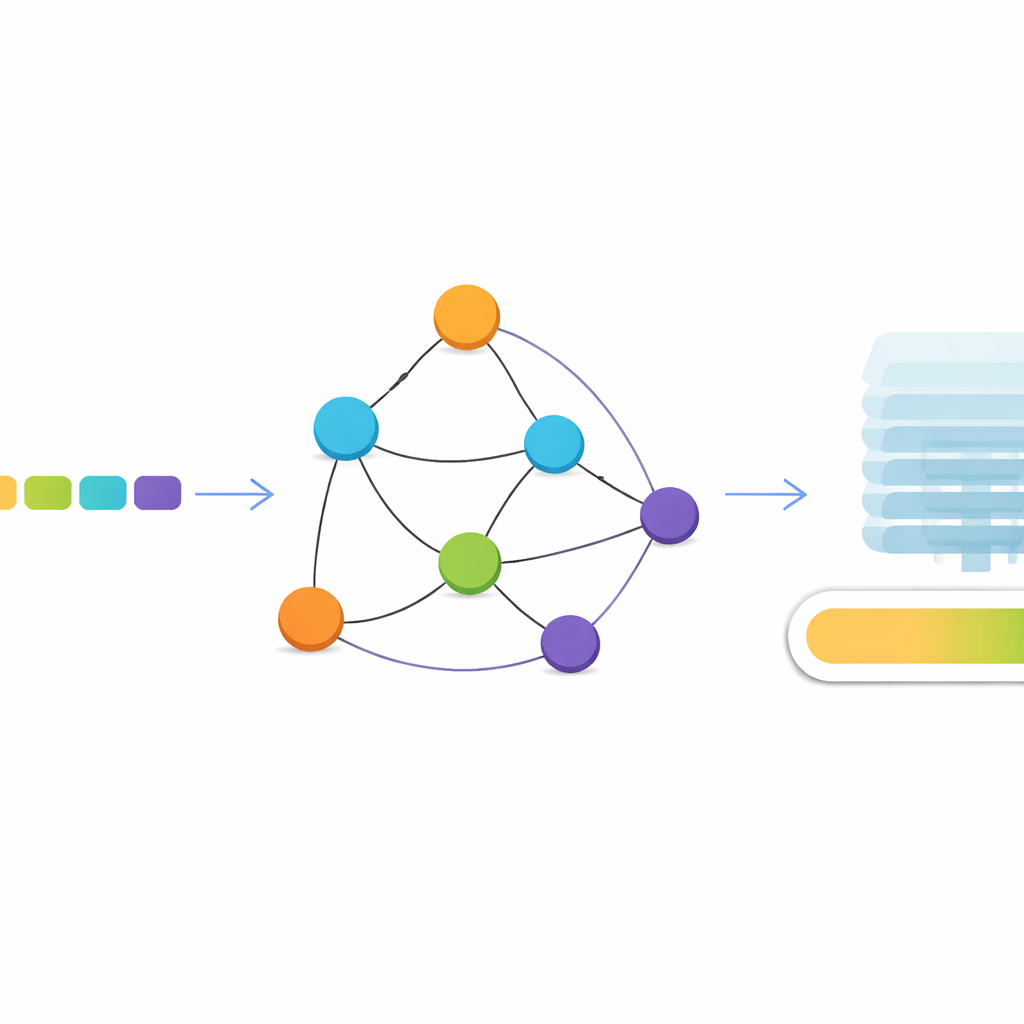

Pour exploiter cette idée de phrase-comme-réseau, l’étude emploie un type de réseau neuronal conçu pour les graphes, appelé réseau convolutionnel sur graphes (Graph Convolutional Network). Avant l’exécution du modèle graphe, un autre moteur d’IA (semblable à des systèmes largement utilisés comme BERT) crée une représentation numérique riche de chaque mot qui rend compte de son sens dans le contexte. Le réseau sur graphe transmet ensuite l’information le long des connexions entre mots, mêlant sens et structure pour former une représentation synthétique de l’ensemble du passage. Ce résumé est envoyé vers une couche finale qui produit un score de lisibilité continu plutôt qu’une simple catégorie, permettant des distinctions plus fines entre textes.

Pour tirer le meilleur parti du système, les auteurs utilisent l’optimisation bayésienne, une stratégie qui recherche automatiquement de bons réglages de nombreux « boutons » à la fois. Cela inclut la manière dont différentes classes de mots doivent influencer la force des connexions, le nombre de couches du graphe à utiliser, et la vitesse d’apprentissage du modèle. Plutôt que d’ajuster ces choix manuellement, la procédure d’optimisation les teste et les affine systématiquement d’après les résultats de validation.

Quelle est son efficacité en pratique

Le modèle est évalué sur le jeu de données CLEAR, une grande collection d’environ 5 000 courts passages assortis de scores de lisibilité attribués par des experts et de classifications de contenu de type cinématographique (G, PG, PG-13 et R). En utilisant un protocole rigoureux de validation croisée, le système explique environ 97 % de la variation de ces scores, un niveau de précision qui dépasse à la fois les méthodes classiques basées sur des caractéristiques et des bases de référence modernes solides reposant uniquement sur des modèles transformeurs. La méthode fonctionne également bien appliquée à un corpus persan originellement conçu pour classer les textes en niveaux facile, moyen et difficile : les passages d’un même groupe de difficulté reçoivent des scores prédits similaires, ce qui suggère que ce que le modèle apprend sur la structure en anglais se transpose à une autre langue.

Ce que cela signifie pour les salles de classe

Pour les enseignants et les concepteurs de programmes, l’essentiel est que la lisibilité ne se résume pas aux mots longs et aux phrases longues. La façon dont l’information est enchaînée dans une phrase — le nombre de détours et le type de mots qui les composent — joue un rôle majeur dans la facilité avec laquelle les élèves peuvent suivre le texte. En modélisant les textes comme des réseaux de mots reliés et en utilisant une IA basée sur les graphes pour lire ces réseaux, cette étude propose un outil plus précis et flexible pour estimer la difficulté de lecture. Sans remplacer le jugement humain ni rendre compte de toutes les nuances de la prose littéraire ou des sciences sociales, il peut servir d’aide à la décision puissante, aidant les enseignants à sélectionner et adapter des textes mieux adaptés aux compétences de leurs élèves et à favoriser un apprentissage plus inclusif.

Citation: Zhang, L., Abhani, J., B, J. et al. Automatic text readability assessment for educational content based on graph representation learning. Sci Rep 16, 11308 (2026). https://doi.org/10.1038/s41598-026-41313-9

Mots-clés: évaluation de la lisibilité, textes pédagogiques, réseaux de neurones sur graphes, traitement du langage naturel, difficulté des textes