Clear Sky Science · de

Ein neuartiges intelligentes hybrides Reinforcement-Learning-Framework für autonome Entscheidungsfindung in komplexen gesundheitskognitiven Systemen

Intelligentere Hilfe für Patienten mit ständigem Betreuungsbedarf

Für Menschen mit komplexen Bewegungsstörungen wie gemischter Zerebralparese kann schon jede kleine Entscheidung zu Haltung, Medikation oder Alarmen Sicherheit und Komfort beeinflussen. Diese Studie untersucht, wie ein vom Gehirn inspiriertes Computersystem Pflegekräfte unterstützen kann, indem es viele Signale gleichzeitig beobachtet, Risiken vorausschauend bewertet und dennoch auf Weise handelt, die Ärzte verstehen und vertrauen können.

Warum aktuelle Krankenhauscomputer an Grenzen stoßen

Viele Krankenhaus‑Systeme nutzen bereits künstliche Intelligenz, doch die meisten tun sich in unordentlichen, realen Umgebungen schwer. Sie benötigen oft enorme Datenmengen zum Training, haben Probleme, mehrere Schritte in die Zukunft zu planen, und können nur schwer erklären, warum sie eine Empfehlung aussprechen. Im Gesundheitswesen sind diese Schwächen gravierend, weil man an echten Patienten nicht frei „ausprobieren“ kann und jeder Fehler Schaden anrichten kann. Die Autorinnen und Autoren argumentieren, dass klinische Unterstützungswerkzeuge statt eines einzigen Regelwerks oder eines monolithischen Lernmodells besser nachahmen sollten, wie das menschliche Gehirn schnelle Gewohnheiten mit langsamerer Planung und konstanten Sicherheitsprüfungen mischt.

Ein vom Gehirn inspirierter Entscheidungs‑Partner

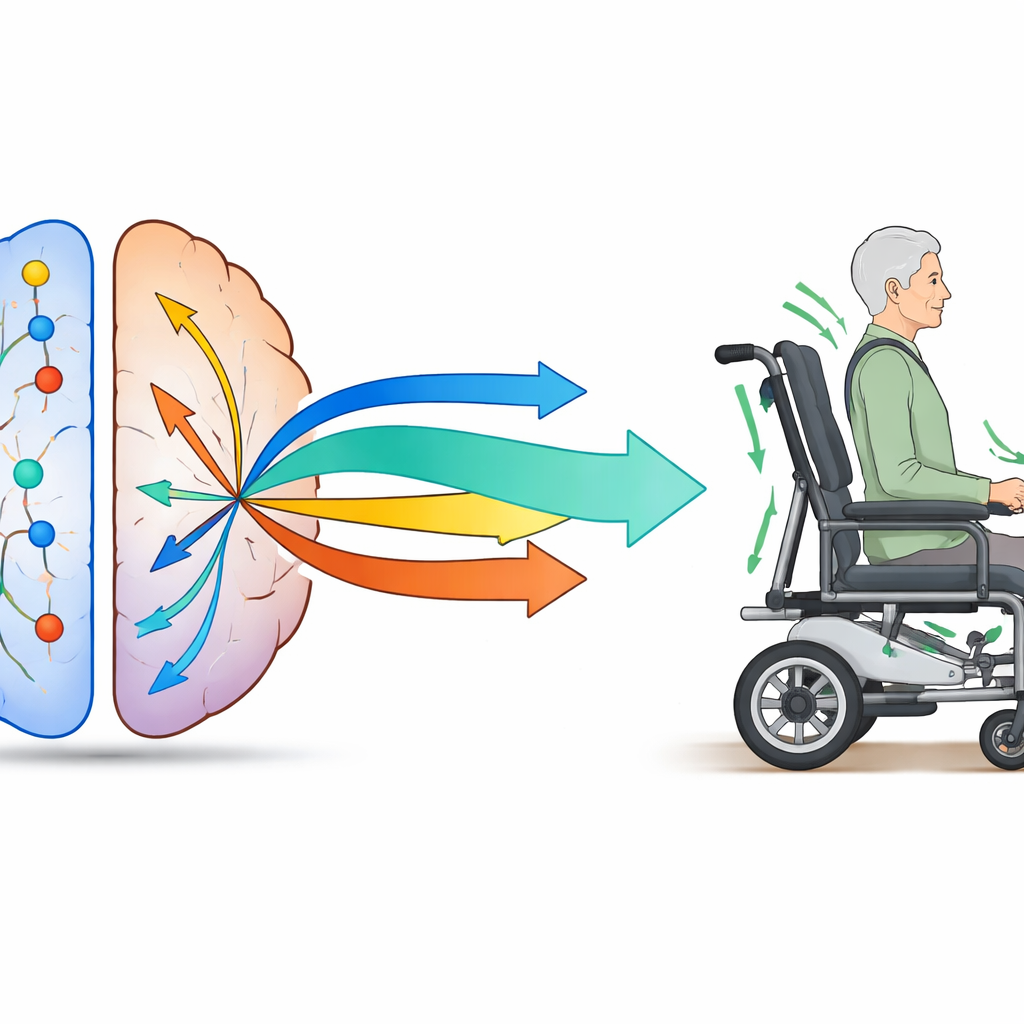

Das Team entwirft ein hybrides Lern‑Framework, das mehrere Gehirnteile nachbildet. Ein Teil verhält sich wie schnelle Reflexe: Er reagiert rasch anhand bereits gesehener Muster, etwa indem er den Rollstuhlwinkel behutsam verändert, wenn Sensoren leichte Beschwerden erkennen. Ein anderer Teil verhält sich wie überlegtes Planen: Er testet gedanklich verschiedene Optionen, bevor er handelt, zum Beispiel indem er die wahrscheinlichen Folgen von Medikamentengabe gegenüber dem bloßen Umlagern des Patienten abwägt. Ein höherstufiger „Meta‑Controller“ entscheidet fortlaufend, welcher Stil in jedem Moment angewendet wird, basierend darauf, wie unsicher oder riskant die Situation erscheint — ähnlich wie das menschliche Gehirn zwischen Gewohnheit und sorgfältigem Nachdenken wechselt.

Medizinisches Wissen mit Daten verweben

Um das System vertrauenswürdig zu halten, verknüpfen die Autoren formales medizinisches Wissen direkt mit dem Lernprozess. Das Modell nutzt Krankenhaus‑Sensorsignale, Behandlungsverläufe, Gesichtsausdrücke und Umgebungsdaten, konsultiert aber auch anerkannte klinische Leitlinien wie WHO‑Empfehlungen und ICD‑10‑Codes. Diese symbolischen Regeln helfen, bekannte Zustände zu erkennen, zugelassene Therapien vorzuschlagen und nachvollziehbar zu begründen, warum ein bestimmter Schritt der etablierten Praxis entspricht. Das Framework führt außerdem „Was‑wäre‑wenn“‑Simulationen durch und prüft, wie ein Patient voraussichtlich reagieren würde, wenn das Team eine andere Maßnahme gewählt hätte. So lässt sich sicherer aus Vergangenheitsdaten lernen, statt riskantes Ausprobieren an realen Patienten; ein ethisches Modul überwacht dabei Leistungseinbrüche bei verletzlichen Untergruppen und lenkt die Strategie zurück zu fairem Verhalten.

Test des Systems in einer virtuellen Station

Die Forschenden prüften ihr Design in detaillierten Computersimulationen einer Station, auf der 86 Patientinnen und Patienten mit gemischter Zerebralparese behandelt werden. Virtuelle Agenten vertreten Patienten, Pflegekräfte und Umgebungsrisiken wie hohe Raumtemperatur oder Rauch. Das System überwacht Körpersensoren, Gesichtssignale wie Weinen, Rollstuhlneigung und ärztliche Entscheidungen und gibt dann Pflegeanweisungen oder automatische Sicherheitsmaßnahmen aus. Im Vergleich zu gängigen Lernmethoden erreicht das hybride System mit etwa halb so vielen Trainingsdaten nahezu optimale Leistung, reagiert verlässlicher in ungewöhnlichen Randfällen und reduziert simulierte Stürze um rund 40 Prozent. Es erzielt zudem sehr hohe Werte bei Erklärbarkeitsmetriken, was bedeutet, dass sich Entscheidungen auf erkennbare Signale und medizinische Regeln zurückführen lassen.

Mehr als eine Krankheit und ein Krankenhaus

Um zu prüfen, ob sich die Idee über den Einzelfall hinaus übertragen lässt, testen die Autorinnen und Autoren das eingefrorene Framework auch an öffentlich verfügbaren Datensätzen, darunter Aktivitätsverläufe von Kindern, Signale aus einem Hand‑Exoskelett und robotische Steuerungsaufgaben. Mit nur leichter Anpassung der Eingabeschicht funktioniert die Kern‑Entscheidungslogik weiterhin gut, was darauf hindeutet, dass das gleiche gehirninspirierte Layout viele verschiedene Gesundheits‑ und Steuerungsszenarien unterstützen könnte. Dieses breite Verhalten zusammen mit starken Simulations‑ und statistischen Prüfungen weist auf Werkzeuge hin, die Wissen über Bedingungen hinweg teilen können, ohne ständig von Grund auf neu trainiert werden zu müssen.

Was das für die künftige Patientenversorgung bedeutet

Vereinfacht gesagt stellt die Studie einen digitalen Assistenten vor, der Patienten ähnlich aufmerksam überwacht wie eine gewissenhafte Pflegekraft, deren Instinkte durch Lehrbücher und die Fähigkeit, Entscheidungen gedanklich vorzubereiten, gestützt sind. Durch die Kombination von schnellen Reaktionen, durchdachter Planung, medizinischen Leitlinien und Fairness‑Checks bietet das Framework einen Weg zu sichererer, nachvollziehbarer Automatisierung in der Rehabilitation und anderen komplexen Versorgungssituationen. Obwohl noch reale Studien nötig sind, skizziert die Arbeit, wie künftige Systeme am Patientenbett Stühle dezent anpassen, Probleme melden und Behandlungen vorschlagen könnten — auf eine Weise, die menschliche Kliniker unterstützt statt ersetzt.

Zitation: Abdullah, Fatima, Z., Ather, M.A. et al. A novel intelligent hybrid reinforcement learning framework for autonomous decision making in complex health cognitive systems. Sci Rep 16, 14721 (2026). https://doi.org/10.1038/s41598-026-50418-0

Schlüsselwörter: Reinforcement Learning, Zerebralparese, klinische Entscheidungsunterstützung, KI im Gesundheitswesen, autonome Agenten