Clear Sky Science · de

Modellierung der Auswirkungen interaktiver Schnittstellenmerkmale auf die Nutzererfahrung in KI‑gestützten digitalen Lernsystemen

Intelligentere Bildschirme für Online‑Lernende

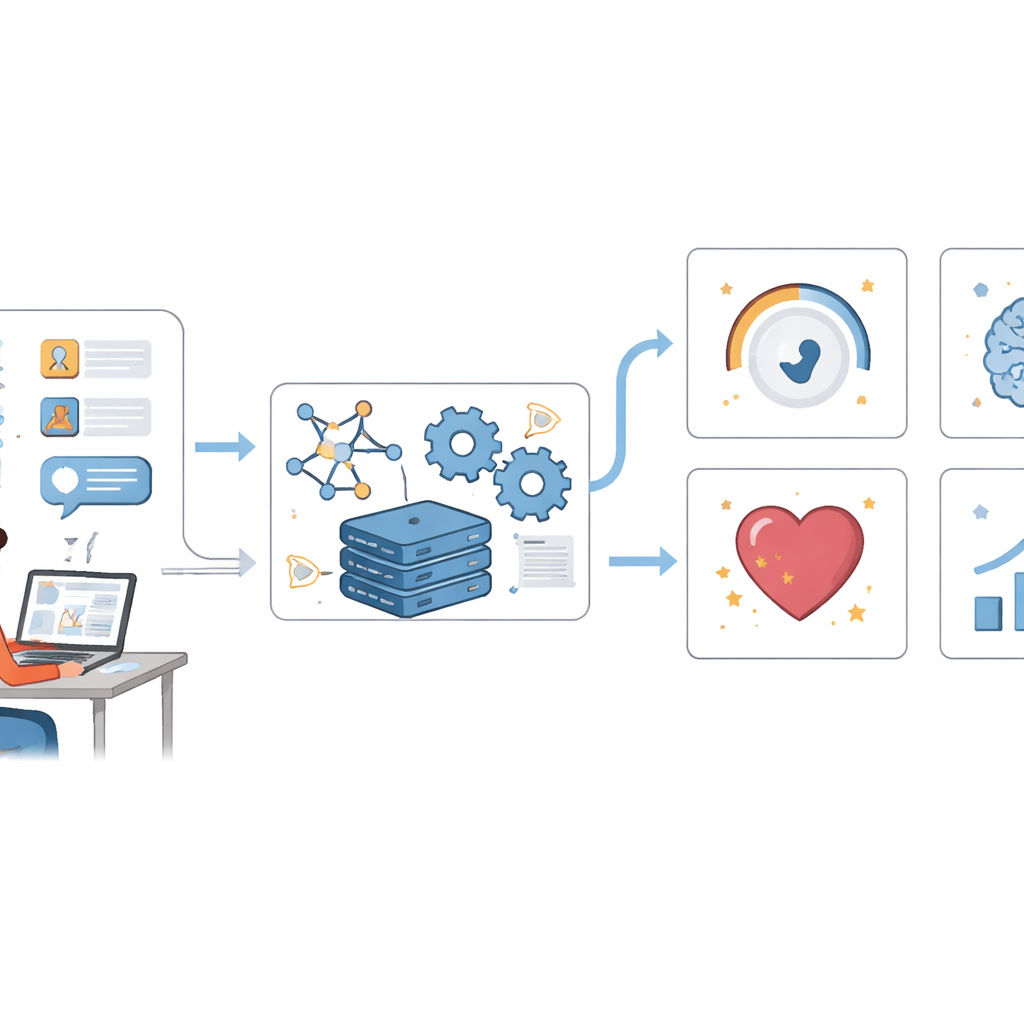

Da immer mehr Kurse online stattfinden, kann das Erscheinungsbild und die Bedienbarkeit von Lernplattformen den Unterschied ausmachen zwischen einer Studentin, die ganz bei der Sache ist, und einer, die stillschweigend abschaltet. Dieses Papier stellt eine einfache, aber häufig gefragte Frage: Welche konkreten Bildschirmfunktionen in KI‑gestützten Lernsystemen machen das Lernen tatsächlich einfacher, ansprechender und wirkungsvoller — und welche sind größtenteils digitale Dekoration?

Die Funktionen hinter einer nutzerfreundlichen Lernplattform

Die Forschenden konzentrierten sich auf fünf gängige Elemente, die in modernen Online‑Kursen vorkommen. Adaptive Feedback‑Panels sind aufklappbare Bereiche, die maßgeschneiderte Hinweise und Anleitung geben. Gamification‑Elemente fügen spielartige Belohnungen wie Punkte oder Abzeichen hinzu. Live konversationelle Agenten fungieren als chatähnliche virtuelle Tutoren. Fortschrittsvisualisierungen zeigen an, wie weit eine Lernende gekommen ist. Mikro‑Assessments sind kleine Inline‑Quizze, die das Verständnis sofort prüfen. Anstatt diese Werkzeuge als vage „nice to haves“ zu behandeln, betrachtete das Team jedes einzelne als kontrollierbaren Baustein, der ein‑ oder ausgeschaltet und detailliert untersucht werden konnte.

Ein sorgfältig kontrolliertes Klassenzimmer auf dem Bildschirm

Um diese Ideen zu testen, bauten die Autorinnen und Autoren ein vollständiges, KI‑gesteuertes digitales Lernsystem von Grund auf. Im Hintergrund nutzt es fortgeschrittene Modelle, um abzuschätzen, was jede Lernende weiß, wie überlastet sie möglicherweise ist und wann sie Hilfe braucht. An der Oberfläche kann die Bedienoberfläche einzelne Funktionen für verschiedene Gruppen von Studierenden ein‑ oder ausschalten, ohne den Unterrichtsinhalt selbst zu verändern. In einer kontrollierten Laborstudie wurden 240 Universitätsstudierende zufällig sechs Versionen der Plattform zugewiesen, von einer nackten Kontrolloberfläche bis hin zu einer voll ausgestatteten Schnittstelle mit allen fünf aktivierten Elementen. Alle bearbeiteten dasselbe Material 30 Minuten lang und beantworteten anschließend Tests und detaillierte Fragebögen zu ihren Erfahrungen.

Was den Studierenden am meisten half

Die Ergebnisse zeigen, dass nicht alle interaktiven Extras gleichwertig sind. Der Live‑Konversationsagent und die adaptiven Feedback‑Panels hatten den stärksten Einfluss darauf, wie nutzbar die Studierenden das System fanden und wie gut sie lernten. Studierende mit diesen Unterstützungen erledigten Aufgaben schneller, verlangten seltener zusätzliche Hinweise und berichteten über geringere mentale Belastung. Gamification‑Elemente fielen besonders durch die Steigerung von Motivation und emotionaler Beteiligung auf und machten die Erfahrung belohnender und visueller ansprechender. Fortschrittsbalken und ähnliche Anzeigen halfen bei der Navigation und verringerten zielloses Klicken, auch wenn ihre Effekte moderater waren. Kleine eingebettete Quizze trugen bei, jedoch deutlich weniger als die sozial‑ und feedbackorientierten Werkzeuge.

Wenn Funktionen besser zusammenwirken

Da das System jeden Klick, jede Pause und jede Abschlusszeit protokollierte, konnten die Forschenden über einfache Mittelwerte hinausgehen. Sie nutzten sowohl traditionelle Statistik als auch moderne maschinelle Lernmodelle, um zu untersuchen, wie Funktionen miteinander interagieren. Diese Modelle zeigten, dass Kombinationen zählen: Das Paar aus Konversationsagent und adaptivem Feedback erzeugte eine stärkere Gesamtenwicklung der Nutzererfahrung als jede der beiden Funktionen für sich. Anders gesagt: Ein freundlicher Bildschirmtutor, der zugleich präzise, just‑in‑time‑Anleitungen liefern kann, schafft einen reibungsloseren und selbstbewussteren Lernfluss als nur soziale Präsenz oder nur Feedback allein. Andere Kombinationen, wie Spielbelohnungen in Verbindung mit klaren Fortschrittsanzeigen, zeigten ebenfalls kleinere, aber spürbare Synergieeffekte.

Was das für zukünftiges Online‑Lernen bedeutet

Für Nicht‑Fachleute, die digitale Lernwerkzeuge entwerfen oder auswählen, ist die Botschaft praktisch und klar. Sind die Ressourcen begrenzt, lohnt sich die Investition in einen reaktionsfähigen, chatähnlichen Tutor und echtes adaptives Feedback am meisten für Benutzerfreundlichkeit, Engagement und bessere Testergebnisse. Spielartige Belohnungen und Fortschrittsanzeigen sollten diese Kernunterstützungen ergänzen, nicht ersetzen. Insgesamt zeigt die Studie, dass wohlüberlegt kombinierte Funktionen in KI‑gesteuerten Oberflächen einen Online‑Kurs von einer statischen Seitenfolge in eine geführte, weniger stressige und wirkungsvollere Lernreise verwandeln können.

Zitation: Chen, R., Zhang, J. Modelling the impact of interactive interface features on user experience in artificial intelligence driven digital learning systems. Sci Rep 16, 14619 (2026). https://doi.org/10.1038/s41598-026-41429-y

Schlüsselwörter: KI in der Bildung, digitale Lernoberflächen, Benutzererfahrung, konversationelle Agenten, adaptives Feedback