Clear Sky Science · de

KI‑gestützte multimodale Bildfusion mit Swin Transformer und optimierten Tensor‑Fusionsnetzen zur Pneumonie‑Erkennung

Warum intelligentere Pneumonie‑Checks wichtig sind

Pneumonie kann einen einfachen Husten in einen lebensbedrohlichen Notfall verwandeln, besonders bei Kindern, älteren Menschen und Personen mit geschwächtem Immunsystem. Ärztinnen und Ärzte erkennen sie meist durch die Beurteilung von Thorax‑Röntgenaufnahmen oder CT‑Scans, doch das Lesen tausender solcher Bilder pro Jahr ist anstrengend und mitunter unsicher, insbesondere in überfüllten oder unterversorgten Kliniken. Dieses Papier stellt ein neues System der künstlichen Intelligenz (KI) vor, das Lungenbilder aus mehreren Quellen gleichzeitig analysiert, seine Befunde erklärt und sogar das Risiko des Zustands eines Patienten einschätzt — mit dem Ziel, schnellere und verlässlichere Unterstützung zu bieten, nicht Ärztinnen und Ärzte zu ersetzen.

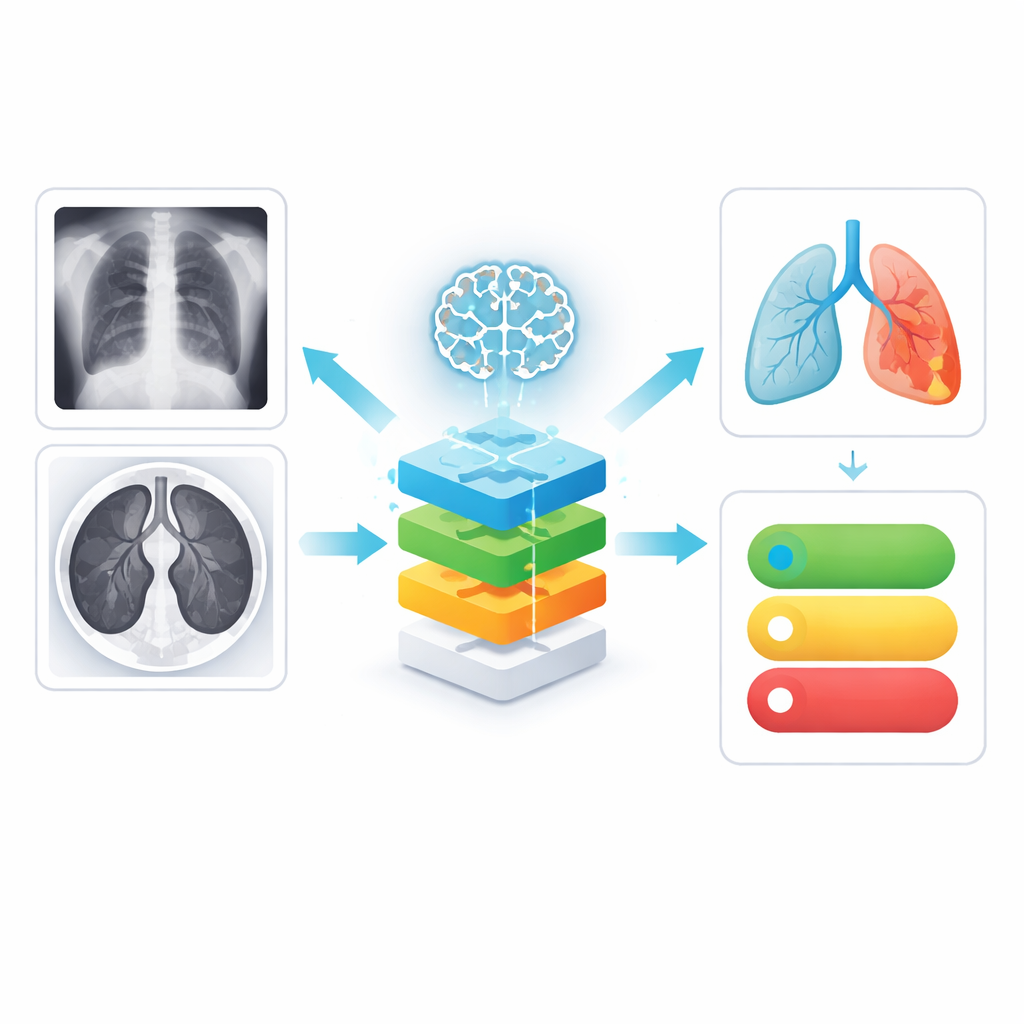

Verschiedene Lungenbilder zusammenführen

Die Autorinnen und Autoren konzentrieren sich auf zwei gängige Bildgebungsarten: Thorax‑Röntgenaufnahmen, die preiswert und weit verbreitet sind, und CT‑Scans, die detailliertere Querschnitte der Lunge liefern. Anstatt diese als voneinander getrennte Welten zu behandeln, lernt das System aus beiden. Zunächst bereinigt ein spezialisiertes Bild‑Vorverarbeitungsmodul jedes Bild, entfernt Rauschen und hebt schwache helle Flecken sowie verwaschene Bereiche hervor, die oft auf frühe Pneumonie hindeuten. Dadurch werden feine Krankheitsmuster für die KI sichtbarer und indirekt auch für Klinikpersonal, das später die Erklärungen des Systems überprüft.

Wie die KI Krankheitsmuster lernt

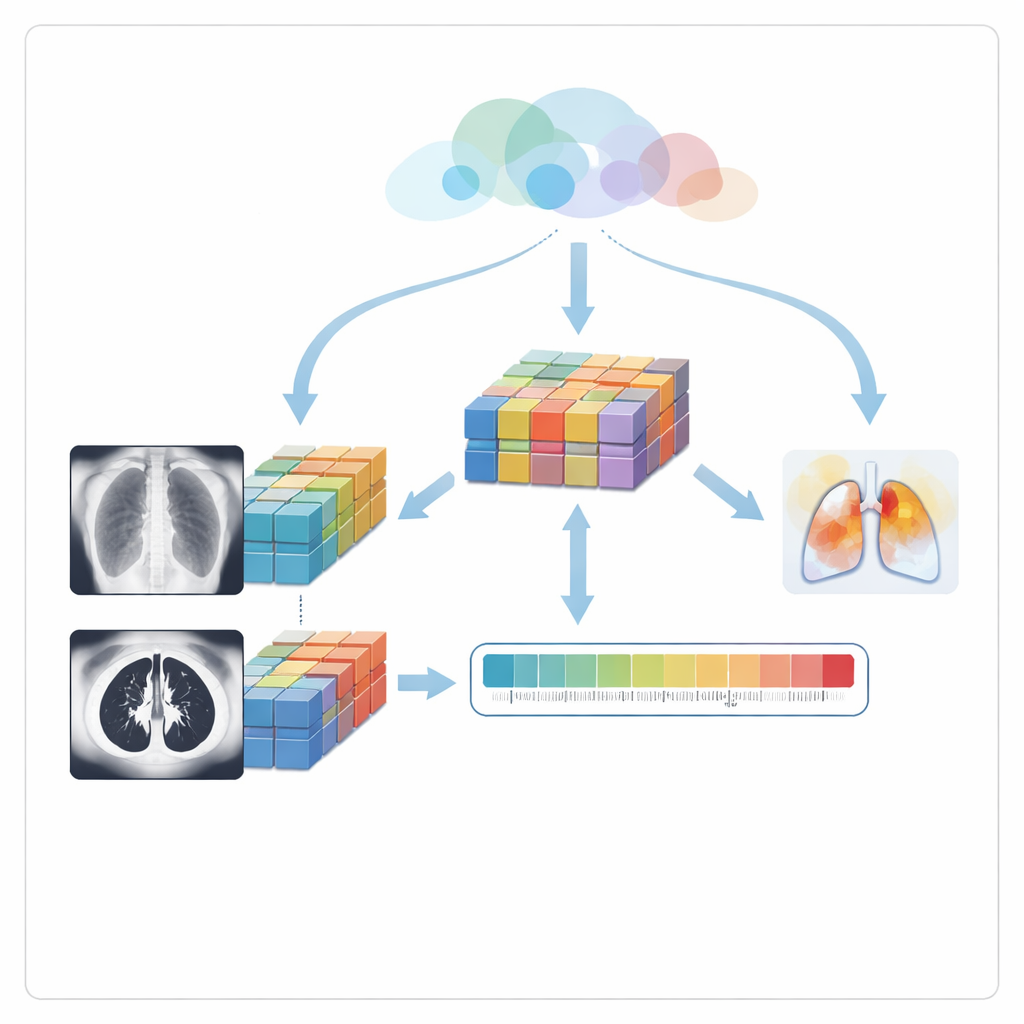

Nach der Bereinigung wird jedes Bild an ein modernes Vision‑Modell namens Swin Transformer übergeben. Anders als traditionelle Methoden, die ein Bild mit festen Filtern absuchen, betrachtet dieses Modell das Bild durch viele kleine, sich überlappende Fenster und baut schrittweise ein mehrschichtiges Verständnis von Formen und Texturen auf — von feinen Lungenstrukturen bis zu größeren Mustern über den Thorax hinweg. Separate Instanzen dieses Modells analysieren Röntgenaufnahmen und CT‑Scans und erzeugen reichhaltige Zusammenfassungen, die sowohl lokale Auffälligkeiten als auch die globale Struktur erfassen, etwa fleckige Verschattungen oder flüssigkeitsgefüllte Bereiche, die häufig mit Pneumonie einhergehen.

Ansichten kombinieren und Unsicherheit handhaben

Die nächste Herausforderung besteht darin, das aus den beiden Bildtypen Gelernte zu verschmelzen. Anstatt einfach Werte zu mitteln, verwendet das System ein Tensor‑Fusionsnetzwerk, das mathematisch jede Merkmalsdimension der Röntgenbilder mit jeder Merkmalsdimension der CT‑Scans verknüpft und so erfasst, wie sich Muster in einer Ansicht mit Mustern in der anderen verstärken oder widersprechen. Da dies eine überwältigende Anzahl von Kombinationen erzeugen kann, kürzt eine von Zebra‑Herdenbewegungen inspirierte Optimierung redundante oder wenig hilfreiche Verbindungen, sodass nur die informativsten Beziehungen erhalten bleiben. Diese gefundene Fusion wird anschließend in ein Bayessches neuronales Netzwerk eingespeist, das nicht nur vorhersagt, ob eine Pneumonie vorliegt, sondern auch seine Zuverlässigkeit abschätzt. Mehrfaches Wiederholen der Vorhersage mit leichten internen Variationen erlaubt dem Modell, seine eigene Unsicherheit zu messen — ein entscheidender Hinweis für Ärztinnen und Ärzte, um zu entscheiden, wann sie der Ausgabe vertrauen oder genauer nachsehen sollten.

Ärztinnen und Ärzten zeigen, wohin das Modell blickt

Um eine „Black‑Box“‑Diagnose zu vermeiden, nutzt das System eine Technik namens Grad‑CAM, um Regionen jeder Aufnahme hervorzuheben, die die Entscheidung am stärksten beeinflusst haben. Diese Hervorhebungen erscheinen als farbige Überlagerungen auf Röntgen‑ und CT‑Bildern und markieren typischerweise vernebelte oder konsolidierte Lungenbereiche, die Radiologinnen und Radiologen bekannt sind. Die Autorinnen und Autoren gehen noch einen Schritt weiter: Sie messen, wie gut diese hervorgehobenen Regionen mit der tatsächlichen Lungenfläche überlappen, und wandeln das in einen visuellen Konsistenz‑Score um. Schließlich kombiniert ein Risikomodul drei Komponenten — die vorhergesagte Wahrscheinlichkeit einer Pneumonie, die Unsicherheit des Modells und diese visuelle Konsistenz — zu einem einzigen Risikoscore von niedrig bis hoch. Überschreitet dieser Score eine voreingestellte Schwelle, soll das System Frühwarnungen auslösen, damit Patientinnen und Patienten mit hohem Risiko priorisiert werden können.

Was die Ergebnisse für Patientinnen und Patienten bedeuten

Getestet an öffentlichen Röntgen‑ und CT‑Datensätzen übertraf das Framework mehrere weit verbreitete Deep‑Learning‑Modelle, erreichte hohe Genauigkeit und lieferte zugleich Unsicherheitsabschätzungen sowie klare visuelle Hinweise. Obwohl die Daten keine aus denselben Patientinnen und Patienten stammenden, abgeglichenen Aufnahmen enthielten und aus begrenzten Quellen kamen, zeigt die Arbeit, dass eine sorgfältig gestaltete multimodale KI mehr leisten kann als nur Bilder zu kennzeichnen: Sie kann verschiedene Blickwinkel der Lunge fusionieren, ihre Zuversicht angeben und genau zeigen, wo sie Auffälligkeiten erkennt. Für Patientinnen und Patienten könnten solche Systeme schnellere Diagnosen, bessere Triage in überfüllten Krankenhäusern und gezieltere Nachsorge bedeuten — besonders in Regionen, in denen erfahrene Radiologinnen und Radiologen rar sind.

Zitation: Sikindar, S., Raghavendran, C.V. & Madhavi, G. AI-driven multimodal imaging fusion using swin transformer and optimized tensor fusion networks for pneumonia detection. Sci Rep 16, 12611 (2026). https://doi.org/10.1038/s41598-026-41427-0

Schlüsselwörter: Pneumonie‑Erkennung, medizinische Bild‑KI, Thorax‑Röntgen, CT‑Scan, Risikobewertung